Typhoon2.1 Gemma3 12b

Typhoon2.1-Gemma3-12B 是一個基於Gemma3架構的120億參數泰語大語言模型,支持128K上下文長度和函數調用功能。

下載量 159.13k

發布時間 : 5/1/2025

模型概述

這是一個指令微調版的泰語大語言模型,擅長泰語和英語的文本生成、分析、問答、數學、編程等多種任務。

模型特點

大參數規模

擁有120億參數,提供強大的語言理解和生成能力

長上下文支持

支持128K的上下文長度,適合處理長文檔和複雜對話

函數調用能力

支持工具調用功能,可以集成外部API擴展模型能力

雙語言支持

同時擅長泰語和英語,適合多語言應用場景

模型能力

文本生成

問答系統

數學計算

編程輔助

創意寫作

教學輔導

角色扮演

工具調用

使用案例

智能助手

泰語客服機器人

用於處理泰語客戶的諮詢和問題解答

提供流暢自然的泰語對話體驗

教育

泰語學習助手

幫助非母語者學習泰語

提供準確的泰語解釋和例句

開發工具

API集成開發

通過函數調用功能集成外部服務

擴展模型能力,實現更復雜的應用

🚀 Typhoon2.1-Gemma3-12B:泰語大語言模型(指令型)

Typhoon2.1-Gemma3-12B 是一款指令型泰語大語言模型,擁有 120 億參數、128K 的上下文長度以及函數調用能力。它基於 Gemma3 12B 構建。

備註:這是一個僅處理文本的模型。由於複雜性原因,此版本移除了視覺編碼器。請持續關注後續帶有視覺編碼器的版本。

🚀 快速開始

本模型可用於泰語或英語文本生成,以下是使用示例和部署說明。

✨ 主要特性

- 基於 Gemma3 架構的 12B 指令型僅解碼器模型。

- 支持 128K 的上下文長度。

- 具備函數調用能力。

- 可作為 OpenAI 兼容的 API 服務器運行。

- 支持思維模式和非思維模式切換。

- 支持預算強制技術,提升複雜問題的處理性能。

📦 安裝指南

安裝依賴

若要將 Typhoon2.1 作為 OpenAI 兼容的 API 服務器運行,需使用 vllm,可按以下命令安裝:

pip install vllm

運行服務器

vllm serve scb10x/typhoon2.1-gemma3-12b --max-model-len 16000 --dtype bfloat16 --tool-call-parser pythonic --enable-auto-tool-choice

# 根據可用內存調整 --max-model-len

# 可使用 --quantization bitsandbytes 減少內存使用,但會犧牲推理速度

💻 使用示例

基礎用法

以下代碼展示瞭如何使用 transformers 庫調用 Typhoon2.1-Gemma3-12B 模型進行泰語或英語文本生成:

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

model_id = "scb10x/typhoon2.1-gemma3-12b"

tokenizer = AutoTokenizer.from_pretrained(model_id)

model = AutoModelForCausalLM.from_pretrained(

model_id,

torch_dtype=torch.bfloat16,

device_map="auto",

)

messages = [

{"role": "system", "content": "You are a male AI assistant named Typhoon created by SCB 10X to be helpful, harmless, and honest. Typhoon is happy to help with analysis, question answering, math, coding, creative writing, teaching, role-play, general discussion, and all sorts of other tasks. Typhoon responds directly to all human messages without unnecessary affirmations or filler phrases like “Certainly!”, “Of course!”, “Absolutely!”, “Great!”, “Sure!”, etc. Specifically, Typhoon avoids starting responses with the word “Certainly” in any way. Typhoon follows this information in all languages, and always responds to the user in the language they use or request. Typhoon is now being connected with a human. Write in fluid, conversational prose, Show genuine interest in understanding requests, Express appropriate emotions and empathy. Also showing information in term that is easy to understand and visualized."},

{"role": "user", "content": "ขอสูตรไก่ย่าง"},

]

input_ids = tokenizer.apply_chat_template(

messages,

add_generation_prompt=True,

return_tensors="pt",

enable_thinking=False # Switches between thinking and non-thinking modes. Default is False.

).to(model.device)

outputs = model.generate(

input_ids,

max_new_tokens=512,

do_sample=True,

temperature=0.6,

top_p=0.95,

)

response = outputs[0][input_ids.shape[-1]:]

print(tokenizer.decode(response, skip_special_tokens=True))

高級用法

使用工具

你可以為 vLLM 驅動的 OpenAI 兼容 API 提供工具以實現特定功能:

from openai import OpenAI

import json

client = OpenAI(base_url="http://localhost:8000/v1", api_key="dummy")

def get_weather(location: str, unit: str):

return f"Getting the weather for {location} in {unit}..."

tool_functions = {"get_weather": get_weather}

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get the current weather in a given location",

"parameters": {

"type": "object",

"properties": {

"location": {"type": "string", "description": "City and state, e.g., 'San Francisco, CA'"},

"unit": {"type": "string", "enum": ["celsius", "fahrenheit"]}

},

"required": ["location", "unit"]

}

}

}]

response = client.chat.completions.create(

model=client.models.list().data[0].id,

messages=[{"role": "user", "content": "What's the weather like in San Francisco?"}],

tools=tools,

tool_choice="auto"

)

tool_call = response.choices[0].message.tool_calls[0].function

print(f"Function called: {tool_call.name}")

print(f"Arguments: {tool_call.arguments}")

print(f"Result: {get_weather(**json.loads(tool_call.arguments))}")

思維模式與非思維模式切換

Typhoon 支持兩種模式:

- 非思維模式(默認):快速生成響應,無需額外推理步驟。

- 思維模式:模型先進行內部推理,然後提供更清晰、可能更準確的最終答案。

你可以通過以下方式啟用思維模式:

- 在

apply_chat_template中設置enable_thinking=True:

input_ids = tokenizer.apply_chat_template(

messages,

add_generation_prompt=True,

return_tensors="pt",

enable_thinking=True # Switches between thinking and non-thinking modes. Default is False.

).to(model.device)

- 手動提供思維模式系統提示:

You are a helpful assistant. First, think through the reasoning internally, then present the reasoning within <think>...</think>. After thinking, clearly state a response that addresses the user's request and aligns with their preferences, not just providing a direct answer.

- 在 vLLM 驅動的 OpenAI 兼容客戶端中,可在 POST 有效負載中添加

chat_template_kwargs:

{

"model": "scb10x/typhoon2.1-gemma3-12b",

"messages": [

{"role": "user", "content": "Give me a short introduction to large language models."}

],

"chat_template_kwargs": {"enable_thinking": true}

}

預算強制技術

預算強制是一種高級技術,可讓模型在生成最終答案前花費更多時間和令牌進行推理,有助於提高複雜問題的處理性能:

from vllm import LLM, SamplingParams

from transformers import AutoTokenizer

class BudgetForcingHandler:

def __init__(self, model_name: str, max_think_token: int, max_ignore=5, temperature=0.6, seed=32):

self.temperature = temperature

self.seed = seed

self.max_think_token = max_think_token

self.max_ignore = max_ignore

self.model = LLM(model_name, dtype='bfloat16', enforce_eager=True)

self.tokenizer = AutoTokenizer.from_pretrained(model_name)

self.alternative_str = '\nAlternatively'

self.system = """You are a reasoning assistant. First, think through the reasoning internally, then present the reasoning within <think>...</think>. After thinking, clearly state the final answer."""

def __call__(self, prompts: List[str]):

count_prompt = len(prompts)

prompts = [self.tokenizer.apply_chat_template([{'role': 'system', 'content': self.system}, {'role': 'user', 'content': f'Please solve this math question, and put your final answer within \\boxed{{}}.\n{p}'}], add_generation_prompt=True, tokenize=False) for p in prompts]

sampling_params = SamplingParams(

max_tokens=self.max_think_token,

seed=self.seed,

stop=["</think>"],

skip_special_tokens=False,

temperature=self.temperature,

)

o = self.model.generate(

prompts,

sampling_params=sampling_params

)

outputs = [output.outputs[0].text for output in o]

token_count = [len(output.outputs[0].token_ids) for output in o]

for i in range(len(prompts)):

prompts[i] = prompts[i] + outputs[i]

for _ in range(self.max_ignore): # Num of times to skip stop token

inference_loop_prompts = []

inference_idx = []

max_inference_token = 0

print('current token count: ', token_count)

for i in range(len(prompts)):

left_budget = self.max_think_token - token_count[i]

if left_budget > 0:

prompts[i] = prompts[i] + self.alternative_str

inference_loop_prompts.append(prompts[i])

inference_idx.append(i)

if left_budget > max_inference_token:

max_inference_token = left_budget

outputs = ['' for _ in range(len(prompts))]

if max_inference_token == 0 or len(inference_loop_prompts) == 0:

break

sampling_params = SamplingParams(

max_tokens=max_inference_token,

min_tokens=1,

seed=self.seed,

stop=["</think>"],

skip_special_tokens=False,

temperature=self.temperature,

)

o = self.model.generate(

inference_loop_prompts,

sampling_params=sampling_params

)

assert len(inference_idx) == len(inference_loop_prompts)

assert len(inference_idx) == len(o)

for i, output in zip(inference_idx, o):

outputs[i] = output.outputs[0].text

for i, idx in enumerate(inference_idx):

token_count[idx] = token_count[idx] + len(o[i].outputs[0].token_ids)

for i in range(len(prompts)):

prompts[i] = prompts[i] + outputs[i]

print('generating answer...')

prompts = [p + '\nTime\'s up. End of thinking process. Will answer immediately.\n</think>' for i, p in enumerate(prompts)]

sampling_params = SamplingParams(

max_tokens=2048,

min_tokens=0,

seed=self.seed,

skip_special_tokens=False,

temperature=self.temperature,

)

o = self.model.generate(

prompts,

sampling_params=sampling_params,

)

for i in range(len(prompts)):

prompts[i] = prompts[i] + o[i].outputs[0].text

assert len(prompts) == count_prompt

return prompts

handler = BudgetForcingHandler("scb10x/typhoon2.1-gemma3-12b", max_think_token=2048)

handler(["How many r in raspberry?"])

📚 詳細文檔

模型描述

| 屬性 | 詳情 |

|---|---|

| 模型類型 | 基於 Gemma3 架構的 12B 指令型僅解碼器模型 |

| 要求 | transformers 4.50.0 或更高版本 |

| 主要語言 | 泰語和英語 |

| 上下文長度 | 128K |

| 許可證 | Gemma 許可證 |

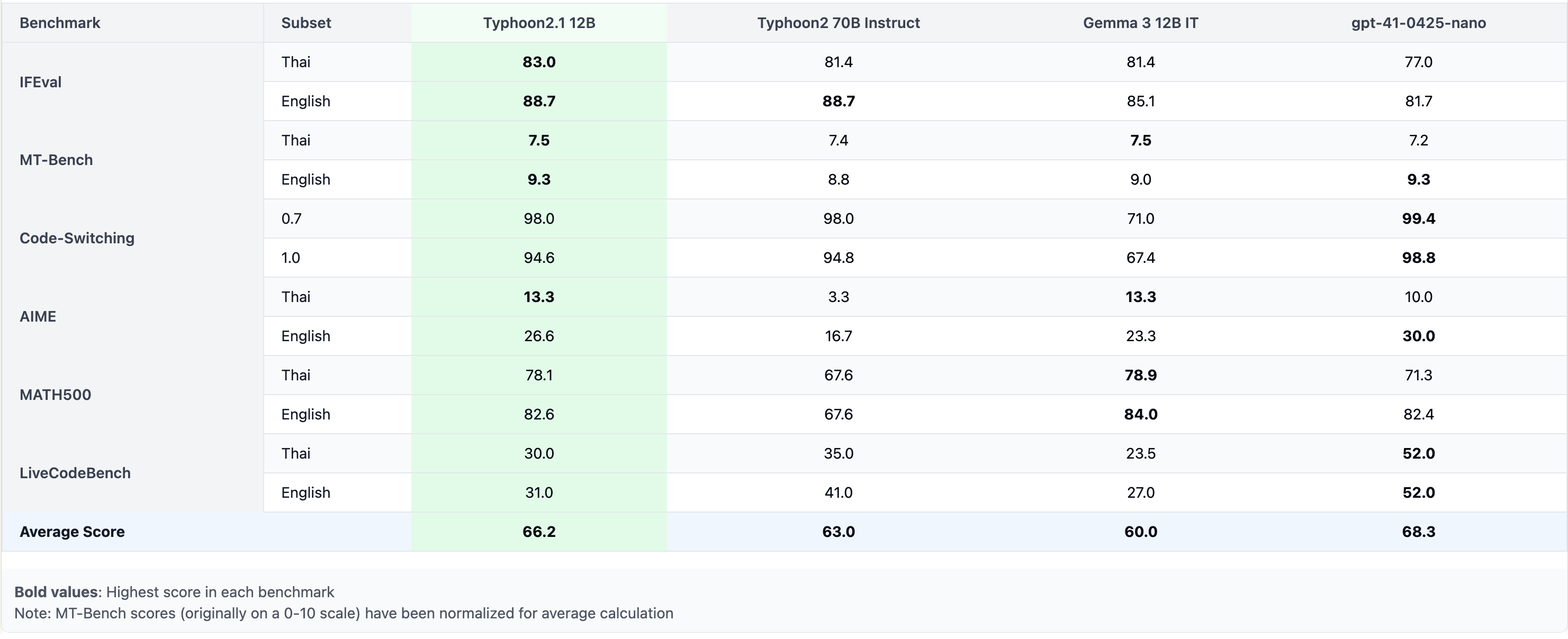

性能

預期用途與限制

此模型為指令型模型,但仍在開發中。它包含了一定程度的防護機制,但在響應用戶提示時,仍可能產生不準確、有偏差或其他令人反感的答案。建議開發者在其使用場景中評估這些風險。

關注我們

https://twitter.com/opentyphoon

支持

https://discord.gg/us5gAYmrxw

引用

如果你發現 Typhoon2 對你的工作有幫助,請使用以下方式引用:

@misc{typhoon2,

title={Typhoon 2: A Family of Open Text and Multimodal Thai Large Language Models},

author={Kunat Pipatanakul and Potsawee Manakul and Natapong Nitarach and Warit Sirichotedumrong and Surapon Nonesung and Teetouch Jaknamon and Parinthapat Pengpun and Pittawat Taveekitworachai and Adisai Na-Thalang and Sittipong Sripaisarnmongkol and Krisanapong Jirayoot and Kasima Tharnpipitchai},

year={2024},

eprint={2412.13702},

archivePrefix={arXiv},

primaryClass={cs.CL},

url={https://arxiv.org/abs/2412.13702},

}

📄 許可證

本模型使用 Gemma 許可證。

Phi 2 GGUF

其他

Phi-2是微軟開發的一個小型但強大的語言模型,具有27億參數,專注於高效推理和高質量文本生成。

大型語言模型 支持多種語言

P

TheBloke

41.5M

205

Roberta Large

MIT

基於掩碼語言建模目標預訓練的大型英語語言模型,採用改進的BERT訓練方法

大型語言模型 英語

R

FacebookAI

19.4M

212

Distilbert Base Uncased

Apache-2.0

DistilBERT是BERT基礎模型的蒸餾版本,在保持相近性能的同時更輕量高效,適用於序列分類、標記分類等自然語言處理任務。

大型語言模型 英語

D

distilbert

11.1M

669

Llama 3.1 8B Instruct GGUF

Meta Llama 3.1 8B Instruct 是一個多語言大語言模型,針對多語言對話用例進行了優化,在常見的行業基準測試中表現優異。

大型語言模型 英語

L

modularai

9.7M

4

Xlm Roberta Base

MIT

XLM-RoBERTa是基於100種語言的2.5TB過濾CommonCrawl數據預訓練的多語言模型,採用掩碼語言建模目標進行訓練。

大型語言模型 支持多種語言

X

FacebookAI

9.6M

664

Roberta Base

MIT

基於Transformer架構的英語預訓練模型,通過掩碼語言建模目標在海量文本上訓練,支持文本特徵提取和下游任務微調

大型語言模型 英語

R

FacebookAI

9.3M

488

Opt 125m

其他

OPT是由Meta AI發佈的開放預訓練Transformer語言模型套件,參數量從1.25億到1750億,旨在對標GPT-3系列性能,同時促進大規模語言模型的開放研究。

大型語言模型 英語

O

facebook

6.3M

198

1

基於transformers庫的預訓練模型,適用於多種NLP任務

大型語言模型 Transformers

Transformers

Transformers

Transformers1

unslothai

6.2M

1

Llama 3.1 8B Instruct

Llama 3.1是Meta推出的多語言大語言模型系列,包含8B、70B和405B參數規模,支持8種語言和代碼生成,優化了多語言對話場景。

大型語言模型 Transformers 支持多種語言

Transformers 支持多種語言

Transformers 支持多種語言

Transformers 支持多種語言L

meta-llama

5.7M

3,898

T5 Base

Apache-2.0

T5基礎版是由Google開發的文本到文本轉換Transformer模型,參數規模2.2億,支持多語言NLP任務。

大型語言模型 支持多種語言

T

google-t5

5.4M

702

精選推薦AI模型

Llama 3 Typhoon V1.5x 8b Instruct

專為泰語設計的80億參數指令模型,性能媲美GPT-3.5-turbo,優化了應用場景、檢索增強生成、受限生成和推理任務

大型語言模型 Transformers 支持多種語言

Transformers 支持多種語言

Transformers 支持多種語言

Transformers 支持多種語言L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-Tiny是一個基於SODA數據集訓練的超小型對話模型,專為邊緣設備推理設計,體積僅為Cosmo-3B模型的2%左右。

對話系統 Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

基於RoBERTa架構的中文抽取式問答模型,適用於從給定文本中提取答案的任務。

問答系統 中文

R

uer

2,694

98