Mask2former Swin Small Coco Panoptic

Swinバックボーンネットワークに基づくMask2Formerの小規模バージョンで、COCOデータセットのパノプティックセグメンテーションタスクに最適化されています

ダウンロード数 240

リリース時間 : 1/2/2023

モデル概要

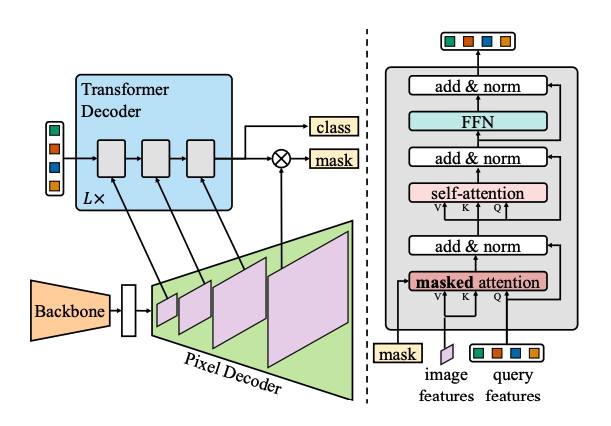

Mask2Formerは汎用画像セグメンテーションモデルで、インスタンスセグメンテーション、セマンティックセグメンテーション、パノプティックセグメンテーションタスクを統一的に処理するフレームワークを採用し、一連のマスクと対応するラベルを予測することで実現します。前世代モデルのMaskFormerと比較して、性能と効率の両面で大幅な向上が見られます。

モデル特徴

統合セグメンテーションフレームワーク

インスタンスセグメンテーション、セマンティックセグメンテーション、パノプティックセグメンテーションをインスタンスセグメンテーションタスクとして統一的に処理します

効率的なアテンションメカニズム

従来のピクセルデコーダーを置き換えるマルチスケール変形可能アテンションTransformerを採用しています

マスクアテンションデコーダー

マスクアテンション付きTransformerデコーダーを導入し、計算量を増やすことなく性能を向上させます

効率的なトレーニング戦略

マスク全体ではなくサンプリングポイントで損失を計算することで、トレーニング効率を大幅に向上させます

モデル能力

画像セグメンテーション

パノプティックセグメンテーション

インスタンスセグメンテーション

セマンティックセグメンテーション

使用事例

コンピュータビジョン

シーン理解

複雑なシーン内の物体をピクセルレベルで識別・分類します

セマンティックラベルを含むセグメンテーションマスクを生成できます

自動運転

道路シーンにおける各種物体の精密なセグメンテーション

自動運転システムが周囲環境を理解するのに役立ちます

おすすめAIモデル

Llama 3 Typhoon V1.5x 8b Instruct

タイ語専用に設計された80億パラメータの命令モデルで、GPT-3.5-turboに匹敵する性能を持ち、アプリケーションシナリオ、検索拡張生成、制限付き生成、推論タスクを最適化

大規模言語モデル Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-TinyはSODAデータセットでトレーニングされた超小型対話モデルで、エッジデバイス推論向けに設計されており、体積はCosmo-3Bモデルの約2%です。

対話システム Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

RoBERTaアーキテクチャに基づく中国語抽出型QAモデルで、与えられたテキストから回答を抽出するタスクに適しています。

質問応答システム 中国語

R

uer

2,694

98