🚀 Stable Diffusion TrinArt/Trin-sama AI finetune v2

這是一個基於Stable Diffusion的模型,通過約40,000張各類高分辨率漫畫/動漫風格圖片進行了8個輪次的微調。它保留了原始Stable Diffusion的美學風格,同時向動漫/漫畫風格微調。

🚀 快速開始

注意事項

本模型並非TrinArt上擁有1920萬張圖像的角色模型,而是原始Trin-sama Twitter機器人模型的改進版本。該模型旨在儘可能保留原始Stable Diffusion的美學風格,同時將模型向動漫/漫畫風格引導。

其他TrinArt模型可在以下鏈接找到:

Diffusers

該模型已由 ayan4m1 移植到 diffusers,可以從以下分支輕鬆運行:

revision="diffusers-60k":訓練了60,000步的檢查點。revision="diffusers-95k":訓練了95,000步的檢查點。revision="diffusers-115k":訓練了115,000步的檢查點。

更多信息,請查看 “三種風格” 部分。

Gradio

我們還支持在Colab筆記本中使用 Gradio 網頁界面與diffusers一起運行:

💻 使用示例

基礎用法

文本到圖像示例

from diffusers import StableDiffusionPipeline

pipe = StableDiffusionPipeline.from_pretrained("naclbit/trinart_stable_diffusion_v2", revision="diffusers-60k")

pipe.to("cuda")

image = pipe("A magical dragon flying in front of the Himalaya in manga style").images[0]

image

如果您想更快地運行管道或在不同的硬件上運行,請查看 優化文檔。

圖像到圖像示例

from diffusers import StableDiffusionImg2ImgPipeline

import requests

from PIL import Image

from io import BytesIO

url = "https://scitechdaily.com/images/Dog-Park.jpg"

response = requests.get(url)

init_image = Image.open(BytesIO(response.content)).convert("RGB")

init_image = init_image.resize((768, 512))

pipe = StableDiffusionImg2ImgPipeline.from_pretrained("naclbit/trinart_stable_diffusion_v2", revision="diffusers-115k")

pipe.to("cuda")

images = pipe(prompt="Manga drawing of Brad Pitt", init_image=init_image, strength=0.75, guidance_scale=7.5).images

image

如果您想更快地運行管道或在不同的硬件上運行,請查看 優化文檔。

📚 詳細文檔

版本2說明

V2檢查點使用了丟棄法(dropouts),增加了10,000張圖像,並採用了新的標籤策略,經過更長時間的訓練,旨在保留原始美學風格的同時改善結果。

三種風格

訓練到115,000步/95,000步的檢查點經過了進一步訓練,但如果您覺得風格調整過度,可以使用訓練到60,000步的檢查點。

圖像到圖像

如果您想使用此模型運行 latent-diffusion 的庫存ddim圖像到圖像腳本,必須將 use_ema 設置為 False。

硬件要求

訓練信息

- 自定義數據集加載器,帶有增強操作:水平翻轉、中心裁剪和鎖定寬高比的縮放。

- 學習率(LR):1.0e-5

- 10%的丟棄率

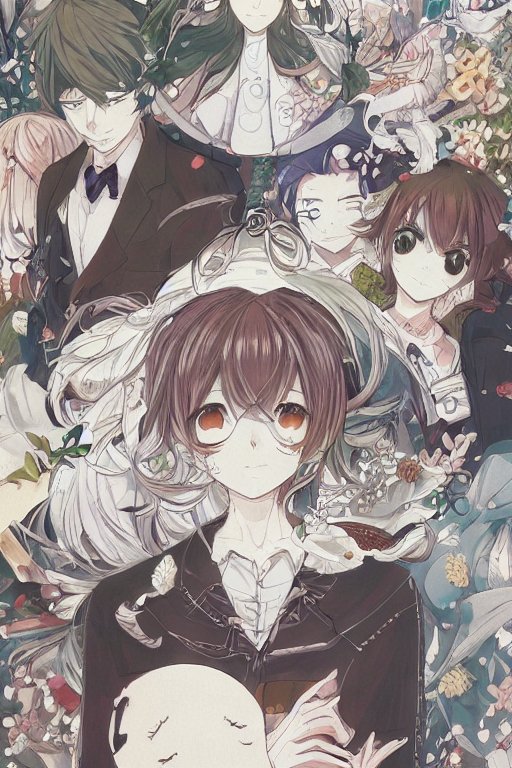

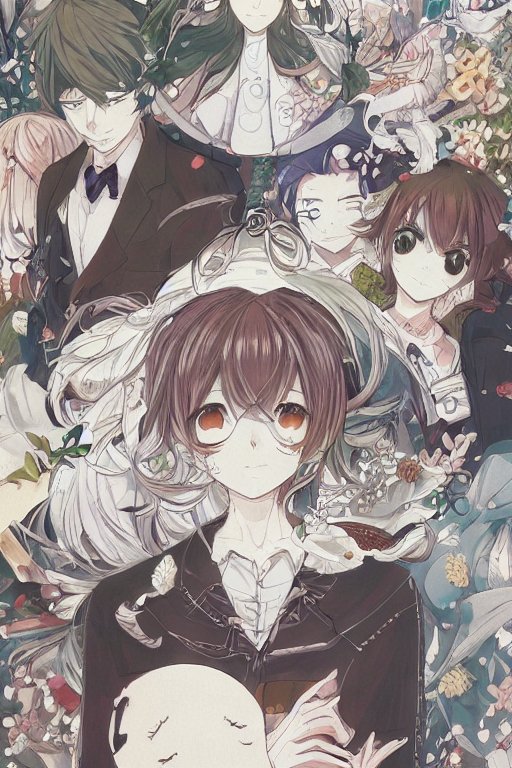

示例

每張圖像均使用K. Crowson的k-lms(來自k-diffusion倉庫)方法進行了50步擴散。

致謝

- Sta, AI小說家開發者 (https://ai-novel.com/) @ Bit192, Inc.

- Stable Diffusion - Rombach, Robin and Blattmann, Andreas and Lorenz, Dominik and Esser, Patrick and Ommer, Bjorn

📄 許可證

CreativeML OpenRAIL-M

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語