🚀 Swin Transformer v2 (大型モデル)

Swin Transformer v2は、解像度192x192のImageNet - 21kで事前学習されたモデルです。このモデルは、Liuらによる論文 Swin Transformer V2: Scaling Up Capacity and Resolution で紹介され、[このリポジトリ](https://github.com/microsoft/Swin - Transformer) で最初に公開されました。

なお、Swin Transformer v2をリリースしたチームはこのモデルのモデルカードを作成していないため、このモデルカードはHugging Faceチームによって作成されています。

🚀 クイックスタート

このモデルは画像分類に使用できます。興味のあるタスクでファインチューニングされたバージョンを探すには、モデルハブ を参照してください。

✨ 主な機能

Swin Transformerの特徴

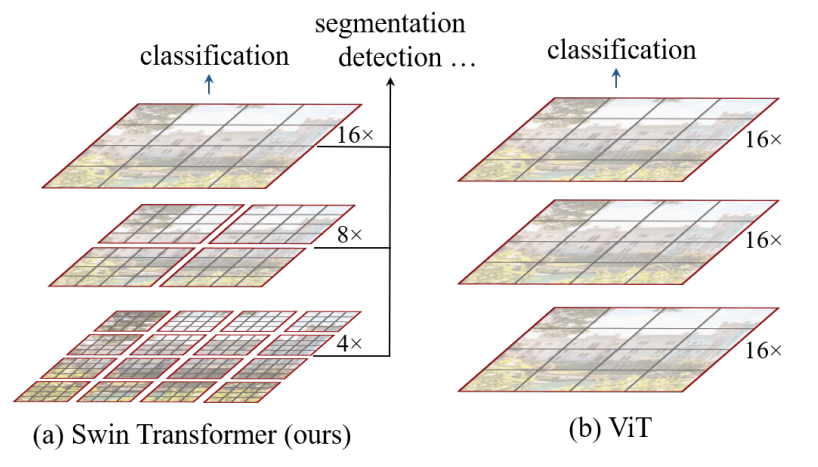

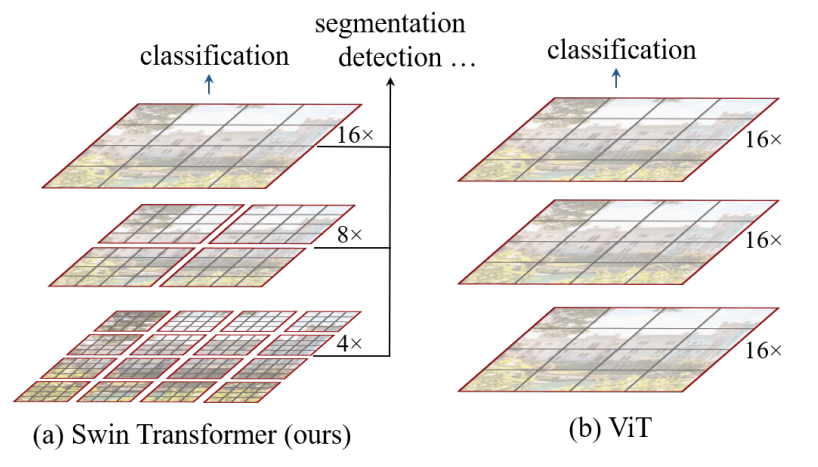

Swin TransformerはVision Transformerの一種です。より深いレイヤーで画像パッチ(灰色で表示)をマージすることで階層的な特徴マップを構築し、自己注意を各ローカルウィンドウ(赤色で表示)内でのみ計算するため、入力画像サイズに対して線形の計算量を持ちます。これにより、画像分類と密な認識タスクの両方の汎用バックボーンとして機能することができます。これに対し、以前のビジョンTransformerは単一の低解像度の特徴マップを生成し、自己注意をグローバルに計算するため、入力画像サイズに対して2次の計算量を持ちます。

Swin Transformer v2の改良点

Swin Transformer v2は3つの主要な改良点を追加しています。

- トレーニングの安定性を向上させるための、残差事後正規化法とコサイン注意の組み合わせ。

- 低解像度画像で事前学習されたモデルを高解像度入力の下流タスクに効果的に転送するための、対数間隔の連続位置バイアス法。

- 大量のラベル付き画像の必要性を減らすための自己教師付き事前学習法、SimMIM。

出典

📦 インストール

このモデルを使用するには、transformers ライブラリが必要です。以下のコマンドでインストールできます。

pip install transformers

💻 使用例

基本的な使用法

以下は、このモデルを使用してCOCO 2017データセットの画像を21kのImageNetクラスのいずれかに分類する方法です。

from transformers import AutoImageProcessor, AutoModelForImageClassification

from PIL import Image

import requests

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

processor = AutoImageProcessor.from_pretrained("microsoft/swinv2-large-patch4-window12-192-22k")

model = AutoModelForImageClassification.from_pretrained("microsoft/swinv2-large-patch4-window12-192-22k")

inputs = processor(images=image, return_tensors="pt")

outputs = model(**inputs)

logits = outputs.logits

predicted_class_idx = logits.argmax(-1).item()

print("Predicted class:", model.config.id2label[predicted_class_idx])

より多くのコード例については、ドキュメント を参照してください。

📚 ドキュメント

想定される使用法と制限

このモデルは画像分類に使用できますが、特定のタスクに最適化されたバージョンを探す場合は、モデルハブ を参照してください。

BibTeX引用

@article{DBLP:journals/corr/abs-2111-09883,

author = {Ze Liu and

Han Hu and

Yutong Lin and

Zhuliang Yao and

Zhenda Xie and

Yixuan Wei and

Jia Ning and

Yue Cao and

Zheng Zhang and

Li Dong and

Furu Wei and

Baining Guo},

title = {Swin Transformer {V2:} Scaling Up Capacity and Resolution},

journal = {CoRR},

volume = {abs/2111.09883},

year = {2021},

url = {https://arxiv.org/abs/2111.09883},

eprinttype = {arXiv},

eprint = {2111.09883},

timestamp = {Thu, 02 Dec 2021 15:54:22 +0100},

biburl = {https://dblp.org/rec/journals/corr/abs-2111-09883.bib},

bibsource = {dblp computer science bibliography, https://dblp.org}

}

📄 ライセンス

このモデルはApache - 2.0ライセンスの下で提供されています。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語