Mask2former Swin Small Cityscapes Instance

Mask2FormerはTransformerベースの統一画像セグメンテーションモデルで、マスクアテンションメカニズムにより性能を向上

ダウンロード数 43

リリース時間 : 1/5/2023

モデル概要

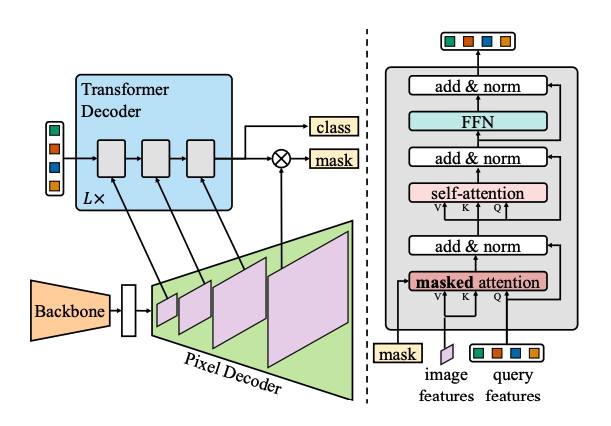

このモデルはMask2Formerの小型バージョンで、Swin Transformerをバックボーンネットワークとして使用し、Cityscapesデータセット向けにインスタンスセグメンテーションタスク用にファインチューニングされています。インスタンスセグメンテーション、セマンティックセグメンテーション、パノプティックセグメンテーションタスクを処理する統一アーキテクチャを採用しています。

モデル特徴

統一セグメンテーションアーキテクチャ

インスタンスセグメンテーション、セマンティックセグメンテーション、パノプティックセグメンテーションタスクを処理する統一パラダイムを採用

マスクアテンションメカニズム

マスク付きアテンションを備えたTransformerデコーダーを導入し、計算量を増やすことなく性能を向上

効率的なトレーニング戦略

マスク全体ではなくサンプリングポイントで損失を計算することで、トレーニング効率を大幅に向上

モデル能力

画像インスタンスセグメンテーション

マルチスケール特徴抽出

高精度な物体境界認識

使用事例

自動運転

街路物体認識

都市景観中の車両、歩行者などのインスタンスを識別

Cityscapesデータセットで優れたパフォーマンス

インテリジェント監視

シーン分析

監視映像中の物体を正確にセグメンテーションし識別

おすすめAIモデル

Llama 3 Typhoon V1.5x 8b Instruct

タイ語専用に設計された80億パラメータの命令モデルで、GPT-3.5-turboに匹敵する性能を持ち、アプリケーションシナリオ、検索拡張生成、制限付き生成、推論タスクを最適化

大規模言語モデル Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-TinyはSODAデータセットでトレーニングされた超小型対話モデルで、エッジデバイス推論向けに設計されており、体積はCosmo-3Bモデルの約2%です。

対話システム Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

RoBERTaアーキテクチャに基づく中国語抽出型QAモデルで、与えられたテキストから回答を抽出するタスクに適しています。

質問応答システム 中国語

R

uer

2,694

98