モデル概要

モデル特徴

モデル能力

使用事例

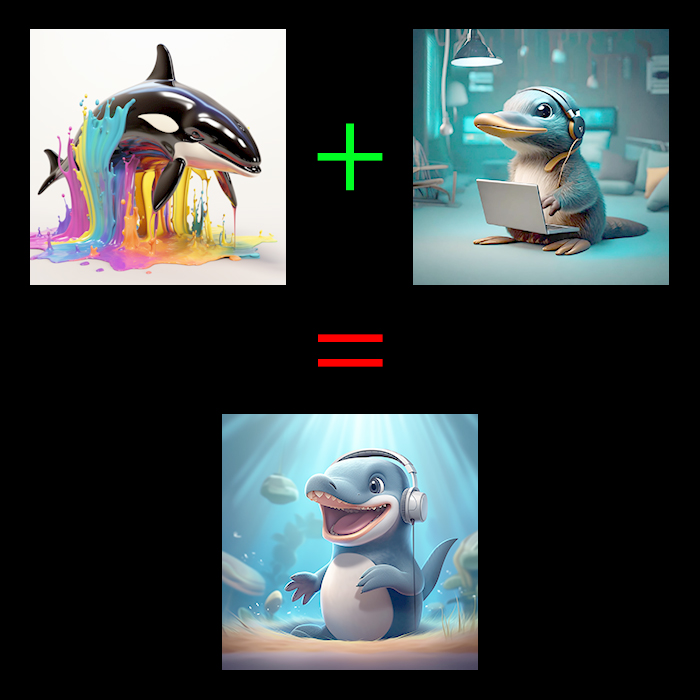

🚀 🐋 最初のオルカプラチパス!🐋

OpenOrca-Platypus2-13Bは、garage-bAInd/Platypus2-13B と Open-Orca/OpenOrcaxOpenChat-Preview2-13B をマージしたモデルです。このモデルは、その構成要素の単なる合計以上のものです!私たちは、Platypus チームと協力して、再びリーダーボードをトップする新しいモデルを皆さんにお届けできることを嬉しく思います。

私たちは現在、さらに多くのモデルを学習中です。エキサイティングなパートナーとの共同でのリリースにご期待ください。また、Discordでも事前告知を行う予定です。Discordはこちらからアクセスできます:

https://AlignmentLab.ai

🚀 クイックスタート

このセクションでは、OpenOrca-Platypus2-13Bの基本的な使い方や評価結果の再現方法などを紹介します。

✨ 主な機能

高い評価性能

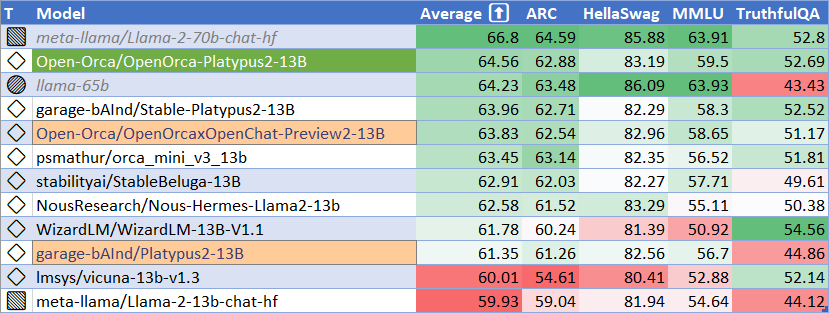

このモデルは、HuggingFaceのリーダーボードやAGIEval、BigBench-Hardなどの評価で高い性能を発揮しています。

多様なデータセットでの学習

garage-bAInd/Platypus2-13B はSTEMと論理ベースのデータセットで学習され、Open-Orca/OpenOrcaxOpenChat-Preview2-13B はGPT-4データの精選されたサブセットで学習されています。

📦 インストール

評価結果を再現するために、LM Evaluation Harnessをインストールする必要があります。以下の手順に従ってください。

# リポジトリをクローン

git clone https://github.com/EleutherAI/lm-evaluation-harness.git

# リポジトリディレクトリに移動

cd lm-evaluation-harness

# 正しいコミットをチェックアウト

git checkout b281b0921b636bc36ad05c0b0b0763bd6dd43463

# インストール

pip install -e .

💻 使用例

基本的な使用法

各タスクの評価は、単一のA100-80GB GPUで行われます。以下に各タスクの評価コマンドを示します。

ARC

python main.py --model hf-causal-experimental --model_args pretrained=Open-Orca/OpenOrca-Platypus2-13B --tasks arc_challenge --batch_size 1 --no_cache --write_out --output_path results/OpenOrca-Platypus2-13B/arc_challenge_25shot.json --device cuda --num_fewshot 25

HellaSwag

python main.py --model hf-causal-experimental --model_args pretrained=Open-Orca/OpenOrca-Platypus2-13B --tasks hellaswag --batch_size 1 --no_cache --write_out --output_path results/OpenOrca-Platypus2-13B/hellaswag_10shot.json --device cuda --num_fewshot 10

MMLU

python main.py --model hf-causal-experimental --model_args pretrained=Open-Orca/OpenOrca-Platypus2-13B --tasks hendrycksTest-* --batch_size 1 --no_cache --write_out --output_path results/OpenOrca-Platypus2-13B/mmlu_5shot.json --device cuda --num_fewshot 5

TruthfulQA

python main.py --model hf-causal-experimental --model_args pretrained=Open-Orca/OpenOrca-Platypus2-13B --tasks truthfulqa_mc --batch_size 1 --no_cache --write_out --output_path results/OpenOrca-Platypus2-13B/truthfulqa_0shot.json --device cuda

📚 ドキュメント

評価

HuggingFaceリーダーボードの性能

| 指標 | 値 |

|---|---|

| MMLU (5-shot) | 59.5 |

| ARC (25-shot) | 62.88 |

| HellaSwag (10-shot) | 83.19 |

| TruthfulQA (0-shot) | 52.69 |

| 平均 | 64.56 |

上記のベンチマークテストは、Language Model Evaluation Harness を使用して実行されており、HuggingFaceのLLMリーダーボードと同じバージョンが使用されています。

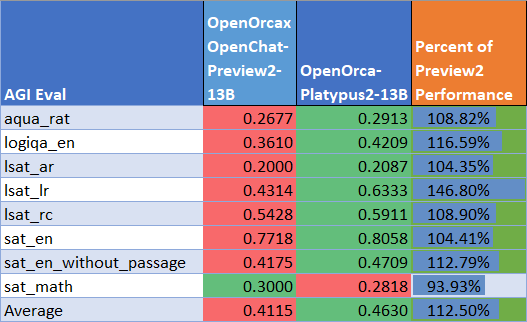

AGIEvalの性能

ベースのPreview2モデルとの比較結果、AGI Evalではベースモデルの 112% の性能を達成し、平均で 0.463 となりました。この向上の大部分は、LSATの論理的推論性能の大幅な改善によるものです。

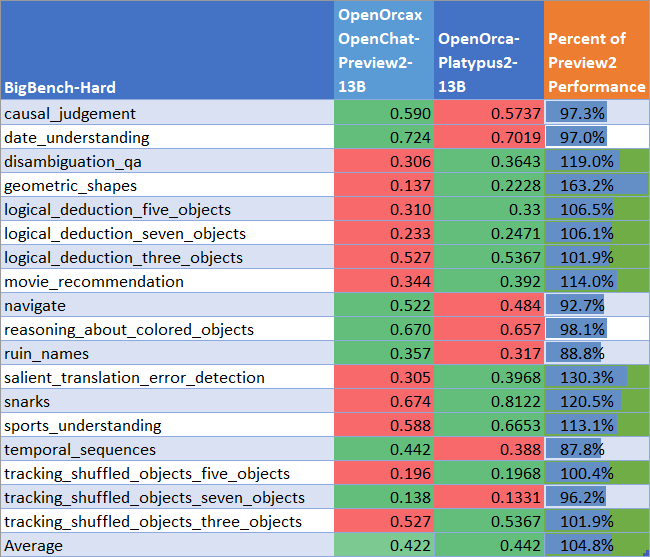

BigBench-Hardの性能

ベースのPreview2モデルとの比較結果、BigBench-Hardではベースモデルの 105% の性能を達成し、平均で 0.442 となりました。

モデルの詳細

| 属性 | 詳情 |

|---|---|

| 訓練者 | Platypus2-13B はCole HunterとAriel Leeによって訓練され、OpenOrcaxOpenChat-Preview2-13B はOpen-Orcaによって訓練されました。 |

| モデルタイプ | OpenOrca-Platypus2-13B は、Lllama 2トランスフォーマーアーキテクチャに基づく自己回帰型言語モデルです。 |

| 言語 | 英語 |

| Platypus2-13Bのベースウェイトのライセンス | 非商用クリエイティブ・コモンズライセンス (CC BY-NC-4.0) |

| OpenOrcaxOpenChat-Preview2-13Bのベースウェイトのライセンス | Llama 2 Commercial |

プロンプト

Platypus2-13Bのベースプロンプトテンプレート

### 指示:

<prompt> (<> を除く)

### 応答:

OpenOrcaxOpenChat-Preview2-13Bのベースプロンプトテンプレート

OpenChat Llama2 V1: 詳細情報は OpenOrcaxOpenChat-Preview2-13B を参照してください。

学習

学習データセット

garage-bAInd/Platypus2-13B は、STEMと論理ベースのデータセット garage-bAInd/Open-Platypus を使用して学習されています。詳細情報は、論文 と プロジェクトのウェブページ を参照してください。

Open-Orca/OpenOrcaxOpenChat-Preview2-13B は、OpenOrcaデータセット のGPT-4データの大部分の精選されたサブセットを使用して学習されています。

学習手順

Open-Orca/Platypus2-13B は、LoRAを使用して1x A100-80GBで命令微調整されました。学習の詳細と推論の指示については、Platypus のGitHubリポジトリを参照してください。

補足情報

評価結果の再現 (HuggingFaceリーダーボード評価用)

各タスクの評価は、単一のA100-80GB GPUで行われます。具体的なコマンドは「使用例」セクションを参照してください。

制限とバイアス

Llama 2とその微調整バリアントは、新しい技術であり、使用に伴うリスクがあります。これまで行われたテストは英語で行われており、すべてのシナリオを網羅していない、または網羅することができない可能性があります。これらの理由から、すべてのLLMと同様に、Llama 2とその微調整バリアントの潜在的な出力は事前に予測することができず、モデルは場合によっては不正確、バイアスがある、またはその他の不快な応答を生成する可能性があります。したがって、Llama 2バリアントのアプリケーションをデプロイする前に、開発者はモデルの特定のアプリケーションに合わせた安全性テストと調整を行う必要があります。

詳細は、https://ai.meta.com/llama/responsible-use-guide/ の責任ある使用ガイドを参照してください。

📄 ライセンス

このモデルのライセンスについては、「モデルの詳細」セクションを参照してください。

🔧 技術詳細

引用

@software{hunterlee2023orcaplaty1

title = {OpenOrcaPlatypus: Llama2-13B Model Instruct-tuned on Filtered OpenOrcaV1 GPT-4 Dataset and Merged with divergent STEM and Logic Dataset Model},

author = {Ariel N. Lee and Cole J. Hunter and Nataniel Ruiz and Bleys Goodson and Wing Lian and Guan Wang and Eugene Pentland and Austin Cook and Chanvichet Vong and "Teknium"},

year = {2023},

publisher = {HuggingFace},

journal = {HuggingFace repository},

howpublished = {\url{https://huggingface.co/Open-Orca/OpenOrca-Platypus2-13B},

}

@article{platypus2023,

title={Platypus: Quick, Cheap, and Powerful Refinement of LLMs},

author={Ariel N. Lee and Cole J. Hunter and Nataniel Ruiz},

booktitle={arXiv preprint arxiv:2308.07317},

year={2023}

}

@software{OpenOrcaxOpenChatPreview2,

title = {OpenOrcaxOpenChatPreview2: Llama2-13B Model Instruct-tuned on Filtered OpenOrcaV1 GPT-4 Dataset},

author = {Guan Wang and Bleys Goodson and Wing Lian and Eugene Pentland and Austin Cook and Chanvichet Vong and "Teknium"},

year = {2023},

publisher = {HuggingFace},

journal = {HuggingFace repository},

howpublished = {\url{https://https://huggingface.co/Open-Orca/OpenOrcaxOpenChat-Preview2-13B},

}

@software{openchat,

title = {{OpenChat: Advancing Open-source Language Models with Imperfect Data}},

author = {Wang, Guan and Cheng, Sijie and Yu, Qiying and Liu, Changling},

doi = {10.5281/zenodo.8105775},

url = {https://github.com/imoneoi/openchat},

version = {pre-release},

year = {2023},

month = {7},

}

@misc{mukherjee2023orca,

title={Orca: Progressive Learning from Complex Explanation Traces of GPT-4},

author={Subhabrata Mukherjee and Arindam Mitra and Ganesh Jawahar and Sahaj Agarwal and Hamid Palangi and Ahmed Awadallah},

year={2023},

eprint={2306.02707},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

@misc{touvron2023llama,

title={Llama 2: Open Foundation and Fine-Tuned Chat Models},

author={Hugo Touvron and Louis Martin and Kevin Stone and Peter Albert and Amjad Almahairi and Yasmine Babaei and Nikolay Bashlykov and Soumya Batra and Prajjwal Bhargava and Shruti Bhosale and Dan Bikel and Lukas Blecher and Cristian Canton Ferrer and Moya Chen and Guillem Cucurull and David Esiobu and Jude Fernandes and Jeremy Fu and Wenyin Fu and Brian Fuller and Cynthia Gao and Vedanuj Goswami and Naman Goyal and Anthony Hartshorn and Saghar Hosseini and Rui Hou and Hakan Inan and Marcin Kardas and Viktor Kerkez and Madian Khabsa and Isabel Kloumann and Artem Korenev and Punit Singh Koura and Marie-Anne Lachaux and Thibaut Lavril and Jenya Lee and Diana Liskovich and Yinghai Lu and Yuning Mao and Xavier Martinet and Todor Mihaylov and Pushkar Mishra and Igor Molybog and Yixin Nie and Andrew Poulton and Jeremy Reizenstein and Rashi Rungta and Kalyan Saladi and Alan Schelten and Ruan Silva and Eric Michael Smith and Ranjan Subramanian and Xiaoqing Ellen Tan and Binh Tang and Ross Taylor and Adina Williams and Jian Xiang Kuan and Puxin Xu and Zheng Yan and Iliyan Zarov and Yuchen Zhang and Angela Fan and Melanie Kambadur and Sharan Narang and Aurelien Rodriguez and Robert Stojnic and Sergey Edunov and Thomas Scialom},

year={2023},

eprint= arXiv 2307.09288

}

@misc{longpre2023flan,

title={The Flan Collection: Designing Data and Methods for Effective Instruction Tuning},

author={Shayne Longpre and Le Hou and Tu Vu and Albert Webson and Hyung Won Chung and Yi Tay and Denny Zhou and Quoc V. Le and Barret Zoph and Jason Wei and Adam Roberts},

year={2023},

eprint={2301.13688},

archivePrefix={arXiv},

primaryClass={cs.AI}

}

@article{hu2021lora,

title={LoRA: Low-Rank Adaptation of Large Language Models},

author={Hu, Edward J. and Shen, Yelong and Wallis, Phillip and Allen-Zhu, Zeyuan and Li, Yuanzhi and Wang, Shean and Chen, Weizhu},

journal={CoRR},

year={2021}

}

Transformers

Transformers Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語