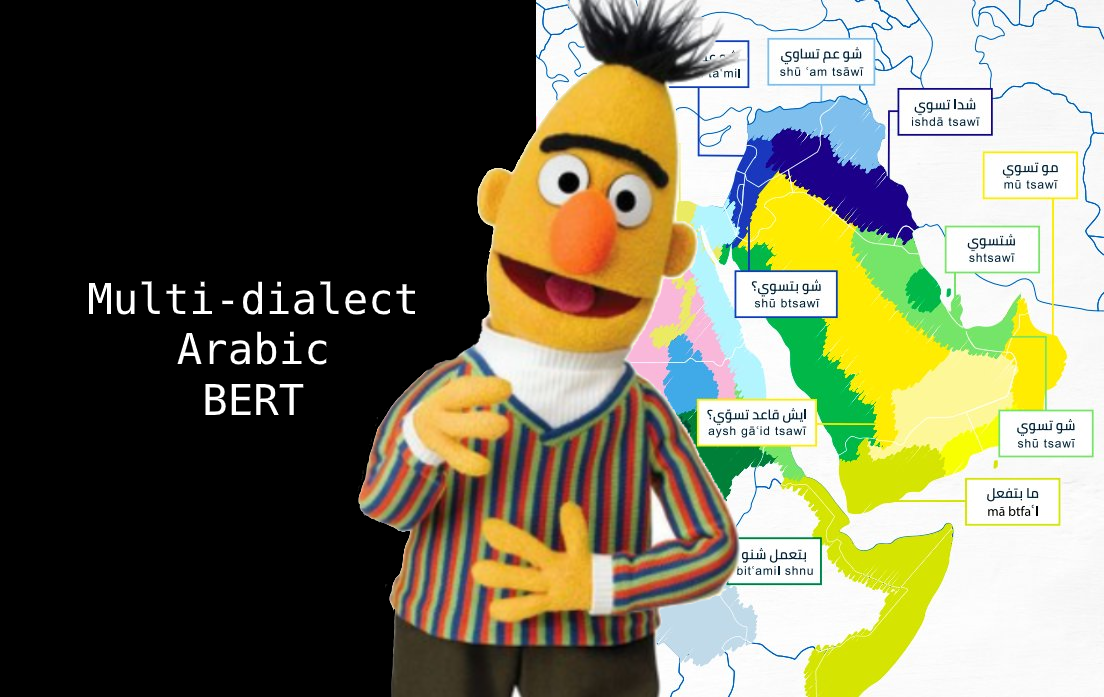

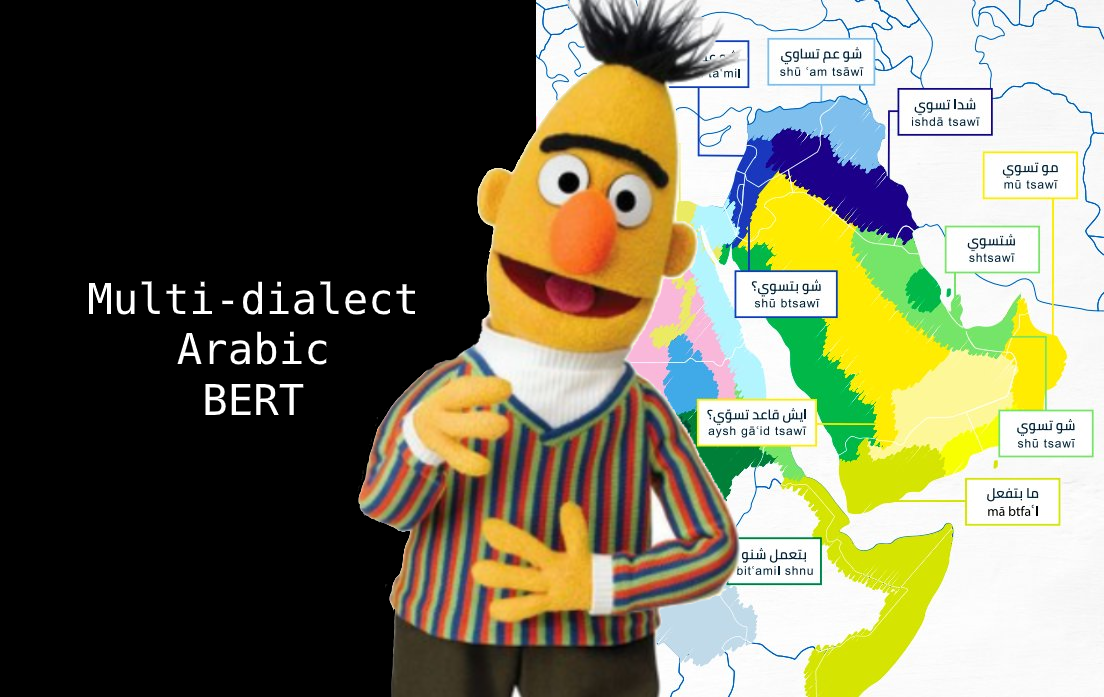

🚀 多方言阿拉伯语BERT模型

本项目是多方言阿拉伯语BERT模型的代码仓库,由 Mawdoo3-AI 开发。该模型旨在解决阿拉伯语不同方言的处理问题,为阿拉伯语的自然语言处理任务提供更强大的支持。

🚀 快速开始

本模型的权重可以使用HuggingFace的transformers库进行加载。

基础用法

from transformers import AutoTokenizer, AutoModel

tokenizer = AutoTokenizer.from_pretrained("bashar-talafha/multi-dialect-bert-base-arabic")

model = AutoModel.from_pretrained("bashar-talafha/multi-dialect-bert-base-arabic")

高级用法

使用pipeline的示例:

from transformers import pipeline

fill_mask = pipeline(

"fill-mask",

model="bashar-talafha/multi-dialect-bert-base-arabic ",

tokenizer="bashar-talafha/multi-dialect-bert-base-arabic "

)

fill_mask(" سافر الرحالة من مطار [MASK] ")

[{'sequence': '[CLS] سافر الرحالة من مطار الكويت [SEP]', 'score': 0.08296813815832138, 'token': 3226},

{'sequence': '[CLS] سافر الرحالة من مطار دبي [SEP]', 'score': 0.05123933032155037, 'token': 4747},

{'sequence': '[CLS] سافر الرحالة من مطار مسقط [SEP]', 'score': 0.046838656067848206, 'token': 13205},

{'sequence': '[CLS] سافر الرحالة من مطار القاهرة [SEP]', 'score': 0.03234650194644928, 'token': 4003},

{'sequence': '[CLS] سافر الرحالة من مطار الرياض [SEP]', 'score': 0.02606341242790222, 'token': 2200}]

✨ 主要特性

本模型并非从头开始训练多方言阿拉伯语BERT模型,而是使用 Arabic-BERT 初始化模型的权重,并在 The Nuanced Arabic Dialect Identification (NADI) shared task 的1000万条未标记阿拉伯语推文数据上进行训练。

📚 详细文档

如需更多信息,请查看 原始仓库。

📄 许可证

引用本工作

@misc{talafha2020multidialect,

title={Multi-Dialect Arabic BERT for Country-Level Dialect Identification},

author={Bashar Talafha and Mohammad Ali and Muhy Eddin Za'ter and Haitham Seelawi and Ibraheem Tuffaha and Mostafa Samir and Wael Farhan and Hussein T. Al-Natsheh},

year={2020},

eprint={2007.05612},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语