模型概述

模型特點

模型能力

使用案例

🚀 Llama 3 8B 64K

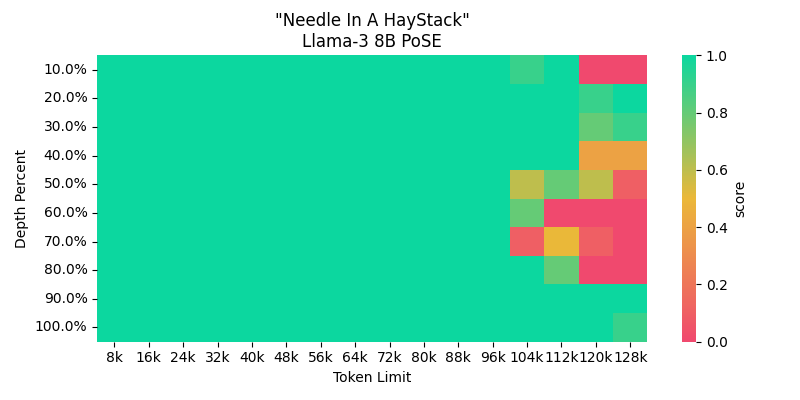

Llama 3 8B 64K模型藉助PoSE技術將Llama的上下文長度從8k擴展到64k,在特定數據集上進行訓練,優化了語言生成能力,適用於對話等多種自然語言處理場景。

該模型使用PoSE將Llama的上下文長度從8k擴展到64k,rope_theta設置為500000.0。我們在RedPajama V1數據集中6k - 8k標記的3億個標記上使用PoSE進行持續預訓練。

在持續預訓練之後,我們進一步將rope_theta設置為200萬,以潛在地將上下文擴展到64k以上。

該模型在RedPajama v1數據集的一個子集上進行訓練,文本上下文長度在6k - 8k之間。我們訓練了一個秩穩定的LoRA,秩為256。WandB

📚 詳細文檔

模型詳情

Meta開發併發布了Meta Llama 3系列大語言模型(LLM),這是一組包含80億和700億參數的預訓練和指令調優生成式文本模型。Llama 3指令調優模型針對對話用例進行了優化,在常見行業基準測試中優於許多可用的開源聊天模型。此外,在開發這些模型時,我們非常注重優化模型的實用性和安全性。

| 屬性 | 詳情 |

|---|---|

| 模型開發者 | Meta |

| 變體 | Llama 3有兩種規模——80億和700億參數,包括預訓練和指令調優變體 |

| 輸入 | 模型僅接受文本輸入 |

| 輸出 | 模型僅生成文本和代碼 |

| 模型架構 | Llama 3是一種自迴歸語言模型,採用優化的Transformer架構。調優版本使用監督微調(SFT)和基於人類反饋的強化學習(RLHF)來符合人類對實用性和安全性的偏好 |

預期用途

- 預期用例:Llama 3旨在用於英語商業和研究用途。指令調優模型適用於類似助手的聊天場景,而預訓練模型可用於各種自然語言生成任務。

- 超出範圍的使用:以任何違反適用法律法規(包括貿易合規法律)的方式使用;以《可接受使用政策》和《Llama 3社區許可協議》禁止的任何其他方式使用;使用除英語以外的其他語言。

⚠️ 重要提示

開發者可以在遵守《Llama 3社區許可協議》和《可接受使用政策》的前提下,對Llama 3模型進行微調以支持英語以外的其他語言。

💻 使用示例

基礎用法

本倉庫包含兩個版本的Meta-Llama-3-8B,分別適用於transformers庫和原始llama3代碼庫。

使用transformers庫

以下是使用transformers庫的代碼示例:

>>> import transformers

>>> import torch

>>> model_id = "meta-llama/Meta-Llama-3-8B"

>>> pipeline = transformers.pipeline(

"text-generation", model=model_id, model_kwargs={"torch_dtype": torch.bfloat16}, device_map="auto"

)

>>> pipeline("Hey how are you doing today?")

使用llama3代碼庫

請遵循倉庫中的說明。

要下載原始檢查點,請參考以下使用huggingface-cli的示例命令:

huggingface-cli download meta-llama/Meta-Llama-3-8B --include "original/*" --local-dir Meta-Llama-3-8B

對於Hugging Face支持,我們建議使用transformers或TGI,但類似的命令也適用。

🔧 技術細節

硬件和軟件

- 訓練因素:我們使用自定義訓練庫、Meta的研究超級集群和生產集群進行預訓練。微調、註釋和評估也在第三方雲計算平臺上進行。

- 碳足跡:預訓練在H100 - 80GB類型的硬件上累計使用了770萬個GPU小時的計算資源(TDP為700W)。估計總排放量為2290噸二氧化碳當量,其中100%由Meta的可持續發展計劃進行了抵消。

| 模型 | 時間(GPU小時) | 功耗(W) | 碳排放(tCO2eq) |

|---|---|---|---|

| Llama 3 8B | 130萬 | 700 | 390 |

| Llama 3 70B | 640萬 | 700 | 1900 |

| 總計 | 770萬 | - | 2290 |

訓練數據

- 概述:Llama 3在超過15萬億個來自公開可用來源的標記數據上進行預訓練。微調數據包括公開可用的指令數據集以及超過1000萬個經過人工註釋的示例。預訓練和微調數據集均不包含Meta用戶數據。

- 數據新鮮度:預訓練數據的截止時間分別為7B模型的2023年3月和70B模型的2023年12月。

基準測試

在本節中,我們報告了Llama 3模型在標準自動基準測試中的結果。所有評估均使用我們的內部評估庫。有關方法論的詳細信息,請參閱此處。

基礎預訓練模型

| 類別 | 基準測試 | Llama 3 8B | Llama2 7B | Llama2 13B | Llama 3 70B | Llama2 70B |

|---|---|---|---|---|---|---|

| 通用 | MMLU (5-shot) | 66.6 | 45.7 | 53.8 | 79.5 | 69.7 |

| 通用 | AGIEval English (3 - 5 shot) | 45.9 | 28.8 | 38.7 | 63.0 | 54.8 |

| 通用 | CommonSenseQA (7-shot) | 72.6 | 57.6 | 67.6 | 83.8 | 78.7 |

| 通用 | Winogrande (5-shot) | 76.1 | 73.3 | 75.4 | 83.1 | 81.8 |

| 通用 | BIG-Bench Hard (3-shot, CoT) | 61.1 | 38.1 | 47.0 | 81.3 | 65.7 |

| 通用 | ARC-Challenge (25-shot) | 78.6 | 53.7 | 67.6 | 93.0 | 85.3 |

| 知識推理 | TriviaQA-Wiki (5-shot) | 78.5 | 72.1 | 79.6 | 89.7 | 87.5 |

| 閱讀理解 | SQuAD (1-shot) | 76.4 | 72.2 | 72.1 | 85.6 | 82.6 |

| 閱讀理解 | QuAC (1-shot, F1) | 44.4 | 39.6 | 44.9 | 51.1 | 49.4 |

| 閱讀理解 | BoolQ (0-shot) | 75.7 | 65.5 | 66.9 | 79.0 | 73.1 |

| 閱讀理解 | DROP (3-shot, F1) | 58.4 | 37.9 | 49.8 | 79.7 | 70.2 |

指令調優模型

| 基準測試 | Llama 3 8B | Llama 2 7B | Llama 2 13B | Llama 3 70B | Llama 2 70B |

|---|---|---|---|---|---|

| MMLU (5-shot) | 68.4 | 34.1 | 47.8 | 82.0 | 52.9 |

| GPQA (0-shot) | 34.2 | 21.7 | 22.3 | 39.5 | 21.0 |

| HumanEval (0-shot) | 62.2 | 7.9 | 14.0 | 81.7 | 25.6 |

| GSM-8K (8-shot, CoT) | 79.6 | 25.7 | 77.4 | 93.0 | 57.5 |

| MATH (4-shot, CoT) | 30.0 | 3.8 | 6.7 | 50.4 | 11.6 |

責任與安全

我們相信,開放的AI方法能夠帶來更好、更安全的產品,加速創新,並開拓更大的整體市場。我們致力於負責任的AI開發,並採取了一系列措施來限制濫用和危害,支持開源社區。

基礎模型是功能廣泛的技術,旨在用於各種不同的應用。它們並非旨在開箱即用地滿足所有開發者在所有用例中的安全級別偏好,因為這些偏好本質上會因不同應用而異。

相反,負責任的大語言模型應用部署是通過在應用開發的整個過程中實施一系列安全最佳實踐來實現的,從模型預訓練、微調,到部署包含保障措施的系統,以根據具體用例和受眾量身定製安全需求。

作為Llama 3發佈的一部分,我們更新了《負責任使用指南》,以概述開發者為其應用實施模型和系統級安全的步驟和最佳實踐。我們還提供了一系列資源,包括Meta Llama Guard 2和Code Shield保障措施。這些工具已被證明能夠在保持高度實用性的同時,大幅降低大語言模型系統的殘餘風險。我們鼓勵開發者根據自身需求調整和部署這些保障措施,並提供了參考實現以幫助您入門。

Llama 3-Instruct

正如《負責任使用指南》中所述,模型實用性和模型對齊性之間可能不可避免地存在一些權衡。開發者應根據其具體用例和受眾,謹慎權衡對齊性和實用性的好處。開發者在使用Llama模型時應注意殘餘風險,並根據需要利用額外的安全工具,以達到其用例所需的安全標準。

安全性:對於我們的指令調優模型,我們進行了廣泛的紅隊測試、對抗性評估,並實施了安全緩解技術以降低殘餘風險。與任何大語言模型一樣,殘餘風險可能仍然存在,我們建議開發者在其用例的背景下評估這些風險。同時,我們正在與社區合作,使AI安全基準標準更加透明、嚴格和可解釋。

拒絕回覆:除了殘餘風險,我們非常重視模型對良性提示的拒絕回覆問題。過度拒絕不僅會影響用戶體驗,在某些情況下甚至可能有害。我們聽取了開發者社區的反饋,並改進了微調過程,以確保Llama 3比Llama 2更不可能錯誤地拒絕回答提示。我們建立了內部基準測試並開發了緩解措施,以限制錯誤拒絕,使Llama 3成為我們迄今為止最實用的模型。

負責任的發佈

除了上述負責任使用的考慮因素外,我們遵循了嚴格的流程,在做出發佈決定之前,採取了額外的措施來防範濫用和重大風險。

濫用:如果您訪問或使用Llama 3,即表示您同意《可接受使用政策》。該政策的最新版本可在此處查看。

重大風險

- CBRNE(化學、生物、放射、核和高當量爆炸物):我們對模型在這一領域的安全性進行了雙重評估:在模型訓練期間進行迭代測試,以評估與CBRNE威脅和其他對抗性風險相關的回覆安全性;邀請外部CBRNE專家進行提升測試,評估模型準確提供專家知識並減少潛在CBRNE濫用障礙的能力,參考不使用模型時通過網絡搜索所能達到的效果。

- 網絡安全:我們使用Meta的網絡安全評估套件CyberSecEval對Llama 3進行了評估,測量了Llama 3作為編碼助手時建議不安全代碼的傾向,以及Llama 3響應進行網絡攻擊請求的傾向,其中攻擊由行業標準的MITRE ATT&CK網絡攻擊本體定義。在我們的不安全編碼和網絡攻擊實用性測試中,Llama 3的表現與具有同等編碼能力的模型處於相同範圍或更安全。

- 兒童安全:我們使用專家團隊進行了兒童安全風險評估,以評估模型產生可能導致兒童安全風險輸出的能力,並通過微調提供必要和適當的風險緩解建議。我們利用這些專家紅隊測試擴展了我們在Llama 3模型開發過程中評估基準的覆蓋範圍。對於Llama 3,我們使用基於目標的方法進行了新的深入測試,以評估模型在多個攻擊向量下的風險。我們還與內容專家合作進行紅隊測試,評估潛在違規內容,同時考慮特定市場的細微差別或經驗。

社區

生成式AI安全需要專業知識和工具,我們相信開放社區的力量能夠加速其發展。我們是多個開放聯盟的積極成員,包括AI聯盟、AI合作組織和MLCommons,積極為安全標準化和透明度做出貢獻。我們鼓勵社區採用MLCommons概念驗證評估等分類法,以促進安全和內容評估的協作和透明度。我們的Purple Llama工具已開源供社區使用,並廣泛分發到包括雲服務提供商在內的生態系統合作伙伴。我們鼓勵社區為我們的GitHub倉庫做出貢獻。

最後,我們建立了一系列資源,包括輸出報告機制和漏洞賞金計劃,以在社區的幫助下不斷改進Llama技術。

倫理考量與侷限性

Llama 3的核心價值觀是開放性、包容性和實用性。它旨在服務於所有人,並適用於廣泛的用例。因此,它設計為對來自不同背景、經驗和觀點的人都具有可訪問性。Llama 3以用戶的實際情況和需求為出發點,不插入不必要的判斷或規範性內容,同時認識到即使在某些情況下可能看起來有問題的內容,在其他情況下也可能有其價值。它尊重所有用戶的尊嚴和自主權,特別是在推動創新和進步的自由思想和表達價值觀方面。

但Llama 3是一項新技術,與任何新技術一樣,其使用存在一定風險。到目前為止進行的測試均使用英語,且無法涵蓋所有場景。因此,與所有大語言模型一樣,Llama 3的潛在輸出無法提前預測,在某些情況下,模型可能會對用戶提示產生不準確、有偏見或其他令人反感的回覆。因此,在部署Llama 3模型的任何應用之前,開發者應針對其特定應用對模型進行安全測試和調整。正如《負責任使用指南》中所述,我們建議將Purple Llama解決方案納入您的工作流程,特別是Llama Guard,它提供了一個基礎模型,用於過濾輸入和輸出提示,在模型級安全的基礎上增加系統級安全。

請參閱《負責任使用指南》。

📄 許可證

自定義商業許可證可在此處獲取。

引用說明

@article{llama3modelcard,

title={Llama 3 Model Card},

author={AI@Meta},

year={2024},

url = {https://github.com/meta-llama/llama3/blob/main/MODEL_CARD.md}

}

貢獻者

Aaditya Singh; Aaron Grattafiori; Abhimanyu Dubey; Abhinav Jauhri; Abhinav Pandey; Abhishek Kadian; Adam Kelsey; Adi Gangidi; Ahmad Al-Dahle; Ahuva Goldstand; Aiesha Letman; Ajay Menon; Akhil Mathur; Alan Schelten; Alex Vaughan; Amy Yang; Andrei Lupu; Andres Alvarado; Andrew Gallagher; Andrew Gu; Andrew Ho; Andrew Poulton; Andrew Ryan; Angela Fan; Ankit Ramchandani; Anthony Hartshorn; Archi Mitra; Archie Sravankumar; Artem Korenev; Arun Rao; Ashley Gabriel; Ashwin Bharambe; Assaf Eisenman; Aston Zhang; Aurelien Rodriguez; Austen Gregerson; Ava Spataru; Baptiste Roziere; Ben Maurer; Benjamin Leonhardi; Bernie Huang; B

Transformers

Transformers Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語