🚀 Swin Transformer (小型模型)

Swin Transformer是在分辨率為224x224的ImageNet - 1k數據集上訓練的模型。它為圖像分類和密集識別任務提供了強大的支持,能有效處理圖像數據。

🚀 快速開始

Swin Transformer模型可用於圖像分類任務。你可以使用原始模型進行圖像分類,也可以在模型中心查找針對你感興趣的任務進行微調的版本。

以下是使用該模型將COCO 2017數據集中的圖像分類為1000個ImageNet類別之一的示例代碼:

from transformers import AutoFeatureExtractor, SwinForImageClassification

from PIL import Image

import requests

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

feature_extractor = AutoFeatureExtractor.from_pretrained("microsoft/swin-small-patch4-window7-224")

model = SwinForImageClassification.from_pretrained("microsoft/swin-small-patch4-window7-224")

inputs = feature_extractor(images=image, return_tensors="pt")

outputs = model(**inputs)

logits = outputs.logits

predicted_class_idx = logits.argmax(-1).item()

print("Predicted class:", model.config.id2label[predicted_class_idx])

更多代碼示例請參考文檔。

✨ 主要特性

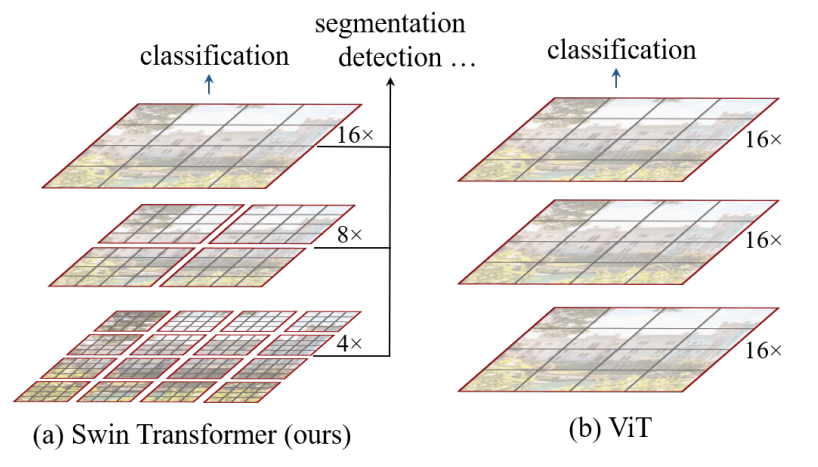

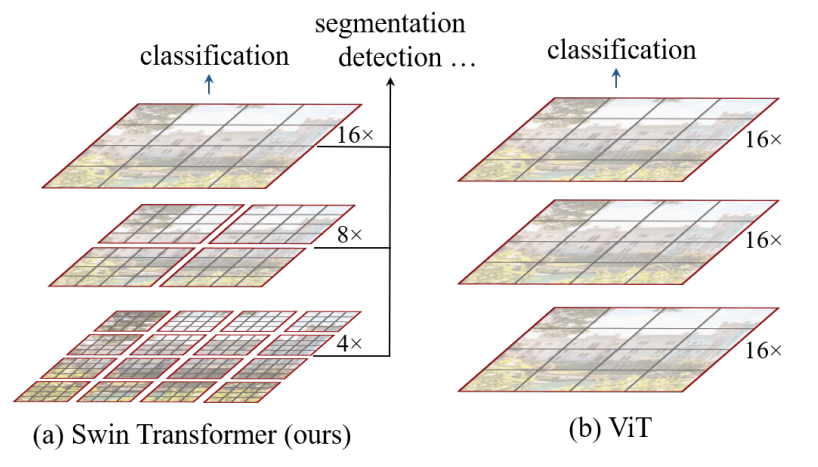

- 分層特徵映射:Swin Transformer通過在更深的層中合併圖像塊(灰色部分)來構建分層特徵映射。

- 線性計算複雜度:由於僅在每個局部窗口(紅色部分)內計算自注意力,它對輸入圖像大小具有線性計算複雜度。這使得它能夠作為圖像分類和密集識別任務的通用主幹網絡。

- 對比優勢:與之前的視覺Transformer相比,它能產生不同分辨率的特徵映射,且避免了全局自注意力計算帶來的二次計算複雜度。

來源

來源

💻 使用示例

基礎用法

from transformers import AutoFeatureExtractor, SwinForImageClassification

from PIL import Image

import requests

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

feature_extractor = AutoFeatureExtractor.from_pretrained("microsoft/swin-small-patch4-window7-224")

model = SwinForImageClassification.from_pretrained("microsoft/swin-small-patch4-window7-224")

inputs = feature_extractor(images=image, return_tensors="pt")

outputs = model(**inputs)

logits = outputs.logits

predicted_class_idx = logits.argmax(-1).item()

print("Predicted class:", model.config.id2label[predicted_class_idx])

📚 詳細文檔

預期用途和限制

你可以使用原始模型進行圖像分類。若想獲取針對特定任務微調的版本,可訪問模型中心進行查找。

BibTeX引用和引用信息

@article{DBLP:journals/corr/abs-2103-14030,

author = {Ze Liu and

Yutong Lin and

Yue Cao and

Han Hu and

Yixuan Wei and

Zheng Zhang and

Stephen Lin and

Baining Guo},

title = {Swin Transformer: Hierarchical Vision Transformer using Shifted Windows},

journal = {CoRR},

volume = {abs/2103.14030},

year = {2021},

url = {https://arxiv.org/abs/2103.14030},

eprinttype = {arXiv},

eprint = {2103.14030},

timestamp = {Thu, 08 Apr 2021 07:53:26 +0200},

biburl = {https://dblp.org/rec/journals/corr/abs-2103-14030.bib},

bibsource = {dblp computer science bibliography, https://dblp.org}

}

📄 許可證

本模型採用Apache - 2.0許可證。

信息表格

| 屬性 |

詳情 |

| 模型類型 |

Swin Transformer(小型模型) |

| 訓練數據 |

ImageNet - 1k |

| 適用任務 |

圖像分類、密集識別任務 |

免責聲明

發佈Swin Transformer的團隊未為此模型編寫模型卡片,此模型卡片由Hugging Face團隊編寫。

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語