模型概述

模型特點

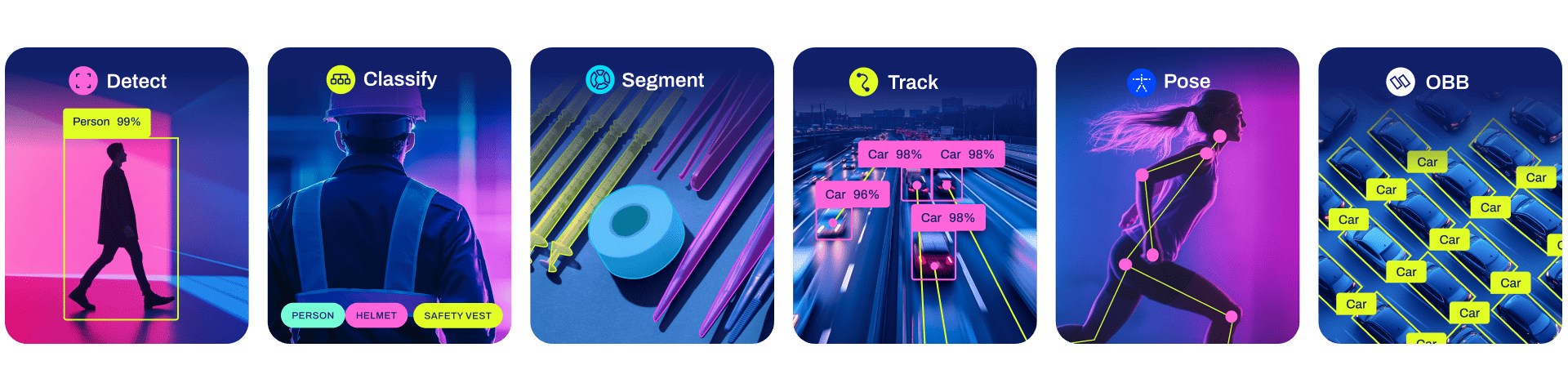

模型能力

使用案例

🚀 Ultralytics YOLOv8

Ultralytics YOLOv8 是一款前沿的、最先進的(SOTA)模型,它在先前 YOLO 版本的成功基礎上進行構建,並引入了新的特性和改進,以進一步提升性能和靈活性。YOLOv8 設計為快速、準確且易於使用,使其成為廣泛的目標檢測與跟蹤、實例分割、圖像分類和姿態估計任務的絕佳選擇。

中文 | 한국어 | 日本語 | Русский | Deutsch | Français | Español | Português | Türkçe | Tiếng Việt | العربية

我們希望這裡的資源能幫助你充分利用 YOLOv8。請瀏覽 YOLOv8 文檔 瞭解詳細信息,在 GitHub 上提出問題以獲取支持、提問或進行討論,加入 Ultralytics Discord、Reddit 和 論壇!

若要申請企業許可證,請填寫 Ultralytics 許可證 表格。

🚀 快速開始

以下是快速安裝和使用示例,完整的訓練、驗證、預測和部署文檔請查看 YOLOv8 文檔。

安裝

在 Python>=3.8 環境中,使用 PyTorch>=1.8,通過 Pip 安裝包含所有 依賴項 的 ultralytics 包。

pip install ultralytics

使用

💻 使用示例

基礎用法

可以直接在命令行界面(CLI)中使用 yolo 命令來使用 YOLOv8:

yolo predict model=yolov8n.pt source='https://ultralytics.com/images/bus.jpg'

yolo 可用於各種任務和模式,並接受額外的參數,例如 imgsz=640。更多示例請查看 YOLOv8 CLI 文檔。

高級用法

YOLOv8 也可以直接在 Python 環境中使用,並且接受與上述 CLI 示例相同的 參數:

from ultralytics import YOLO

# 加載模型

model = YOLO("yolov8n.pt")

# 訓練模型

train_results = model.train(

data="coco8.yaml", # 數據集 YAML 文件路徑

epochs=100, # 訓練輪數

imgsz=640, # 訓練圖像大小

device="cpu", # 運行設備,例如 device=0 或 device=0,1,2,3 或 device=cpu

)

# 在驗證集上評估模型性能

metrics = model.val()

# 在圖像上進行目標檢測

results = model("path/to/image.jpg")

results[0].show()

# 將模型導出為 ONNX 格式

path = model.export(format="onnx") # 返回導出模型的路徑

更多示例請查看 YOLOv8 Python 文檔。

✨ 主要特性

- 前沿技術:基於先前 YOLO 版本的成功經驗,引入新特性和改進,提升性能和靈活性。

- 多任務支持:適用於目標檢測與跟蹤、實例分割、圖像分類和姿態估計等廣泛任務。

- 快速準確:設計為快速、準確且易於使用,提高工作效率。

- 多平臺集成:與多個領先的 AI 平臺集成,擴展功能。

- 易於使用:提供簡單的 CLI 和 Python API,方便用戶使用。

📦 安裝指南

在 Python>=3.8 環境中,使用 PyTorch>=1.8,通過 Pip 安裝包含所有 依賴項 的 ultralytics 包:

pip install ultralytics

有關包括 Conda、Docker 和 Git 在內的替代安裝方法,請參考 快速入門指南。

📚 詳細文檔

模型

YOLOv8 在 COCO 數據集上預訓練的 檢測、分割 和 姿態 模型,以及在 ImageNet 數據集上預訓練的 分類 模型均可使用。所有 檢測、分割和姿態模型都支持跟蹤模式。

所有 模型 在首次使用時會自動從最新的 Ultralytics 版本 下載。

檢測(COCO)

有關在 COCO 上訓練的這些模型的使用示例,請查看 檢測文檔,這些模型包含 80 個預訓練類別。

| 模型 | 尺寸 (像素) |

mAP驗證集 50 - 95 |

速度 CPU ONNX (毫秒) |

速度 A100 TensorRT (毫秒) |

參數 (M) |

浮點運算數 (B) |

|---|---|---|---|---|---|---|

| YOLOv8n | 640 | 37.3 | 80.4 | 0.99 | 3.2 | 8.7 |

| YOLOv8s | 640 | 44.9 | 128.4 | 1.20 | 11.2 | 28.6 |

| YOLOv8m | 640 | 50.2 | 234.7 | 1.83 | 25.9 | 78.9 |

| YOLOv8l | 640 | 52.9 | 375.2 | 2.39 | 43.7 | 165.2 |

| YOLOv8x | 640 | 53.9 | 479.1 | 3.53 | 68.2 | 257.8 |

- mAP驗證集 值是在 COCO val2017 數據集上的單模型單尺度結果。

通過yolo val detect data=coco.yaml device=0重現。 - 速度 是使用 Amazon EC2 P4d 實例在 COCO 驗證圖像上的平均值。

通過yolo val detect data=coco.yaml batch=1 device=0|cpu重現。

分割(COCO)

有關在 COCO-Seg 上訓練的這些模型的使用示例,請查看 分割文檔,這些模型包含 80 個預訓練類別。

| 模型 | 尺寸 (像素) |

mAP邊界框 50 - 95 |

mAP掩碼 50 - 95 |

速度 CPU ONNX (毫秒) |

速度 A100 TensorRT (毫秒) |

參數 (M) |

浮點運算數 (B) |

|---|---|---|---|---|---|---|---|

| YOLOv8n-seg | 640 | 36.7 | 30.5 | 96.1 | 1.21 | 3.4 | 12.6 |

| YOLOv8s-seg | 640 | 44.6 | 36.8 | 155.7 | 1.47 | 11.8 | 42.6 |

| YOLOv8m-seg | 640 | 49.9 | 40.8 | 317.0 | 2.18 | 27.3 | 110.2 |

| YOLOv8l-seg | 640 | 52.3 | 42.6 | 572.4 | 2.79 | 46.0 | 220.5 |

| YOLOv8x-seg | 640 | 53.4 | 43.4 | 712.1 | 4.02 | 71.8 | 344.1 |

- mAP驗證集 值是在 COCO val2017 數據集上的單模型單尺度結果。

通過yolo val segment data=coco-seg.yaml device=0重現。 - 速度 是使用 Amazon EC2 P4d 實例在 COCO 驗證圖像上的平均值。

通過yolo val segment data=coco-seg.yaml batch=1 device=0|cpu重現。

姿態(COCO)

有關在 COCO-Pose 上訓練的這些模型的使用示例,請查看 姿態文檔,這些模型包含 1 個預訓練類別,即人。

| 模型 | 尺寸 (像素) |

mAP姿態 50 - 95 |

mAP姿態 50 |

速度 CPU ONNX (毫秒) |

速度 A100 TensorRT (毫秒) |

參數 (M) |

浮點運算數 (B) |

|---|---|---|---|---|---|---|---|

| YOLOv8n-pose | 640 | 50.4 | 80.1 | 131.8 | 1.18 | 3.3 | 9.2 |

| YOLOv8s-pose | 640 | 60.0 | 86.2 | 233.2 | 1.42 | 11.6 | 30.2 |

| YOLOv8m-pose | 640 | 65.0 | 88.8 | 456.3 | 2.00 | 26.4 | 81.0 |

| YOLOv8l-pose | 640 | 67.6 | 90.0 | 784.5 | 2.59 | 44.4 | 168.6 |

| YOLOv8x-pose | 640 | 69.2 | 90.2 | 1607.1 | 3.73 | 69.4 | 263.2 |

| YOLOv8x-pose-p6 | 1280 | 71.6 | 91.2 | 4088.7 | 10.04 | 99.1 | 1066.4 |

- mAP驗證集 值是在 COCO Keypoints val2017 數據集上的單模型單尺度結果。

通過yolo val pose data=coco-pose.yaml device=0重現。 - 速度 是使用 Amazon EC2 P4d 實例在 COCO 驗證圖像上的平均值。

通過yolo val pose data=coco-pose.yaml batch=1 device=0|cpu重現。

OBB(DOTAv1)

有關在 DOTAv1 上訓練的這些模型的使用示例,請查看 OBB 文檔,這些模型包含 15 個預訓練類別。

| 模型 | 尺寸 (像素) |

mAP測試集 50 |

速度 CPU ONNX (毫秒) |

速度 A100 TensorRT (毫秒) |

參數 (M) |

浮點運算數 (B) |

|---|---|---|---|---|---|---|

| YOLOv8n-obb | 1024 | 78.0 | 204.77 | 3.57 | 3.1 | 23.3 |

| YOLOv8s-obb | 1024 | 79.5 | 424.88 | 4.07 | 11.4 | 76.3 |

| YOLOv8m-obb | 1024 | 80.5 | 763.48 | 7.61 | 26.4 | 208.6 |

| YOLOv8l-obb | 1024 | 80.7 | 1278.42 | 11.83 | 44.5 | 433.8 |

| YOLOv8x-obb | 1024 | 81.36 | 1759.10 | 13.23 | 69.5 | 676.7 |

- mAP測試集 值是在 DOTAv1 數據集上的單模型多尺度結果。

通過yolo val obb data=DOTAv1.yaml device=0 split=test重現,並將合併結果提交到 DOTA 評估。 - 速度 是使用 Amazon EC2 P4d 實例在 DOTAv1 驗證圖像上的平均值。

通過yolo val obb data=DOTAv1.yaml batch=1 device=0|cpu重現。

分類(ImageNet)

有關在 ImageNet 上訓練的這些模型的使用示例,請查看 分類文檔,這些模型包含 1000 個預訓練類別。

| 模型 | 尺寸 (像素) |

準確率 前 1 |

準確率 前 5 |

速度 CPU ONNX (毫秒) |

速度 A100 TensorRT (毫秒) |

參數 (M) |

浮點運算數 (B) 在 640 時 |

|---|---|---|---|---|---|---|---|

| YOLOv8n-cls | 224 | 69.0 | 88.3 | 12.9 | 0.31 | 2.7 | 4.3 |

| YOLOv8s-cls | 224 | 73.8 | 91.7 | 23.4 | 0.35 | 6.4 | 13.5 |

| YOLOv8m-cls | 224 | 76.8 | 93.5 | 85.4 | 0.62 | 17.0 | 42.7 |

| YOLOv8l-cls | 224 | 78.3 | 94.2 | 163.0 | 0.87 | 37.5 | 99.7 |

| YOLOv8x-cls | 224 | 79.0 | 94.6 | 232.0 | 1.01 | 57.4 | 154.8 |

- 準確率 值是模型在 ImageNet 數據集驗證集上的準確率。

通過yolo val classify data=path/to/ImageNet device=0重現。 - 速度 是使用 Amazon EC2 P4d 實例在 ImageNet 驗證圖像上的平均值。

通過yolo val classify data=path/to/ImageNet batch=1 device=0|cpu重現。

🔧 技術細節

YOLOv8 基於先前 YOLO 版本的架構進行改進,引入了新的特性和優化,以提高性能和靈活性。它使用了先進的深度學習技術,如卷積神經網絡(CNN)和注意力機制,來實現高效的目標檢測、實例分割、圖像分類和姿態估計。

在訓練方面,YOLOv8 支持多種數據集和訓練配置,可以根據不同的任務和需求進行調整。它還提供了簡單的 CLI 和 Python API,方便用戶進行訓練、驗證、預測和部署。

在推理方面,YOLOv8 可以在多種設備上運行,包括 CPU、GPU 和 TensorRT 等,以實現快速的推理速度。它還支持多種輸出格式,如圖像、視頻和 JSON 等,方便用戶進行後續處理。

📄 許可證

Ultralytics 提供兩種許可選項,以適應不同的使用場景:

- AGPL - 3.0 許可證:這是一種經 OSI 批准 的開源許可證,非常適合學生和愛好者,促進開放協作和知識共享。更多詳細信息請查看 LICENSE 文件。

- 企業許可證:專為商業用途設計,此許可證允許將 Ultralytics 軟件和 AI 模型無縫集成到商業產品和服務中,無需遵循 AGPL - 3.0 的開源要求。如果你的場景涉及將我們的解決方案嵌入到商業產品中,請通過 Ultralytics 許可證 聯繫我們。

🔗 集成

我們與領先 AI 平臺的關鍵集成擴展了 Ultralytics 產品的功能,增強了數據集標註、訓練、可視化和模型管理等任務。瞭解 Ultralytics 如何與 Roboflow、ClearML、Comet、Neural Magic 和 OpenVINO 合作,優化你的 AI 工作流程。

| Roboflow | ClearML ⭐ 新特性 | Comet ⭐ 新特性 | Neural Magic ⭐ 新特性 |

|---|---|---|---|

| 使用 Roboflow 直接標註並導出自定義數據集到 YOLOv8 進行訓練 | 使用 ClearML(開源!)自動跟蹤、可視化甚至遠程訓練 YOLOv8 | 永久免費,Comet 允許你保存 YOLOv8 模型、恢復訓練,並交互式地可視化和調試預測結果 | 使用 Neural Magic DeepSparse 使 YOLOv8 推理速度提高多達 6 倍 |

🌟 Ultralytics HUB

通過 Ultralytics HUB ⭐ 體驗無縫 AI,這是一個一站式解決方案,用於數據可視化、YOLOv5 和 YOLOv8 🚀 模型訓練和部署,無需任何編碼。使用我們先進的平臺和用戶友好的 Ultralytics 應用,輕鬆將圖像轉化為可操作的見解,實現你的 AI 願景。現在就免費開啟你的旅程!

🤝 貢獻

我們非常歡迎你的參與!沒有社區的幫助,YOLOv5 和 YOLOv8 是不可能實現的。請查看我們的 貢獻指南 以開始貢獻,並填寫我們的 調查問卷 向我們反饋你的使用體驗。感謝所有貢獻者 🙏!

📞 聯繫

如需報告 Ultralytics 的 bug 或提出功能請求,請訪問 GitHub 問題。加入 Ultralytics Discord、Reddit 或 論壇,提問、分享項目、參與學習討論或獲取 Ultralytics 相關的幫助!

Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語