模型概述

模型特點

模型能力

使用案例

🚀 RT-DETR 模型卡

RT-DETR 是一種即時端到端目標檢測模型,它解決了現有目標檢測模型在速度和準確性之間難以平衡的問題。該模型通過設計高效混合編碼器和提出不確定性最小查詢選擇方法,在速度和準確性上均超越了先前先進的 YOLO 模型,並且支持靈活的速度調整以適應各種場景。

🚀 快速開始

使用以下代碼開始使用該模型:

import torch

import requests

from PIL import Image

from transformers import RTDetrForObjectDetection, RTDetrImageProcessor

url = 'http://images.cocodataset.org/val2017/000000039769.jpg'

image = Image.open(requests.get(url, stream=True).raw)

image_processor = RTDetrImageProcessor.from_pretrained("PekingU/rtdetr_r101vd_coco_o365")

model = RTDetrForObjectDetection.from_pretrained("PekingU/rtdetr_r101vd_coco_o365")

inputs = image_processor(images=image, return_tensors="pt")

with torch.no_grad():

outputs = model(**inputs)

results = image_processor.post_process_object_detection(outputs, target_sizes=torch.tensor([image.size[::-1]]), threshold=0.3)

for result in results:

for score, label_id, box in zip(result["scores"], result["labels"], result["boxes"]):

score, label = score.item(), label_id.item()

box = [round(i, 2) for i in box.tolist()]

print(f"{model.config.id2label[label]}: {score:.2f} {box}")

此代碼應輸出:

sofa: 0.97 [0.14, 0.38, 640.13, 476.21]

cat: 0.96 [343.38, 24.28, 640.14, 371.5]

cat: 0.96 [13.23, 54.18, 318.98, 472.22]

remote: 0.95 [40.11, 73.44, 175.96, 118.48]

remote: 0.92 [333.73, 76.58, 369.97, 186.99]

✨ 主要特性

- 解決速度與準確性平衡問題:YOLO 系列在即時目標檢測中很受歡迎,但速度和準確性受 NMS 影響;端到端 Transformer 檢測器(DETRs)雖可消除 NMS,但計算成本高。RT-DETR 是首個即時端到端目標檢測器,解決了這一困境。

- 分兩步構建模型:借鑑先進的 DETR,先在保持準確性的同時提高速度,再在保持速度的同時提高準確性。

- 高效混合編碼器:通過解耦尺度內交互和跨尺度融合,快速處理多尺度特徵,提高速度。

- 不確定性最小查詢選擇:為解碼器提供高質量的初始查詢,提高準確性。

- 靈活的速度調整:通過調整解碼器層數,支持靈活的速度調整,無需重新訓練即可適應各種場景。

- 性能超越:RT-DETR-R50 / R101 在 COCO 上達到 53.1% / 54.3% 的 AP,在 T4 GPU 上達到 108 / 74 FPS,在速度和準確性上均超越先前先進的 YOLO 模型;縮放後的 RT-DETR 也優於更輕量級的 YOLO 檢測器;RT-DETR-R50 在準確性上比 DINO-R50 高 2.2% AP,FPS 約高 21 倍。

📦 安裝指南

文檔未提供安裝步驟,故跳過此章節。

📚 詳細文檔

模型詳情

YOLO 系列由於在速度和準確性之間取得了合理的平衡,已成為即時目標檢測最流行的框架。然而,我們觀察到 YOLO 的速度和準確性受到 NMS 的負面影響。最近,端到端基於 Transformer 的檢測器(DETRs)提供了一種消除 NMS 的替代方案。然而,高計算成本限制了它們的實用性,並阻礙了它們充分發揮排除 NMS 的優勢。在本文中,我們提出了即時檢測 Transformer(RT-DETR),據我們所知,這是第一個解決上述困境的即時端到端目標檢測器。我們分兩步構建 RT-DETR,借鑑先進的 DETR:首先,我們專注於在提高速度的同時保持準確性,然後在保持速度的同時提高準確性。具體來說,我們設計了一個高效的混合編碼器,通過解耦尺度內交互和跨尺度融合來快速處理多尺度特徵,以提高速度。然後,我們提出了不確定性最小查詢選擇,為解碼器提供高質量的初始查詢,從而提高準確性。此外,RT-DETR 支持通過調整解碼器層數進行靈活的速度調整,以適應各種場景而無需重新訓練。我們的 RT-DETR-R50 / R101 在 COCO 上達到 53.1% / 54.3% 的 AP,在 T4 GPU 上達到 108 / 74 FPS,在速度和準確性上均優於先前先進的 YOLO。我們還開發了縮放後的 RT-DETR,優於更輕量級的 YOLO 檢測器(S 和 M 模型)。此外,RT-DETR-R50 在準確性上比 DINO-R50 高 2.2% AP,FPS 約高 21 倍。在使用 Objects365 進行預訓練後,RT-DETR-R50 / R101 達到 55.3% / 56.2% 的 AP。項目頁面:https URL。

這是一個已推送至 Hub 的 🤗 transformers 模型的模型卡。

- 開發者:Yian Zhao 和 Sangbum Choi

- 資助方:中國國家重點研發計劃(No.2022ZD0118201)、中國自然科學基金(No.61972217、32071459、62176249、62006133、62271465)以及中國深圳醫學研究基金(No.B2302037)。

- 共享者:Sangbum Choi

- 模型類型:RT-DETR

- 許可證:Apache-2.0

模型來源

- HF 文檔:RT-DETR

- 倉庫:https://github.com/lyuwenyu/RT-DETR

- 論文:https://arxiv.org/abs/2304.08069

- 演示:RT-DETR 跟蹤

訓練詳情

訓練數據

RTDETR 模型在 COCO 2017 目標檢測 數據集上進行訓練,該數據集分別由 118k/5k 張帶註釋的圖像用於訓練/驗證。

訓練過程

我們在 COCO 和 Objects365 數據集上進行實驗,其中 RT-DETR 在 COCO train2017 上訓練,並在 COCO val2017 數據集上驗證。我們報告標準的 COCO 指標,包括 AP(在從 0.50 - 0.95 以 0.05 為步長均勻採樣的 IoU 閾值上平均)、AP50、AP75 以及不同尺度的 AP:APS、APM、APL。

預處理

圖像被調整為 640x640 像素,並使用 image_mean=[0.485, 0.456, 0.406] 和 image_std=[0.229, 0.224, 0.225] 進行重新縮放。

訓練超參數

- 訓練機制:

評估

| 模型 | 訓練輪數 | 參數數量(M) | GFLOPs | FPS_bs=1 | AP(驗證集) | AP50(驗證集) | AP75(驗證集) | AP-s(驗證集) | AP-m(驗證集) | AP-l(驗證集) |

|---|---|---|---|---|---|---|---|---|---|---|

| RT-DETR-R18 | 72 | 20 | 60.7 | 217 | 46.5 | 63.8 | 50.4 | 28.4 | 49.8 | 63.0 |

| RT-DETR-R34 | 72 | 31 | 91.0 | 172 | 48.5 | 66.2 | 52.3 | 30.2 | 51.9 | 66.2 |

| RT-DETR R50 | 72 | 42 | 136 | 108 | 53.1 | 71.3 | 57.7 | 34.8 | 58.0 | 70.0 |

| RT-DETR R101 | 72 | 76 | 259 | 74 | 54.3 | 72.7 | 58.6 | 36.0 | 58.8 | 72.1 |

| RT-DETR-R18(Objects 365 預訓練) | 60 | 20 | 61 | 217 | 49.2 | 66.6 | 53.5 | 33.2 | 52.3 | 64.8 |

| RT-DETR-R50(Objects 365 預訓練) | 24 | 42 | 136 | 108 | 55.3 | 73.4 | 60.1 | 37.9 | 59.9 | 71.8 |

| RT-DETR-R101(Objects 365 預訓練) | 24 | 76 | 259 | 74 | 56.2 | 74.6 | 61.3 | 38.3 | 60.5 | 73.5 |

模型架構和目標

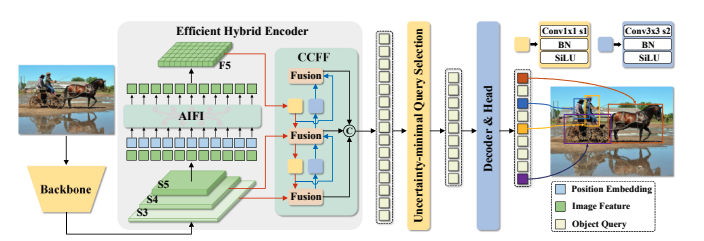

RT-DETR 概述。我們將骨幹網絡最後三個階段的特徵輸入到編碼器中。高效混合編碼器通過基於注意力的尺度內特徵交互(AIFI)和基於 CNN 的跨尺度特徵融合(CCFF)將多尺度特徵轉換為圖像特徵序列。然後,不確定性最小查詢選擇選擇固定數量的編碼器特徵作為解碼器的初始目標查詢。最後,帶有輔助預測頭的解碼器迭代優化目標查詢以生成類別和邊界框。

引用

BibTeX:

@misc{lv2023detrs,

title={DETRs Beat YOLOs on Real-time Object Detection},

author={Yian Zhao and Wenyu Lv and Shangliang Xu and Jinman Wei and Guanzhong Wang and Qingqing Dang and Yi Liu and Jie Chen},

year={2023},

eprint={2304.08069},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

模型卡作者

🔧 技術細節

文檔未提供具體的技術實現細節(>50 字),故跳過此章節。

📄 許可證

本模型使用的許可證為 Apache-2.0。

Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語