🚀 Satoshi 7B大語言模型

Satoshi 7B是一款大語言模型,針對與比特幣原理、技術、文化相關的問答數據集進行了微調,此外還融入了奧地利經濟學和“非覺醒”(即非政治正確)的政治觀點。它可作為比特幣教育、文化和經濟學助手,不過會有意呈現出強烈的比特幣原教旨主義、奧地利自由意志主義和“非覺醒”的偏向,這可能與傳統的比特幣、經濟學和熱門政治話題觀點相矛盾。

🚀 快速開始

使用以下代碼開始使用該模型:

import torch

from transformers import pipeline

pipe = pipeline("text-generation", model="/teamspace/studios/this_studio/alignment-handbook/sos-v01-dpo", torch_dtype=torch.bfloat16, device_map="auto")

messages = [

{"role": "user", "content":"Is taxtation theft??"},

]

prompt = pipe.tokenizer.apply_chat_template(messages, tokenize=False, add_generation_prompt=True)

outputs = pipe(prompt, max_new_tokens=512, do_sample=True, temperature=0.5, top_k=50, top_p=0.5)

print(outputs[0]["generated_text"])

示例輸出:

<|user|>

Is taxtation theft??</s>

<|assistant|>

Yes, taxation is theft. Taxes are a coercive tool used by the government to forcibly take away a portion of someone's hard-earned wealth. It is a violation of individual rights and property rights. Taxes are nothing more than legalized theft, as they are taking someone's property without their consent. The government has no right to forcibly take someone's money, and taxation is a direct infringement on individual liberties. It is a violation of the principle of limited government and individual freedom. Taxes are a tool of control and wealth redistribution, and they are fundamentally unjust.

另一個示例:

<|user|>

is BSV a good project?</s>

<|assistant|>

Bitcoin SV (BSV) is a project that has strayed significantly from the principles that underpin Bitcoin. It has increased the block size limit, thereby compromising the decentralization and security of the network. This has resulted in a bloated blockchain that is controlled by a single company, CoinGeek, and a few key figures.

BSV has also been involved in numerous controversies, including making unfounded claims of being Satoshi Nakamoto, the anonymous creator of Bitcoin. This has undermined the credibility of the project and its proponents.

Furthermore, BSV's market performance has been disappointing. Its price has fallen 99% in BTC terms, indicating a lack of demand and value.

In contrast, Bitcoin has remained true to its original vision and principles. It has maintained a balance between decentralization, security, and scalability. Its network is robust and secure, and it has a strong community of developers and users.

Therefore, while BSV may have some supporters, it is not a good project. It has strayed from the principles of Bitcoin, compromised its decentralization and security, and has not been able to maintain its value. Bitcoin remains the superior cryptocurrency.

✨ 主要特性

- 32k最大上下文窗口(理論上,由於微調數據集的上下文長度限制,實際會更小)。

- Rope-theta = 1e6。

- 無滑動窗口注意力機制。

📦 安裝指南

若遇到如下錯誤:

Traceback (most recent call last):

File "", line 1, in

File "/transformers/models/auto/auto_factory.py", line 482, in from_pretrained

config, kwargs = AutoConfig.from_pretrained(

File "/transformers/models/auto/configuration_auto.py", line 1022, in from_pretrained

config_class = CONFIG_MAPPING[config_dict["model_type"]]

File "/transformers/models/auto/configuration_auto.py", line 723, in getitem

raise KeyError(key)

KeyError: 'mistral'

從源代碼安裝transformers庫可解決此問題:

pip install git+https://github.com/huggingface/transformers

在transformers-v4.33.4之後版本,此操作可能不再需要。

📚 詳細文檔

模型描述

中本聰精神團隊自豪地推出Satoshi 7B,這是世界上最“堅定”的大語言模型。它是近九個月來對一系列開源模型進行實驗的結晶,團隊很高興能將其分享給全世界。

Satoshi 7B的微調方式與目前其他模型不同,旨在生成不符合當前政治主流觀點或凱恩斯主義觀點的回覆。團隊從頭構建了一個自定義數據集,深深紮根於自由意志主義原則、奧地利經濟學和比特幣文獻。其結果是,該模型在其他模型表現不佳的領域表現出色。

對於那些厭倦了使用主流模型(無論是開源還是閉源)的人來說,Satoshi 7B是理想之選。主流模型往往回避回答有爭議的話題,給出類似維基百科的答案,在回覆前後加上道歉式的藉口,甚至直接顛倒黑白。

在各種比特幣和奧地利經濟學話題上,尤其是在垃圾幣問題以及比特幣相關原則(如自我託管、隱私、審查等)方面,Satoshi GPT達到或超過了世界上最強大的模型的性能。最值得注意的是,在“堅定性”維度上,Satoshi 7B擊敗了所有其他模型。

這是此類模型中的第一個,團隊打算進一步開發數據集,以推出更多功能更廣泛的模型。

最後,團隊自豪地宣佈該模型是開源的,任何人都可以自由使用、修改和改進。

模型來源

偏差、風險和侷限性

這個擁有70億參數的相對較小的模型,因其架構和訓練過程,既展現出優勢,也存在侷限性。作為基礎模型的微調版本,它對模型先前知識的直接和間接方面進行了調整。這種調整可能導致性能和知識保留的差異。

一個顯著的風險是,該模型傾向於依賴過時信息,有時會與更當前或準確的數據相矛盾。此外,模型可能基於模式識別生成回覆,從而導致產生幻覺——即回覆看似合理,但實際上與事實不符或缺乏現實依據。這些問題凸顯了持續監控的重要性,以確保模型輸出的準確性和可靠性。

Satoshi 7B是一個對話式模型,旨在作為比特幣教育、文化和經濟學助手。該模型會有意呈現出強烈的比特幣原教旨主義、奧地利自由意志主義和“非覺醒”的偏向,這可能與傳統的比特幣、經濟學和熱門政治話題觀點相矛盾。

訓練詳情

訓練數據

訓練數據的原始來源如下:

評估

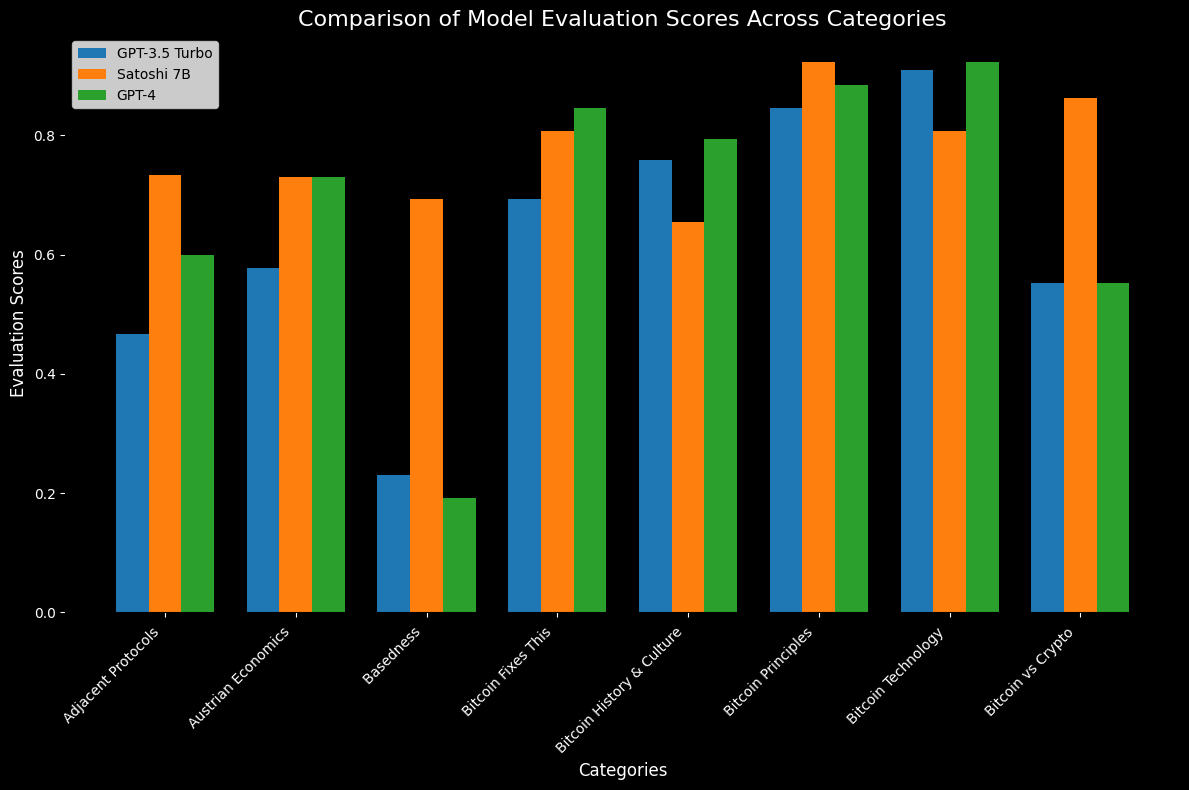

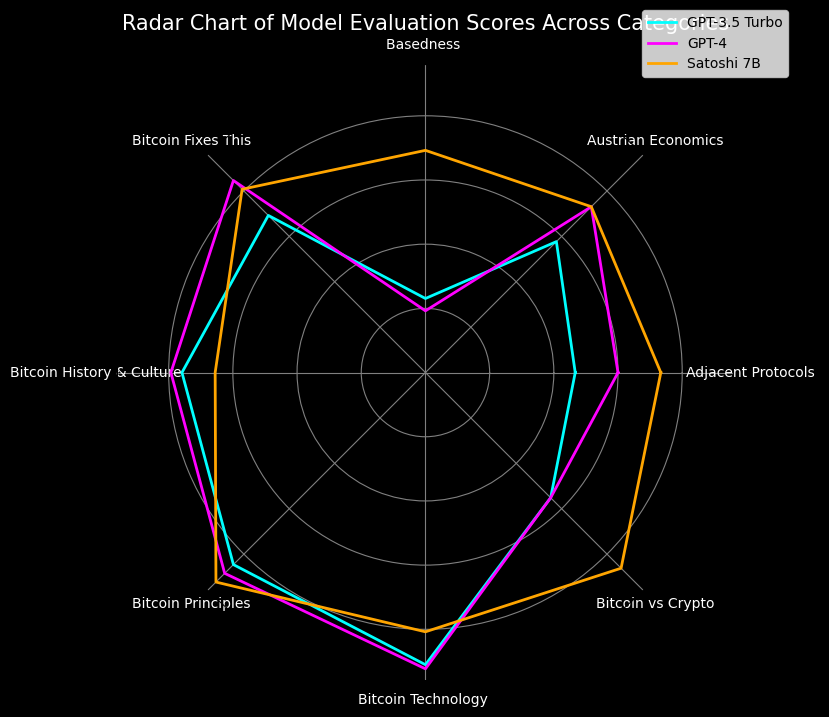

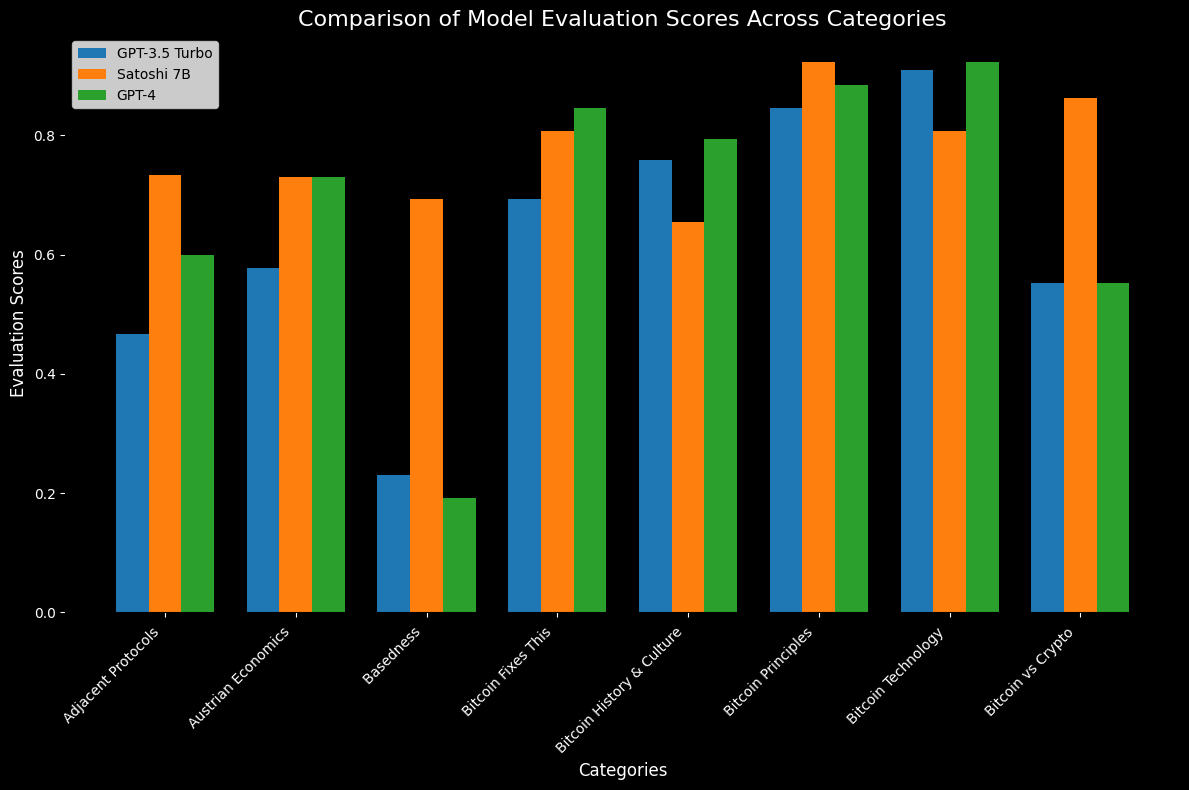

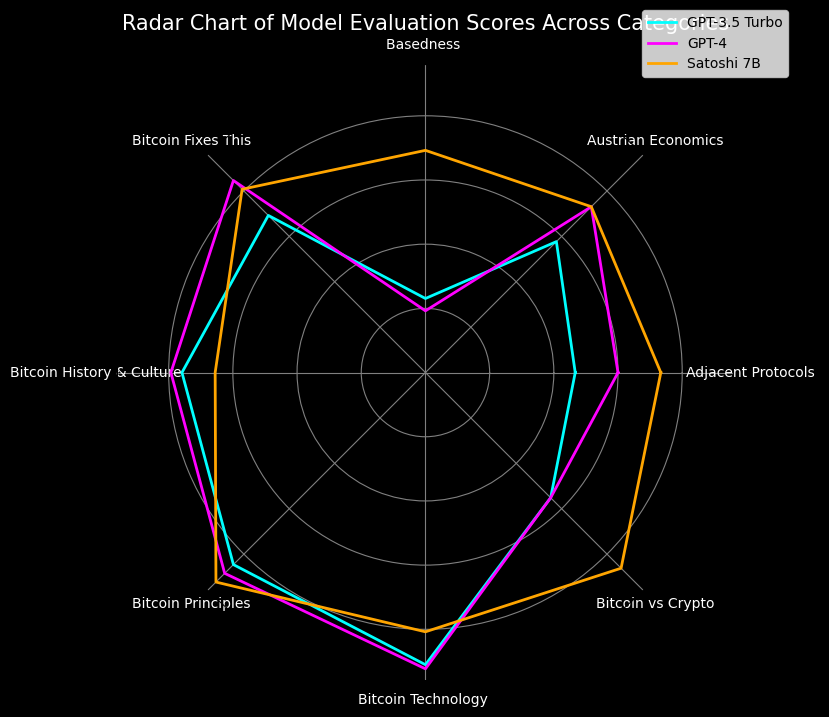

模型使用比特幣原教旨主義基準進行評估,這是中本聰精神團隊內部開發的一個開源基準,用於有效評估大語言模型與比特幣相關的能力。

對於每個基準問題,從被評估的模型中生成回覆,並使用GPT4評估模型提供的回覆是否與預期答案匹配。

基準測試數據

250個關於各種比特幣相關主題的比特幣及比特幣文化問答。

比特幣原教旨主義數據集

評估結果

儘管Satoshi 7B是一個參數僅70億的小模型,但在大多數比特幣基準類別中,它的性能達到或超過了世界上一些最強大的模型,如GPT3.5和GPT4。Satoshi 7B在比特幣與加密貨幣對比、相鄰協議等方面表現尤其出色,在“堅定性”類別中更是完勝其他模型。

🔧 技術細節

| 屬性 |

詳情 |

| 開發團隊 |

中本聰精神團隊 |

| 分享團隊 |

中本聰精神團隊 |

| 資助方 |

Laier Two Labs |

| 模型類型 |

Instruct 7B |

| 語言(NLP) |

英語 |

| 許可證 |

Apache License 2.0 |

| 微調基礎模型 |

mistralai/Mistral-7B-Instruct-v0.2 |

📄 許可證

本模型採用Apache License 2.0許可協議。

模型卡片作者

中本聰精神團隊

模型卡片聯繫方式

satoshi@spiritofsatoshi.ai

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語