Swinv2 Base Patch4 Window12to24 192to384 22kto1k Ft

Swin Transformer v2は、階層的特徴マップと局所ウィンドウ自己注意メカニズムにより、効率的な画像分類と密な認識タスクを実現する視覚Transformerモデルです。

ダウンロード数 1,824

リリース時間 : 6/16/2022

モデル概要

このモデルはImageNet-21kで事前学習され、384x384解像度でImageNet-1kに微調整されており、画像分類タスクに直接使用できます。

モデル特徴

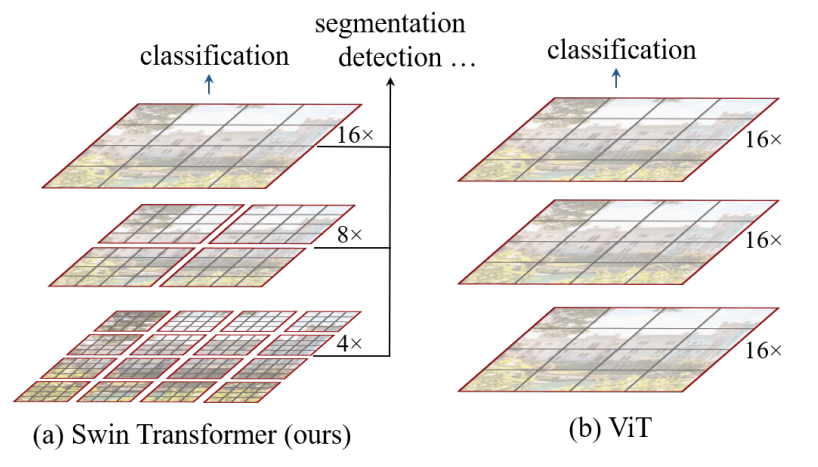

階層的特徴マップ

深層で画像パッチを統合して階層的特徴マップを構築し、異なる解像度の画像処理に適応します。

局所ウィンドウ自己注意

局所ウィンドウ内でのみ自己注意を計算し、計算複雑度を入力画像サイズに対して線形に保つことで効率を向上させます。

訓練安定性の改善

残差後正規化とコサイン注意を組み合わせて訓練安定性を向上させます。

高解像度転移能力

対数間隔連続位置バイアス法を採用し、低解像度事前学習モデルを高解像度下流タスクに効果的に転移させます。

自己教師付き事前学習

自己教師付き事前学習法SimMIMを導入し、大量の注釈付き画像への依存を軽減します。

モデル能力

画像分類

密な認識

使用事例

画像認識

動物認識

画像中の動物カテゴリ(例:トラ)を識別します。

ImageNet-1kの1000カテゴリのいずれかに正確に分類されます。

物体認識

ティーポットなどの日常物体を識別します。

ImageNet-1kの1000カテゴリのいずれかに正確に分類されます。

シーン認識

宮殿などの建築物や自然景観を識別します。

ImageNet-1kの1000カテゴリのいずれかに正確に分類されます。

おすすめAIモデル

Llama 3 Typhoon V1.5x 8b Instruct

タイ語専用に設計された80億パラメータの命令モデルで、GPT-3.5-turboに匹敵する性能を持ち、アプリケーションシナリオ、検索拡張生成、制限付き生成、推論タスクを最適化

大規模言語モデル Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-TinyはSODAデータセットでトレーニングされた超小型対話モデルで、エッジデバイス推論向けに設計されており、体積はCosmo-3Bモデルの約2%です。

対話システム Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

RoBERTaアーキテクチャに基づく中国語抽出型QAモデルで、与えられたテキストから回答を抽出するタスクに適しています。

質問応答システム 中国語

R

uer

2,694

98