🚀 ResNet-50バックボーンを持つDeformable DETRモデル(ボックスリファイン付き)

このモデルは、COCO 2017物体検出データセット(118k枚の注釈付き画像)でエンドツーエンドでトレーニングされた、ボックスリファイン付きのDeformable Detection Transformer(DETR)です。物体検出タスクにおいて高い性能を発揮します。

🚀 クイックスタート

このモデルは、物体検出タスクに使用できます。利用可能なすべてのDeformable DETRモデルを探すには、モデルハブを参照してください。

✨ 主な機能

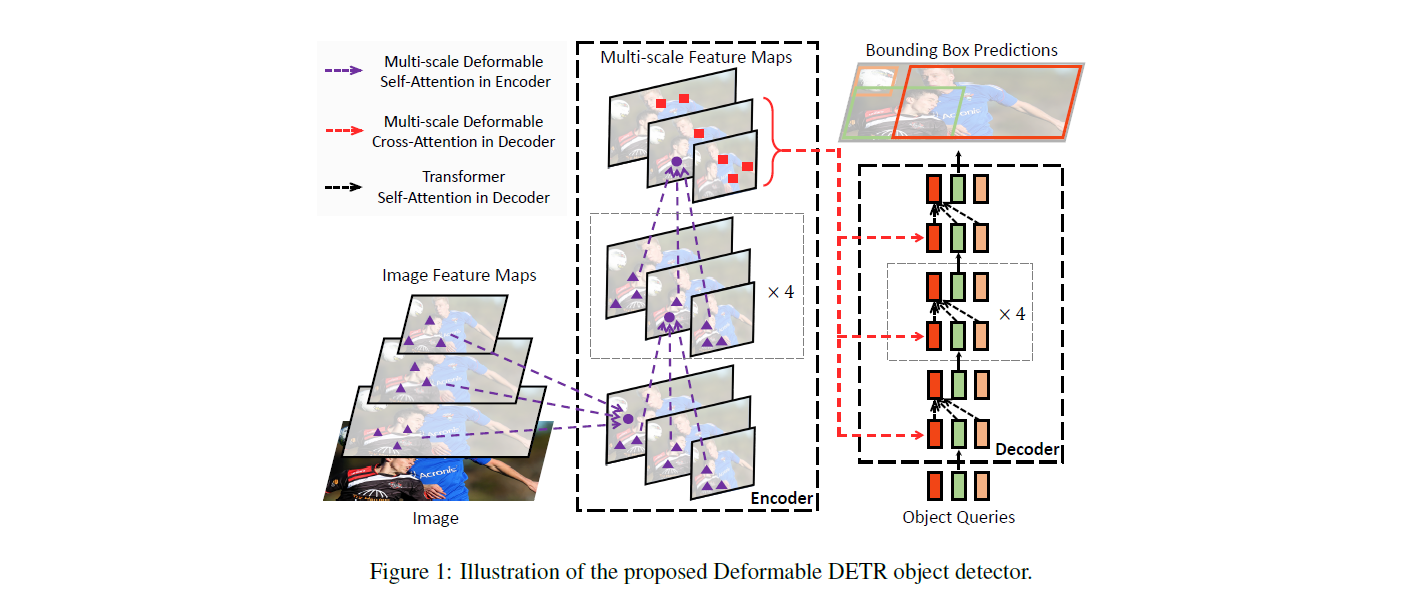

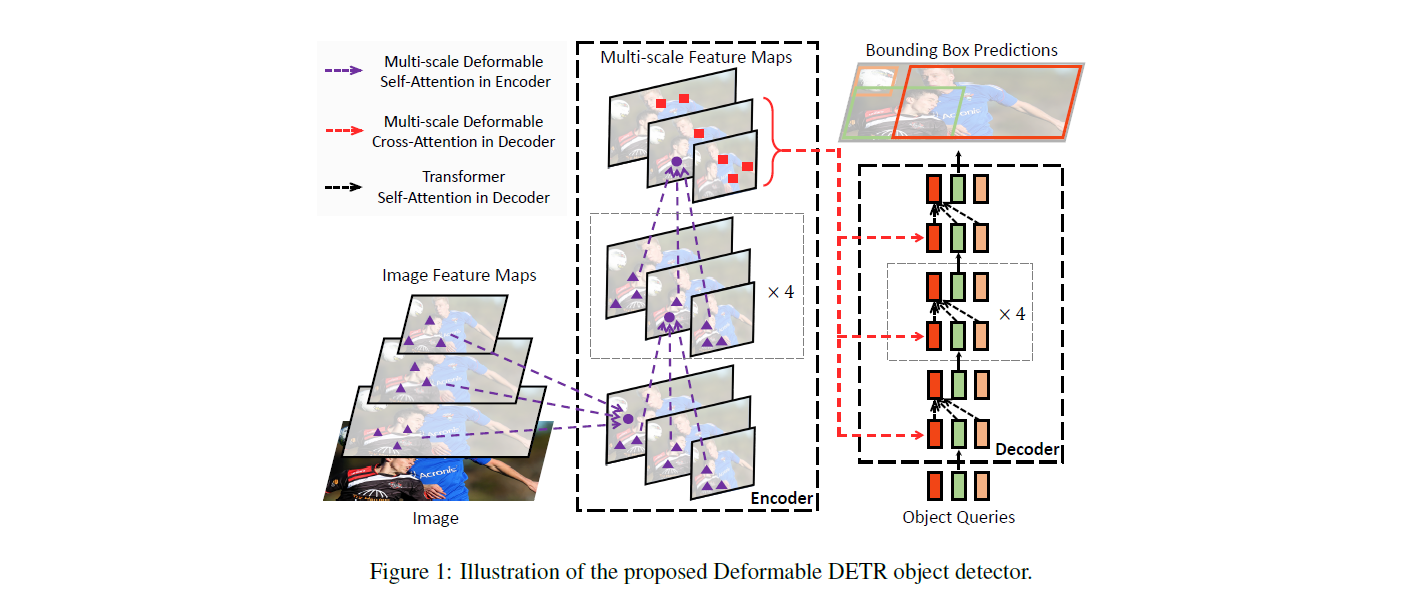

- DETRモデルは、畳み込みバックボーンを持つエンコーダ・デコーダトランスフォーマーです。

- デコーダ出力の上に2つのヘッドを追加して物体検出を行います。クラスラベルには線形層、バウンディングボックスにはMLP(多層パーセプトロン)を使用します。

- モデルは、画像内の物体を検出するためにオブジェクトクエリを使用します。COCOの場合、オブジェクトクエリの数は100に設定されています。

- 「二部マッチング損失」を使用してトレーニングされ、ハンガリアンマッチングアルゴリズムを用いて最適な1対1のマッピングを作成します。

📦 インストール

このモデルを使用するには、transformersライブラリが必要です。以下のコマンドでインストールできます。

pip install transformers torch pillow requests

💻 使用例

基本的な使用法

from transformers import AutoImageProcessor, DeformableDetrForObjectDetection

import torch

from PIL import Image

import requests

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

processor = AutoImageProcessor.from_pretrained("SenseTime/deformable-detr-with-box-refine")

model = DeformableDetrForObjectDetection.from_pretrained("SenseTime/deformable-detr-with-box-refine")

inputs = processor(images=image, return_tensors="pt")

outputs = model(**inputs)

target_sizes = torch.tensor([image.size[::-1]])

results = processor.post_process_object_detection(outputs, target_sizes=target_sizes, threshold=0.7)[0]

for score, label, box in zip(results["scores"], results["labels"], results["boxes"]):

box = [round(i, 2) for i in box.tolist()]

print(

f"Detected {model.config.id2label[label.item()]} with confidence "

f"{round(score.item(), 3)} at location {box}"

)

現在、特徴抽出器とモデルの両方がPyTorchをサポートしています。

📚 ドキュメント

モデルの説明

DETRモデルは、畳み込みバックボーンを持つエンコーダ・デコーダトランスフォーマーです。デコーダ出力の上に2つのヘッドを追加して物体検出を行います。クラスラベルには線形層、バウンディングボックスにはMLP(多層パーセプトロン)を使用します。

モデルは、画像内の物体を検出するためにオブジェクトクエリを使用します。各オブジェクトクエリは、画像内の特定の物体を探します。COCOの場合、オブジェクトクエリの数は100に設定されています。

モデルは、「二部マッチング損失」を使用してトレーニングされます。つまり、N = 100の各オブジェクトクエリの予測クラスとバウンディングボックスを、同じ長さNにパディングされた正解注釈と比較します。ハンガリアンマッチングアルゴリズムを使用して、各N個のクエリと各N個の注釈の間に最適な1対1のマッピングを作成します。次に、標準的な交差エントロピー(クラスに対して)とL1損失と一般化IoU損失の線形結合(バウンディングボックスに対して)を使用して、モデルのパラメータを最適化します。

想定される用途と制限

このモデルは、物体検出に使用できます。ただし、特定の環境やデータセットにおいては性能が低下する可能性があります。

🔧 技術詳細

📄 ライセンス

このモデルは、Apache-2.0ライセンスの下で提供されています。

BibTeX引用

@misc{https://doi.org/10.48550/arxiv.2010.04159,

doi = {10.48550/ARXIV.2010.04159},

url = {https://arxiv.org/abs/2010.04159},

author = {Zhu, Xizhou and Su, Weijie and Lu, Lewei and Li, Bin and Wang, Xiaogang and Dai, Jifeng},

keywords = {Computer Vision and Pattern Recognition (cs.CV), FOS: Computer and information sciences, FOS: Computer and information sciences},

title = {Deformable DETR: Deformable Transformers for End-to-End Object Detection},

publisher = {arXiv},

year = {2020},

copyright = {arXiv.org perpetual, non-exclusive license}

}

トレーニングデータ

Deformable DETRモデルは、COCO 2017物体検出データセットでトレーニングされました。このデータセットは、トレーニング用に118k枚、検証用に5k枚の注釈付き画像で構成されています。

| 属性 |

详情 |

| モデルタイプ |

ResNet-50バックボーンを持つDeformable DETRモデル(ボックスリファイン付き) |

| トレーニングデータ |

COCO 2017物体検出データセット(118k枚の注釈付き画像) |

⚠️ 重要提示

このモデルカードは、Deformable DETRを公開したチームではなく、Hugging Faceチームによって作成されました。

💡 使用建议

モデルの性能を向上させるために、適切な前処理やハイパーパラメータの調整を行うことをおすすめします。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語