🚀 ポルトガル語版BERT large cased QA (質問応答), SQUAD v1.1でファインチューニング

このモデルは、ポルトガル語のSQUAD v1.1データセットを用いて訓練された質問応答モデルです。BERTimbau Largeをベースに、SQUAD v1.1でファインチューニングすることで、質問応答タスクでの性能を向上させています。

🚀 クイックスタート

このモデルは、ポルトガル語の質問応答タスクに特化しています。以下のセクションでは、モデルの使用方法や性能、制限事項などについて説明します。

✨ 主な機能

- 高精度な質問応答: SQUAD v1.1データセットでファインチューニングされたため、質問応答タスクで高い精度を達成します。

- ポルトガル語対応: ポルトガル語の質問に対して適切な回答を生成します。

📦 インストール

モデルを使用するには、transformersライブラリをインストールする必要があります。以下のコマンドでインストールできます。

pip install transformers

💻 使用例

基本的な使用法

import transformers

from transformers import pipeline

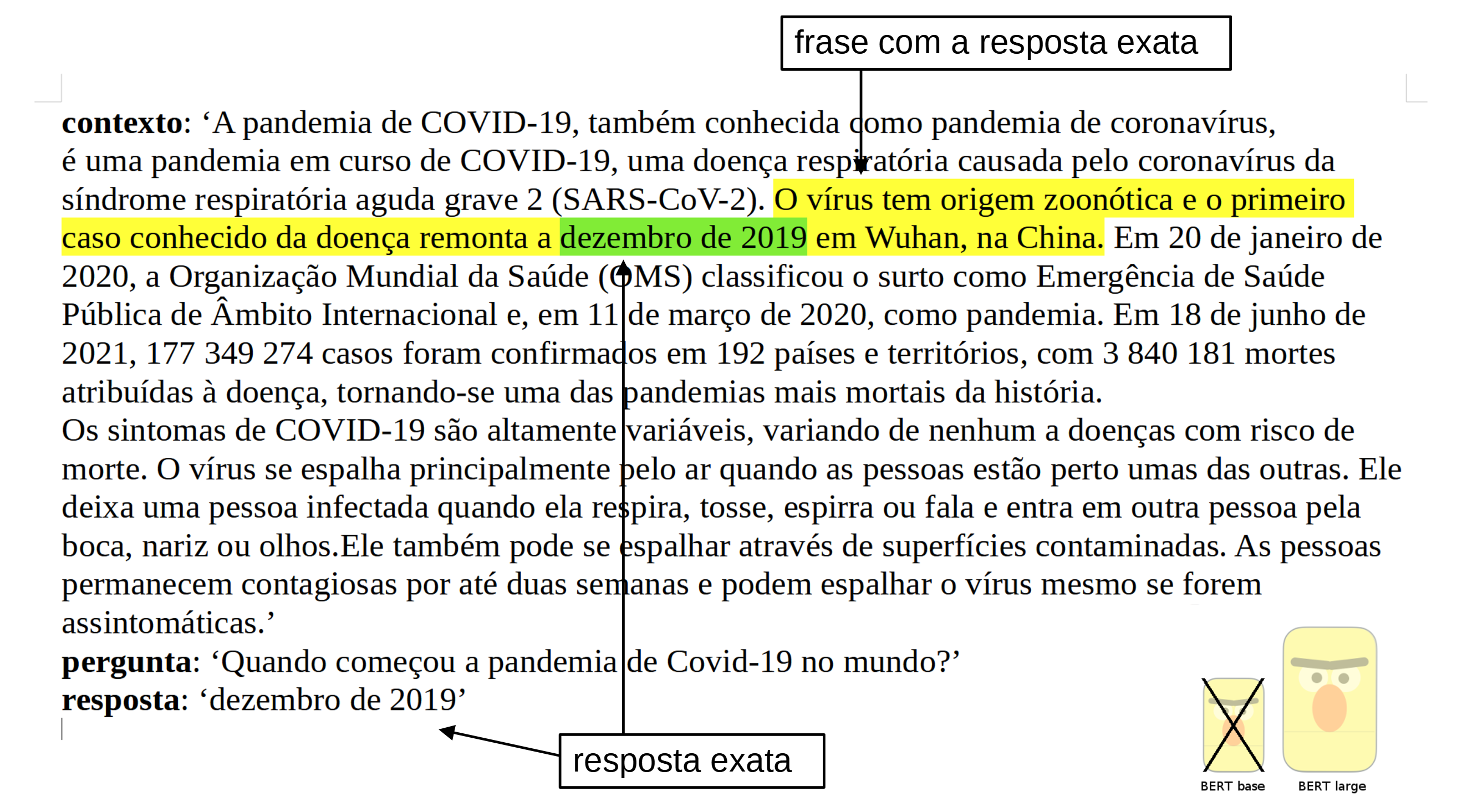

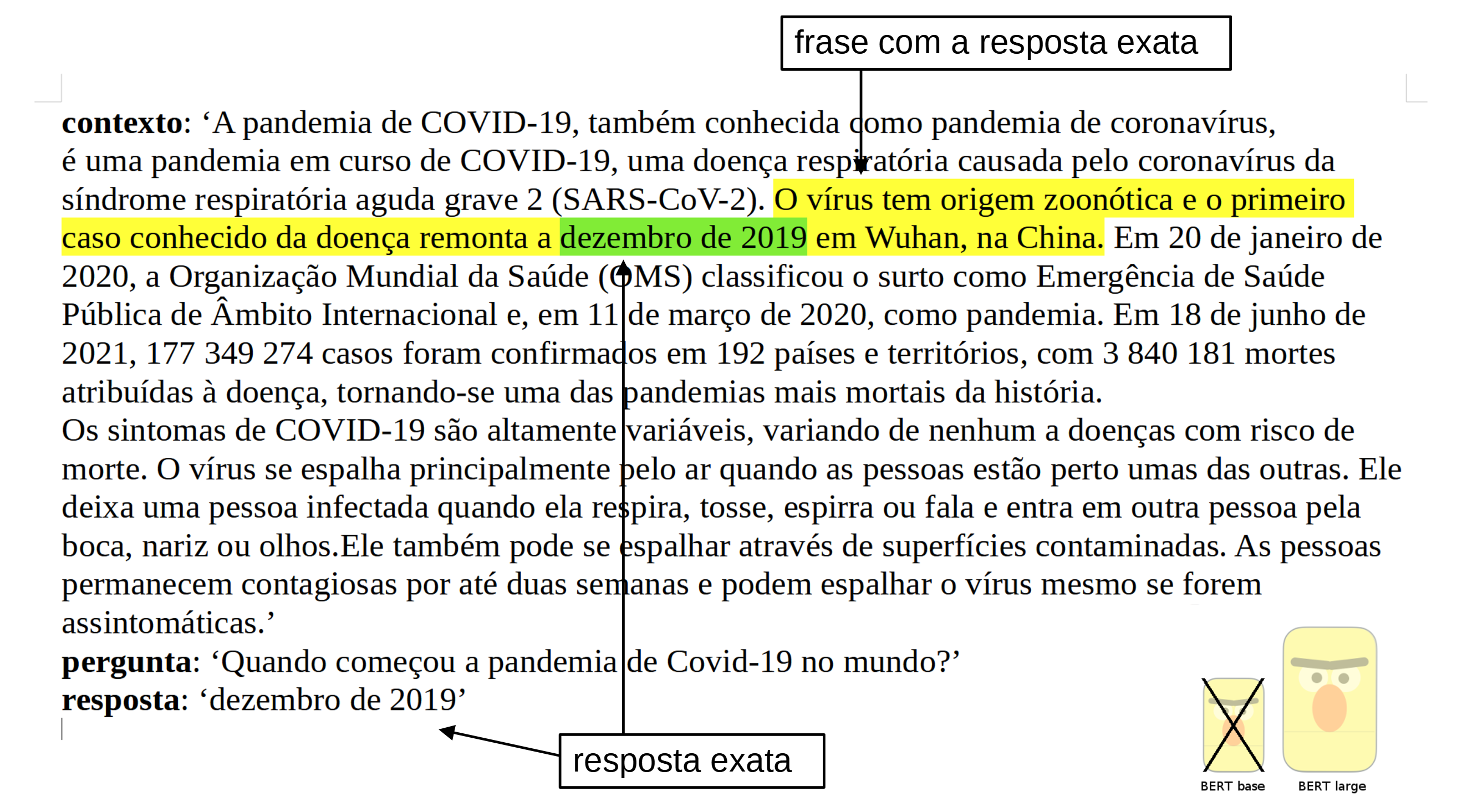

context = r"""

A pandemia de COVID-19, também conhecida como pandemia de coronavírus, é uma pandemia em curso de COVID-19,

uma doença respiratória causada pelo coronavírus da síndrome respiratória aguda grave 2 (SARS-CoV-2).

O vírus tem origem zoonótica e o primeiro caso conhecido da doença remonta a dezembro de 2019 em Wuhan, na China.

Em 20 de janeiro de 2020, a Organização Mundial da Saúde (OMS) classificou o surto

como Emergência de Saúde Pública de Âmbito Internacional e, em 11 de março de 2020, como pandemia.

Em 18 de junho de 2021, 177 349 274 casos foram confirmados em 192 países e territórios,

com 3 840 181 mortes atribuídas à doença, tornando-se uma das pandemias mais mortais da história.

Os sintomas de COVID-19 são altamente variáveis, variando de nenhum a doenças com risco de morte.

O vírus se espalha principalmente pelo ar quando as pessoas estão perto umas das outras.

Ele deixa uma pessoa infectada quando ela respira, tosse, espirra ou fala e entra em outra pessoa pela boca, nariz ou olhos.

Ele também pode se espalhar através de superfícies contaminadas.

As pessoas permanecem contagiosas por até duas semanas e podem espalhar o vírus mesmo se forem assintomáticas.

"""

model_name = 'pierreguillou/bert-large-cased-squad-v1.1-portuguese'

nlp = pipeline("question-answering", model=model_name)

question = "Quando começou a pandemia de Covid-19 no mundo?"

result = nlp(question=question, context=context)

print(f"Answer: '{result['answer']}', score: {round(result['score'], 4)}, start: {result['start']}, end: {result['end']}")

高度な使用法

from transformers import AutoTokenizer, AutoModelForQuestionAnswering

tokenizer = AutoTokenizer.from_pretrained("pierreguillou/bert-large-cased-squad-v1.1-portuguese")

model = AutoModelForQuestionAnswering.from_pretrained("pierreguillou/bert-large-cased-squad-v1.1-portuguese")

または、以下のコマンドでモデルのリポジトリをクローンできます。

git lfs install

git clone https://huggingface.co/pierreguillou/bert-large-cased-squad-v1.1-portuguese

GIT_LFS_SKIP_SMUDGE=1

📚 ドキュメント

モデルの訓練について

このモデルは、Deep Learning Brasilグループのポルトガル語版SQUAD v1.1データセットを用いて訓練されました。使用された言語モデルは、Neuralmind.aiのBERTimbau Large(別名 "bert-large-portuguese-cased")です。

詳細情報

すべての詳細情報は、ブログ記事 NLP | Como treinar um modelo de Question Answering em qualquer linguagem baseado no BERT large, melhorando o desempenho do modelo utilizando o BERT base? (estudo de caso em português) に記載されています。

GitHub上のノートブック

question_answering_BERT_large_cased_squad_v11_pt.ipynb (nbviewer版)

🔧 技術詳細

このモデルの訓練に使用された手法やパラメータについては、上記のブログ記事に詳細が記載されています。

📈 性能

得られた結果は以下の通りです。

f1 = 84.43 (ベースモデルの82.50に対して)

exact match = 72.68 (ベースモデルの70.49に対して)

⚠️ 制限事項とバイアス

このモデルの訓練データはポルトガル語版SQUADから取得されています。このデータには、中立性を欠く未フィルターのコンテンツやバイアスが含まれている可能性があります。

📄 ライセンス

このモデルはMITライセンスの下で提供されています。

👤 作者

ポルトガル語版BERT large cased QA (質問応答), SQUAD v1.1でファインチューニングされたモデルは、Pierre GUILLOUによって訓練および評価されました。多くの組織のオープンソースコード、プラットフォーム、アドバイスを活用しています。特に、Hugging Face、Neuralmind.ai、Deep Learning Brasilグループ、AI Lab などです。

📝 引用

このモデルを使用する場合は、以下のように引用してください。

@inproceedings{pierreguillou2021bertlargecasedsquadv11portuguese,

title={Portuguese BERT large cased QA (Question Answering), finetuned on SQUAD v1.1},

author={Pierre Guillou},

year={2021}

}

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語