🚀 UniSpeech-Large-plus Kyrgyz

このモデルは、16kHzでサンプリングされた音声オーディオと音素ラベルを用いて事前学習され、その後1時間分のキルギス語の音素でファインチューニングされた大規模モデルです。モデルを使用する際には、入力音声が16kHzでサンプリングされており、テキストが音素列に変換されていることを確認してください。

論文: UniSpeech: Unified Speech Representation Learning with Labeled and Unlabeled Data

著者: Chengyi Wang, Yu Wu, Yao Qian, Kenichi Kumatani, Shujie Liu, Furu Wei, Michael Zeng, Xuedong Huang

概要

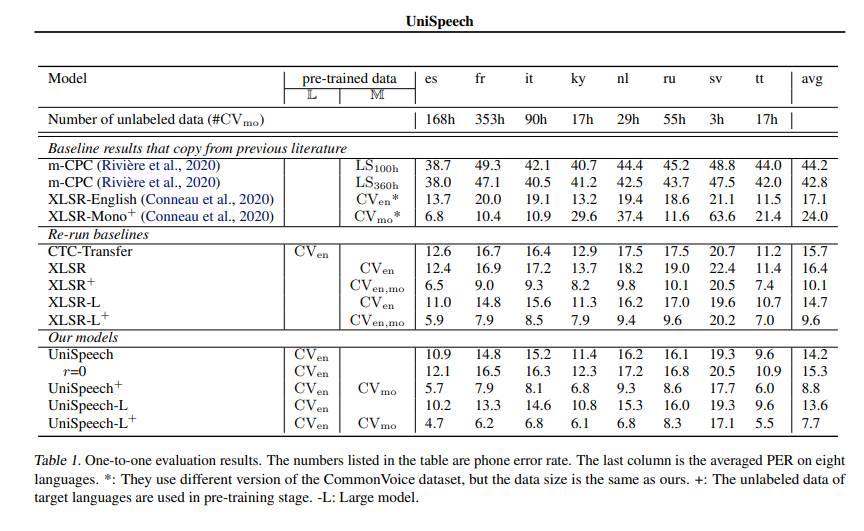

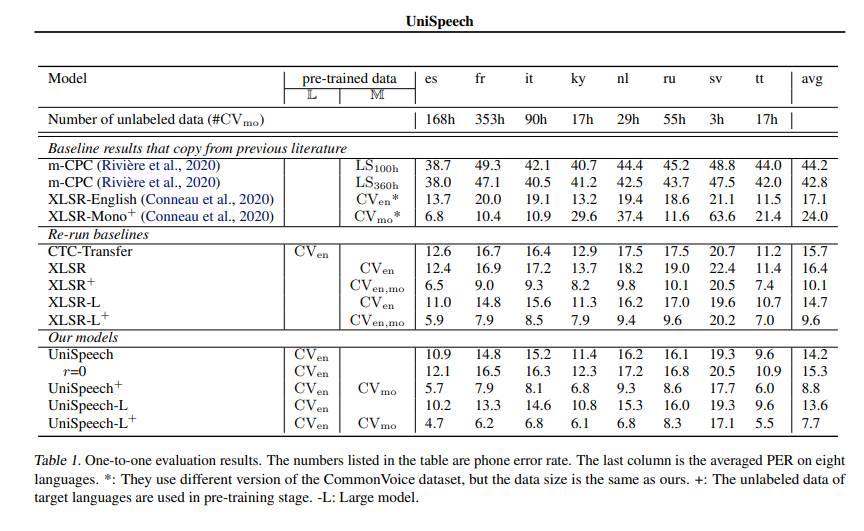

本論文では、ラベル付きデータとラベル無しデータの両方を用いて音声表現を学習するための統一的な事前学習アプローチであるUniSpeechを提案します。このアプローチでは、教師付き音素CTC学習と音素を意識したコントラスト型自己教師付き学習がマルチタスク学習の方式で行われます。得られた表現は、音素構造とより相関の高い情報を捉えることができ、言語やドメイン間の汎化性能を向上させます。我々は、公開されているCommonVoiceコーパスを用いて、UniSpeechの多言語表現学習における有効性を評価しました。結果は、UniSpeechが自己教師付き事前学習と教師付き転移学習をそれぞれ最大で13.4%と17.8%の相対音素誤り率の削減で上回っていることを示しています(すべてのテスト言語で平均)。また、UniSpeechの転移性は、ドメインシフト音声認識タスクでも実証されており、以前のアプローチに対して6%の相対単語誤り率の削減が達成されています。

元のモデルは、https://github.com/microsoft/UniSpeech/tree/main/UniSpeech で見つけることができます。

🚀 クイックスタート

このモデルは音素分類にファインチューニングされた音声モデルです。

推論

import torch

from datasets import load_dataset

from transformers import AutoModelForCTC, AutoProcessor

import torchaudio.functional as F

model_id = "microsoft/unispeech-1350-en-17h-ky-ft-1h"

sample = next(iter(load_dataset("common_voice", "ky", split="test", streaming=True)))

resampled_audio = F.resample(torch.tensor(sample["audio"]["array"]), 48_000, 16_000).numpy()

model = AutoModelForCTC.from_pretrained(model_id)

processor = AutoProcessor.from_pretrained(model_id)

input_values = processor(resampled_audio, return_tensors="pt").input_values

with torch.no_grad():

logits = model(input_values).logits

prediction_ids = torch.argmax(logits, dim=-1)

transcription = processor.batch_decode(prediction_ids)

✨ 主な機能

- キルギス語の音素分類に特化した音声モデルです。

- 事前学習とファインチューニングを経て、高い性能を発揮します。

📦 インストール

このモデルを使用するには、必要なライブラリをインストールする必要があります。以下のコマンドを使用してインストールできます。

pip install torch datasets transformers torchaudio

💻 使用例

基本的な使用法

import torch

from datasets import load_dataset

from transformers import AutoModelForCTC, AutoProcessor

import torchaudio.functional as F

model_id = "microsoft/unispeech-1350-en-17h-ky-ft-1h"

sample = next(iter(load_dataset("common_voice", "ky", split="test", streaming=True)))

resampled_audio = F.resample(torch.tensor(sample["audio"]["array"]), 48_000, 16_000).numpy()

model = AutoModelForCTC.from_pretrained(model_id)

processor = AutoProcessor.from_pretrained(model_id)

input_values = processor(resampled_audio, return_tensors="pt").input_values

with torch.no_grad():

logits = model(input_values).logits

prediction_ids = torch.argmax(logits, dim=-1)

transcription = processor.batch_decode(prediction_ids)

📚 ドキュメント

🔧 技術詳細

このモデルは、MicrosoftのUniSpeechをベースに構築されています。事前学習は16kHzの音声オーディオと音素ラベルを用いて行われ、その後1時間分のキルギス語の音素でファインチューニングされています。

📄 ライセンス

公式のライセンスは、こちらで確認できます。

📊 公式の結果

UniSpeeech-L^{+} - ky の結果は以下の画像で確認できます。

👥 貢献者

このモデルは、cywang と patrickvonplaten によって貢献されました。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語