🚀 DISTIL-ITA-LEGAL-BERT

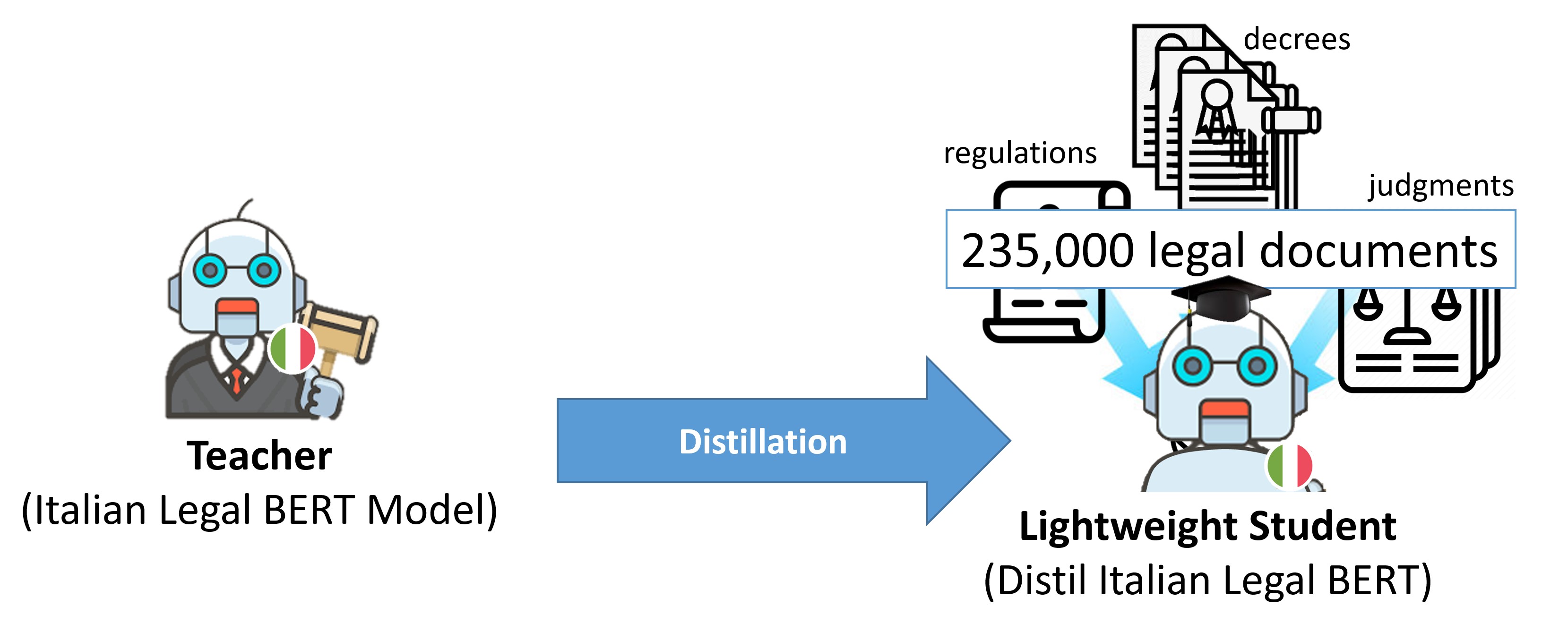

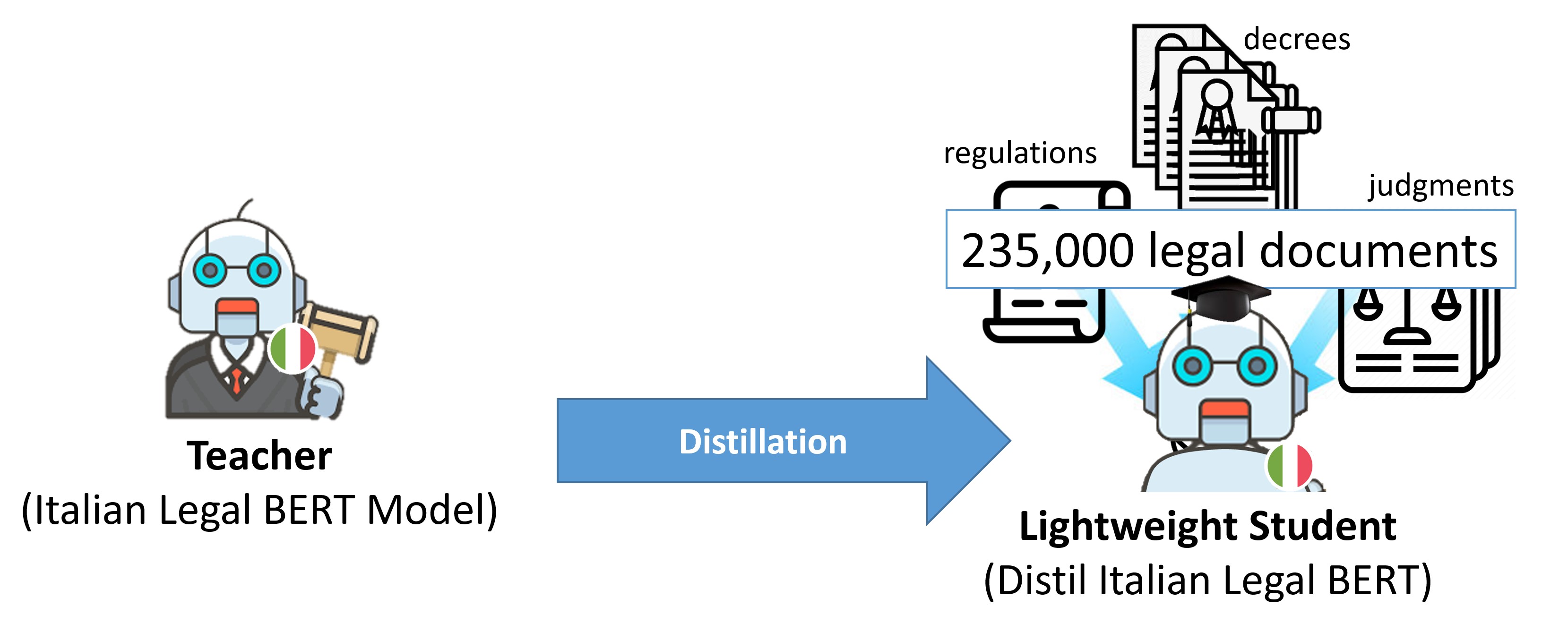

このモデルは、知識蒸留のプロセスを用いて、Transformerが4レベルのみの高速で軽量な生徒モデルを作成しました。このモデルは、より複雑なITALIAN-LEGAL-BERT教師モデルが生成するものと同様の文埋め込みを生成することができます。

このモデルは、Sentence-BERTライブラリを使用して、ITALIAN-LEGAL-BERTのトレーニングセット(3.7 GB)で、自身の埋め込みと教師モデルが生成する埋め込みの間の平均二乗誤差(MSE)を最小化することで最適化されています。

これはsentence-transformersモデルです。文や段落を768次元の密なベクトル空間にマッピングし、クラスタリングや意味検索などのタスクに使用できます。

🚀 クイックスタート

このモデルは、sentence-transformersをインストールすると簡単に使用できます。

✨ 主な機能

- 知識蒸留を用いて、高速で軽量な生徒モデルを作成。

- ITALIAN-LEGAL-BERTのトレーニングセットで最適化されている。

- 文や段落を768次元の密なベクトル空間にマッピングできる。

- クラスタリングや意味検索などのタスクに使用できる。

📦 インストール

pip install -U sentence-transformers

💻 使用例

基本的な使用法

from sentence_transformers import SentenceTransformer

sentences = ["This is an example sentence", "Each sentence is converted"]

model = SentenceTransformer('dlicari/distil-ita-legal-bert')

embeddings = model.encode(sentences)

print(embeddings)

高度な使用法

from transformers import AutoTokenizer, AutoModel

import torch

def mean_pooling(model_output, attention_mask):

token_embeddings = model_output[0]

input_mask_expanded = attention_mask.unsqueeze(-1).expand(token_embeddings.size()).float()

return torch.sum(token_embeddings * input_mask_expanded, 1) / torch.clamp(input_mask_expanded.sum(1), min=1e-9)

sentences = ['This is an example sentence', 'Each sentence is converted']

tokenizer = AutoTokenizer.from_pretrained('dlicari/distil-ita-legal-bert')

model = AutoModel.from_pretrained('dlicari/distil-ita-legal-bert')

encoded_input = tokenizer(sentences, padding=True, truncation=True, return_tensors='pt')

with torch.no_grad():

model_output = model(**encoded_input)

sentence_embeddings = mean_pooling(model_output, encoded_input['attention_mask'])

print("Sentence embeddings:")

print(sentence_embeddings)

📚 ドキュメント

評価結果

このモデルの自動評価については、Sentence Embeddings Benchmarkを参照してください: https://seb.sbert.net

トレーニング

このモデルは以下のパラメータでトレーニングされました。

DataLoader:

torch.utils.data.dataloader.DataLoader of length 409633 with parameters:

{'batch_size': 24, 'sampler': 'torch.utils.data.sampler.RandomSampler', 'batch_sampler': 'torch.utils.data.sampler.BatchSampler'}

Loss:

sentence_transformers.losses.MSELoss.MSELoss

Parameters of the fit()-Method:

{

"epochs": 4,

"evaluation_steps": 5000,

"evaluator": "sentence_transformers.evaluation.SequentialEvaluator.SequentialEvaluator",

"max_grad_norm": 1,

"optimizer_class": "<class 'transformers.optimization.AdamW'>",

"optimizer_params": {

"correct_bias": false,

"eps": 1e-06,

"lr": 0.0001

},

"scheduler": "WarmupLinear",

"steps_per_epoch": null,

"warmup_steps": 1000,

"weight_decay": 0.01

}

全モデルアーキテクチャ

SentenceTransformer(

(0): Transformer({'max_seq_length': 512, 'do_lower_case': False}) with Transformer model: BertModel

(1): Pooling({'word_embedding_dimension': 768, 'pooling_mode_cls_token': False, 'pooling_mode_mean_tokens': True, 'pooling_mode_max_tokens': False, 'pooling_mode_mean_sqrt_len_tokens': False})

)

📄 ライセンス

このモデルはafl-3.0ライセンスの下で提供されています。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語