🚀 ColQwen2.5-3b-multilingual: Qwen2.5-VL-3B-InstructをベースにColBERT戦略を用いた多言語ビジュアルリトリーバー

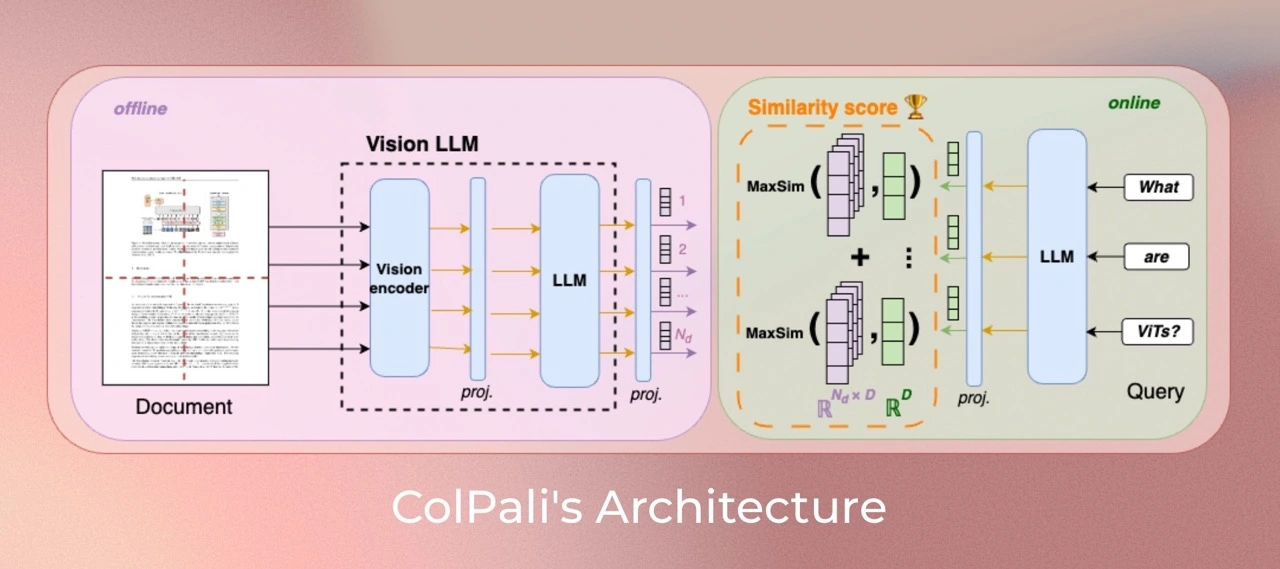

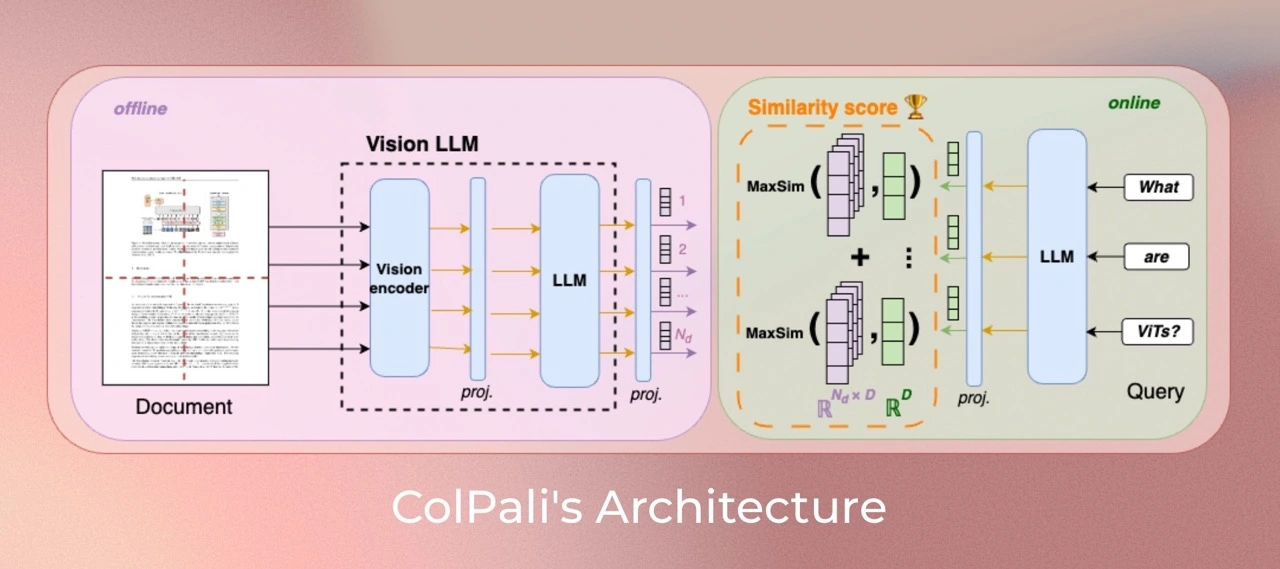

このモデルは、ビジョン言語モデル(VLM)に基づく新しいモデルアーキテクチャとトレーニング戦略を用いて、ドキュメントのビジュアル特徴から効率的にインデックスを作成します。2025年2月2日現在、Vidoreベンチマークで70億パラメータ未満のモデルの中で1位、全体で3位を獲得しています。Vidoreリーダーボードに報告されているスコアは、checkpoint-1800に対応しています。

このモデルは、4xA100 80GBでper_device_batch_size=128、gradient_accumulation_steps=2、5エポックでトレーニングされたベースバージョンです。

🚀 クイックスタート

ColQwen2.5-3b-multilingualは、ビジュアルドキュメント検索に特化した多言語モデルです。以下のセクションでは、インストール方法、使用例、制限事項などについて説明します。

✨ 主な機能

- 高い検索性能: 2025年2月2日現在、Vidoreベンチマークで70億パラメータ未満のモデルの中で1位、全体で3位を獲得しています。

- 多言語対応: 英語、フランス語、スペイン語、イタリア語、ドイツ語などの複数の言語に対応しています。

- マルチベクトル検索: ColBERTの遅延相互作用メカニズムに基づくマルチベクトル検索をサポートしています。

📦 インストール

colpali-engine がソースからインストールされているか、バージョンが0.3.1より新しいことを確認してください。transformers のバージョンは4.45.0より新しい必要があります。

ColPali

pip install git+https://github.com/illuin-tech/colpali

または

pip install git+https://github.com/illuin-tech/colpali@colqwen2_5

Qwen2.5

Qwen2.5-VLのコードは最新のHugging face transformersに含まれています。ソースからビルドすることをお勧めします。

pip install git+https://github.com/huggingface/transformers accelerate

ソースからビルドしない場合、以下のエラーが発生する可能性があります。

KeyError: 'qwen2_5_vl'

💻 使用例

基本的な使用法

import torch

from PIL import Image

from colpali_engine.models import ColQwen2_5, ColQwen2_5_Processor

model = ColQwen2_5.from_pretrained(

"Metric-AI/colqwen2.5-3b-multilingual",

torch_dtype=torch.bfloat16,

device_map="cuda:0",

).eval()

processor = ColQwen2_5_Processor.from_pretrained("Metric-AI/colqwen2.5-3b-multilingual")

images = [

Image.new("RGB", (32, 32), color="white"),

Image.new("RGB", (16, 16), color="black"),

]

queries = [

"Is attention really all you need?",

"What is the amount of bananas farmed in Salvador?",

]

batch_images = processor.process_images(images).to(model.device)

batch_queries = processor.process_queries(queries).to(model.device)

with torch.no_grad():

image_embeddings = model(**batch_images)

query_embeddings = model(**batch_queries)

scores = processor.score_multi_vector(query_embeddings, image_embeddings)

🔧 技術詳細

データセット

- Synthetic data:

openbmb/VisRAG-Ret-Train-Synthetic-data データセットから選択され、前処理されたデータです。

- In-domain VQA dataset:

openbmb/VisRAG-Ret-Train-In-domain-data から抽出されたデータです。

- Docmatix dataset:

Metric-AI/rag_docmatix_100k データセットから抽出されたデータです。

- Colpali dataset:

vidore/colpali_train_set から取得されたデータです。

- Multilingual dataset:

llamaindex/vdr-multilingual-train から取得されたデータです。

モデルトレーニング

モデルは、低ランクアダプター(LoRA)を使用してトレーニングされています。具体的には、言語モデルのトランスフォーマーレイヤーと、最後のランダムに初期化された投影レイヤーに対して、alpha=128 および r=128 を使用しています。最適化には paged_adamw_8bit オプティマイザーを使用しています。

トレーニングは4xA100 GPUセットアップで分散データ並列(accelerate経由)で行われ、学習率は2e-4で線形減衰し、1%のウォームアップステップを使用しています。デバイスごとのバッチサイズは128、勾配累積ステップは2で、bfloat16 形式でトレーニングされています。

📚 ドキュメント

制限事項

- 対象範囲: このモデルは主にPDFタイプのドキュメントとリソースが豊富な言語に焦点を当てており、他のドキュメントタイプや表現が少ない言語への汎化能力が制限される可能性があります。

- サポート: このモデルはColBERTの遅延相互作用メカニズムに基づくマルチベクトル検索に依存しており、ネイティブのマルチベクトルサポートがない一般的なベクトル検索フレームワークに適応させるにはエンジニアリングの努力が必要になる場合があります。

ライセンス

ColQwen2.5のビジョン言語バックボーンモデル(Qwen2.5-VL)は apache2.0 ライセンスの下にあります。モデルに付属するアダプターはMITライセンスの下にあります。

引用

この組織のモデルを研究で使用する場合は、以下のように元の論文を引用してください。

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

開発元

Metric AI Research Lab

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語