🚀 Yi-Coder

Yi-Coder是一系列开源代码语言模型,在参数少于100亿的情况下,仍能提供卓越的编码性能。它能够帮助开发者更高效地进行代码编写和理解,在代码生成、代码补全等场景中发挥重要作用。

🐙 GitHub •

👾 Discord •

🐤 Twitter •

💬 WeChat

📝 Paper •

💪 Tech Blog •

🙌 FAQ •

📗 Learning Hub

✨ 主要特性

- 具备出色的长上下文理解能力,最大上下文长度可达128K个标记。

- 支持52种主流编程语言,包括:

'java', 'markdown', 'python', 'php', 'javascript', 'c++', 'c#', 'c', 'typescript', 'html', 'go', 'java_server_pages', 'dart', 'objective-c', 'kotlin', 'tex', 'swift', 'ruby', 'sql', 'rust', 'css', 'yaml', 'matlab', 'lua', 'json', 'shell', 'visual_basic', 'scala', 'rmarkdown', 'pascal', 'fortran', 'haskell', 'assembly', 'perl', 'julia', 'cmake', 'groovy', 'ocaml', 'powershell', 'elixir', 'clojure', 'makefile', 'coffeescript', 'erlang', 'lisp', 'toml', 'batchfile', 'cobol', 'dockerfile', 'r', 'prolog', 'verilog'

如需了解模型详情和基准测试结果,请参考 Yi-Coder博客 和 Yi-Coder README。

📦 模型信息

具体模型下载信息如下:

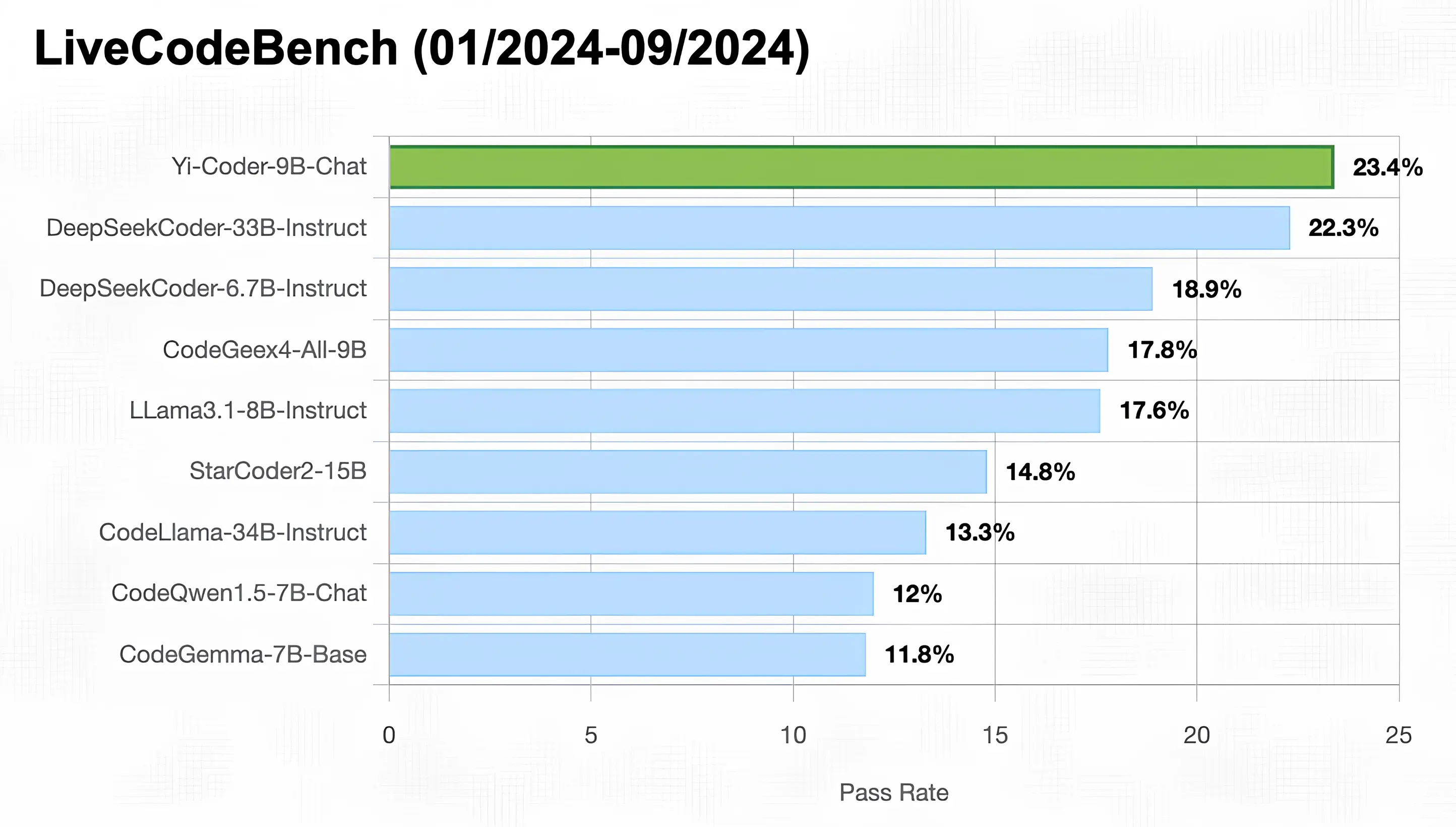

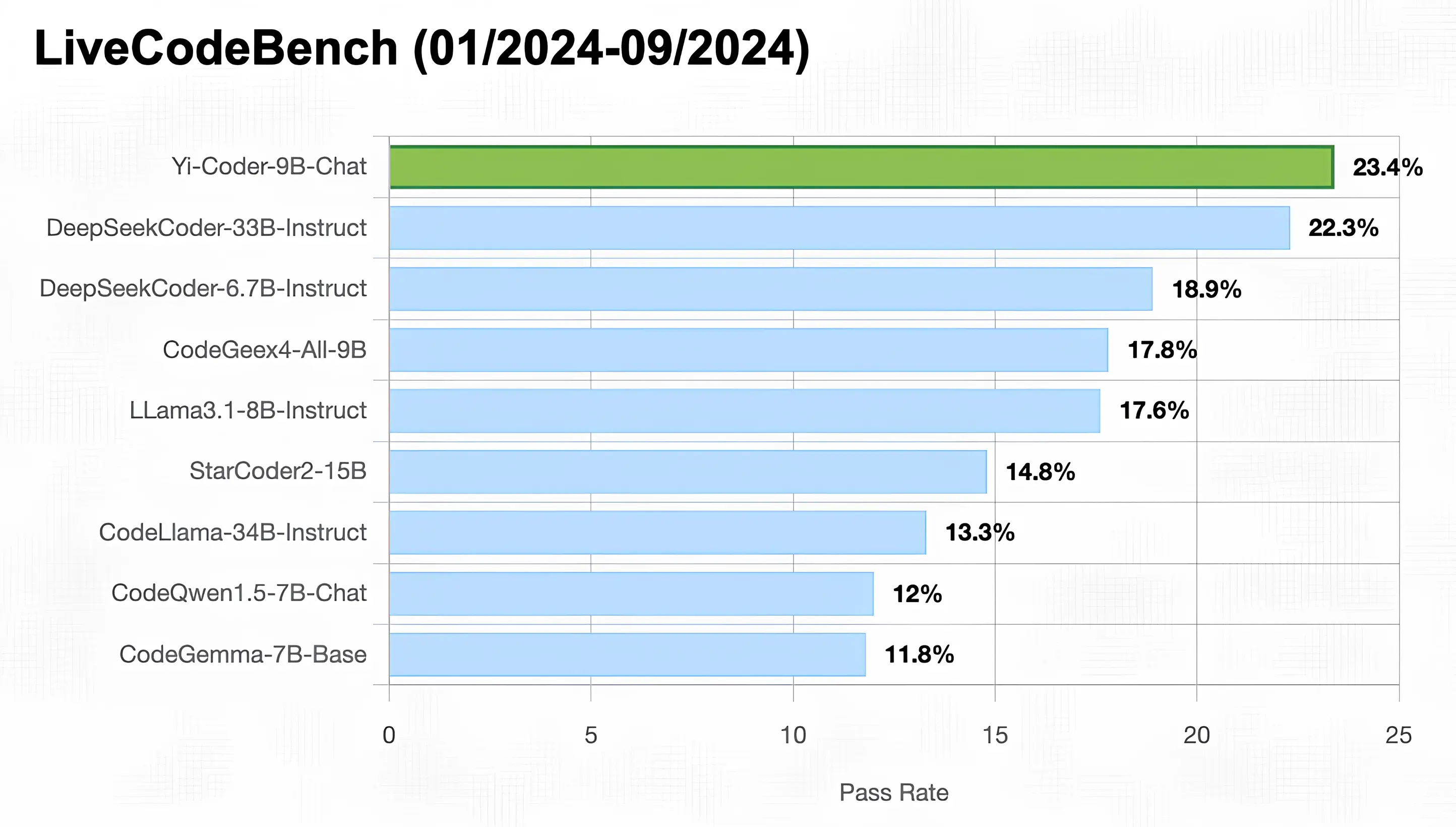

📊 基准测试

如下图所示,Yi-Coder-9B-Chat在LiveCodeBench中取得了令人瞩目的23%的通过率,是唯一参数少于100亿且通过率超过20%的模型。它还优于DeepSeekCoder - 33B - Ins(22.3%)、CodeGeex4 - 9B - all(17.8%)、CodeLLama - 34B - Ins(13.3%)和CodeQwen1.5 - 7B - Chat(12%)。

🚀 快速开始

你可以使用transformers库对Yi-Coder模型(包括聊天版和基础版)进行推理,示例代码如下:

from transformers import AutoTokenizer, AutoModelForCausalLM

device = "cuda"

model_path = "01-ai/Yi-Coder-9B-Chat"

tokenizer = AutoTokenizer.from_pretrained(model_path)

model = AutoModelForCausalLM.from_pretrained(model_path, device_map="auto").eval()

prompt = "Write a quick sort algorithm."

messages = [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": prompt}

]

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True

)

model_inputs = tokenizer([text], return_tensors="pt").to(device)

generated_ids = model.generate(

model_inputs.input_ids,

max_new_tokens=1024,

eos_token_id=tokenizer.eos_token_id

)

generated_ids = [

output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids)

]

response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0]

print(response)

如需快速上手并运行Yi-Coder系列模型,请参考 Yi-Coder README。

📄 许可证

本项目采用Apache-2.0许可证。

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语