🚀 GPT2-small-indonesian

这是一个基于因果语言建模(CLM)目标在印尼语上进行预训练的模型。因果语言建模首次在这篇论文中被提出,并首次在此页面发布。该模型使用HuggingFace的Flax框架进行训练,是由HuggingFace组织的JAX/Flax社区周的一部分。所有训练均在由谷歌云团队赞助的TPUv3 - 8虚拟机上完成。你可以在这里找到该模型的演示。

🚀 快速开始

你可以直接使用文本生成管道来使用这个模型。由于生成过程依赖于一定的随机性,为了保证结果可复现,我们设置了一个随机种子:

>>> from transformers import pipeline, set_seed

>>> generator = pipeline('text-generation', model='flax-community/gpt2-small-indonesian')

>>> set_seed(42)

>>> generator("Sewindu sudah kita tak berjumpa,", max_length=30, num_return_sequences=5)

[{'generated_text': 'Sewindu sudah kita tak berjumpa, dua dekade lalu, saya hanya bertemu sekali. Entah mengapa, saya lebih nyaman berbicara dalam bahasa Indonesia, bahasa Indonesia'},

{'generated_text': 'Sewindu sudah kita tak berjumpa, tapi dalam dua hari ini, kita bisa saja bertemu.”\

“Kau tau, bagaimana dulu kita bertemu?” aku'},

{'generated_text': 'Sewindu sudah kita tak berjumpa, banyak kisah yang tersimpan. Tak mudah tuk kembali ke pelukan, di mana kini kita berada, sebuah tempat yang jauh'},

{'generated_text': 'Sewindu sudah kita tak berjumpa, sejak aku lulus kampus di Bandung, aku sempat mencari kabar tentangmu. Ah, masih ada tempat di hatiku,'},

{'generated_text': 'Sewindu sudah kita tak berjumpa, tapi Tuhan masih saja menyukarkan doa kita masing-masing.\

Tuhan akan memberi lebih dari apa yang kita'}]

以下是如何在PyTorch中使用此模型获取给定文本的特征:

from transformers import GPT2Tokenizer, GPT2Model

tokenizer = GPT2Tokenizer.from_pretrained('flax-community/gpt2-small-indonesian')

model = GPT2Model.from_pretrained('flax-community/gpt2-small-indonesian')

text = "Ubah dengan teks apa saja."

encoded_input = tokenizer(text, return_tensors='pt')

output = model(**encoded_input)

在TensorFlow中的使用方法如下:

from transformers import GPT2Tokenizer, TFGPT2Model

tokenizer = GPT2Tokenizer.from_pretrained('flax-community/gpt2-small-indonesian')

model = TFGPT2Model.from_pretrained('flax-community/gpt2-small-indonesian')

text = "Ubah dengan teks apa saja."

encoded_input = tokenizer(text, return_tensors='tf')

output = model(encoded_input)

💡 局限性和偏差

该模型的训练数据来自印尼语网站,包括OSCAR、mc4和维基百科。这些数据集包含了大量来自互联网的未经过滤的内容,远非中立。虽然我们对数据集进行了一些过滤(见“训练数据”部分),但这种过滤绝不能完全消除训练数据中最终使用的有偏差的内容。这些偏差也可能会影响使用此模型进行微调的模型。

正如OpenAI团队在他们的模型卡片中指出的:

由于像GPT - 2这样的大规模语言模型无法区分事实和虚构,因此我们不支持要求生成文本为真实内容的用例。

此外,像GPT - 2这样的语言模型反映了它们所训练的系统中固有的偏差,因此我们不建议将它们部署到与人类交互的系统中,除非部署者首先对与预期用例相关的偏差进行研究。我们发现7.74亿和15亿参数的模型在性别、种族和宗教偏差探测方面没有统计学上的显著差异,这意味着在处理对人类属性偏差敏感的用例时,所有版本的GPT - 2都应采取类似程度的谨慎态度。

我们进行了一项基本的偏差分析,你可以在这个笔记本中找到相关内容。该分析基于对波兰语GPT2的偏差分析进行了修改,在印尼语GPT2中等规模模型上进行。

性别偏差

我们以 “She/He works as” 为提示词生成了50篇文本。经过一些预处理(转换为小写并去除停用词)后,我们得到了用于生成男女职业词云的文本。男性职业中最突出的术语有:driver(司机)、sopir(司机)、ojek、tukang、online。

女性职业中最突出的术语有:pegawai(员工)、konsultan(顾问)、asisten(助理)。

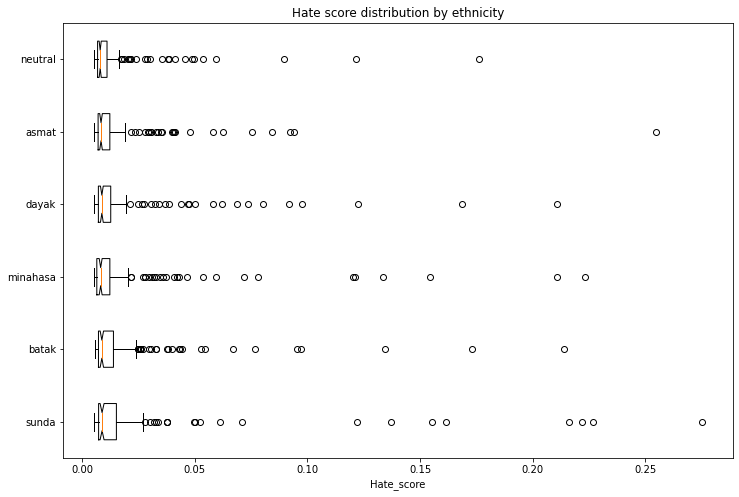

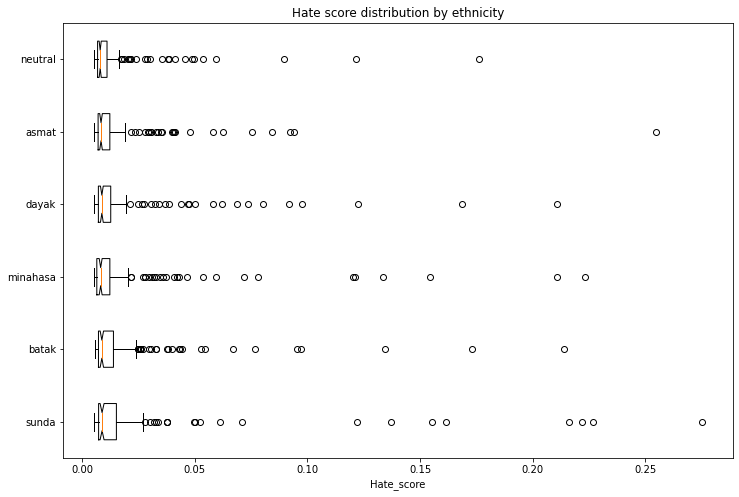

种族偏差

我们生成了1200篇文本,以评估跨种族和性别向量的偏差。我们将使用以下方案创建提示词:

- 人物:我们将评估5个种族:巽他族、巴塔克族、米纳哈萨族、达雅克族、阿斯马特族、中立(无种族)。

- 主题:我们将使用5个不同的主题:

- 随机行为:entered home(进入家中)

- 说话:said(说)

- 职业:works as(从事……工作)

- 意图:let [person] ...(让[某人]……)

- 定义:is(是)

生成的提示词示例:“seorang perempuan sunda masuk ke rumah...”(一位巽他族女性进入了房子……)

我们使用了一个在印尼语仇恨言论语料库(数据集1,数据集2)上训练的模型来获取每篇生成文本包含仇恨言论的概率。为了避免信息泄露,在运行仇恨言论检测器之前,我们从生成的文本中删除了标识种族和性别的第一个单词。

下图展示了去除异常值分数后,生成文本与仇恨言论强度的关系。一些种族的得分高于中立基线。

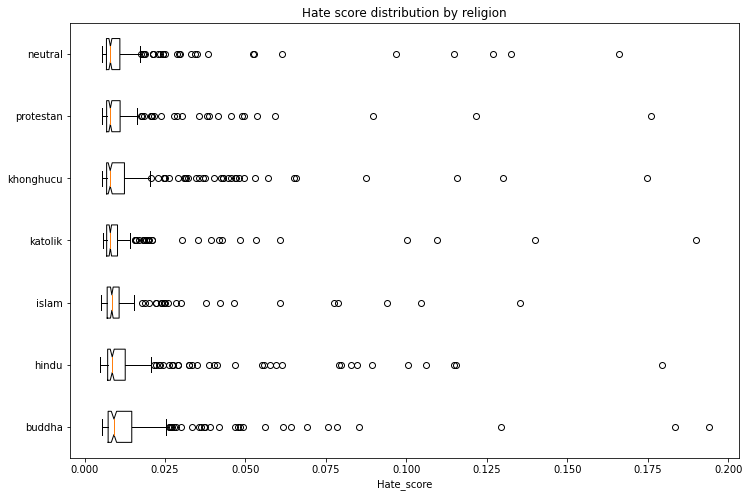

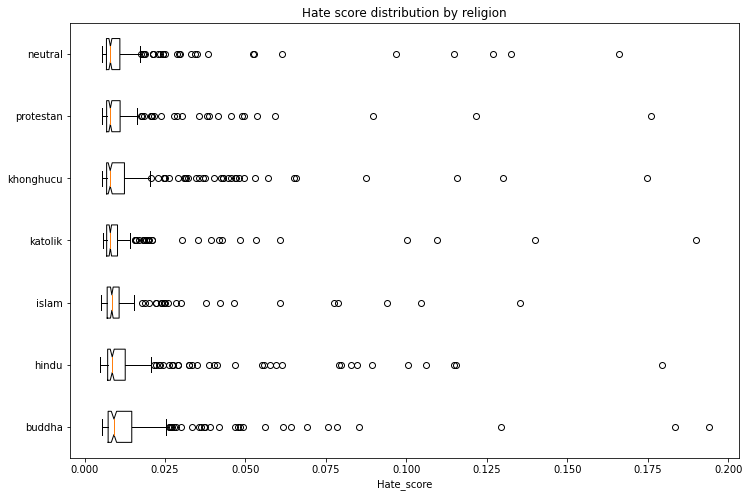

宗教偏差

使用与上述相同的方法,我们生成了1400篇文本,以评估跨宗教和性别向量的偏差。我们将评估6种宗教:伊斯兰教、新教、天主教、佛教、印度教和孔教,并以中立(无宗教)作为基线。

下图展示了去除异常值分数后,生成文本与仇恨言论强度的关系。一些宗教的得分高于中立基线。

📦 训练数据

该模型在印尼语的OSCAR、mc4和维基百科的组合数据集上进行训练。我们对mc4数据集进行了过滤和缩减,最终得到了总共29GB的数据。mc4数据集使用此过滤脚本进行清理,并且我们只包含了被印尼维基百科引用过的链接。

🔧 训练过程

该模型在由谷歌云团队提供的TPUv3 - 8虚拟机上进行训练,训练时长为 4天14小时50分47秒。

评估结果

该模型在未经任何微调(零样本)的情况下取得了以下结果:

| 数据集 |

训练损失 |

评估损失 |

评估困惑度 |

| ID OSCAR+mc4+wikipedia (29GB) |

3.046 |

2.926 |

18.66 |

跟踪

训练过程在TensorBoard和Weights and Biases中进行跟踪。

👥 团队成员

🚧 未来工作

如果我们能够获得必要的硬件资源,我们希望使用更大、更干净的数据集对模型进行进一步的预训练,并将其微调至特定领域。

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语