🚀 Data2Vec-Vision(基础大小模型,仅预训练)

Data2Vec-Vision 是一个基于 BEiT 架构的模型,在 ImageNet-1k 数据集上进行自监督预训练。该模型可用于图像分类任务,为相关领域的研究和应用提供了有力支持。

🚀 快速开始

你可以使用这个原始模型进行图像分类。若想寻找针对特定任务的微调版本,可查看 模型中心。

✨ 主要特性

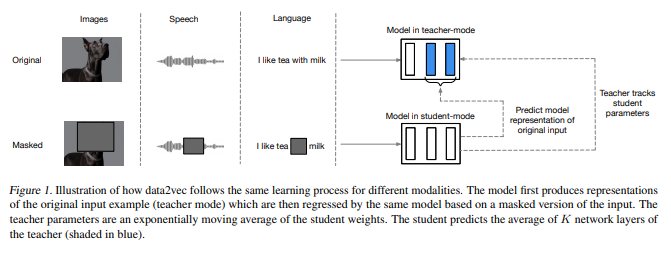

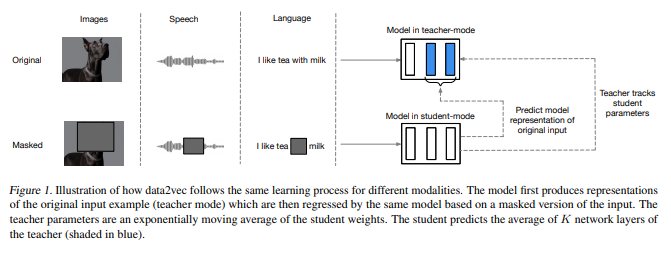

- 跨模态通用性:data2vec 框架使用相同的学习方法应用于语音、自然语言处理或计算机视觉领域。

- 自蒸馏学习:通过自蒸馏设置,基于输入的掩码视图预测完整输入数据的潜在表示。

- 上下文潜在表示:预测包含整个输入信息的上下文潜在表示,而非特定模态的局部目标。

📚 详细文档

预训练方法

更多信息请查看 官方论文。

更多信息请查看 官方论文。

摘要

虽然自监督学习的总体思想在不同模态之间是相同的,但实际的算法和目标却大相径庭,因为它们是针对单一模态开发的。为了更接近通用的自监督学习,我们提出了 data2vec 框架,该框架对语音、自然语言处理或计算机视觉使用相同的学习方法。其核心思想是在使用标准 Transformer 架构的自蒸馏设置中,基于输入的掩码视图预测完整输入数据的潜在表示。与预测本质上是局部的特定模态目标(如单词、视觉标记或人类语音单元)不同,data2vec 预测包含整个输入信息的上下文潜在表示。在语音识别、图像分类和自然语言理解的主要基准测试上的实验表明,该方法达到了新的技术水平,或与主流方法具有竞争力。

预期用途和限制

你可以使用原始模型进行图像分类。查看 模型中心 以寻找针对你感兴趣任务的微调版本。

训练数据

BEiT 模型在 ImageNet-1k 数据集上进行预训练,该数据集包含 120 万张图像和 1000 个类别。

训练过程

预处理

训练/验证期间图像预处理的确切细节可在 此处 找到。

图像被调整大小/重新缩放至相同分辨率(224x224),并在 RGB 通道上进行归一化,均值为 (0.5, 0.5, 0.5),标准差为 (0.5, 0.5, 0.5)。

预训练

所有与预训练相关的超参数,请参考 原始论文 和 原始代码库。

评估结果

关于几个图像分类基准的评估结果,请参考原始论文的表 1。请注意,对于微调,使用更高分辨率可获得最佳结果。当然,增加模型大小会提高性能。

BibTeX 引用和引用信息

@misc{https://doi.org/10.48550/arxiv.2202.03555,

doi = {10.48550/ARXIV.2202.03555},

url = {https://arxiv.org/abs/2202.03555},

author = {Baevski, Alexei and Hsu, Wei-Ning and Xu, Qiantong and Babu, Arun and Gu, Jiatao and Auli, Michael},

keywords = {Machine Learning (cs.LG), FOS: Computer and information sciences, FOS: Computer and information sciences},

title = {data2vec: A General Framework for Self-supervised Learning in Speech, Vision and Language},

publisher = {arXiv},

year = {2022},

copyright = {arXiv.org perpetual, non-exclusive license}

}

📄 许可证

本项目采用 Apache-2.0 许可证。

📦 信息表格

| 属性 |

详情 |

| 模型类型 |

用于图像分类的预训练 BEiT 模型 |

| 训练数据 |

ImageNet-1k 数据集,包含 120 万张图像和 1000 个类别 |

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语 更多信息请查看

更多信息请查看