🚀 動漫角色文本到圖像生成模型

該模型專注於動漫角色的圖像生成,基於特定動漫角色訓練,能根據文本提示生成對應風格的動漫圖像,為動漫藝術創作和相關應用提供了強大的支持。

🚀 快速開始

此模型以擴散器(diffuser)和安全張量(safetensors)兩種格式共享。觸發詞方面,六個角色可以使用 OyamaMahiro、OyamaMihari、HozukiKaede、HozukiMomiji、OkaAsahi 和 MurosakiMiyo 進行提示。TenkawaNayuta 雖有標籤,但她出現在少於 10 張圖像中,因此不要期望有好的生成效果。模型還訓練了三種不同風格:aniscreen、edstyle 和 megazine。通常可以生成多角色圖像,但從 4 個角色開始就比較困難了。另外,該模型在剪輯跳過(clip skip)為 1 的情況下訓練。

✨ 主要特性

- 角色精準生成:基於《別當歐尼醬了!》(お兄ちゃんはおしまい!)中的 6(+1?)個角色進行訓練,能精準生成對應角色的圖像。

- 多風格支持:模型訓練了

aniscreen、edstyle 和 megazine 三種不同風格,滿足多樣化的創作需求。

- 雙格式共享:以擴散器(diffuser)和安全張量(safetensors)兩種格式共享,方便不同用戶使用。

💻 使用示例

基礎用法

使用觸發詞生成對應角色圖像,例如:

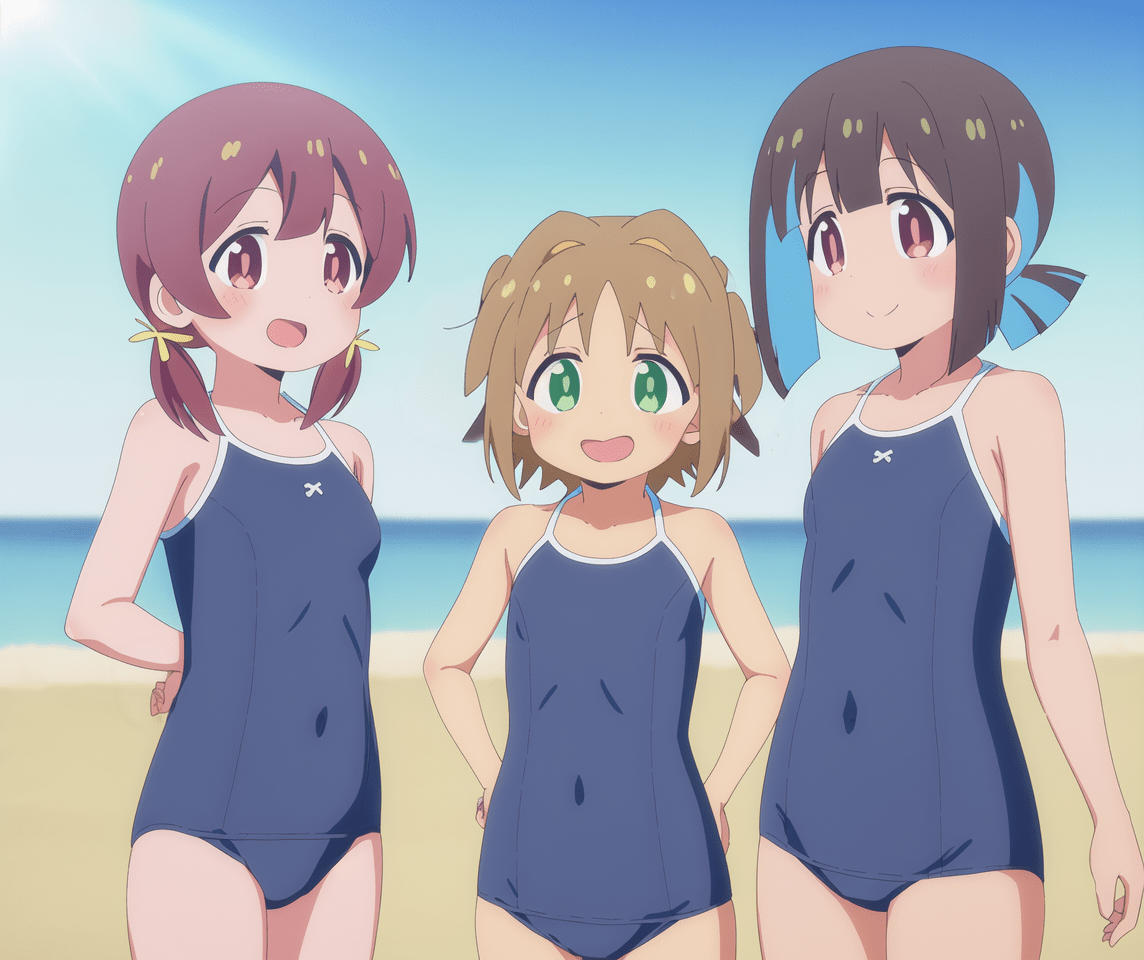

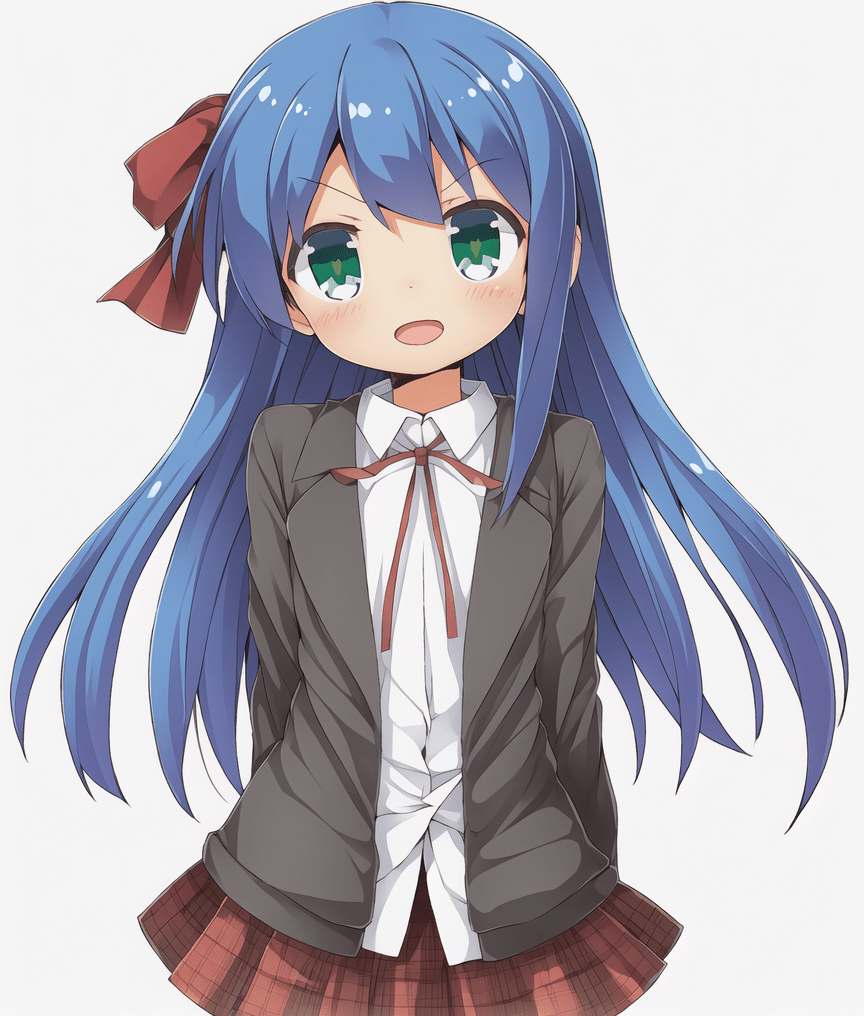

提示詞:OyamaMahiro, aniscreen style

高級用法

組合多個觸發詞和風格,生成多角色、多風格的複雜圖像,例如:

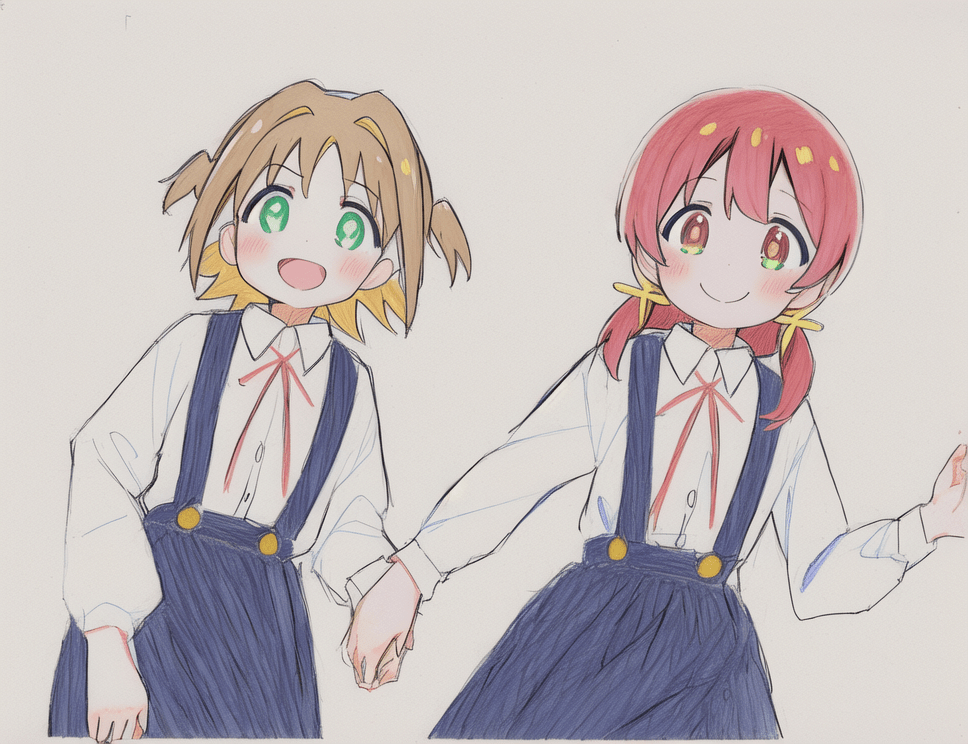

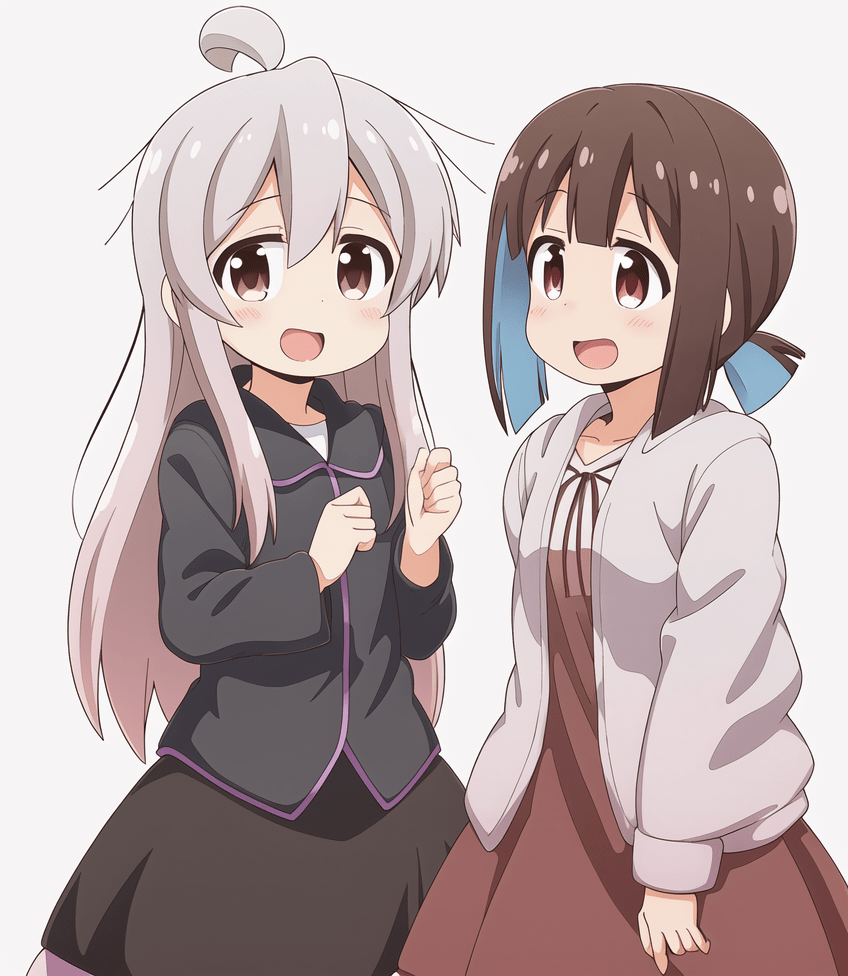

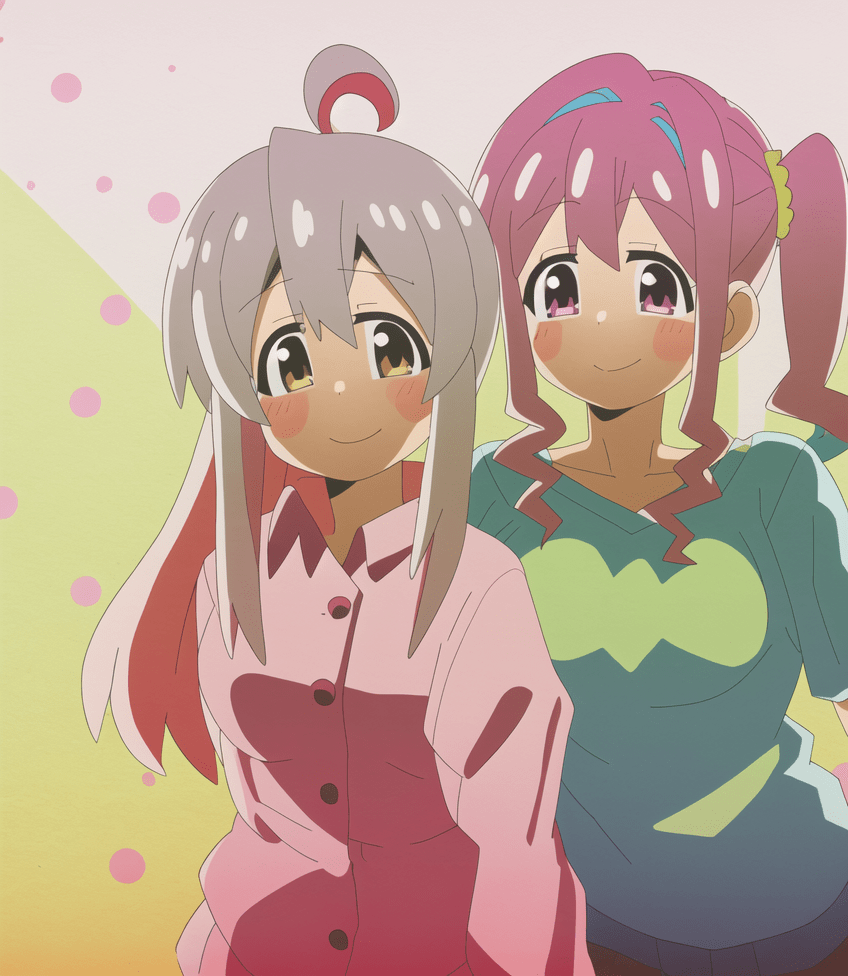

提示詞:OyamaMahiro, HozukiKaede, edstyle

📚 詳細文檔

更新記錄 -- 2023.02.19

在 loras 子文件夾中添加了兩個使用相同數據集訓練的 LoRA 檢查點。第一個似乎已經可以使用,模型學習到了角色特徵,但遺憾的是沒有學習到風格和服裝特徵。該 LoRA 基於 ACertainty 進行訓練,在 Orange 和 Anything 模型上效果良好,但在如 MyneFactoryBase 或作者自己的模型等進一步訓練的模型上效果不太好。作者仍未弄清楚 LoRA 何時能正確遷移。

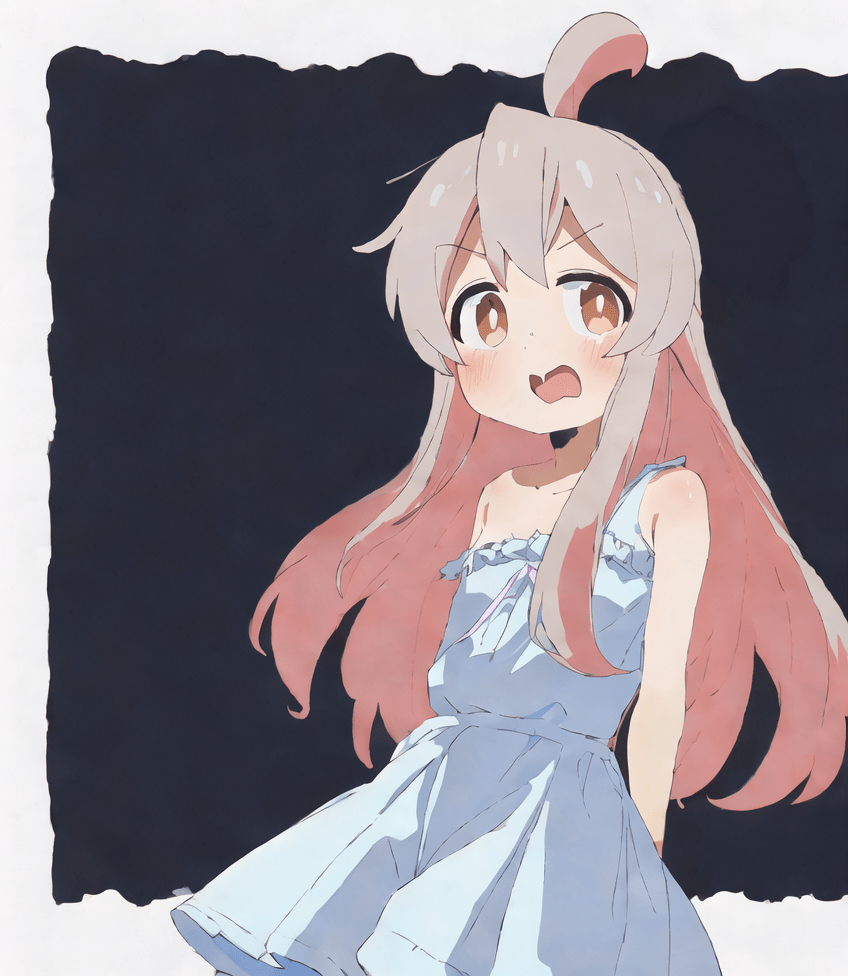

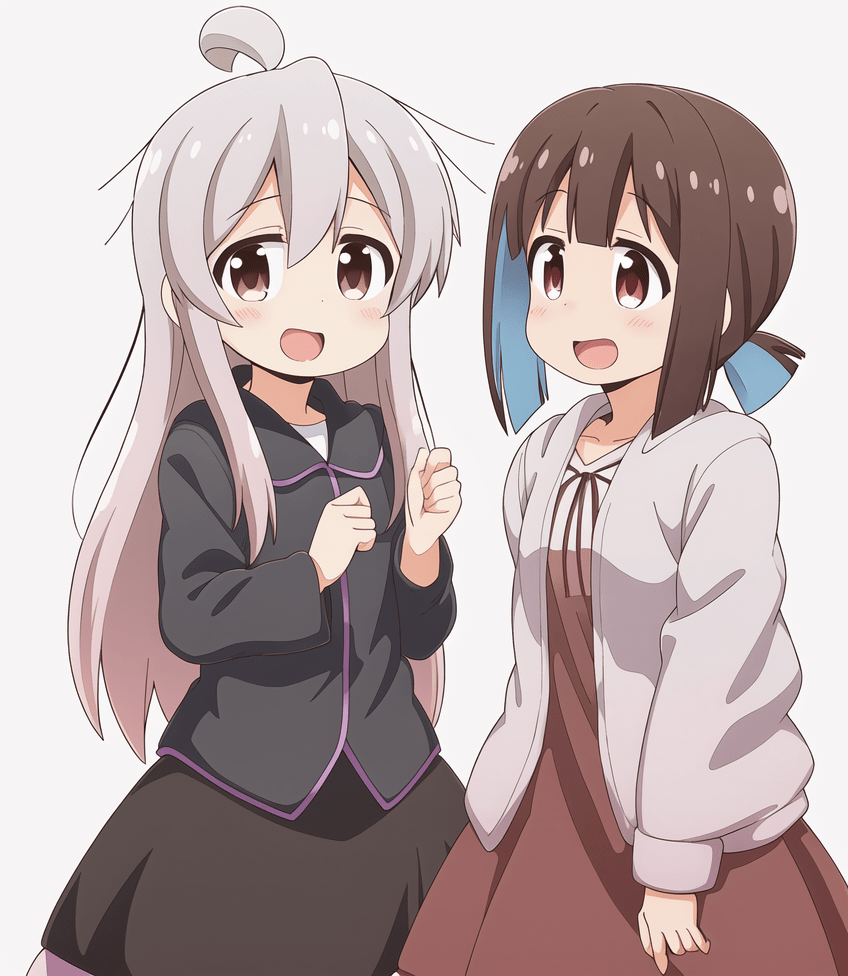

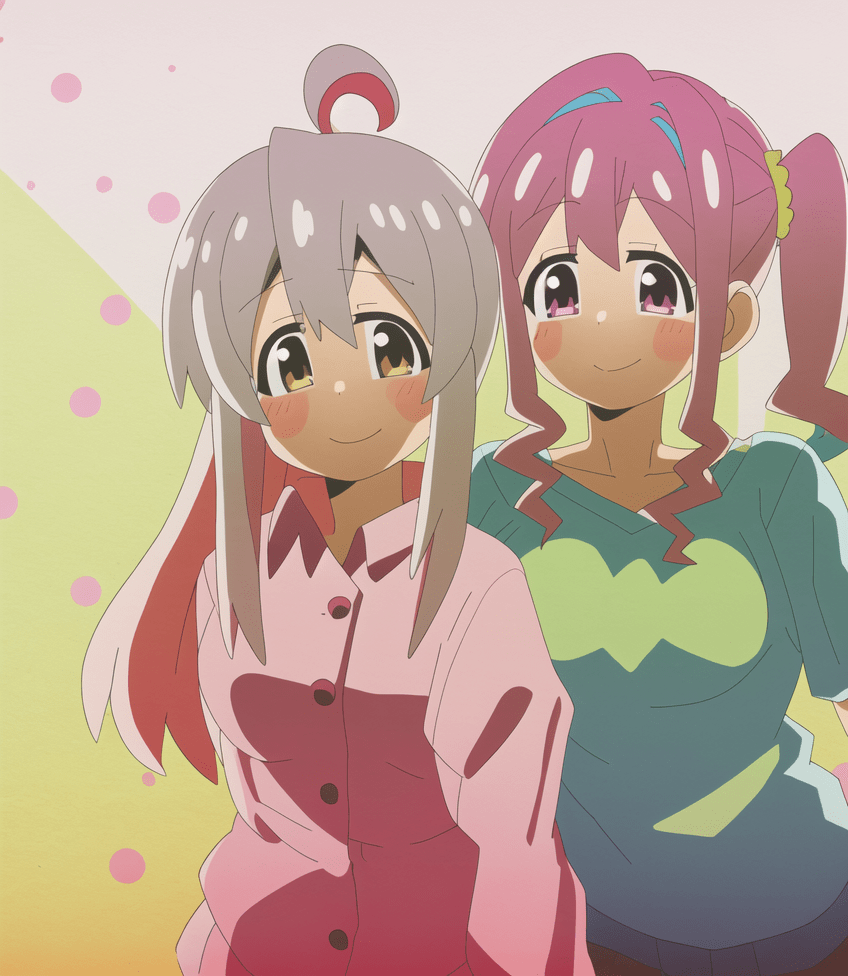

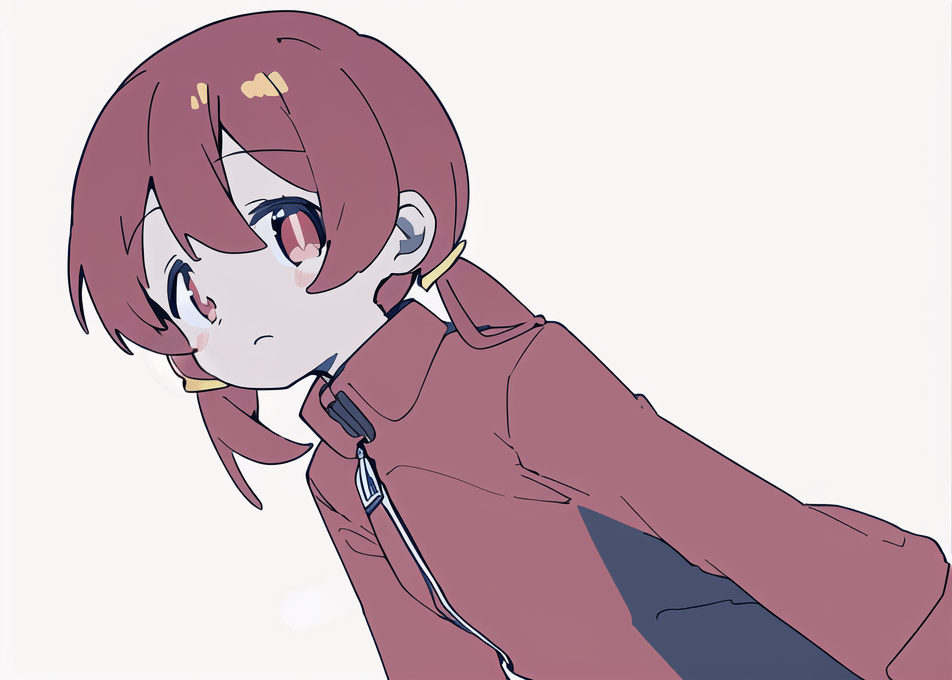

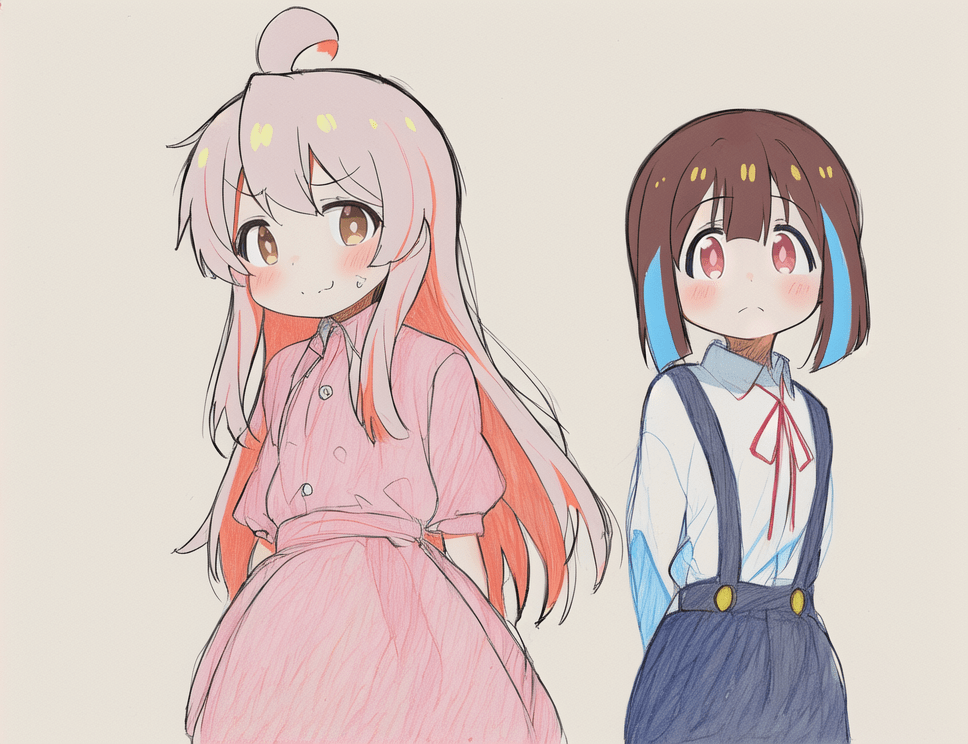

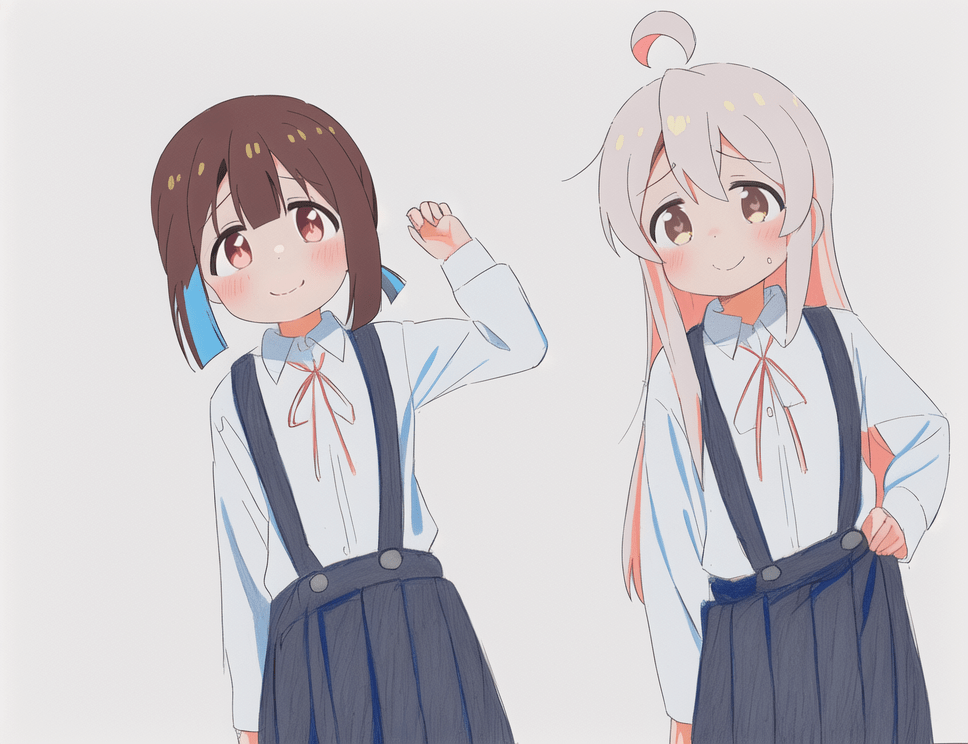

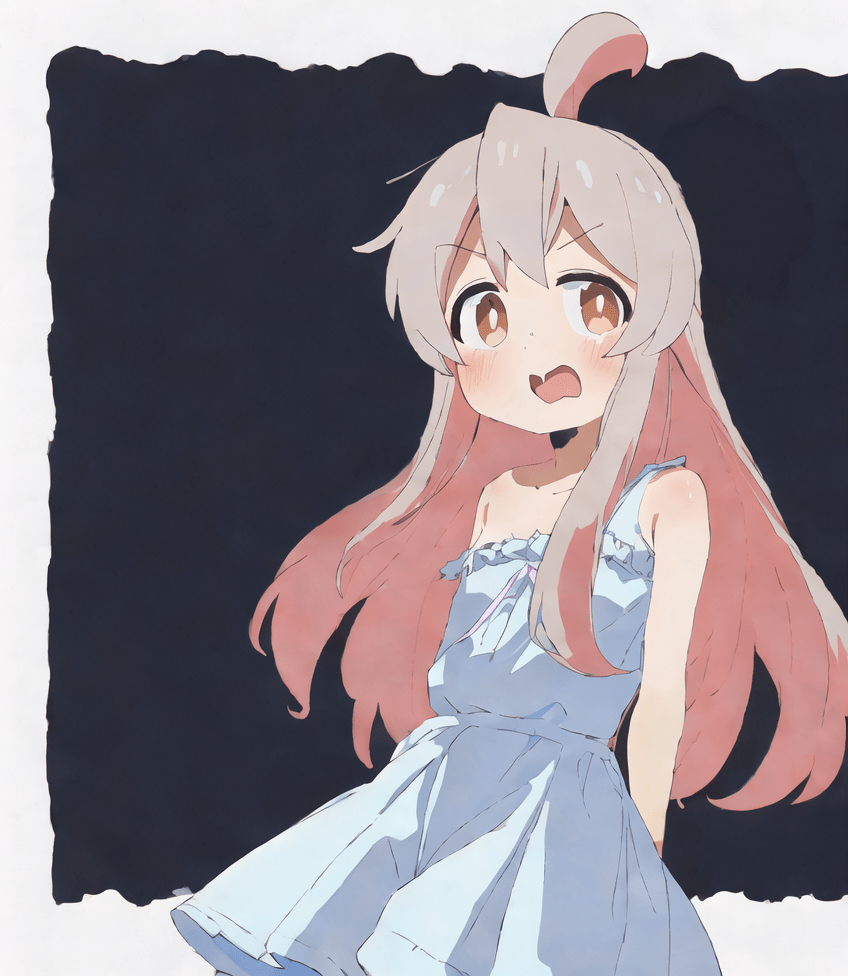

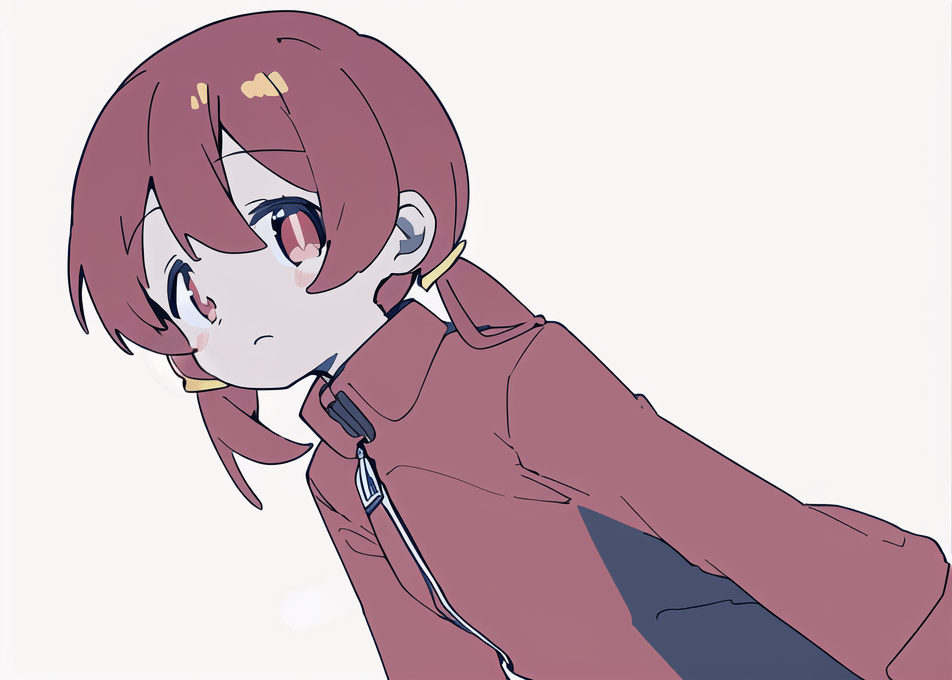

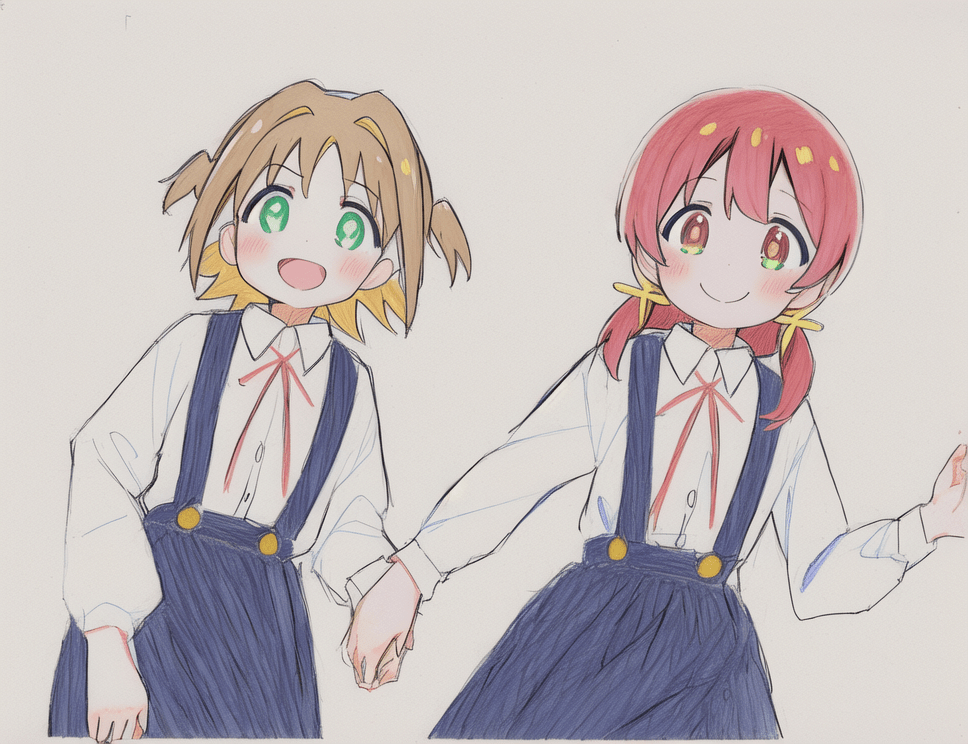

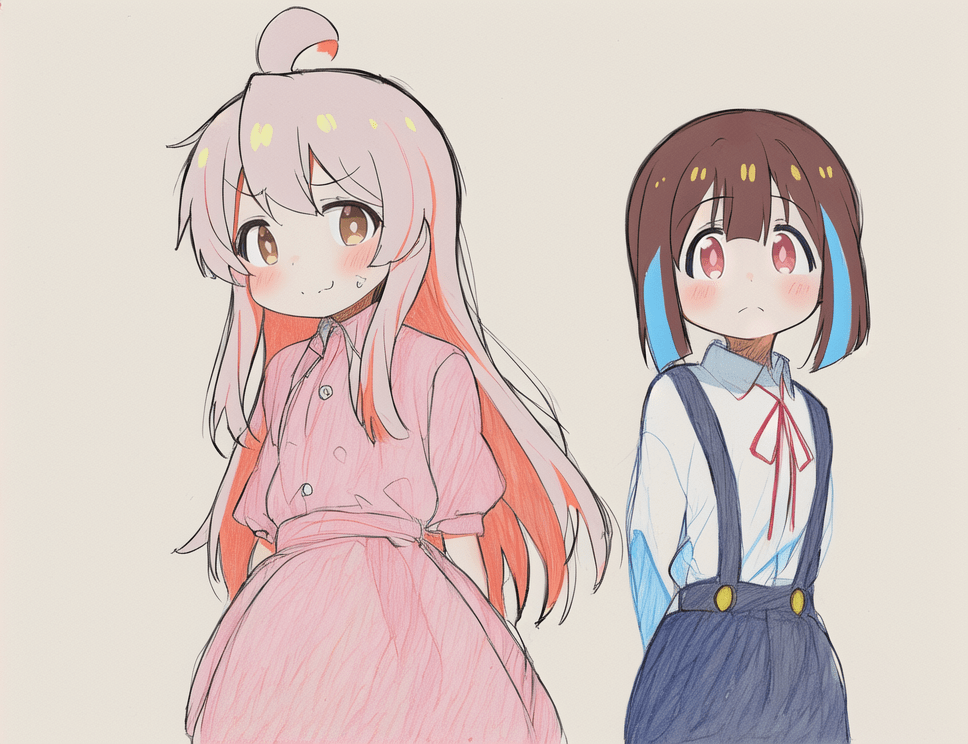

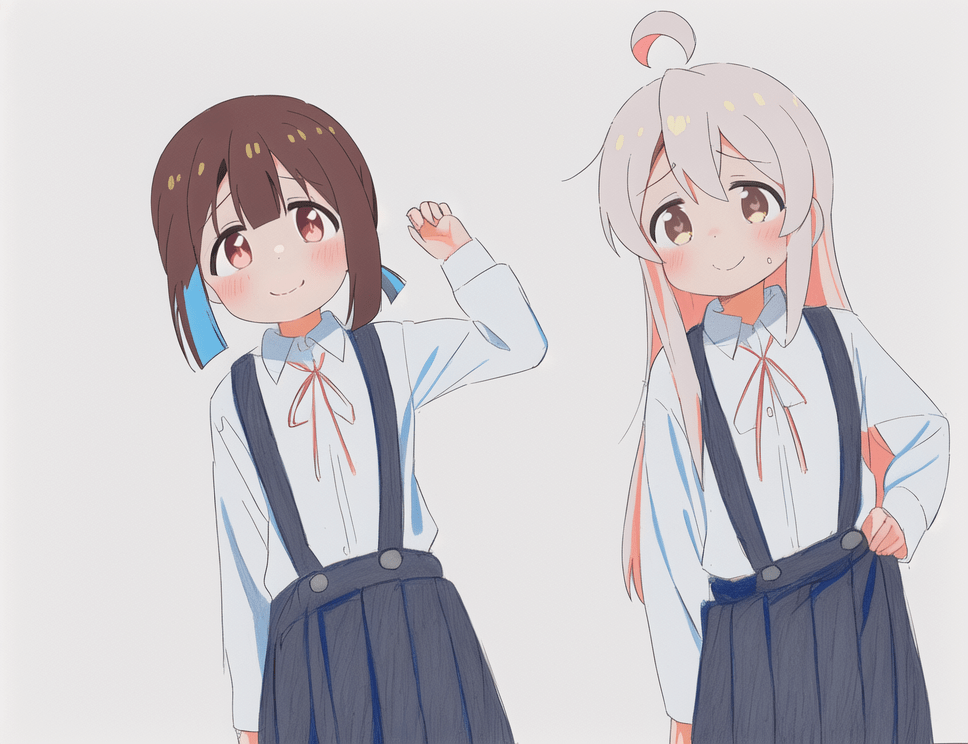

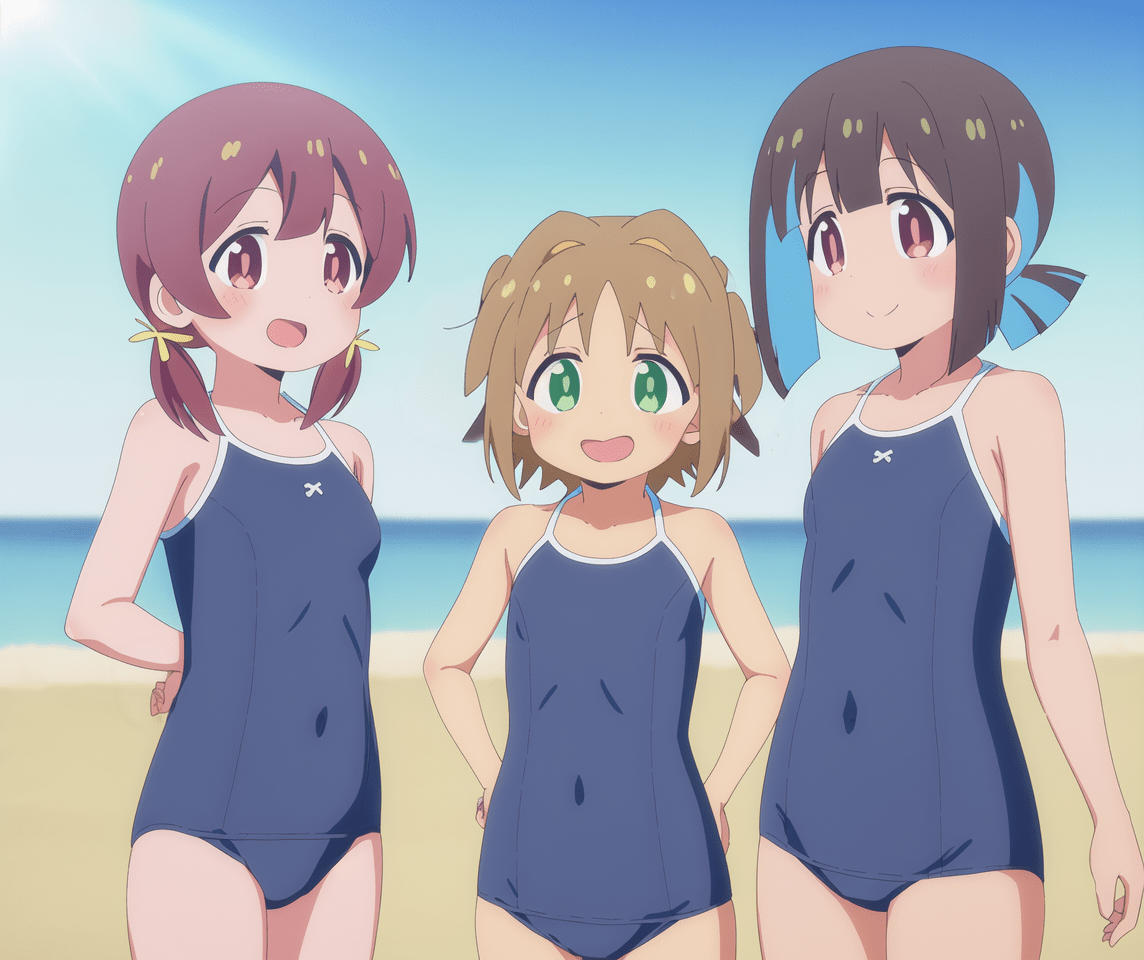

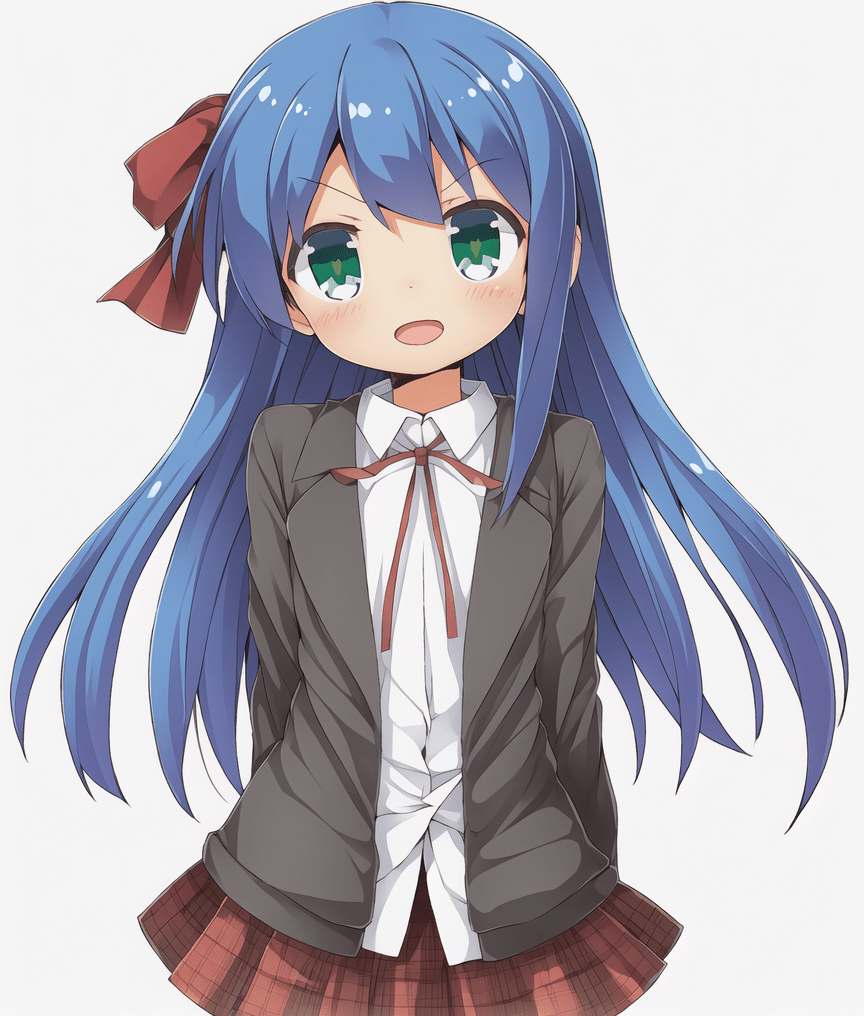

LoRA 的維度為 32,alpha 為 1,學習率為 1e-4。以下是一些生成示例:

提示:如果需要更復雜的場景,或者對風格和服裝有更高的保真度要求,建議使用完整模型。也可以通過合併模型來改變風格。

更多生成示例

數據集描述

數據集通過此工作流準備:https://github.com/cyber-meow/anime_screenshot_pipeline 。它包含 21412 張圖像,組成如下:

- 2133 張《別當歐尼醬了!》相關圖像,分為四種類型:

- 1496 張來自前六集的動漫截圖(對應

aniscreen 風格)

- 70 張動漫結尾截圖(對應

edstyle 風格,不包含在上述 1496 張中)

- 528 張粉絲畫作(或可能是一些官方畫作)

- 39 張漫畫封面掃描圖(對應

megazine 風格,不要問為什麼選這個名字,雖然不好但效果不錯)

- 19279 張正則化圖像,旨在儘可能多樣化,同時保持動漫風格(即不使用寫實照片)

注意,模型使用特定的加權方案進行訓練,以平衡不同概念,因此每張圖像的權重並不相等。應用每圖像重複後,每個 epoch 大約有 145K 張圖像。

訓練信息

使用 EveryDream2 訓練器,以 ACertainty 為基礎模型進行訓練,使用以下配置:

- 分辨率 512

- 餘弦學習率調度器,學習率 2.5e - 6

- 批量大小 8

- 條件丟棄率 0.08

- 在模型調度器的

config.json 中將 beta 調度器從 scaler_linear 更改為 linear

- 剪輯跳過 1

作者訓練了兩個 epoch,而默認發佈模型如上述所提到的訓練了 22828 步。

🔧 技術細節

模型訓練

模型基於特定的動漫角色數據集進行訓練,使用了特定的加權方案來平衡不同概念,確保每個角色和風格都能得到適當的學習。訓練過程中採用了餘弦學習率調度器和條件丟棄率等技術,以提高模型的泛化能力。

數據集處理

數據集包含動漫截圖、粉絲畫作、漫畫封面掃描圖和正則化圖像等多種類型,通過特定的工作流進行準備。在訓練時,對圖像進行了每圖像重複處理,以增加每個 epoch 的訓練數據量。

📄 許可證

本模型採用 CreativeML OpenRAIL - M 許可證。

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語