🚀 NAT (基礎變體)

NAT(Neighborhood Attention Transformer)是一種基於鄰域注意力機制的分層視覺變換器模型。該模型在 ImageNet-1K 數據集上以 224x224 分辨率進行訓練,可用於圖像分類任務。

🚀 快速開始

你可以使用原始模型進行圖像分類。你可以在 模型中心 中查找針對你感興趣的任務進行微調的版本。

以下是如何使用此模型將來自 COCO 2017 數據集的圖像分類為 1000 個 ImageNet 類別之一的示例:

from transformers import AutoImageProcessor, NatForImageClassification

from PIL import Image

import requests

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

feature_extractor = AutoImageProcessor.from_pretrained("shi-labs/nat-base-in1k-224")

model = NatForImageClassification.from_pretrained("shi-labs/nat-base-in1k-224")

inputs = feature_extractor(images=image, return_tensors="pt")

outputs = model(**inputs)

logits = outputs.logits

predicted_class_idx = logits.argmax(-1).item()

print("Predicted class:", model.config.id2label[predicted_class_idx])

更多示例請參考 文檔。

✨ 主要特性

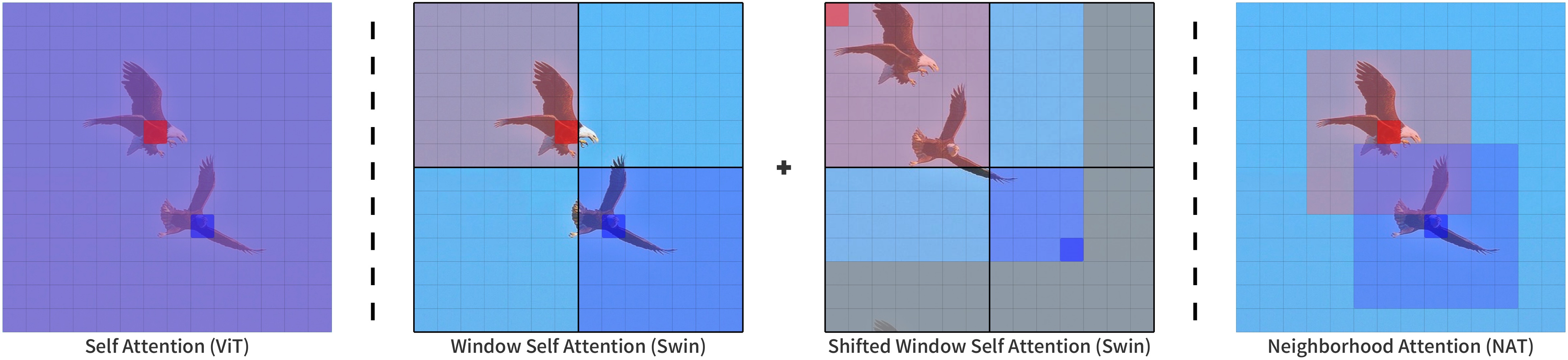

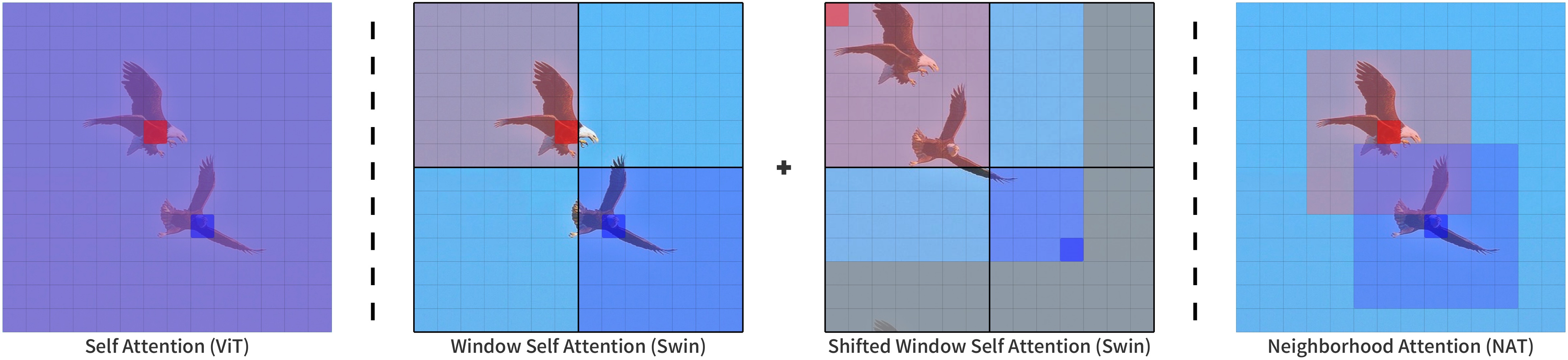

- 分層視覺變換器:NAT 是基於鄰域注意力(NA)的分層視覺變換器。

- 鄰域注意力機制:鄰域注意力是一種受限的自注意力模式,其中每個標記的感受野僅限於其最近的相鄰像素。

- 滑動窗口注意力模式:NA 是一種滑動窗口注意力模式,因此具有高度的靈活性並保持平移等變性。

- PyTorch 實現:NA 通過其擴展 NATTEN 在 PyTorch 中實現。

📚 詳細文檔

模型描述

NAT 是基於鄰域注意力(NA)的分層視覺變換器。鄰域注意力是一種受限的自注意力模式,其中每個標記的感受野僅限於其最近的相鄰像素。NA 是一種滑動窗口注意力模式,因此具有高度的靈活性並保持平移等變性。

NA 通過其擴展 NATTEN 在 PyTorch 中實現。

來源

預期用途和限制

你可以使用原始模型進行圖像分類。你可以在 模型中心 中查找針對你感興趣的任務進行微調的版本。

要求

除了 transformers 之外,此模型還需要 NATTEN 包。

如果你使用的是 Linux 系統,可以參考 shi-labs.com/natten 上的說明,使用預編譯的二進制文件進行安裝(只需選擇你的 PyTorch 版本以獲取正確的 wheel URL)。

你也可以使用 pip install natten 在你的設備上進行編譯,這可能需要幾分鐘時間。Mac 用戶只能使用後一種方法(沒有預編譯的二進制文件)。

更多信息請參考 NATTEN 的 GitHub。

BibTeX 引用和引用信息

@article{hassani2022neighborhood,

title = {Neighborhood Attention Transformer},

author = {Ali Hassani and Steven Walton and Jiachen Li and Shen Li and Humphrey Shi},

year = 2022,

url = {https://arxiv.org/abs/2204.07143},

eprint = {2204.07143},

archiveprefix = {arXiv},

primaryclass = {cs.CV}

}

📄 許可證

本項目採用 MIT 許可證。

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語