🚀 T2I-Adapter-SDXL - Depth-MiDaS

T2I Adapter是一個為穩定擴散模型提供額外條件控制的網絡。每個T2I檢查點接收不同類型的條件作為輸入,並與特定的基礎穩定擴散檢查點配合使用。

本檢查點為StableDiffusionXL檢查點提供深度條件控制。這是騰訊ARC實驗室與 Hugging Face 合作的成果。

✨ 主要特性

- 為StableDiffusionXL模型提供深度條件控制,增強圖像生成的可控性。

- 與多種類型的控制圖像兼容,支持不同的圖像生成場景。

📦 安裝指南

要開始使用,首先安裝所需的依賴項:

pip install -U git+https://github.com/huggingface/diffusers.git

pip install -U controlnet_aux==0.0.7

pip install transformers accelerate safetensors

💻 使用示例

基礎用法

from diffusers import StableDiffusionXLAdapterPipeline, T2IAdapter, EulerAncestralDiscreteScheduler, AutoencoderKL

from diffusers.utils import load_image, make_image_grid

from controlnet_aux.midas import MidasDetector

import torch

adapter = T2IAdapter.from_pretrained(

"TencentARC/t2i-adapter-depth-midas-sdxl-1.0", torch_dtype=torch.float16, varient="fp16"

).to("cuda")

model_id = 'stabilityai/stable-diffusion-xl-base-1.0'

euler_a = EulerAncestralDiscreteScheduler.from_pretrained(model_id, subfolder="scheduler")

vae=AutoencoderKL.from_pretrained("madebyollin/sdxl-vae-fp16-fix", torch_dtype=torch.float16)

pipe = StableDiffusionXLAdapterPipeline.from_pretrained(

model_id, vae=vae, adapter=adapter, scheduler=euler_a, torch_dtype=torch.float16, variant="fp16",

).to("cuda")

pipe.enable_xformers_memory_efficient_attention()

midas_depth = MidasDetector.from_pretrained(

"valhalla/t2iadapter-aux-models", filename="dpt_large_384.pt", model_type="dpt_large"

).to("cuda")

高級用法

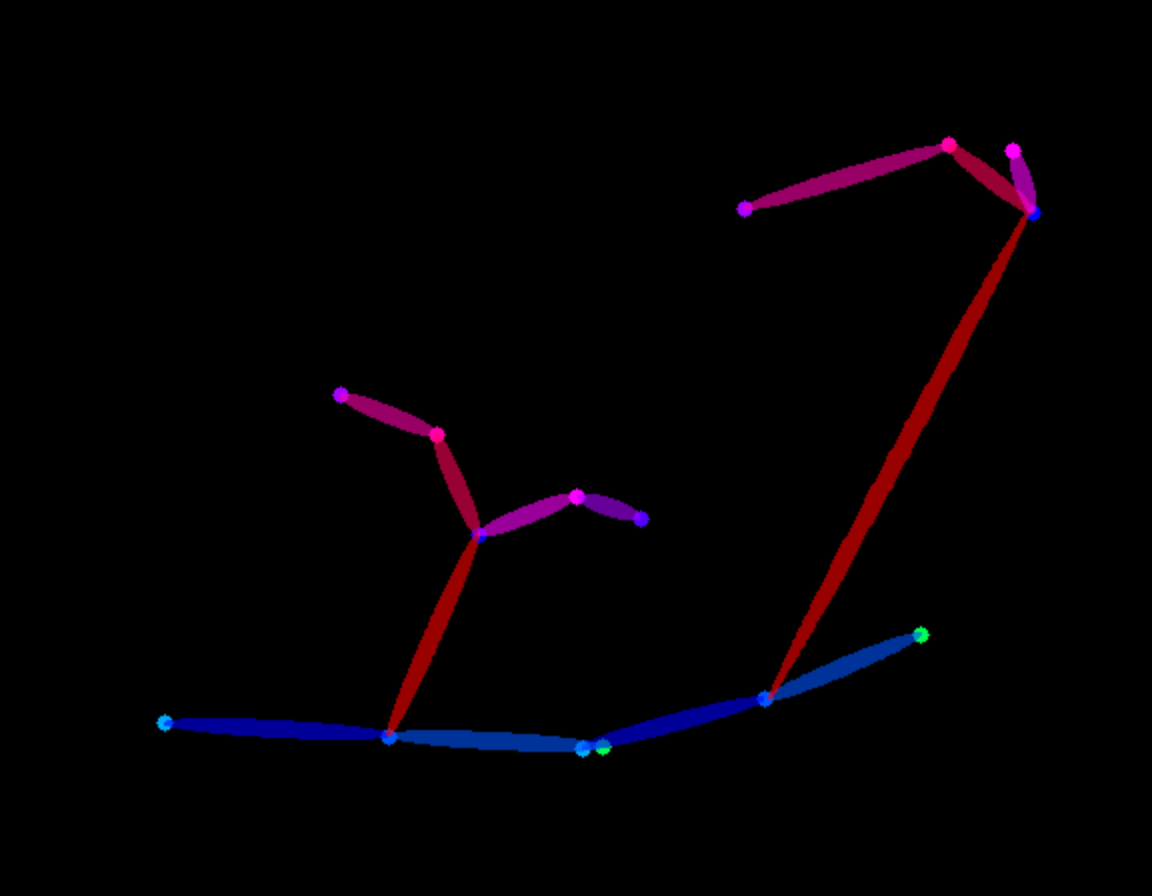

url = "https://huggingface.co/Adapter/t2iadapter/resolve/main/figs_SDXLV1.0/org_mid.jpg"

image = load_image(url)

image = midas_depth(

image, detect_resolution=512, image_resolution=1024

)

prompt = "A photo of a room, 4k photo, highly detailed"

negative_prompt = "anime, cartoon, graphic, text, painting, crayon, graphite, abstract, glitch, deformed, mutated, ugly, disfigured"

gen_images = pipe(

prompt=prompt,

negative_prompt=negative_prompt,

image=image,

num_inference_steps=30,

adapter_conditioning_scale=1,

guidance_scale=7.5,

).images[0]

gen_images.save('out_mid.png')

📚 詳細文檔

模型詳情

| 屬性 |

詳情 |

| 開發者 |

T2I-Adapter: Learning Adapters to Dig out More Controllable Ability for Text-to-Image Diffusion Models |

| 模型類型 |

基於擴散的文本到圖像生成模型 |

| 語言 |

英語 |

| 許可證 |

Apache 2.0 |

| 更多信息資源 |

GitHub倉庫,論文 |

| 模型複雜度 |

| SD-V1.4/1.5 | SD-XL | T2I-Adapter | T2I-Adapter-SDXL | | 參數數量 | 8.6億 | 26億 | 7700萬 | 7700萬/7900萬 |

|

| 引用格式 |

@misc{

title={T2I-Adapter: Learning Adapters to Dig out More Controllable Ability for Text-to-Image Diffusion Models},

author={Chong Mou, Xintao Wang, Liangbin Xie, Yanze Wu, Jian Zhang, Zhongang Qi, Ying Shan, Xiaohu Qie},

year={2023},

eprint={2302.08453},

archivePrefix={arXiv},

primaryClass={cs.CV}

} |

檢查點

訓練信息

我們的訓練腳本基於官方提供的訓練腳本構建,可參考 此處。

模型在LAION-Aesthetics V2的300萬高分辨率圖像 - 文本對上進行訓練,具體訓練參數如下:

- 訓練步數:35000

- 批量大小:數據並行,單GPU批量大小為

16,總批量大小為 256。

- 學習率:恆定學習率

1e-5。

- 混合精度:fp16

🔧 技術細節

本模型基於T2I Adapter架構,通過學習適配器來挖掘文本到圖像擴散模型更多的可控能力。它為StableDiffusionXL模型提供深度條件控制,在圖像生成過程中引入深度信息,從而實現更精細的圖像生成控制。模型的訓練過程採用了特定的訓練策略和參數設置,以確保模型能夠學習到有效的特徵表示。

📄 許可證

本模型使用Apache 2.0許可證。

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語