🚀 SigLIP(基礎大小模型,多語言)

SigLIP是一種多模態模型,通過使用更好的損失函數,在圖像 - 文本預訓練任務中表現出色。它能用於零樣本圖像分類和圖像 - 文本檢索等任務,為相關領域的研究和應用提供了強大的支持。

🚀 快速開始

SigLIP是在分辨率為256x256的WebLi上進行預訓練的模型。它由Zhai等人在論文Sigmoid Loss for Language Image Pre - Training中提出,並首次在此倉庫中發佈。

聲明:發佈SigLIP的團隊並未為此模型編寫模型卡片,此模型卡片由Hugging Face團隊編寫。

✨ 主要特性

SigLIP是基於CLIP的多模態模型,採用了更優的損失函數。Sigmoid損失僅對圖像 - 文本對進行操作,無需對成對相似度進行全局歸一化。這使得在進一步擴大批量大小的同時,在小批量大小下也能有更好的表現。

一位作者對SigLIP的簡要總結可查看此處。

📚 詳細文檔

預期用途和限制

你可以使用原始模型進行零樣本圖像分類和圖像 - 文本檢索等任務。請查看模型中心,尋找你感興趣任務的其他版本模型。

如何使用

以下是如何使用此模型進行零樣本圖像分類的示例:

基礎用法

from PIL import Image

import requests

from transformers import AutoProcessor, AutoModel

import torch

model = AutoModel.from_pretrained("google/siglip-base-patch16-256-multilingual")

processor = AutoProcessor.from_pretrained("google/siglip-base-patch16-256-multilingual")

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

texts = ["a photo of 2 cats", "a photo of 2 dogs"]

inputs = processor(text=texts, images=image, padding="max_length", return_tensors="pt")

with torch.no_grad():

outputs = model(**inputs)

logits_per_image = outputs.logits_per_image

probs = torch.sigmoid(logits_per_image)

print(f"{probs[0][0]:.1%} that image 0 is '{texts[0]}'")

高級用法

from transformers import pipeline

from PIL import Image

import requests

image_classifier = pipeline(task="zero-shot-image-classification", model="google/siglip-base-patch16-256-multilingual")

url = 'http://images.cocodataset.org/val2017/000000039769.jpg'

image = Image.open(requests.get(url, stream=True).raw)

outputs = image_classifier(image, candidate_labels=["2 cats", "a plane", "a remote"])

outputs = [{"score": round(output["score"], 4), "label": output["label"] } for output in outputs]

print(outputs)

更多代碼示例,請參考文檔。

訓練過程

訓練數據

SigLIP在未進行語言過濾的WebLI數據集上進行預訓練(Chen et al., 2023)。

預處理

圖像被調整大小/重新縮放至相同分辨率(256x256),並在RGB通道上進行歸一化,均值為(0.5, 0.5, 0.5),標準差為(0.5, 0.5, 0.5)。

文本被分詞並填充至相同長度(64個標記)。

計算資源

該模型在16個TPU - v4芯片上訓練了三天。

評估結果

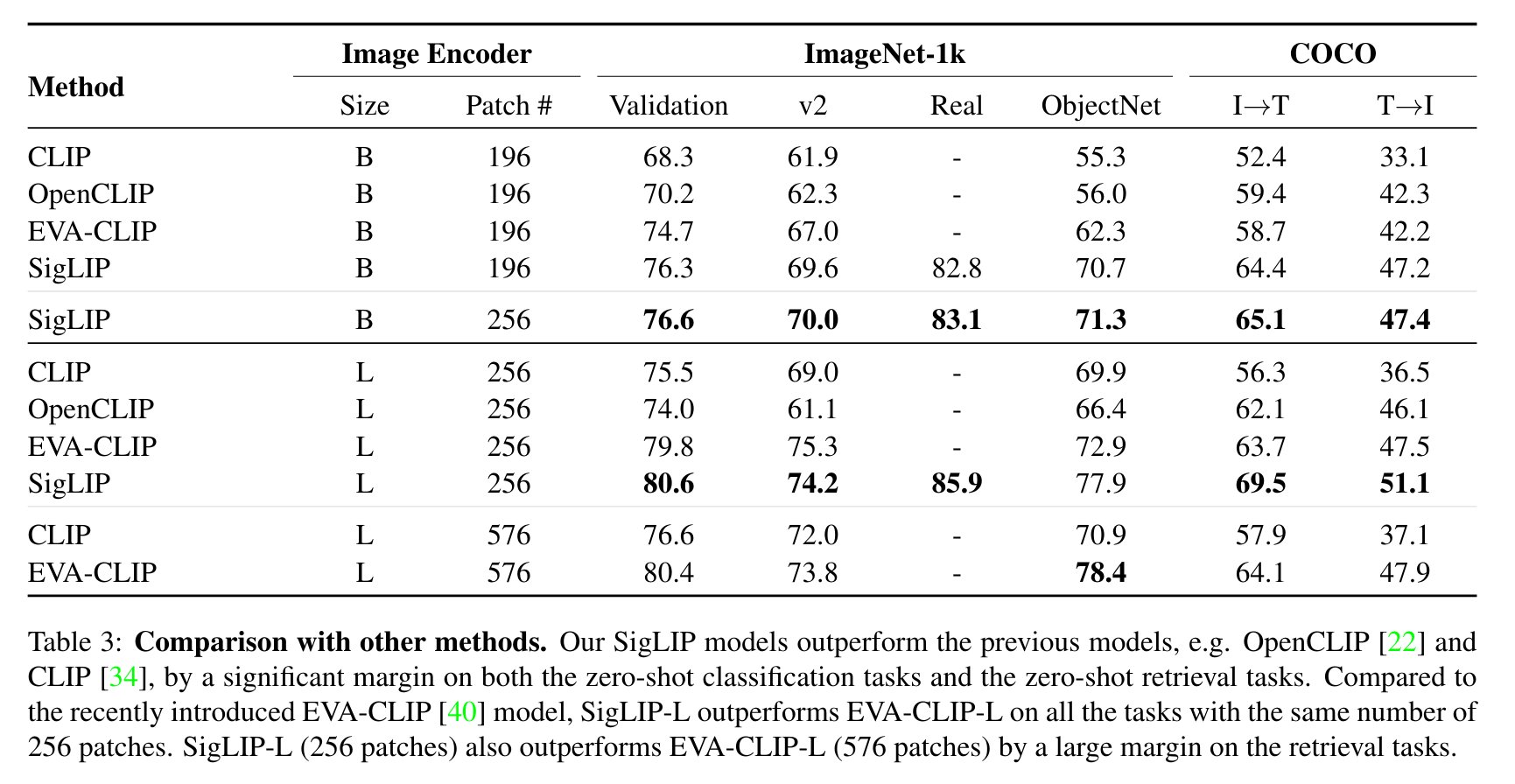

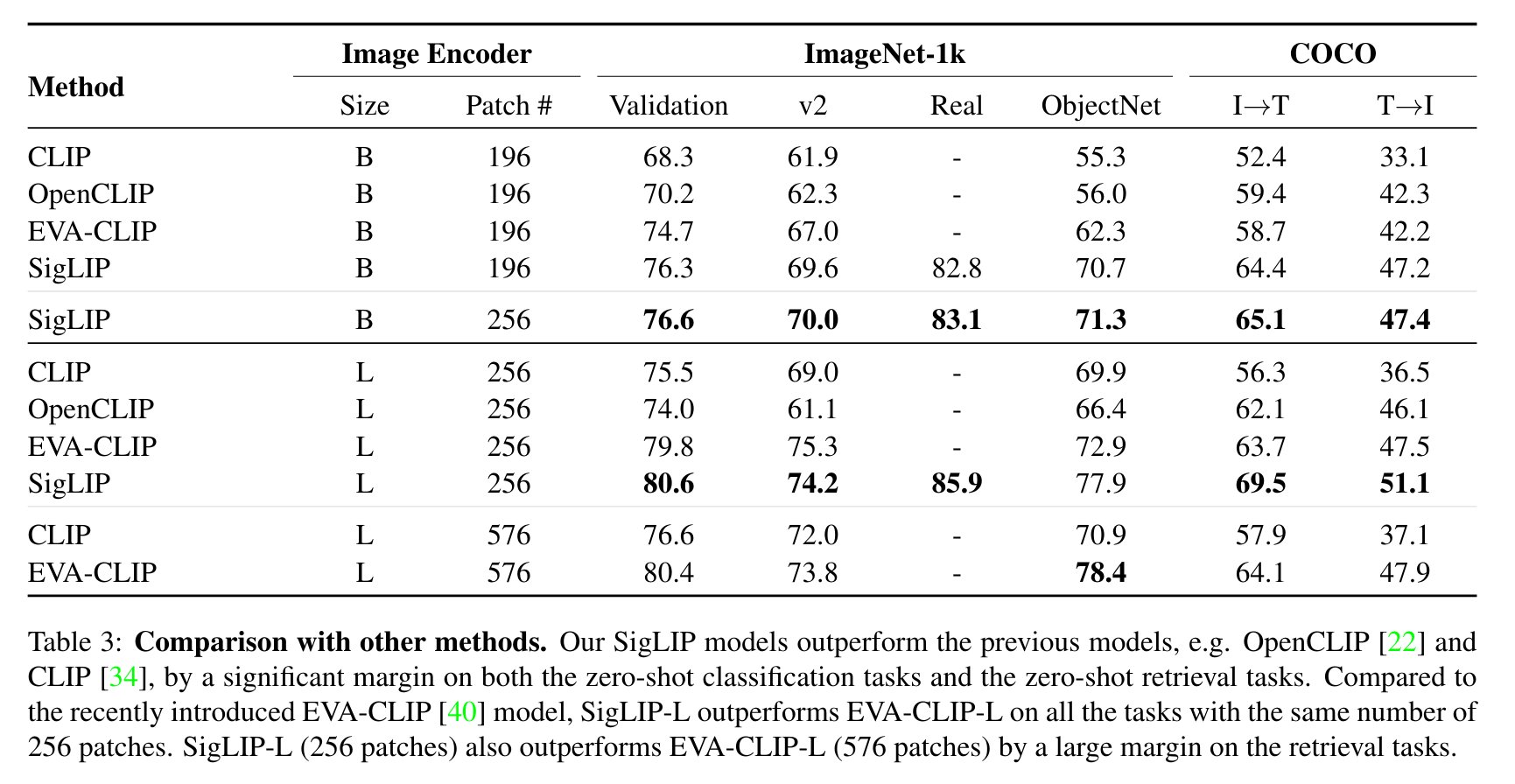

SigLIP與CLIP的評估對比結果如下(取自論文):

BibTeX引用和引用信息

@misc{zhai2023sigmoid,

title={Sigmoid Loss for Language Image Pre-Training},

author={Xiaohua Zhai and Basil Mustafa and Alexander Kolesnikov and Lucas Beyer},

year={2023},

eprint={2303.15343},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

📄 許可證

本模型採用Apache - 2.0許可證。

| 屬性 |

詳情 |

| 模型類型 |

SigLIP(基礎大小模型,多語言) |

| 訓練數據 |

未進行語言過濾的WebLI數據集 |

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語