P5 Beauty Base

P5は、レコメンデーションシステムのタスクをテキストからテキストへの生成タスクとして統一する事前学習モデルで、特に美容分野向けに設計されています。

ダウンロード数 122

リリース時間 : 12/20/2022

モデル概要

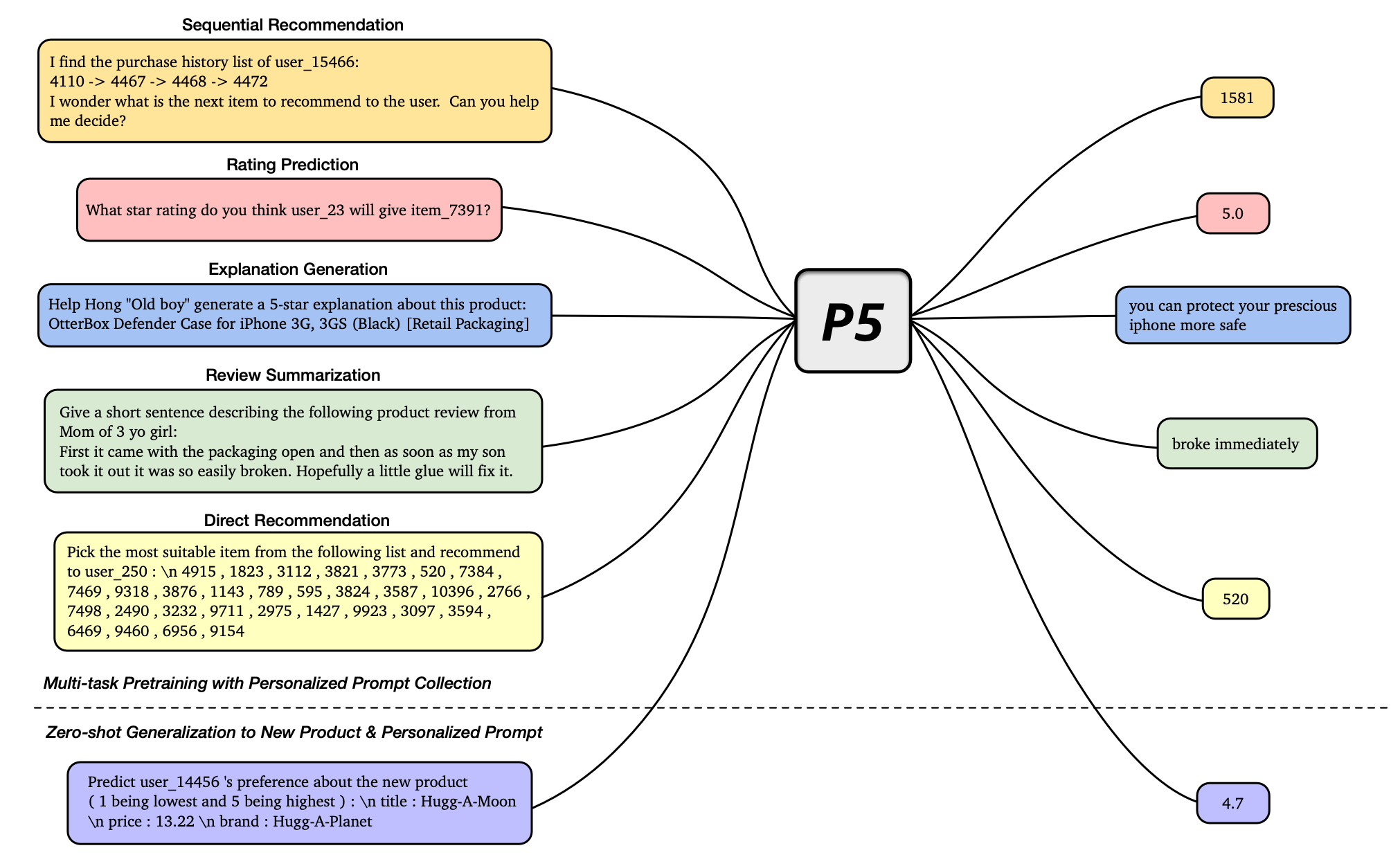

このモデルは、レコメンデーションタスクを言語処理タスクに変換することで、シーケンシャルレコメンデーション、ダイレクトレコメンデーション、説明生成などの多機能を統一的に処理します。

モデル特徴

統一レコメンデーションパラダイム

異なるタイプのレコメンデーションタスクをテキストからテキストへの生成タスクとして統一する

マルチタスク処理

シーケンシャルレコメンデーション、ダイレクトレコメンデーション、説明生成という3つのコアタスクを同時にサポート

パーソナライズドプロンプト

パーソナライズドプロンプトにより、異なるユーザー向けのカスタマイズされたレコメンデーションを実現

モデル能力

シーケンシャルレコメンデーション

ダイレクトレコメンデーション

説明生成

テキストからテキストへの生成

使用事例

Eコマースレコメンデーション

ユーザー購買履歴分析

ユーザーの過去の購買シーケンスに基づいて、次に購入する可能性のある商品を予測

レコメンデーションの精度とユーザーコンバージョン率の向上

新商品レコメンデーション

候補商品プールからユーザーに最も適した商品を選択して推薦

ユーザーが興味を持つ新製品の発見を支援

製品説明生成

製品特性説明

キーワードに基づいて製品の説明文を生成

ユーザーが製品特性をよりよく理解するのを支援

おすすめAIモデル

Llama 3 Typhoon V1.5x 8b Instruct

タイ語専用に設計された80億パラメータの命令モデルで、GPT-3.5-turboに匹敵する性能を持ち、アプリケーションシナリオ、検索拡張生成、制限付き生成、推論タスクを最適化

大規模言語モデル Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-TinyはSODAデータセットでトレーニングされた超小型対話モデルで、エッジデバイス推論向けに設計されており、体積はCosmo-3Bモデルの約2%です。

対話システム Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

RoBERTaアーキテクチャに基づく中国語抽出型QAモデルで、与えられたテキストから回答を抽出するタスクに適しています。

質問応答システム 中国語

R

uer

2,694

98