🚀 Controlnet - v1.1 - Scribble Version

Controlnet v1.1は、Controlnet v1.0の後継モデルで、Lvmin Zhangによってlllyasviel/ControlNet-v1-1でリリースされました。このチェックポイントは、元のチェックポイントをdiffusers形式に変換したもので、Stable Diffusion、例えばrunwayml/stable-diffusion-v1-5と組み合わせて使用することができます。

🚀 クイックスタート

このチェックポイントはStable Diffusion v1-5で学習されているため、同モデルとの組み合わせが推奨されます。実験的には、dreamboothed stable diffusionなどの他の拡散モデルとも使用できます。

✨ 主な機能

ControlNetは、追加の条件を付与することで拡散モデルを制御するニューラルネットワーク構造です。このチェックポイントは、スクリブル画像を条件としたControlNetに対応しています。

📦 インストール

外部依存関係のインストール

$ pip install controlnet_aux==0.3.0

diffusersと関連パッケージのインストール

$ pip install diffusers transformers accelerate

💻 使用例

基本的な使用法

import torch

import os

from huggingface_hub import HfApi

from pathlib import Path

from diffusers.utils import load_image

from PIL import Image

import numpy as np

from controlnet_aux import PidiNetDetector, HEDdetector

from diffusers import (

ControlNetModel,

StableDiffusionControlNetPipeline,

UniPCMultistepScheduler,

)

checkpoint = "lllyasviel/control_v11p_sd15_scribble"

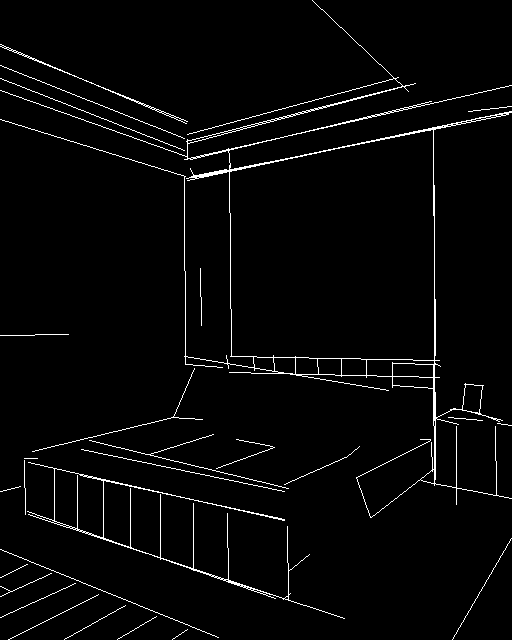

image = load_image(

"https://huggingface.co/lllyasviel/control_v11p_sd15_scribble/resolve/main/images/input.png"

)

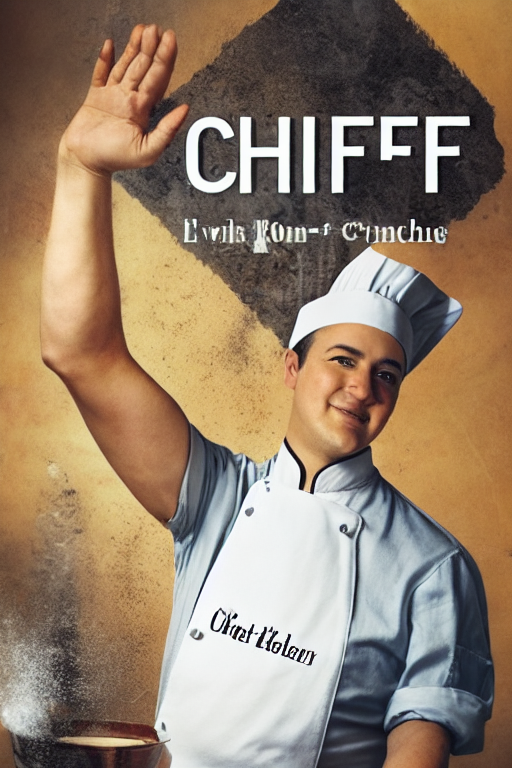

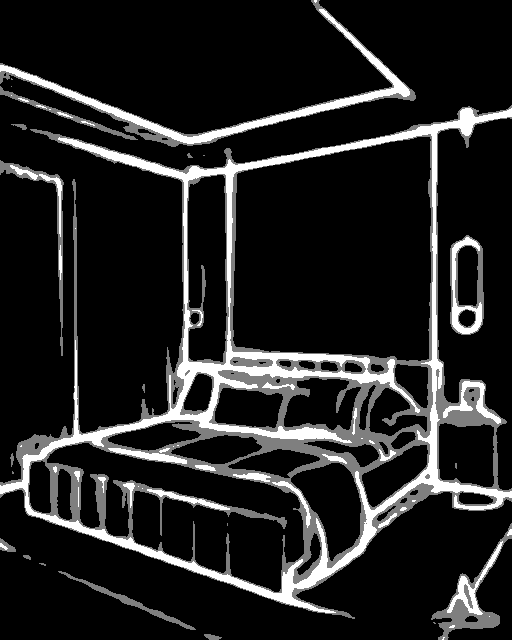

prompt = "royal chamber with fancy bed"

processor = HEDdetector.from_pretrained('lllyasviel/Annotators')

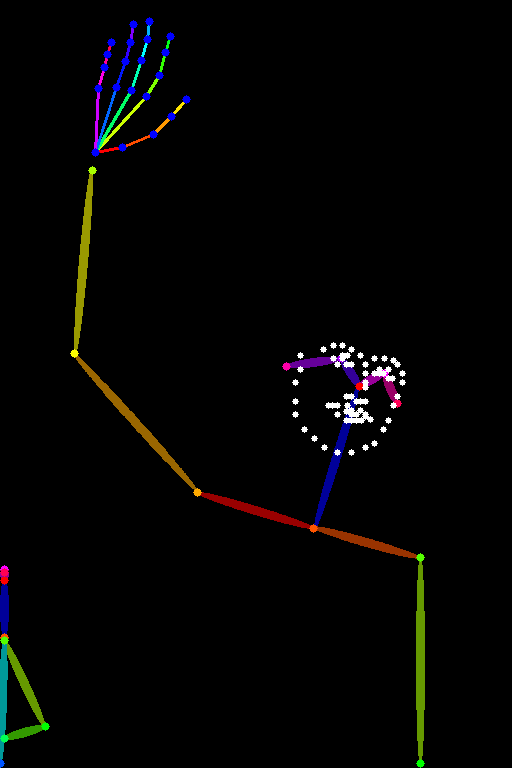

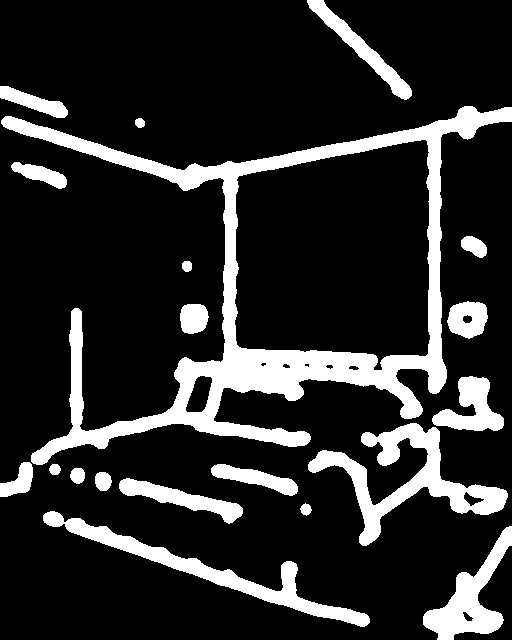

control_image = processor(image, scribble=True)

control_image.save("./images/control.png")

controlnet = ControlNetModel.from_pretrained(checkpoint, torch_dtype=torch.float16)

pipe = StableDiffusionControlNetPipeline.from_pretrained(

"runwayml/stable-diffusion-v1-5", controlnet=controlnet, torch_dtype=torch.float16

)

pipe.scheduler = UniPCMultistepScheduler.from_config(pipe.scheduler.config)

pipe.enable_model_cpu_offload()

generator = torch.manual_seed(0)

image = pipe(prompt, num_inference_steps=30, generator=generator, image=control_image).images[0]

image.save('images/image_out.png')

📚 ドキュメント

モデルの詳細

論文の紹介

Controlnetは、Lvmin ZhangとManeesh AgrawalaによるAdding Conditional Control to Text-to-Image Diffusion Modelsで提案されました。

論文の概要は以下の通りです。

我々は、事前学習された大規模拡散モデルを制御して追加の入力条件をサポートするためのニューラルネットワーク構造であるControlNetを提案します。ControlNetは、タスク固有の条件をエンドツーエンドで学習し、学習データセットが小さい場合(< 50k)でもロバストな学習が可能です。さらに、ControlNetの学習は拡散モデルの微調整と同じくらい速く、パーソナルデバイスでも学習できます。あるいは、強力な計算クラスタが利用可能な場合、モデルは大量(数百万から数十億)のデータにスケーリングすることができます。我々は、Stable Diffusionのような大規模拡散モデルにControlNetを追加することで、エッジマップ、セグメンテーションマップ、キーポイントなどの条件付き入力を可能にできることを報告しています。これにより、大規模拡散モデルを制御する方法が豊富になり、関連するアプリケーションがさらに促進される可能性があります。

他のリリースされたチェックポイント v1-1

著者らは、Stable Diffusion v1-5でそれぞれ異なるタイプの条件付きで学習された14種類の異なるチェックポイントをリリースしています。

引用

@misc{zhang2023adding,

title={Adding Conditional Control to Text-to-Image Diffusion Models},

author={Lvmin Zhang and Maneesh Agrawala},

year={2023},

eprint={2302.05543},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

📄 ライセンス

このモデルはThe CreativeML OpenRAIL M licenseの下で提供されています。

⚠️ 重要提示

画像を処理して補助条件を作成する場合は、以下に示すように外部依存関係が必要です。

💡 使用建议

このチェックポイントはStable Diffusion v1-5で学習されているため、同モデルとの組み合わせが推奨されます。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語