🚀 InternViT-6B-448px-V2_5

InternViT-6B-448px-V2_5は、画像の特徴抽出を行うためのモデルです。InternViT-6B-448px-V1-5をベースに微調整され、視覚エンコーダの性能が向上しています。

[📂 GitHub] [📜 InternVL 1.0] [📜 InternVL 1.5] [📜 Mini-InternVL] [📜 InternVL 2.5]

[🆕 Blog] [🗨️ Chat Demo] [🤗 HF Demo] [🚀 Quick Start] [📖 Documents]

🚀 クイックスタート

⚠️ 重要提示

私たちの経験では、InternViT V2.5シリーズは、従来のコンピュータビジョンタスクよりもMLLMを構築するのに適しています。

import torch

from PIL import Image

from transformers import AutoModel, CLIPImageProcessor

model = AutoModel.from_pretrained(

'OpenGVLab/InternViT-6B-448px-V2_5',

torch_dtype=torch.bfloat16,

low_cpu_mem_usage=True,

trust_remote_code=True).cuda().eval()

image = Image.open('./examples/image1.jpg').convert('RGB')

image_processor = CLIPImageProcessor.from_pretrained('OpenGVLab/InternViT-6B-448px-V2_5')

pixel_values = image_processor(images=image, return_tensors='pt').pixel_values

pixel_values = pixel_values.to(torch.bfloat16).cuda()

outputs = model(pixel_values)

✨ 主な機能

概要

InternViT-6B-448px-V2_5は、InternViT-6B-448px-V1-5をベースに構築された画期的なモデルです。このモデルは、NTP損失を用いたViT増分学習(Stage 1.5)を採用することで、視覚エンコーダの画像特徴抽出能力を向上させ、より包括的な情報を捉えることができるようになりました。この改善は、LAION - 5Bなどの大規模ウェブデータセットでは十分に表現されていない分野、例えば多言語OCRデータや数学的なチャートなどで特に顕著です。

InternViT 2.5ファミリー

以下の表では、InternViT 2.5シリーズの概要を提供しています。

| モデル名 |

HFリンク |

| InternViT-300M-448px-V2_5 |

🤗 link |

| InternViT-6B-448px-V2_5 |

🤗 link |

モデルアーキテクチャ

下の図に示すように、InternVL 2.5は、前作のInternVL 1.5および2.0と同じモデルアーキテクチャを保持しており、「ViT - MLP - LLM」パラダイムに従っています。この新しいバージョンでは、新たに増分事前学習されたInternViTを、ランダムに初期化されたMLPプロジェクターを使用して、InternLM 2.5やQwen 2.5などの様々な事前学習済みLLMと統合しています。

前のバージョンと同様に、ピクセルのアンシャッフル操作を適用し、視覚トークンの数を元の1/4に減らしています。さらに、InternVL 1.5と同様の動的解像度戦略を採用し、画像を448×448ピクセルのタイルに分割しています。InternVL 2.0以降の主な違いは、マルチ画像およびビデオデータのサポートを追加したことです。

学習戦略

マルチモーダルデータの動的高解像度学習

InternVL 2.0および2.5では、動的高解像度学習アプローチを拡張し、マルチ画像およびビデオデータセットを扱う能力を強化しています。

- 単一画像データセットの場合、タイルの総数

n_maxは、最大解像度を得るために単一の画像に割り当てられます。視覚トークンは<img>と</img>タグで囲まれます。

- マルチ画像データセットの場合、タイルの総数

n_maxは、サンプル内のすべての画像に分散されます。各画像はImage - 1などの補助タグでラベル付けされ、<img>と</img>タグで囲まれます。

- ビデオの場合、各フレームは448×448にリサイズされます。フレームは

Frame - 1などのタグでラベル付けされ、画像と同様に<img>と</img>タグで囲まれます。

単一モデル学習パイプライン

InternVL 2.5における単一モデルの学習パイプラインは、3つの段階に構成されており、モデルの視覚認識能力とマルチモーダル能力を強化するように設計されています。

- 段階1: MLPウォームアップ:この段階では、視覚エンコーダと言語モデルを凍結した状態で、MLPプロジェクターのみを学習させます。コストは増加しますが、より良い性能を得るために動的高解像度学習戦略が適用されます。このフェーズは、堅牢なクロスモーダルアライメントを確保し、安定したマルチモーダル学習のためのモデルを準備します。

- 段階1.5: ViT増分学習(オプション):この段階では、段階1と同じデータを使用して、視覚エンコーダとMLPプロジェクターの増分学習が可能です。これにより、エンコーダが多言語OCRや数学的チャートなどの希少なドメインを扱う能力が向上します。一度学習されたエンコーダは、新しいドメインが導入されない限り、再学習することなくLLM間で再利用できるため、この段階はオプションです。

- 段階2: 全モデル命令微調整:高品質なマルチモーダル命令データセットでモデル全体を学習させます。ノイズの多いデータがLLMの性能を低下させる可能性があるため、厳格なデータ品質管理が行われます。この段階の後、学習プロセスは完了します。

視覚能力の評価

視覚エンコーダの性能を、様々なドメインやタスクにわたって包括的に評価しています。評価は2つの主要なカテゴリに分けられています。(1) グローバルビューのセマンティック品質を表す画像分類、および(2) ローカルビューのセマンティック品質を捉えるセマンティックセグメンテーションです。このアプローチにより、InternViTの連続するバージョンアップデートにおける表現品質を評価することができます。詳細については、技術レポートを参照してください。

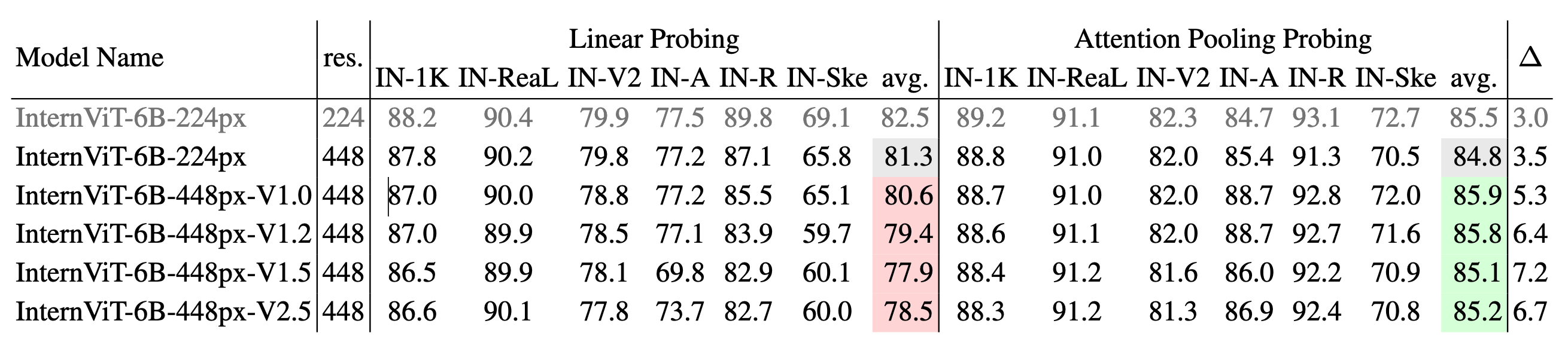

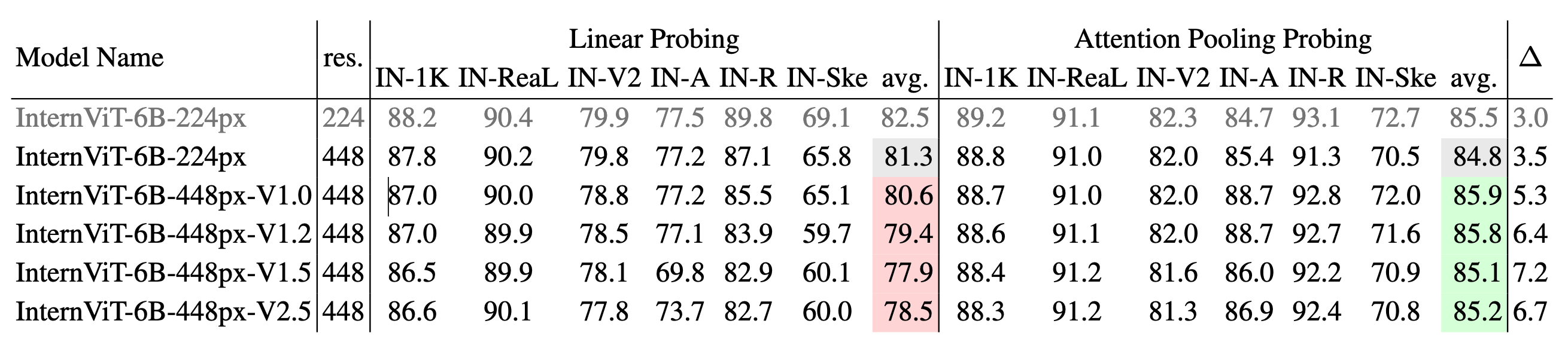

画像分類

InternViTの異なるバージョンにおける画像分類性能:IN - 1Kを学習に使用し、IN - 1K検証セットおよびIN - ReaL、IN - V2、IN - A、IN - R、IN - Sketchなどの複数のImageNetバリアントで評価しています。線形プロービングとアテンションプーリングプロービングの両方の方法について結果を報告し、各方法の平均精度を示しています。∆は、アテンションプーリングプロービングと線形プロービングの間の性能ギャップを表しており、∆が大きいほど、単純な線形特徴の学習から、より複雑な非線形セマンティック表現の捕捉へのシフトを示しています。

セマンティックセグメンテーション性能

InternViTの異なるバージョンにおけるセマンティックセグメンテーション性能:モデルは、ADE20KおよびCOCO - Stuff - 164Kで、線形プロービング、ヘッドチューニング、および完全チューニングの3つの設定で評価されています。表には、各設定のmIoUスコアとその平均が示されています。∆1はヘッドチューニングと線形プロービングの間のギャップを表し、∆2は完全チューニングと線形プロービングの間のギャップを示しています。∆の値が大きいほど、単純な線形特徴からより複雑な非線形表現へのシフトを示しています。

📄 ライセンス

このプロジェクトはMITライセンスの下で公開されています。

引用

このプロジェクトがあなたの研究に役立つ場合、以下を引用していただけると幸いです。

@article{chen2024expanding,

title={Expanding Performance Boundaries of Open-Source Multimodal Models with Model, Data, and Test-Time Scaling},

author={Chen, Zhe and Wang, Weiyun and Cao, Yue and Liu, Yangzhou and Gao, Zhangwei and Cui, Erfei and Zhu, Jinguo and Ye, Shenglong and Tian, Hao and Liu, Zhaoyang and others},

journal={arXiv preprint arXiv:2412.05271},

year={2024}

}

@article{gao2024mini,

title={Mini-internvl: A flexible-transfer pocket multimodal model with 5\% parameters and 90\% performance},

author={Gao, Zhangwei and Chen, Zhe and Cui, Erfei and Ren, Yiming and Wang, Weiyun and Zhu, Jinguo and Tian, Hao and Ye, Shenglong and He, Junjun and Zhu, Xizhou and others},

journal={arXiv preprint arXiv:2410.16261},

year={2024}

}

@article{chen2024far,

title={How Far Are We to GPT-4V? Closing the Gap to Commercial Multimodal Models with Open-Source Suites},

author={Chen, Zhe and Wang, Weiyun and Tian, Hao and Ye, Shenglong and Gao, Zhangwei and Cui, Erfei and Tong, Wenwen and Hu, Kongzhi and Luo, Jiapeng and Ma, Zheng and others},

journal={arXiv preprint arXiv:2404.16821},

year={2024}

}

@inproceedings{chen2024internvl,

title={Internvl: Scaling up vision foundation models and aligning for generic visual-linguistic tasks},

author={Chen, Zhe and Wu, Jiannan and Wang, Wenhai and Su, Weijie and Chen, Guo and Xing, Sen and Zhong, Muyan and Zhang, Qinglong and Zhu, Xizhou and Lu, Lewei and others},

booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition},

pages={24185--24198},

year={2024}

}

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語