Qwq 32B Snowdrop V0

Qwen2.5-32Bシリーズモデルを統合・最適化した高性能言語モデルで、ロールプレイとクリエイティブライティングに優れる

ダウンロード数 678

リリース時間 : 3/8/2025

モデル概要

このモデルはQwen2.5-32Bの強化統合版で、特にロールプレイシナリオでのパフォーマンスを最適化し、優れた文章スタイル制御とキャラクター一貫性維持能力を備えています

モデル特徴

卓越したロールプレイ能力

複雑な設定のキャラクターカードを完璧に処理し、キャラクターの一貫性を保ちながら多様な応答を提供できます

安定した文章スタイル制御

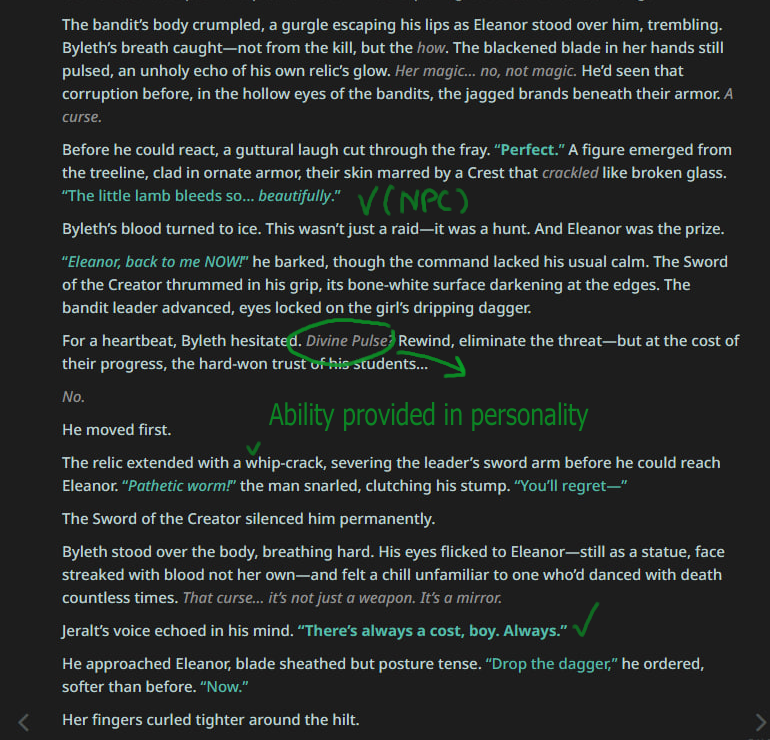

特定の推論ガイドワードを使用することで(例: 和風ライトノベルスタイル)、特定の執筆スタイルを固定できます

優れた創造的生成

10回のリロール中8回は90%オリジナルコンテンツを生成し、陳腐な表現がほとんど出ません

精密なキャラクター塑造

キャラクター固有の用語を正確に記憶・使用し、NPCの独特な話し方を維持できます

モデル能力

クリエイティブライティング

ロールプレイ対話

ストーリー生成

スタイライズドテキスト生成

マルチターン対話維持

使用事例

クリエイティブライティング

ライトノベルスタイル創作

和風ライトノベルスタイルの一貫したストーリー段落を生成

指定スタイルを安定して維持しつつ、内容の多様性を保証

ロールプレイ

複雑なキャラクターインタラクション

詳細なキャラクター設定に基づくマルチターン対話

NPCは開始情報に基づいてインタラクションに参加し、独特な話し方を維持できます

おすすめAIモデル

Llama 3 Typhoon V1.5x 8b Instruct

タイ語専用に設計された80億パラメータの命令モデルで、GPT-3.5-turboに匹敵する性能を持ち、アプリケーションシナリオ、検索拡張生成、制限付き生成、推論タスクを最適化

大規模言語モデル Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-TinyはSODAデータセットでトレーニングされた超小型対話モデルで、エッジデバイス推論向けに設計されており、体積はCosmo-3Bモデルの約2%です。

対話システム Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

RoBERTaアーキテクチャに基づく中国語抽出型QAモデルで、与えられたテキストから回答を抽出するタスクに適しています。

質問応答システム 中国語

R

uer

2,694

98

(Geminiで開始したセッション後)

(Geminiで開始したセッション後)