🚀 ColQwen2-2B: ColBERT戦略を用いたQwen2-VL-2B-Instructベースのビジュアルリトリーバ

このモデルは、バッチサイズ8x128で5エポック、更新されたパッドトークンを用いて学習されたベースバージョンです。

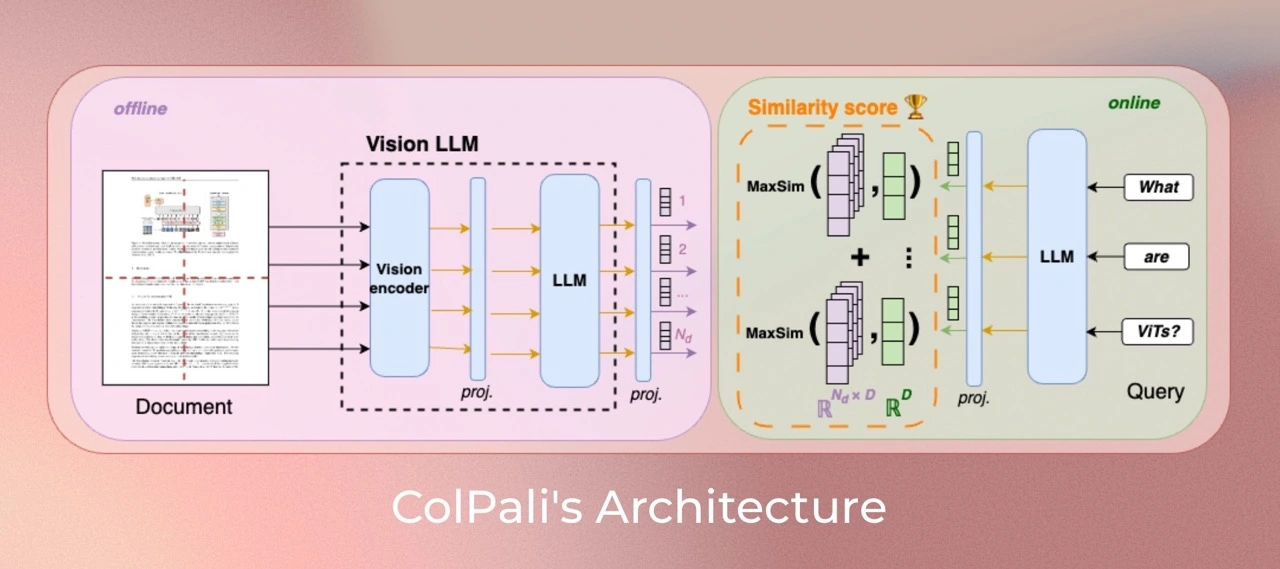

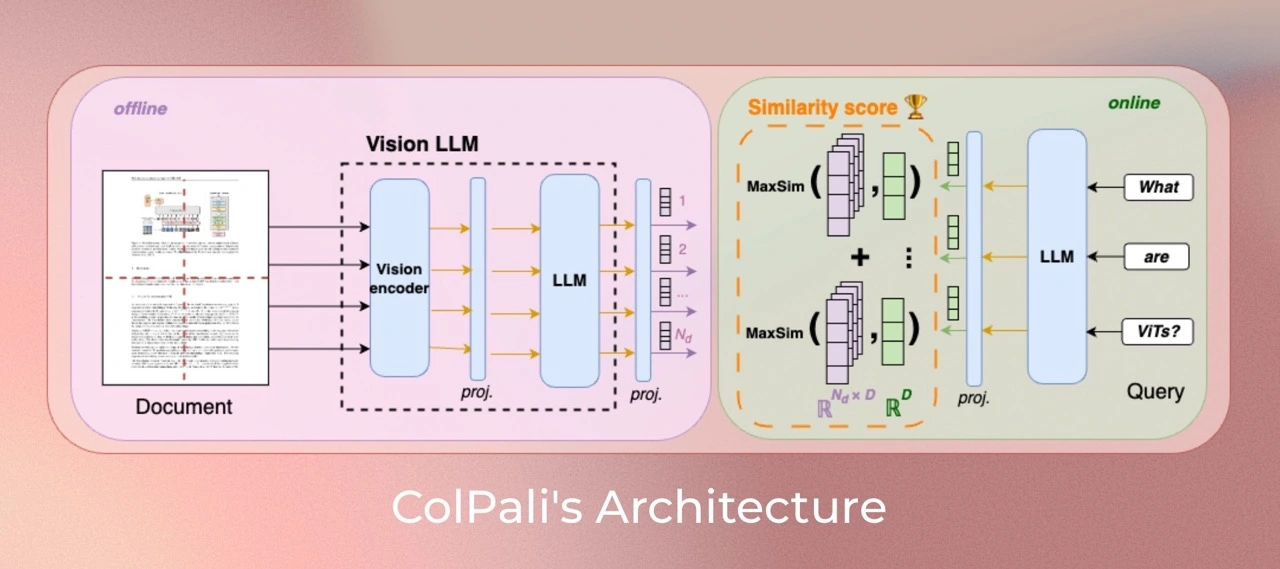

ColQwenは、ビジュアル言語モデル(VLMs)に基づく新しいモデルアーキテクチャと学習戦略を用いて、ビジュアル特徴から効率的にドキュメントをインデックス化するモデルです。

これはQwen2-VL-2Bの拡張であり、ColBERTスタイルのテキストと画像の多ベクトル表現を生成します。

このモデルは論文ColPali: Efficient Document Retrieval with Vision Language Modelsで紹介され、このリポジトリで最初に公開されました。

このバージョンは未学習のベースバージョンで、投影層の初期化を決定論的に行うことを保証します。

✨ 主な機能

バージョンの特異性

このモデルは動的な画像解像度を入力として受け取り、ColPaliのようにアスペクト比を変えずにリサイズしません。

最大解像度は、最大1024個の画像パッチが作成されるように設定されています。実験では、画像パッチの数を増やすことで、メモリ要件を犠牲にしても明らかな改善が見られます。

このバージョンはcolpali-engine==0.3.4で学習されています。

データは論文で説明されているColPaliのデータと同じです。

モデルの学習

パラメータ

言語モデルのトランスフォーマー層と、ランダムに初期化された最終投影層に対して、低ランクアダプター(LoRA)を用いて、alpha=128 と r=128 でモデルを学習します。

また、paged_adamw_8bitオプティマイザを使用します。

8台のH100 GPUを用いた分散データ並列(accelerate経由)で学習し、学習率は2e-4で線形減衰、1%のウォームアップステップを使用し、デバイスごとのバッチサイズは128、bfloat16形式で学習します。

📦 インストール

colpali-engineがソースからインストールされているか、バージョンが0.3.4以上であることを確認してください。

transformersのバージョンは4.46.1より大きい必要があります。

pip install git+https://github.com/illuin-tech/colpali

💻 使用例

基本的な使用法

import torch

from PIL import Image

from colpali_engine.models import ColQwen2, ColQwen2Processor

model = ColQwen2.from_pretrained(

"tsystems/colqwen2-2b-v1.0",

torch_dtype=torch.bfloat16,

device_map="cuda:0",

).eval()

processor = ColQwen2Processor.from_pretrained("tsystems/colqwen2-2b-v1.0")

images = [

Image.new("RGB", (32, 32), color="white"),

Image.new("RGB", (16, 16), color="black"),

]

queries = [

"Is attention really all you need?",

"What is the amount of bananas farmed in Salvador?",

]

batch_images = processor.process_images(images).to(model.device)

batch_queries = processor.process_queries(queries).to(model.device)

with torch.no_grad():

image_embeddings = model(**batch_images)

query_embeddings = model(**batch_queries)

scores = processor.score_multi_vector(query_embeddings, image_embeddings)

📚 ドキュメント

制限事項

- 焦点:このモデルは主にPDFタイプのドキュメントと高リソース言語に焦点を当てており、他のドキュメントタイプや表現が少ない言語への一般化が制限される可能性があります。

- サポート:このモデルはColBERTの後期相互作用メカニズムに由来する多ベクトル検索に依存しており、ネイティブの多ベクトルサポートを持たない一般的なベクトル検索フレームワークに適応させるにはエンジニアリングの努力が必要になる場合があります。

ライセンス

ColQwen2のビジュアル言語バックボーンモデル(Qwen2-VL)はapache2.0ライセンスの下にあります。

この微調整されたアダプターはCC BY NC 4.0ライセンスの下にあります。したがって、現時点ではこのモデルの使用は研究目的のみです。

引用

もしあなたがこの組織のモデルを研究で使用する場合は、以下のように元の論文を引用してください。

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語