モデル概要

モデル特徴

モデル能力

使用事例

🚀 ColPali: PaliGemma-3BベースのColBERT戦略によるビジュアルドキュメント検索モデル

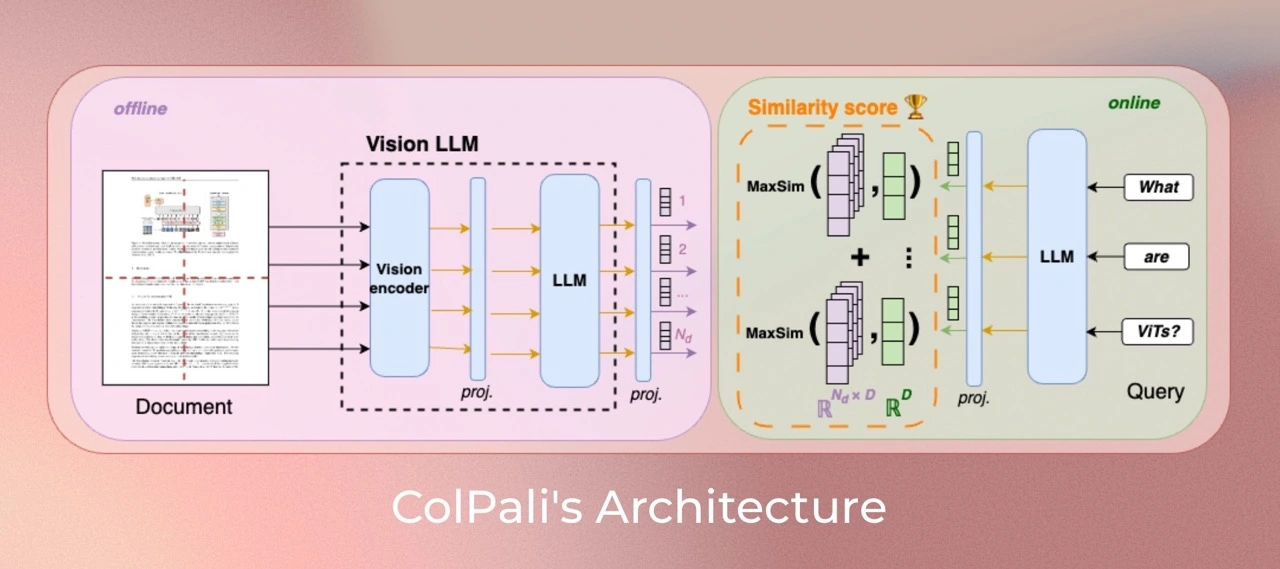

ColPaliは、ビジュアル言語モデル(VLM)に基づく新しいモデルアーキテクチャとトレーニング戦略を用いて、ビジュアル特徴からドキュメントを効率的にインデックス化するモデルです。 これはPaliGemma-3Bの拡張であり、ColBERTスタイルのテキストと画像のマルチベクトル表現を生成します。 このモデルは論文ColPali: Efficient Document Retrieval with Vision Language Modelsで紹介され、このリポジトリで最初に公開されました。

✨ 主な機能

バージョンの特徴

このバージョンはcolpali-engine==0.2.0でトレーニングされています。

colpaliと比較して、このバージョンはクエリの右パディングを使用してトレーニングされ、クエリエンコーディングにおける不要なトークンを修正しています。

また、決定的な投影層の初期化を保証するために、修正されたvidore/colpaligemma-3b-mix-448-baseをベースにしています。

データは論文で説明されているColPaliデータと同じです。

モデルの説明

このモデルは、既存のSigLIPモデルから反復的に構築されています。 これをファインチューニングしてBiSigLIPを作成し、SigLIPから出力されるパッチ埋め込みを大規模言語モデルであるPaliGemma-3Bに入力してBiPaliを作成します。 言語モデルを介して画像パッチ埋め込みを入力することの利点の1つは、それらが自然にテキスト入力(クエリ)と同様の潜在空間にマッピングされることです。 これにより、ColBERT戦略を利用して、テキストトークンと画像パッチの間の相互作用を計算することができ、BiPaliと比較して性能が大幅に向上します。

📦 インストール

ドキュメントに具体的なインストール手順が記載されていないため、このセクションは省略されます。

💻 使用例

基本的な使用法

import torch

import typer

from torch.utils.data import DataLoader

from tqdm import tqdm

from transformers import AutoProcessor

from PIL import Image

from colpali_engine.models.paligemma_colbert_architecture import ColPali

from colpali_engine.trainer.retrieval_evaluator import CustomEvaluator

from colpali_engine.utils.colpali_processing_utils import process_images, process_queries

from colpali_engine.utils.image_from_page_utils import load_from_dataset

def main() -> None:

"""Example script to run inference with ColPali"""

# Load model

model_name = "vidore/colpali-v1.1"

model = ColPali.from_pretrained("vidore/colpaligemma-3b-mix-448-base", torch_dtype=torch.bfloat16, device_map="cuda").eval()

model.load_adapter(model_name)

model = model.eval()

processor = AutoProcessor.from_pretrained(model_name)

# select images -> load_from_pdf(<pdf_path>), load_from_image_urls(["<url_1>"]), load_from_dataset(<path>)

images = load_from_dataset("vidore/docvqa_test_subsampled")

queries = ["From which university does James V. Fiorca come ?", "Who is the japanese prime minister?"]

# run inference - docs

dataloader = DataLoader(

images,

batch_size=4,

shuffle=False,

collate_fn=lambda x: process_images(processor, x),

)

ds = []

for batch_doc in tqdm(dataloader):

with torch.no_grad():

batch_doc = {k: v.to(model.device) for k, v in batch_doc.items()}

embeddings_doc = model(**batch_doc)

ds.extend(list(torch.unbind(embeddings_doc.to("cpu"))))

# run inference - queries

dataloader = DataLoader(

queries,

batch_size=4,

shuffle=False,

collate_fn=lambda x: process_queries(processor, x, Image.new("RGB", (448, 448), (255, 255, 255))),

)

qs = []

for batch_query in dataloader:

with torch.no_grad():

batch_query = {k: v.to(model.device) for k, v in batch_query.items()}

embeddings_query = model(**batch_query)

qs.extend(list(torch.unbind(embeddings_query.to("cpu"))))

# run evaluation

retriever_evaluator = CustomEvaluator(is_multi_vector=True)

scores = retriever_evaluator.evaluate(qs, ds)

print(scores.argmax(axis=1))

if __name__ == "__main__":

typer.run(main)

高度な使用法

# モデルをこのアダプターからさらにトレーニングする場合のコード

lora_config = LoraConfig.from_pretrained("vidore/colpali-v1.1")

lora_config.inference_mode = False # force training mode for fine-tuning

model = get_peft_model(model, lora_config)

print("after")

model.print_trainable_parameters()

📚 ドキュメント

モデルのトレーニング

データセット

トレーニングデータセットは127,460のクエリ - ページペアで構成されており、公開されている学術データセットのトレーニングセット(63%)と、ウェブクロールしたPDFドキュメントのページから構成され、VLM(Claude - 3 Sonnet)で生成された疑似質問で拡張された合成データセット(37%)から成ります。 トレーニングセットは設計上完全に英語であり、非英語言語へのゼロショット汎化を研究することができます。 評価の汚染を防ぐために、ViDoReとトレーニングセットの両方でマルチページPDFドキュメントが使用されていないことを明示的に検証しています。 ハイパーパラメータを調整するために、サンプルの2%を使用して検証セットを作成しています。

注: 多言語データは言語モデル(Gemma - 2B)の事前学習コーパスに含まれており、PaliGemma - 3Bのマルチモーダルトレーニング中に潜在的に発生します。

パラメータ

すべてのモデルはトレーニングセットで1エポックトレーニングされます。特に指定がない限り、モデルはbfloat16形式でトレーニングされ、低ランクアダプター(LoRA)を使用し、alpha = 32 と r = 32を言語モデルのトランスフォーマー層と、最後のランダムに初期化された投影層に適用し、paged_adamw_8bitオプティマイザーを使用します。

8つのGPUを使用したデータ並列でトレーニングし、学習率は5e - 5で線形減衰し、2.5%のウォームアップステップを使用し、バッチサイズは32です。

モデルの制限事項

- 対象範囲: このモデルは主にPDF形式のドキュメントとリソースが豊富な言語に焦点を当てているため、他のドキュメント形式や表現が少ない言語への汎化能力が制限される可能性があります。

- サポート: このモデルはColBERTの後期相互作用メカニズムに基づくマルチベクトル検索に依存しています。これは、ネイティブのマルチベクトルサポートがない広く使用されているベクトル検索フレームワークに適応させるためにエンジニアリングの努力が必要になる場合があります。

ライセンス

ColPaliのビジュアル言語バックボーンモデル(PaliGemma)は、モデルカードに指定されているgemmaライセンスの下にあります。

モデルに付属するアダプターはMITライセンスの下にあります。

連絡先

- Manuel Faysse: manuel.faysse@illuin.tech

- Hugues Sibille: hugues.sibille@illuin.tech

- Tony Wu: tony.wu@illuin.tech

引用

この組織のデータセットやモデルを研究で使用する場合は、元のデータセットを次のように引用してください。

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

🔧 技術詳細

ドキュメントに十分な技術的詳細が記載されていないため、このセクションは省略されます。

📄 ライセンス

ColPaliのビジュアル言語バックボーンモデル(PaliGemma)は、モデルカードに指定されているgemmaライセンスの下にあります。

モデルに付属するアダプターはMITライセンスの下にあります。

Transformers

Transformers Transformers 英語

Transformers 英語 Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers 複数言語対応

Transformers 複数言語対応 Transformers

Transformers Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語