🚀 OneFormer

OneFormer是首个多任务通用图像分割框架,仅需在单个数据集上以单一通用架构和模型进行一次训练,就能在语义、实例和全景分割任务中超越现有的专门模型。

🚀 快速开始

OneFormer模型在ADE20k数据集(大尺寸版本,Dinat主干网络)上进行训练。它由Jain等人在论文 OneFormer: One Transformer to Rule Universal Image Segmentation 中提出,并首次在 此仓库 中发布。

✨ 主要特性

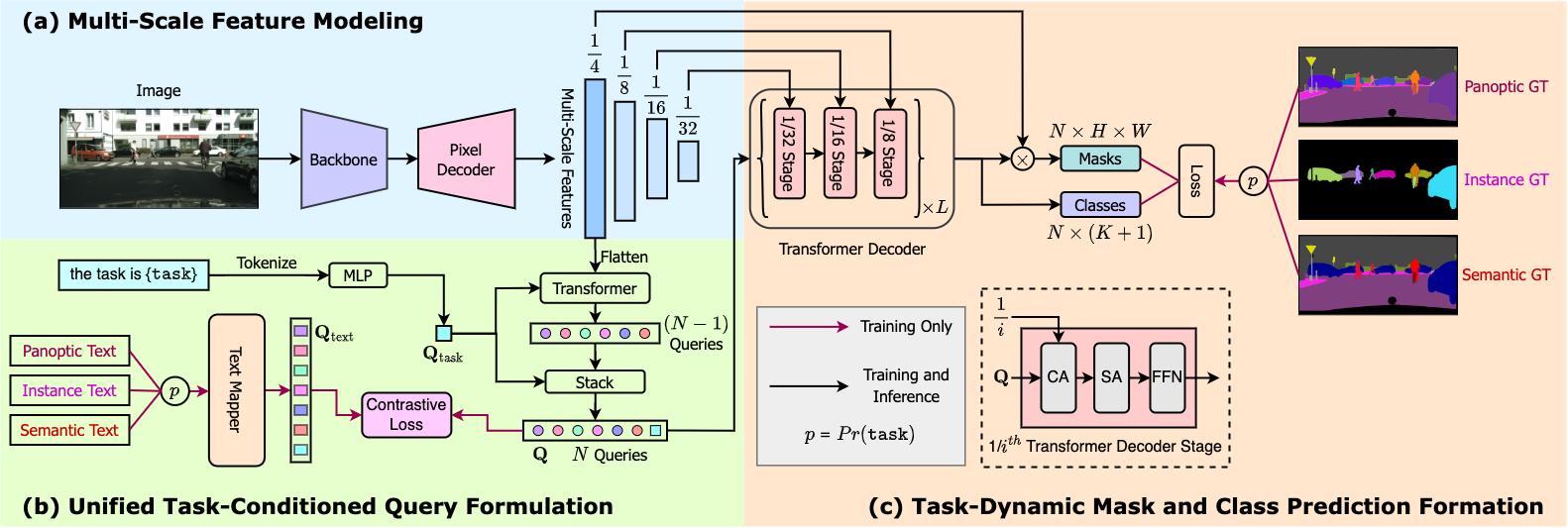

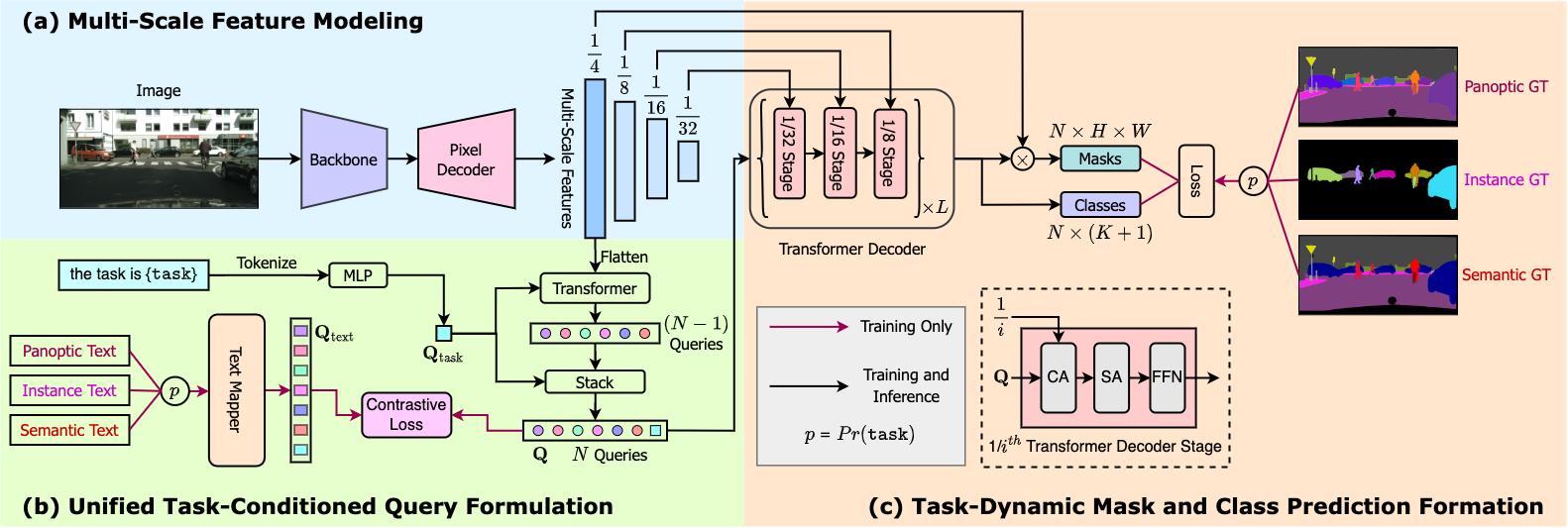

模型描述

OneFormer是首个多任务通用图像分割框架。它仅需使用单一通用架构、单一模型,并在单一数据集上进行一次训练,就能在语义、实例和全景分割任务中超越现有的专门模型。OneFormer使用任务令牌来使模型专注于当前任务,使架构在训练时具有任务导向性,在推理时具有任务动态性,且所有操作都通过单一模型完成。

预期用途与局限性

你可以使用此特定检查点进行语义、实例和全景分割。请查看 模型中心 以查找在不同数据集上微调的其他版本。

💻 使用示例

基础用法

from transformers import OneFormerProcessor, OneFormerForUniversalSegmentation

from PIL import Image

import requests

url = "https://huggingface.co/datasets/shi-labs/oneformer_demo/blob/main/ade20k.jpeg"

image = Image.open(requests.get(url, stream=True).raw)

processor = OneFormerProcessor.from_pretrained("shi-labs/oneformer_ade20k_dinat_large")

model = OneFormerForUniversalSegmentation.from_pretrained("shi-labs/oneformer_ade20k_dinat_large")

semantic_inputs = processor(images=image, task_inputs=["semantic"], return_tensors="pt")

semantic_outputs = model(**semantic_inputs)

predicted_semantic_map = processor.post_process_semantic_segmentation(outputs, target_sizes=[image.size[::-1]])[0]

instance_inputs = processor(images=image, task_inputs=["instance"], return_tensors="pt")

instance_outputs = model(**instance_inputs)

predicted_instance_map = processor.post_process_instance_segmentation(outputs, target_sizes=[image.size[::-1]])[0]["segmentation"]

panoptic_inputs = processor(images=image, task_inputs=["panoptic"], return_tensors="pt")

panoptic_outputs = model(**panoptic_inputs)

predicted_semantic_map = processor.post_process_panoptic_segmentation(outputs, target_sizes=[image.size[::-1]])[0]["segmentation"]

如需更多示例,请参考 文档。

📚 详细文档

引用

@article{jain2022oneformer,

title={{OneFormer: One Transformer to Rule Universal Image Segmentation}},

author={Jitesh Jain and Jiachen Li and MangTik Chiu and Ali Hassani and Nikita Orlov and Humphrey Shi},

journal={arXiv},

year={2022}

}

📄 许可证

本项目采用MIT许可证。

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语