🚀 nlpconnect/vit-gpt2-image-captioning

这是一个由@ydshieh在flax中训练的图像描述模型,这是此模型的PyTorch版本。该模型可用于将图像转换为文本描述,为图像赋予语义信息,在图像理解和内容生成等领域具有重要价值。

🚀 快速开始

模型简介

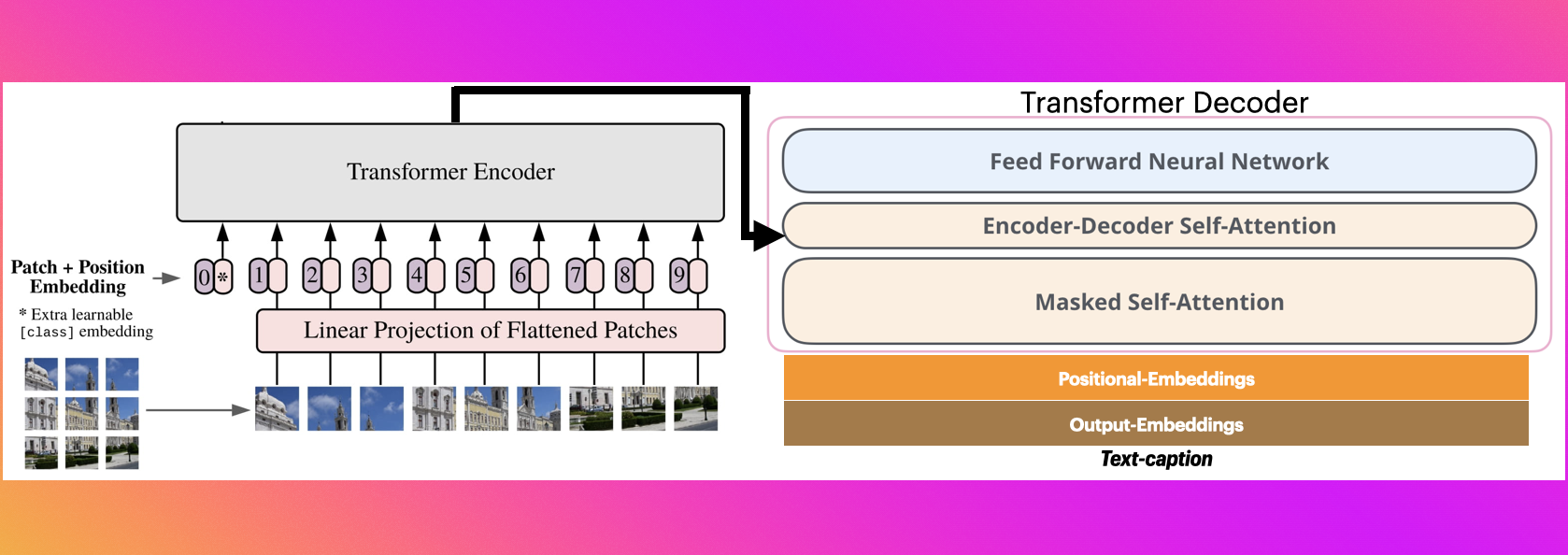

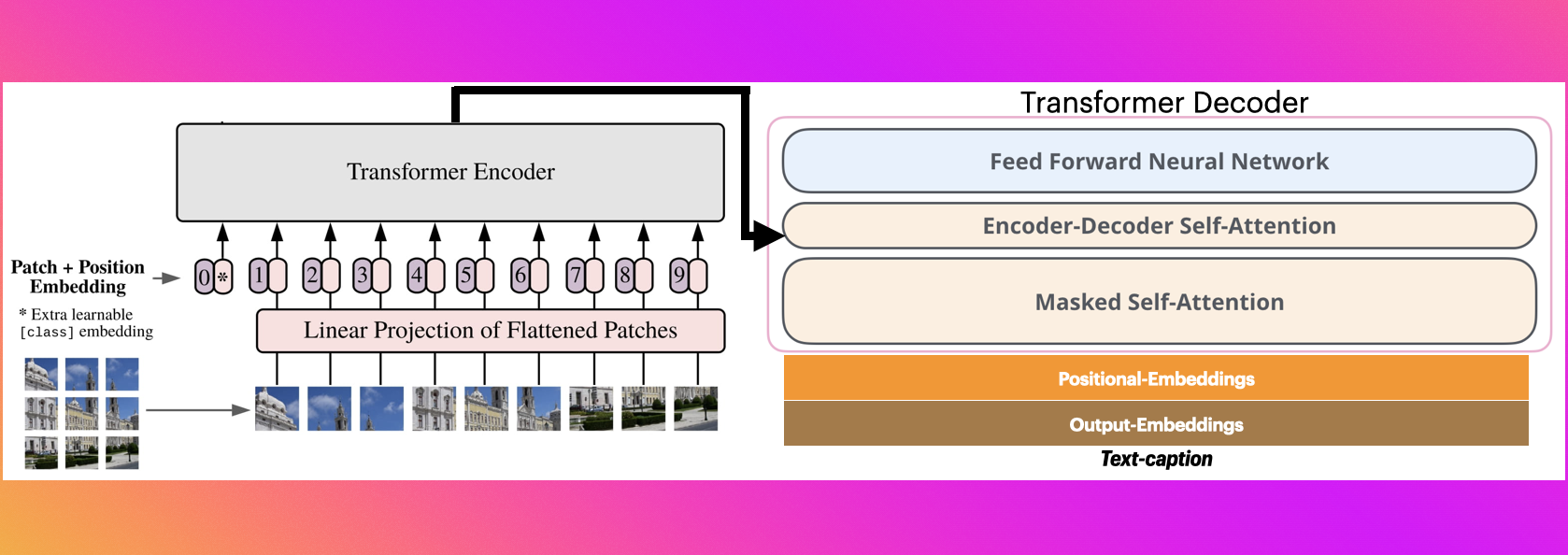

这是一个图像描述模型,可将图像转换为文本描述。它基于Transformer架构,结合了视觉编码器和解码器,能够对输入的图像生成自然语言描述。

示例展示

相关文章

关于使用Transformer进行图像描述的详细说明,可参考:使用Transformer进行图像描述的图解

💻 使用示例

基础用法

from transformers import VisionEncoderDecoderModel, ViTImageProcessor, AutoTokenizer

import torch

from PIL import Image

model = VisionEncoderDecoderModel.from_pretrained("nlpconnect/vit-gpt2-image-captioning")

feature_extractor = ViTImageProcessor.from_pretrained("nlpconnect/vit-gpt2-image-captioning")

tokenizer = AutoTokenizer.from_pretrained("nlpconnect/vit-gpt2-image-captioning")

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

model.to(device)

max_length = 16

num_beams = 4

gen_kwargs = {"max_length": max_length, "num_beams": num_beams}

def predict_step(image_paths):

images = []

for image_path in image_paths:

i_image = Image.open(image_path)

if i_image.mode != "RGB":

i_image = i_image.convert(mode="RGB")

images.append(i_image)

pixel_values = feature_extractor(images=images, return_tensors="pt").pixel_values

pixel_values = pixel_values.to(device)

output_ids = model.generate(pixel_values, **gen_kwargs)

preds = tokenizer.batch_decode(output_ids, skip_special_tokens=True)

preds = [pred.strip() for pred in preds]

return preds

predict_step(['doctor.e16ba4e4.jpg'])

高级用法

使用transformers的pipeline进行图像描述:

from transformers import pipeline

image_to_text = pipeline("image-to-text", model="nlpconnect/vit-gpt2-image-captioning")

image_to_text("https://ankur3107.github.io/assets/images/image-captioning-example.png")

📄 许可证

本项目采用Apache 2.0许可证。

📞 联系信息

如果需要任何帮助,可通过以下方式联系:

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语