🚀 ColQwen2:基于Qwen2-VL-2B-Instruct与ColBERT策略的视觉检索器

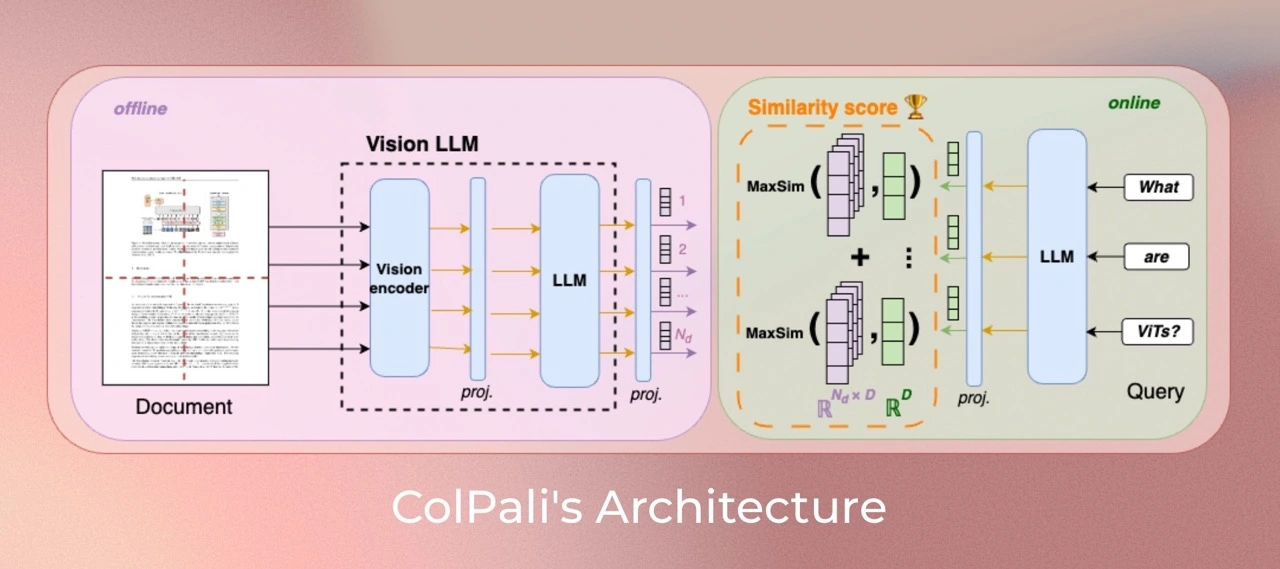

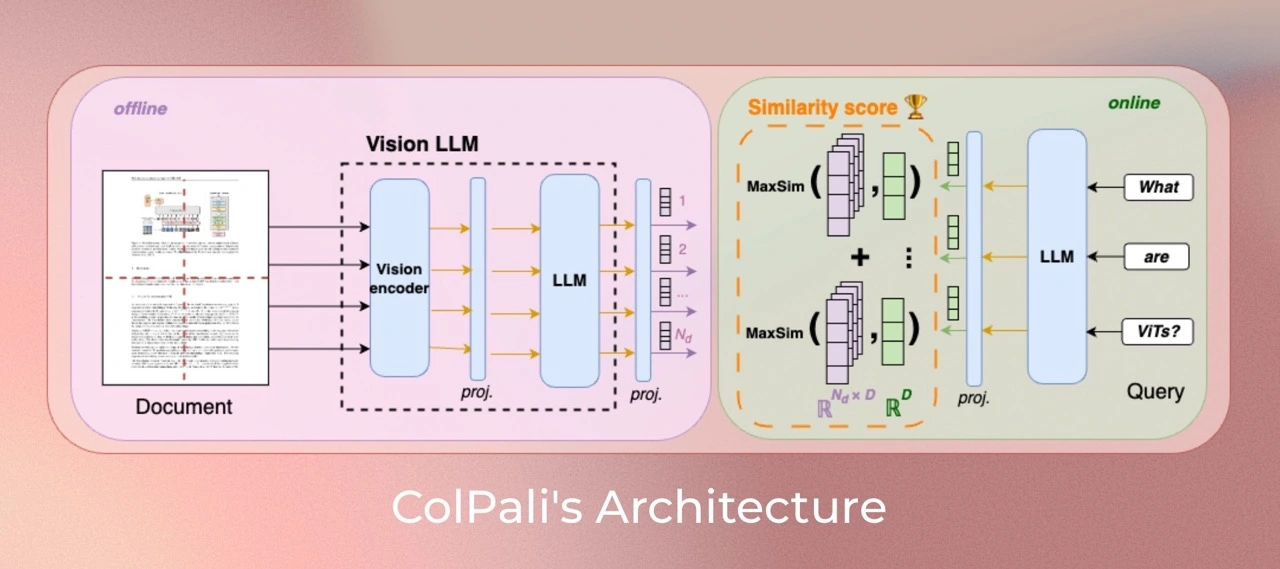

ColQwen2是一种基于视觉语言模型(VLMs)的新型模型架构和训练策略,能够从视觉特征中高效索引文档。它是Qwen2-VL-2B的扩展,可生成ColBERT风格的文本和图像多向量表示。该模型在论文ColPali: Efficient Document Retrieval with Vision Language Models中被提出,并首次在此仓库发布。

🚀 快速开始

ColQwen2是基于视觉语言模型(VLMs)的新型模型,用于从视觉特征中高效索引文档。它是Qwen2-VL-2B的扩展,可生成ColBERT风格的多向量表示。

✨ 主要特性

- 基于新颖的模型架构和训练策略,能从视觉特征高效索引文档。

- 作为Qwen2-VL-2B的扩展,生成ColBERT风格的多向量表示。

- 接受动态图像分辨率输入,不改变图像宽高比。

- 实验表明,更多图像块可带来显著性能提升,但会增加内存需求。

📦 安装指南

确保安装colpali-engine的版本高于0.3.4,transformers版本高于4.46.1。

pip install git+https://github.com/illuin-tech/colpali

💻 使用示例

基础用法

import torch

from PIL import Image

from transformers.utils.import_utils import is_flash_attn_2_available

from colpali_engine.models import ColQwen2, ColQwen2Processor

model = ColQwen2.from_pretrained(

"vidore/colqwen2-v1.0",

torch_dtype=torch.bfloat16,

device_map="cuda:0",

attn_implementation="flash_attention_2" if is_flash_attn_2_available() else None,

).eval()

processor = ColQwen2Processor.from_pretrained("vidore/colqwen2-v1.0")

images = [

Image.new("RGB", (128, 128), color="white"),

Image.new("RGB", (64, 32), color="black"),

]

queries = [

"Is attention really all you need?",

"What is the amount of bananas farmed in Salvador?",

]

batch_images = processor.process_images(images).to(model.device)

batch_queries = processor.process_queries(queries).to(model.device)

with torch.no_grad():

image_embeddings = model(**batch_images)

query_embeddings = model(**batch_queries)

scores = processor.score_multi_vector(query_embeddings, image_embeddings)

📚 详细文档

版本特性

此模型接受动态图像分辨率输入,不改变图像宽高比,最大分辨率设置为最多创建768个图像块。实验表明,更多图像块可带来显著性能提升,但会增加内存需求。此版本使用colpali-engine==0.3.1进行训练,数据与论文中描述的ColPali数据相同。

模型训练

数据集

训练数据集包含127,460个查询-页面配对,由公开可用学术数据集的训练集(63%)和合成数据集(37%)组成。合成数据集由网页爬取的PDF文档页面组成,并使用VLM生成的伪问题(Claude-3 Sonnet)进行增强。训练集设计为全英文,以便研究对非英语语言的零样本泛化能力。验证集使用2%的样本进行超参数调整。

参数

所有模型在训练集上训练1个epoch。除非另有说明,模型以bfloat16格式训练,使用低秩适配器(LoRA),alpha=32,r=32,应用于语言模型的Transformer层和最终随机初始化的投影层,并使用paged_adamw_8bit优化器。模型在8个GPU上进行数据并行训练,学习率为5e-5,线性衰减,热身步骤为2.5%,批量大小为32。

🔧 技术细节

ColQwen2基于视觉语言模型架构,结合ColBERT策略,对文本和图像生成多向量表示。通过动态图像分辨率输入和特定的训练策略,提高文档检索效率。模型训练使用特定的数据集和参数设置,以实现对不同语言和文档类型的泛化能力。

📄 许可证

ColQwen2的视觉语言骨干模型(Qwen2-VL)采用apache2.0许可证,附加的适配器采用MIT许可证。

联系我们

- Manuel Faysse: manuel.faysse@illuin.tech

- Hugues Sibille: hugues.sibille@illuin.tech

- Tony Wu: tony.wu@illuin.tech

引用说明

如果您在研究中使用了本组织的任何数据集或模型,请按以下格式引用原始数据集:

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语