🚀 ColSmolVLM-Instruct-256M:基于SmolVLM-Instruct-250M和ColBERT策略的视觉检索器

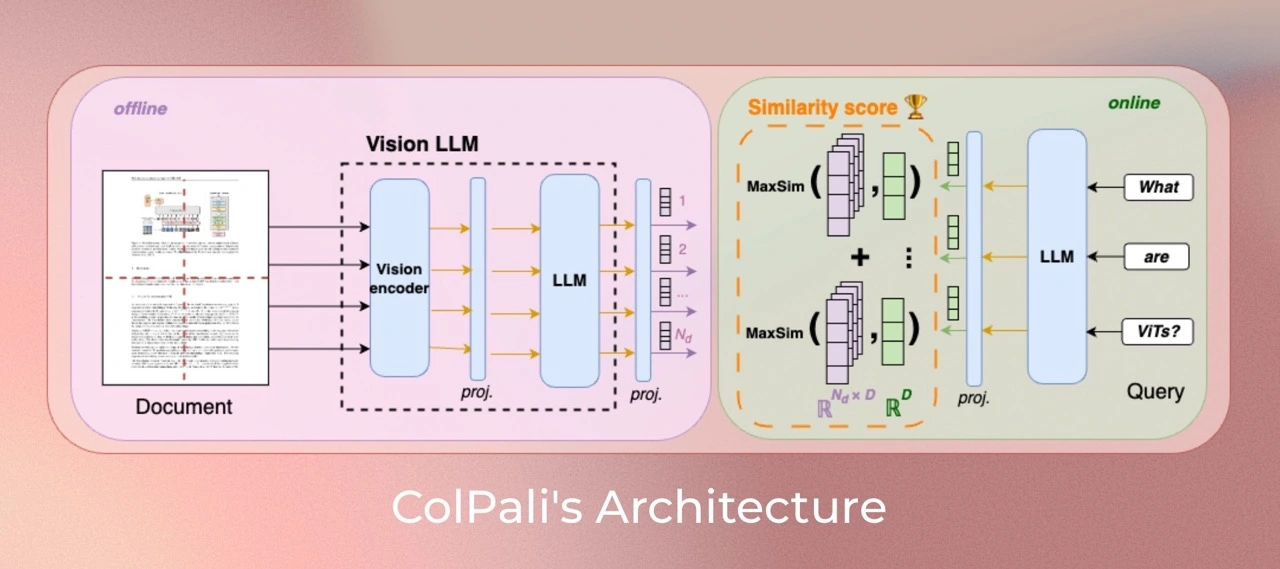

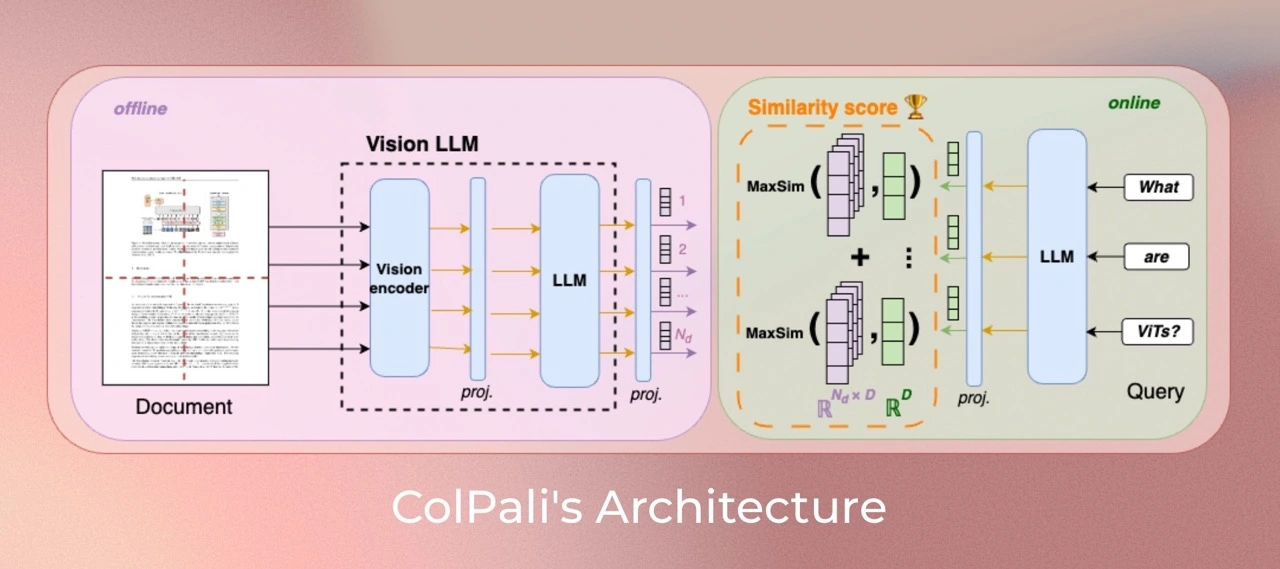

ColSmolVLM是一个基于视觉语言模型(VLMs)的新型模型架构和训练策略的模型,可根据文档的视觉特征对其进行高效索引。它是SmolVLM的扩展,能够生成ColBERT风格的文本和图像多向量表示。该模型在论文ColPali: Efficient Document Retrieval with Vision Language Models中被提出,并首次在此仓库中发布。

✨ 主要特性

- 基于新颖的模型架构和训练策略,能根据视觉特征高效索引文档。

- 作为SmolVLM的扩展,可生成ColBERT风格的多向量表示。

📦 安装指南

确保从源代码安装colpali-engine,或者使用版本高于0.3.5的版本(目前为仓库的主分支)。transformers版本必须大于4.46.2。

pip install git+https://github.com/illuin-tech/colpali

💻 使用示例

基础用法

import torch

from PIL import Image

from colpali_engine.models import ColIdefics3, ColIdefics3Processor

model = ColIdefics3.from_pretrained(

"vidore/colSmol-256M",

torch_dtype=torch.bfloat16,

device_map="cuda:0",

attn_implementation="flash_attention_2"

).eval()

processor = ColIdefics3Processor.from_pretrained("vidore/colSmol-256M")

images = [

Image.new("RGB", (32, 32), color="white"),

Image.new("RGB", (16, 16), color="black"),

]

queries = [

"Is attention really all you need?",

"What is the amount of bananas farmed in Salvador?",

]

batch_images = processor.process_images(images).to(model.device)

batch_queries = processor.process_queries(queries).to(model.device)

with torch.no_grad():

image_embeddings = model(**batch_images)

query_embeddings = model(**batch_queries)

scores = processor.score_multi_vector(query_embeddings, image_embeddings)

📚 详细文档

版本特性

此版本使用Colpali仓库(主分支)的提交b983e40进行训练。数据与论文中描述的ColPali数据相同。

模型训练

数据集

我们的训练数据集包含127,460个查询 - 页面配对,由公开可用的学术数据集的训练集(63%)和一个合成数据集组成。合成数据集由网络爬取的PDF文档页面构成,并使用VLM生成(Claude - 3 Sonnet)的伪问题进行扩充(37%)。我们的训练集设计为全英文,以便研究对非英语语言的零样本泛化能力。我们明确验证了没有多页PDF文档同时用于ViDoRe和训练集,以防止评估污染。使用2%的样本创建验证集来调整超参数。

注意:多语言数据存在于语言模型的预训练语料库中,并且很可能存在于多模态训练中。

参数

除非另有说明,我们以bfloat16格式训练模型,在语言模型的Transformer层以及最终随机初始化的投影层上使用低秩适配器(LoRA),其中alpha = 32且r = 32,并使用paged_adamw_8bit优化器。我们在4个GPU上进行数据并行训练,学习率为5e - 4,采用线性衰减和2.5%的热身步骤,批量大小为8。

局限性

- 适用范围:该模型主要专注于PDF类型的文档和资源丰富的语言,可能限制其对其他文档类型或代表性不足的语言的泛化能力。

- 支持情况:该模型依赖于从ColBERT后期交互机制派生的多向量检索,可能需要进行工程工作才能适应缺乏原生多向量支持的广泛使用的向量检索框架。

许可证

ColQwen2的视觉语言骨干模型(Qwen2 - VL)遵循apache2.0许可证。附加到模型的适配器遵循MIT许可证。

联系方式

- Manuel Faysse: manuel.faysse@illuin.tech

- Hugues Sibille: hugues.sibille@illuin.tech

- Tony Wu: tony.wu@illuin.tech

引用

如果您在研究中使用了该组织的任何数据集或模型,请按以下方式引用原始数据集:

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

📄 信息表格

| 属性 |

详情 |

| 模型类型 |

基于SmolVLM-Instruct-250M和ColBERT策略的视觉检索器 |

| 训练数据 |

由公开学术数据集(63%)和合成数据集(37%)组成的127,460个查询 - 页面配对,训练集全英文 |

| 训练参数 |

以bfloat16格式训练,使用LoRA(alpha = 32,r = 32),paged_adamw_8bit优化器,4个GPU数据并行,学习率5e - 4,线性衰减,2.5%热身步骤,批量大小8 |

| 许可证 |

ColQwen2的视觉语言骨干模型(Qwen2 - VL)遵循apache2.0许可证,适配器遵循MIT许可证 |

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语