🚀 无参考对齐扩散模型的边际感知偏好优化

我们提出了 MaPO,这是一种无参考、样本高效且节省内存的文本到图像扩散模型对齐技术。有关该技术的更多详细信息,请参阅我们的论文 点击查看。

👥 开发者

- 洪智宇* (韩国科学技术院人工智能系)

- 赛亚克·保罗* (Hugging Face)

- 诺亚·李 (韩国科学技术院人工智能系)

- 卡希夫·拉苏尔 (Hugging Face)

- 詹姆斯·索恩 (韩国科学技术院人工智能系)

- 郑正宪 (韩国大学)

📊 数据集

该模型是在 yuvalkirstain/pickapic_v2 数据集上对 Stable Diffusion XL 进行微调得到的。

💻 训练代码

请参考我们的代码仓库 点击查看。

🖼️ 定性比较

📈 结果

下面我们报告一些定量指标,并使用这些指标将 MaPO 与现有模型进行比较:

| 模型 |

美学得分 |

HPS v2.1 得分 |

Pickscore 得分 |

| SDXL |

6.03 |

30.0 |

22.4 |

| SFTChosen |

5.95 |

29.6 |

22.0 |

| Diffusion-DPO |

6.03 |

31.1 |

22.7 |

| MaPO (我们的模型) |

6.17 |

31.2 |

22.5 |

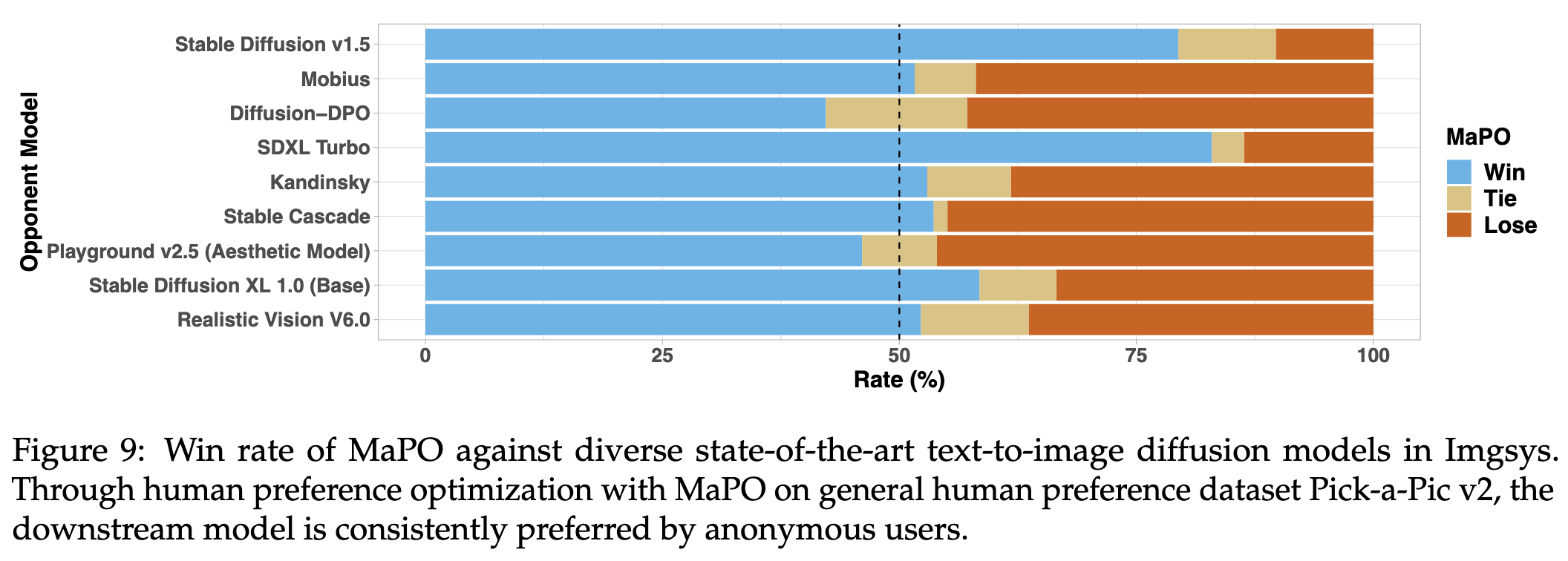

我们在 Imgsys 公开基准测试中评估了该检查点。在撰写本文时,MaPO 在排行榜上排名第 7,能够在 25 个最先进的文本到图像扩散模型中超越或匹配其中 21 个,而 Diffusion-DPO 排名第 20。同时,在适配 Pick-a-Pic v2 时,MaPO 的实际训练时间减少了 14.5%。我们感谢 Imgsys 团队帮助我们获取人类偏好数据。

下表报告了 MaPO 的内存效率,使其成为扩散模型对齐微调的更好选择:

| 指标 |

Diffusion-DPO |

MaPO (我们的模型) |

| 时间 (越低越好) |

63.5 |

54.3 (-14.5%) |

| GPU 内存 (越低越好) |

55.9 |

46.1 (-17.5%) |

| 最大批次大小 (越高越好) |

4 |

16 (×4) |

💻 使用示例

基础用法

from diffusers import DiffusionPipeline, AutoencoderKL, UNet2DConditionModel

import torch

sdxl_id = "stabilityai/stable-diffusion-xl-base-1.0"

vae_id = "madebyollin/sdxl-vae-fp16-fix"

unet_id = "mapo-t2i/mapo-beta"

vae = AutoencoderKL.from_pretrained(vae_id, torch_dtype=torch.float16)

unet = UNet2DConditionModel.from_pretrained(unet_id, torch_dtype=torch.float16)

pipeline = DiffusionPipeline.from_pretrained(sdxl_id, vae=vae, unet=unet, torch_dtype=torch.float16).to("cuda")

prompt = "An abstract portrait consisting of bold, flowing brushstrokes against a neutral background."

image = pipeline(prompt=prompt, num_inference_steps=30).images[0]

如需查看定性结果,请访问我们的 项目网站。

📚 引用

@misc{hong2024marginaware,

title={Margin-aware Preference Optimization for Aligning Diffusion Models without Reference},

author={Jiwoo Hong and Sayak Paul and Noah Lee and Kashif Rasul and James Thorne and Jongheon Jeong},

year={2024},

eprint={2406.06424},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

📄 许可证

openrail++

Transformers 支持多种语言

Transformers 支持多种语言 Transformers 支持多种语言

Transformers 支持多种语言 Transformers 英语

Transformers 英语 Transformers 英语

Transformers 英语