🚀 Controlnet - v1.1 - shuffle版本

Controlnet是一種神經網絡結構,可通過添加額外條件來控制擴散模型。本項目的這個檢查點是將原始檢查點轉換為diffusers格式,能與Stable Diffusion結合使用,為圖像生成提供更多的條件控制。

🚀 快速開始

Controlnet v1.1由Lvmin Zhang發佈於lllyasviel/ControlNet-v1-1。

此檢查點是將原始檢查點轉換為diffusers格式,可與Stable Diffusion(如runwayml/stable-diffusion-v1-5)結合使用。

更多詳情,請查看🧨 Diffusers文檔。

ControlNet是一種通過添加額外條件來控制擴散模型的神經網絡結構。

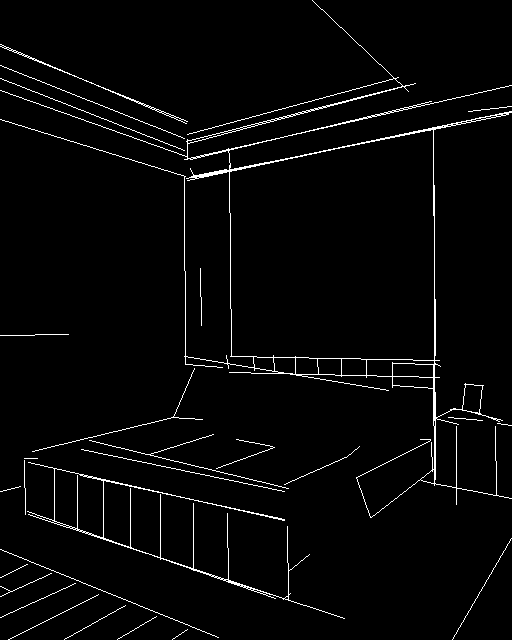

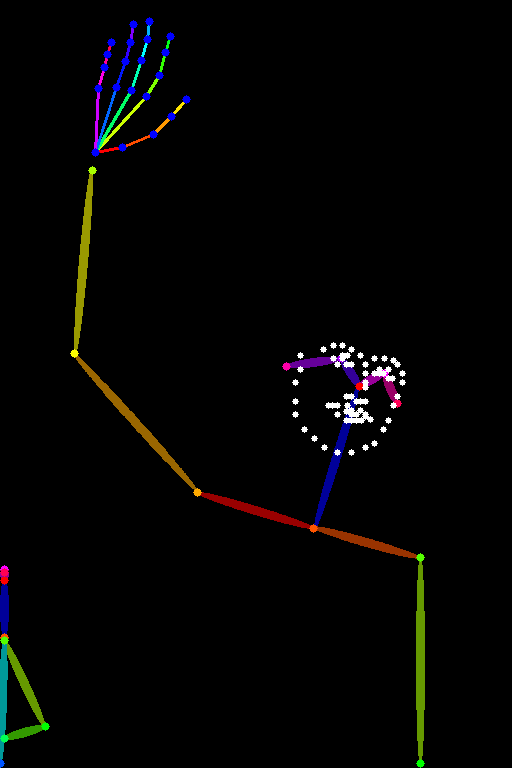

此檢查點對應於以shuffle圖像為條件的ControlNet。

✨ 主要特性

- 可控制擴散模型,通過添加額外條件生成特定圖像。

- 訓練速度快,可在個人設備上進行訓練,也能在強大計算集群上處理大量數據。

- 能與Stable Diffusion等模型結合使用,豐富圖像生成的控制方法。

📦 安裝指南

安裝外部依賴

$ pip install controlnet_aux==0.3.0

安裝diffusers及相關包

重要提示:請確保安裝diffusers.__version__ >= 0.16.0.dev0!

$ pip install git+https://github.com/huggingface/diffusers.git transformers accelerate

💻 使用示例

基礎用法

建議將此檢查點與Stable Diffusion v1-5配合使用,因為該檢查點是基於此模型進行訓練的。實驗表明,此檢查點也可與其他擴散模型(如經過微調的Stable Diffusion)一起使用。

import torch

import os

from huggingface_hub import HfApi

from pathlib import Path

from diffusers.utils import load_image

from PIL import Image

import numpy as np

from controlnet_aux import ContentShuffleDetector

from diffusers import (

ControlNetModel,

StableDiffusionControlNetPipeline,

UniPCMultistepScheduler,

)

checkpoint = "lllyasviel/control_v11e_sd15_shuffle"

image = load_image(

"https://huggingface.co/lllyasviel/control_v11e_sd15_shuffle/resolve/main/images/input.png"

)

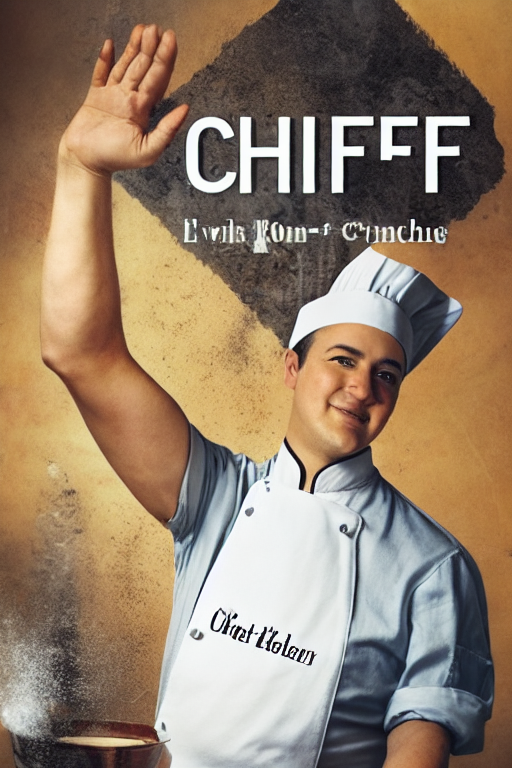

prompt = "New York"

processor = ContentShuffleDetector()

control_image = processor(image)

control_image.save("./images/control.png")

controlnet = ControlNetModel.from_pretrained(checkpoint, torch_dtype=torch.float16)

pipe = StableDiffusionControlNetPipeline.from_pretrained(

"runwayml/stable-diffusion-v1-5", controlnet=controlnet, torch_dtype=torch.float16

)

pipe.scheduler = UniPCMultistepScheduler.from_config(pipe.scheduler.config)

pipe.enable_model_cpu_offload()

generator = torch.manual_seed(33)

image = pipe(prompt, num_inference_steps=30, generator=generator, image=control_image).images[0]

image.save('images/image_out.png')

📚 詳細文檔

模型詳情

模型介紹

Controlnet由Lvmin Zhang和Maneesh Agrawala在論文 Adding Conditional Control to Text-to-Image Diffusion Models 中提出。

論文摘要如下:

我們提出了一種神經網絡結構ControlNet,用於控制預訓練的大型擴散模型以支持額外的輸入條件。ControlNet以端到端的方式學習特定任務的條件,即使訓練數據集較小(< 50k),學習過程也很穩健。此外,訓練ControlNet的速度與微調擴散模型相當,並且可以在個人設備上進行訓練。或者,如果有強大的計算集群,模型可以處理大量(數百萬到數十億)的數據。我們發現,像Stable Diffusion這樣的大型擴散模型可以通過ControlNet進行增強,以支持邊緣圖、分割圖、關鍵點等條件輸入。這可能會豐富控制大型擴散模型的方法,並進一步促進相關應用的發展。

其他發佈的v1-1檢查點

作者發佈了14種不同的檢查點,每種都基於Stable Diffusion v1-5在不同類型的條件下進行訓練:

更多信息

更多信息,請查看Diffusers ControlNet博客文章和官方文檔。

📄 許可證

本項目使用CreativeML OpenRAIL M許可證。

Transformers 支持多種語言

Transformers 支持多種語言 Transformers 支持多種語言

Transformers 支持多種語言 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語