モデル概要

モデル特徴

モデル能力

使用事例

🚀 Wan-Fun

😊 ようこそ!

このプロジェクトは、テキストから動画を生成する機能を提供し、diffusersライブラリを使用しています。

🚀 クイックスタート

1. クラウドでの使用: AliyunDSW/Docker

a. 阿里云DSWを通じて

DSWには無料のGPU使用時間があり、ユーザーは一度申請することができ、申請後3か月間有効です。

阿里云はFreetierで無料のGPU使用時間を提供しています。これを取得して阿里云PAI-DSWで使用すると、5分以内にCogVideoX-Funを起動できます。

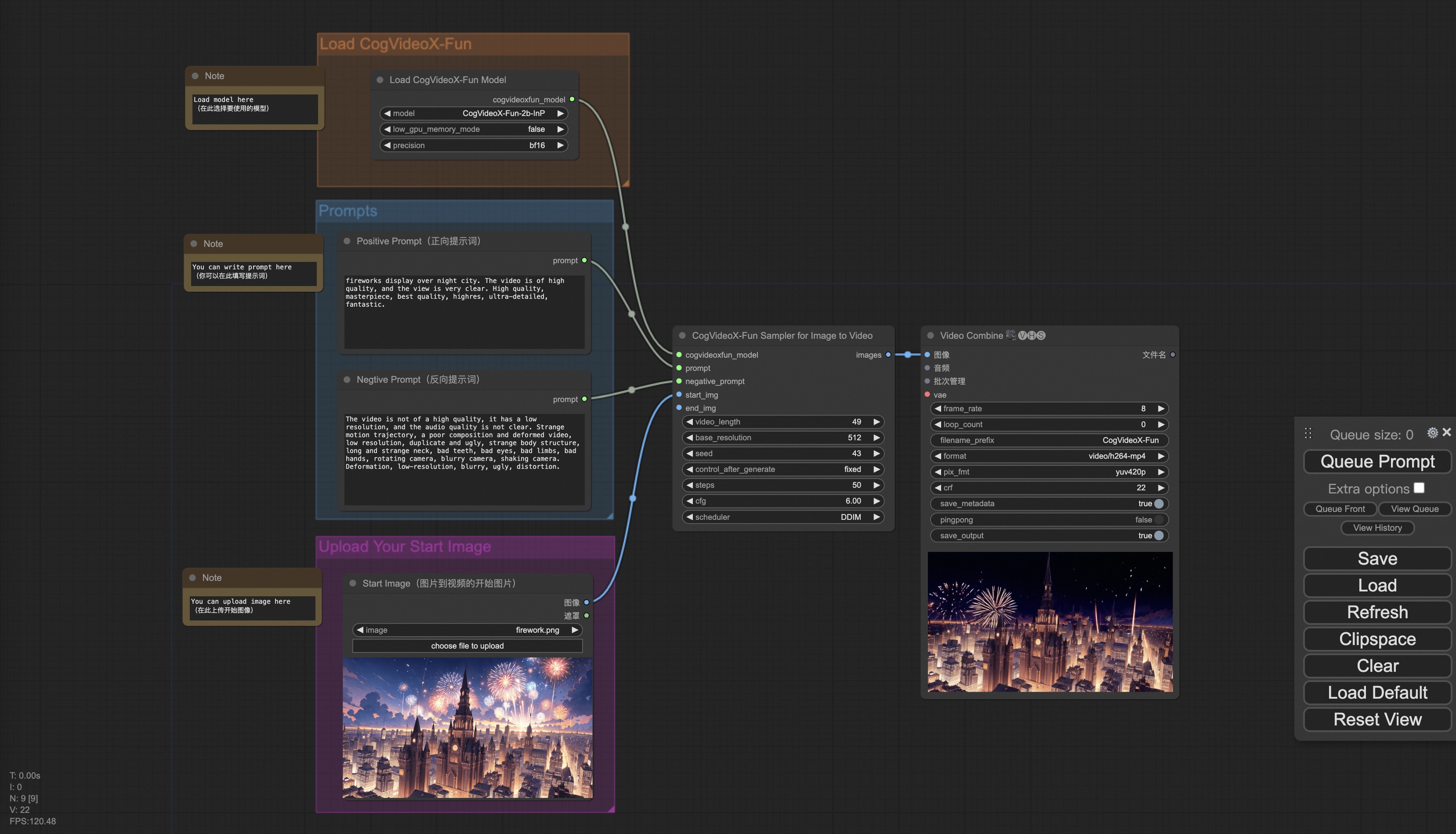

b. ComfyUIを通じて

ComfyUIのインターフェースは以下の通りです。詳細はComfyUI READMEを参照してください。

c. Dockerを通じて

Dockerを使用する場合は、マシンに正しくGPUドライバとCUDA環境がインストールされていることを確認してから、以下のコマンドを順に実行してください。

# イメージをプルする

docker pull mybigpai-public-registry.cn-beijing.cr.aliyuncs.com/easycv/torch_cuda:cogvideox_fun

# イメージに入る

docker run -it -p 7860:7860 --network host --gpus all --security-opt seccomp:unconfined --shm-size 200g mybigpai-public-registry.cn-beijing.cr.aliyuncs.com/easycv/torch_cuda:cogvideox_fun

# コードをクローンする

git clone https://github.com/aigc-apps/VideoX-Fun.git

# VideoX-Funのディレクトリに入る

cd VideoX-Fun

# 重みをダウンロードするためのディレクトリを作成する

mkdir models/Diffusion_Transformer

mkdir models/Personalized_Model

# モデルをダウンロードするには、hugginfaceリンクまたはmodelscopeリンクを使用してください。

# CogVideoX-Fun

# https://huggingface.co/alibaba-pai/CogVideoX-Fun-V1.1-5b-InP

# https://modelscope.cn/models/PAI/CogVideoX-Fun-V1.1-5b-InP

# Wan

# https://huggingface.co/alibaba-pai/Wan2.1-Fun-V1.1-14B-InP

# https://modelscope.cn/models/PAI/Wan2.1-Fun-V1.1-14B-InP

2. ローカルインストール: 環境チェック/ダウンロード/インストール

a. 環境チェック

このライブラリは以下の環境で動作することを確認しています。

Windowsの詳細情報:

- オペレーティングシステム: Windows 10

- python: python3.10 & python3.11

- pytorch: torch2.2.0

- CUDA: 11.8 & 12.1

- CUDNN: 8+

- GPU: Nvidia-3060 12G & Nvidia-3090 24G

Linuxの詳細情報:

- オペレーティングシステム: Ubuntu 20.04, CentOS

- python: python3.10 & python3.11

- pytorch: torch2.2.0

- CUDA: 11.8 & 12.1

- CUDNN: 8+

- GPU:Nvidia-V100 16G & Nvidia-A10 24G & Nvidia-A100 40G & Nvidia-A100 80G

約60GBの空きディスク容量が必要ですので、確認してください。

b. 重みの配置

重みを指定されたパスに配置することをおすすめします。

ComfyUIを通じて:

モデルをComfyuiの重みフォルダComfyUI/models/Fun_Models/に配置します。

📦 ComfyUI/

├── 📂 models/

│ └── 📂 Fun_Models/

│ ├── 📂 CogVideoX-Fun-V1.1-2b-InP/

│ ├── 📂 CogVideoX-Fun-V1.1-5b-InP/

│ ├── 📂 Wan2.1-Fun-V1.1-14B-InP

│ └── 📂 Wan2.1-Fun-V1.1-1.3B-InP/

独自のPythonファイルまたはUIを実行する場合:

📦 models/

├── 📂 Diffusion_Transformer/

│ ├── 📂 CogVideoX-Fun-V1.1-2b-InP/

│ ├── 📂 CogVideoX-Fun-V1.1-5b-InP/

│ ├── 📂 Wan2.1-Fun-V1.1-14B-InP

│ └── 📂 Wan2.1-Fun-V1.1-1.3B-InP/

├── 📂 Personalized_Model/

│ └── トレーニングしたトランスフォーマーモデル / トレーニングしたloraモデル (UIロード用)

✨ 主な機能

このプロジェクトは、テキストから動画を生成する機能を提供し、異なるバージョンのモデルをサポートしています。また、ComfyUIやDockerを通じた簡単な起動方法や、ローカルでのインストール方法も提供しています。

📦 モデルアドレス

V1.1

| 名称 | ストレージ容量 | Hugging Face | Model Scope | 説明 |

|---|---|---|---|---|

| Wan2.1-Fun-V1.1-1.3B-InP | 19.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-V1.1-1.3Bのテキストと画像から動画を生成する重みで、多解像度でトレーニングされ、最初と最後の画像の予測をサポートします。 |

| Wan2.1-Fun-V1.1-14B-InP | 47.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-V1.1-14Bのテキストと画像から動画を生成する重みで、多解像度でトレーニングされ、最初と最後の画像の予測をサポートします。 |

| Wan2.1-Fun-V1.1-1.3B-Control | 19.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-V1.1-1.3Bの動画制御重みで、Canny、Depth、Pose、MLSDなどの異なる制御条件をサポートし、参照画像と制御条件を組み合わせた制御や軌跡制御もサポートします。多解像度(512、768、1024)の動画予測をサポートし、81フレーム、毎秒16フレームでトレーニングされ、多言語予測をサポートします。 |

| Wan2.1-Fun-V1.1-14B-Control | 47.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-V1.1-14Bの動画制御重みで、Canny、Depth、Pose、MLSDなどの異なる制御条件をサポートし、参照画像と制御条件を組み合わせた制御や軌跡制御もサポートします。多解像度(512、768、1024)の動画予測をサポートし、81フレーム、毎秒16フレームでトレーニングされ、多言語予測をサポートします。 |

| Wan2.1-Fun-V1.1-1.3B-Control-Camera | 19.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-V1.1-1.3Bのカメラレンズ制御重みです。多解像度(512、768、1024)の動画予測をサポートし、81フレーム、毎秒16フレームでトレーニングされ、多言語予測をサポートします。 |

| Wan2.1-Fun-V1.1-14B-Control | 47.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-V1.1-14Bのカメラレンズ制御重みです。多解像度(512、768、1024)の動画予測をサポートし、81フレーム、毎秒16フレームでトレーニングされ、多言語予測をサポートします。 |

V1.0

| 名称 | ストレージ容量 | Hugging Face | Model Scope | 説明 |

|---|---|---|---|---|

| Wan2.1-Fun-1.3B-InP | 19.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-1.3Bのテキストと画像から動画を生成する重みで、多解像度でトレーニングされ、最初と最後の画像の予測をサポートします。 |

| Wan2.1-Fun-14B-InP | 47.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-14Bのテキストと画像から動画を生成する重みで、多解像度でトレーニングされ、最初と最後の画像の予測をサポートします。 |

| Wan2.1-Fun-1.3B-Control | 19.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-1.3Bの動画制御重みで、Canny、Depth、Pose、MLSDなどの異なる制御条件をサポートし、軌跡制御もサポートします。多解像度(512、768、1024)の動画予測をサポートし、81フレーム、毎秒16フレームでトレーニングされ、多言語予測をサポートします。 |

| Wan2.1-Fun-14B-Control | 47.0 GB | 🤗Link | 😄Link | Wan2.1-Fun-14Bの動画制御重みで、Canny、Depth、Pose、MLSDなどの異なる制御条件をサポートし、軌跡制御もサポートします。多解像度(512、768、1024)の動画予測をサポートし、81フレーム、毎秒16フレームでトレーニングされ、多言語予測をサポートします。 |

🎬 動画作品

Wan2.1-Fun-V1.1-14B-InP && Wan2.1-Fun-V1.1-1.3B-InP

Wan2.1-Fun-V1.1-14B-Control && Wan2.1-Fun-V1.1-1.3B-Control

一般的な制御動画 + 参照画像:

| 参照画像 | 制御動画 | Wan2.1-Fun-V1.1-14B-Control | Wan2.1-Fun-V1.1-1.3B-Control |

|

|

|||

一般的な制御動画 (Canny、Pose、Depthなど) と軌跡制御:

Wan2.1-Fun-V1.1-14B-Control-Camera && Wan2.1-Fun-V1.1-1.3B-Control-Camera

| 上方向にパン | 左方向にパン | 右方向にパン |

| 下方向にパン | 上方向と左方向にパン | 上方向と右方向にパン |

💻 使用例

1. 生成

a、VRAM節約方案

Wan2.1のパラメータが非常に大きいため、VRAMを節約して消費者向けGPUに対応するためのVRAM節約方案を考慮する必要があります。各予測ファイルにはGPU_memory_modeが提供されており、model_cpu_offload、model_cpu_offload_and_qfloat8、sequential_cpu_offloadから選択できます。この方案はCogVideoX-Funの生成にも適用されます。

- model_cpu_offloadは、モデル全体が使用後にCPUに移動し、一部のVRAMを節約できます。

- model_cpu_offload_and_qfloat8は、モデル全体が使用後にCPUに移動し、トランスフォーマーモデルをfloat8で量子化することで、より多くのVRAMを節約できます。

- sequential_cpu_offloadは、モデルの各層が使用後にCPUに移動し、速度は遅くなりますが、大量のVRAMを節約できます。

qfloat8はモデルの性能を一部低下させますが、より多くのVRAMを節約できます。VRAMが十分な場合は、model_cpu_offloadの使用をおすすめします。

b、ComfyUIを通じて

詳細はComfyUI READMEを参照してください。

c、Pythonファイルを実行する

- ステップ1:対応する重みをダウンロードし、modelsフォルダに配置します。

- ステップ2:異なる重みと予測目標に応じて、異なるファイルを使用して予測を行います。現在、このライブラリはCogVideoX-Fun、Wan2.1、Wan2.1-Funをサポートしており、examplesフォルダ内のフォルダ名で区別されます。異なるモデルがサポートする機能は異なるため、具体的な状況に応じて区別してください。CogVideoX-Funを例に説明します。

- テキストから動画を生成する:

- examples/cogvideox_fun/predict_t2v.pyファイル内のprompt、neg_prompt、guidance_scale、seedを変更します。

- その後、examples/cogvideox_fun/predict_t2v.pyファイルを実行し、生成結果を待ちます。結果はsamples/cogvideox-fun-videosフォルダに保存されます。

- 画像から動画を生成する:

- examples/cogvideox_fun/predict_i2v.pyファイル内のvalidation_image_start、validation_image_end、prompt、neg_prompt、guidance_scale、seedを変更します。

- validation_image_startは動画の開始画像、validation_image_endは動画の終了画像です。

- その後、examples/cogvideox_fun/predict_i2v.pyファイルを実行し、生成結果を待ちます。結果はsamples/cogvideox-fun-videos_i2vフォルダに保存されます。

- 動画から動画を生成する:

- examples/cogvideox_fun/predict_v2v.pyファイル内のvalidation_video、validation_image_end、prompt、neg_prompt、guidance_scale、seedを変更します。

- validation_videoは動画から動画を生成する際の参照動画です。以下の動画を使用してデモを実行できます:デモ動画

- その後、examples/cogvideox_fun/predict_v2v.pyファイルを実行し、生成結果を待ちます。結果はsamples/cogvideox-fun-videos_v2vフォルダに保存されます。

- 通常の制御で動画を生成する(Canny、Pose、Depthなど):

- examples/cogvideox_fun/predict_v2v_control.pyファイル内のcontrol_video、validation_image_end、prompt、neg_prompt、guidance_scale、seedを変更します。

- control_videoは動画を生成する際の制御動画で、Canny、Pose、Depthなどのオペレーターで抽出された動画です。以下の動画を使用してデモを実行できます:デモ動画

- その後、examples/cogvideox_fun/predict_v2v_control.pyファイルを実行し、生成結果を待ちます。結果はsamples/cogvideox-fun-videos_v2v_controlフォルダに保存されます。

- テキストから動画を生成する:

- ステップ3:独自にトレーニングした他のバックボーンとLoraを組み合わせる場合は、examples/{model_name}/predict_t2v.py内のexamples/{model_name}/predict_i2v.pyとlora_pathを適宜変更します。

d、UIを通じて

WebUIは、テキストから動画、画像から動画、動画から動画、通常の制御で動画を生成する機能をサポートしています。現在、このライブラリはCogVideoX-Fun、Wan2.1、Wan2.1-Funをサポートしており、examplesフォルダ内のフォルダ名で区別されます。異なるモデルがサポートする機能は異なるため、具体的な状況に応じて区別してください。CogVideoX-Funを例に説明します。

- ステップ1:対応する重みをダウンロードし、modelsフォルダに配置します。

- ステップ2:examples/cogvideox_fun/app.pyファイルを実行し、Gradioページにアクセスします。

- ステップ3:ページで生成モデルを選択し、prompt、neg_prompt、guidance_scale、seedなどを入力し、生成ボタンをクリックして生成結果を待ちます。結果はsampleフォルダに保存されます。

📚 参考文献

- CogVideo: https://github.com/THUDM/CogVideo/

- EasyAnimate: https://github.com/aigc-apps/EasyAnimate

- Wan2.1: https://github.com/Wan-Video/Wan2.1/

- ComfyUI-KJNodes: https://github.com/kijai/ComfyUI-KJNodes

- ComfyUI-EasyAnimateWrapper: https://github.com/kijai/ComfyUI-EasyAnimateWrapper

- ComfyUI-CameraCtrl-Wrapper: https://github.com/chaojie/ComfyUI-CameraCtrl-Wrapper

- CameraCtrl: https://github.com/hehao13/CameraCtrl

📄 ライセンス

このプロジェクトは Apache License (Version 2.0) を採用しています。

Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語