🚀 Controlnet - v1.1 - openpose Version

Controlnet v1.1は、Controlnet v1.0の後継モデルで、Lvmin Zhangによってlllyasviel/ControlNet-v1-1でリリースされました。

このチェックポイントは、元のチェックポイントをdiffusers形式に変換したものです。Stable Diffusion、例えばrunwayml/stable-diffusion-v1-5と組み合わせて使用することができます。

詳細については、🧨 Diffusers docsも参照してください。

ControlNetは、追加の条件を付与することで拡散モデルを制御するニューラルネットワーク構造です。

このチェックポイントは、openpose画像を条件としたControlNetに対応しています。

📚 ドキュメント

モデルの詳細

概要

Controlnetは、Lvmin ZhangとManeesh AgrawalaによるAdding Conditional Control to Text-to-Image Diffusion Modelsで提案されました。

概要は以下の通りです。

我々は、事前学習された大規模拡散モデルを制御して、追加の入力条件をサポートするニューラルネットワーク構造であるControlNetを提案します。ControlNetは、タスク固有の条件をエンドツーエンドで学習し、学習データセットが小さい場合(< 50k)でも学習は堅牢です。さらに、ControlNetの学習は拡散モデルの微調整と同じくらい速く、モデルは個人用デバイスで学習することができます。あるいは、強力な計算クラスタが利用可能な場合、モデルは大量(数百万から数十億)のデータにスケールすることができます。我々は、Stable Diffusionのような大規模拡散モデルにControlNetを追加することで、エッジマップ、セグメンテーションマップ、キーポイントなどの条件付き入力を可能にできることを報告します。これにより、大規模拡散モデルを制御する方法が豊富になり、関連するアプリケーションがさらに促進される可能性があります。

💻 使用例

基本的な使用法

このチェックポイントはStable Diffusion v1-5で学習されているため、同モデルと組み合わせて使用することをお勧めします。実験的には、このチェックポイントはdreamboothed stable diffusionなどの他の拡散モデルとも使用できます。

⚠️ 重要提示

画像を処理して補助条件を作成する場合は、以下に示すように外部依存関係が必要です。

- https://github.com/patrickvonplaten/controlnet_aux をインストールします。

$ pip install controlnet_aux==0.3.0

diffusersと関連パッケージをインストールします。

$ pip install diffusers transformers accelerate

- コードを実行します。

import torch

import os

from huggingface_hub import HfApi

from pathlib import Path

from diffusers.utils import load_image

from PIL import Image

import numpy as np

from controlnet_aux import OpenposeDetector

from diffusers import (

ControlNetModel,

StableDiffusionControlNetPipeline,

UniPCMultistepScheduler,

)

checkpoint = "lllyasviel/control_v11p_sd15_openpose"

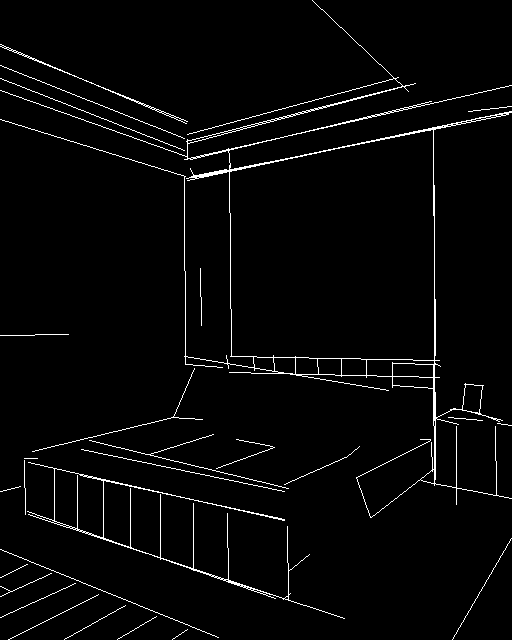

image = load_image(

"https://huggingface.co/lllyasviel/control_v11p_sd15_openpose/resolve/main/images/input.png"

)

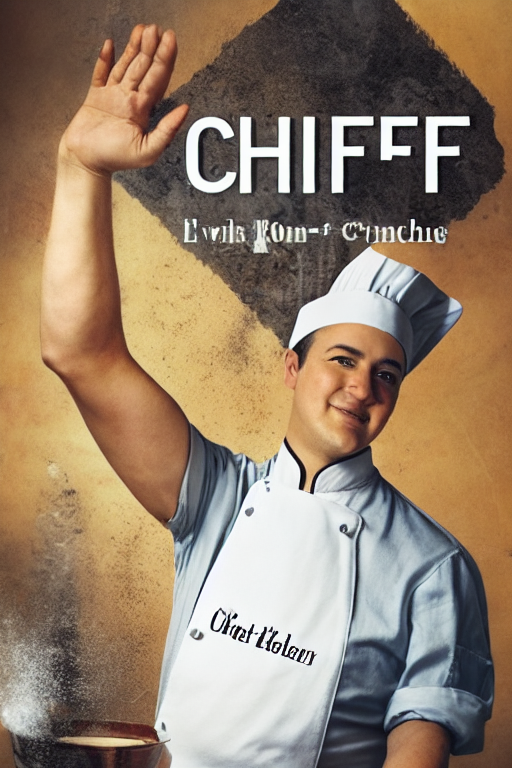

prompt = "chef in the kitchen"

processor = OpenposeDetector.from_pretrained('lllyasviel/ControlNet')

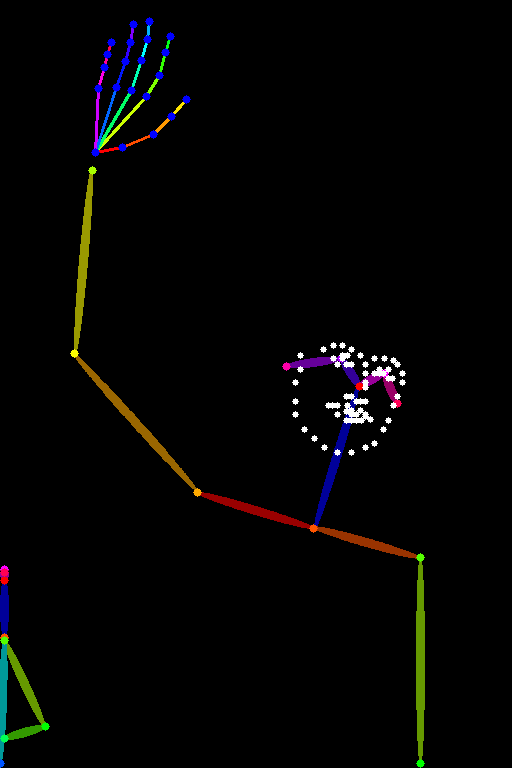

control_image = processor(image, hand_and_face=True)

control_image.save("./images/control.png")

controlnet = ControlNetModel.from_pretrained(checkpoint, torch_dtype=torch.float16)

pipe = StableDiffusionControlNetPipeline.from_pretrained(

"runwayml/stable-diffusion-v1-5", controlnet=controlnet, torch_dtype=torch.float16

)

pipe.scheduler = UniPCMultistepScheduler.from_config(pipe.scheduler.config)

pipe.enable_model_cpu_offload()

generator = torch.manual_seed(0)

image = pipe(prompt, num_inference_steps=30, generator=generator, image=control_image).images[0]

image.save('images/image_out.png')

🔧 技術詳細

他のリリースされたチェックポイントv1-1

著者らは、Stable Diffusion v1-5を使用して、異なるタイプの条件付きで学習された14種類の異なるチェックポイントをリリースしています。

Openpose 1.1の改善点

- このモデルの改善は、主にOpenPoseの改善された実装に基づいています。私たちは、pytorch OpenPoseとCMUのc++ openposeの違いを注意深く見直しました。現在、プロセッサはより正確になり、特に手に関しては精度が向上しています。プロセッサの改善により、Openpose 1.1の性能も向上しています。

- より多くの入力(手と顔)がサポートされています。

- 以前のcnet 1.0の学習データセットには、いくつかの問題がありました。

📄 ライセンス

このモデルはThe CreativeML OpenRAIL M licenseの下で提供されています。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語