🚀 ColPali: PaliGemma - 3BベースのColBERT戦略を用いた視覚検索モデル

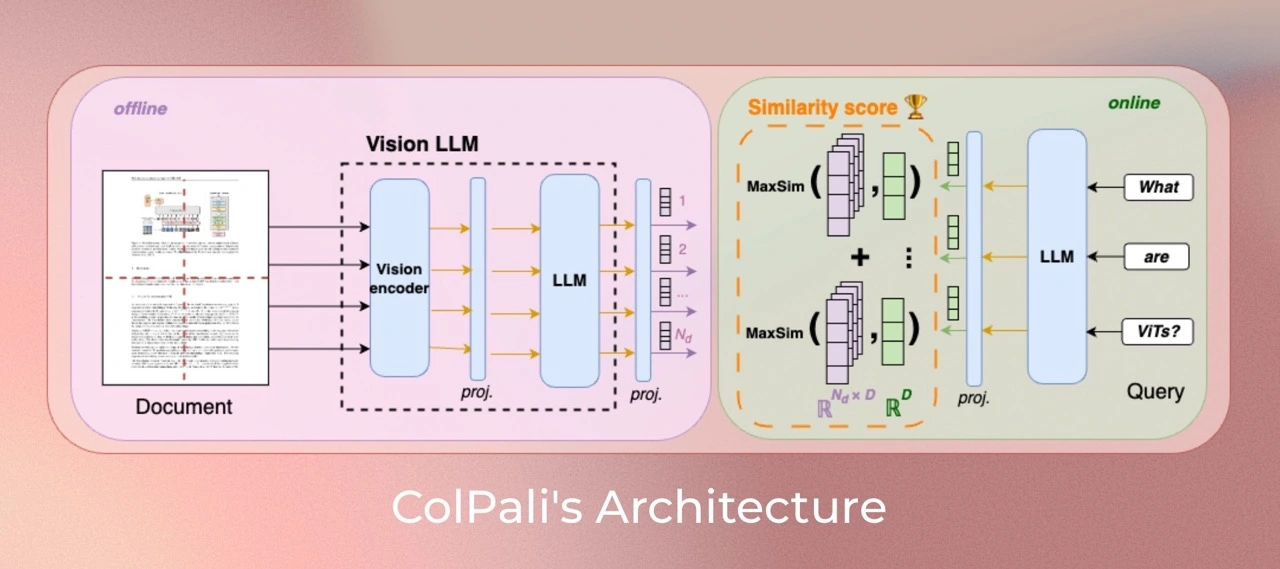

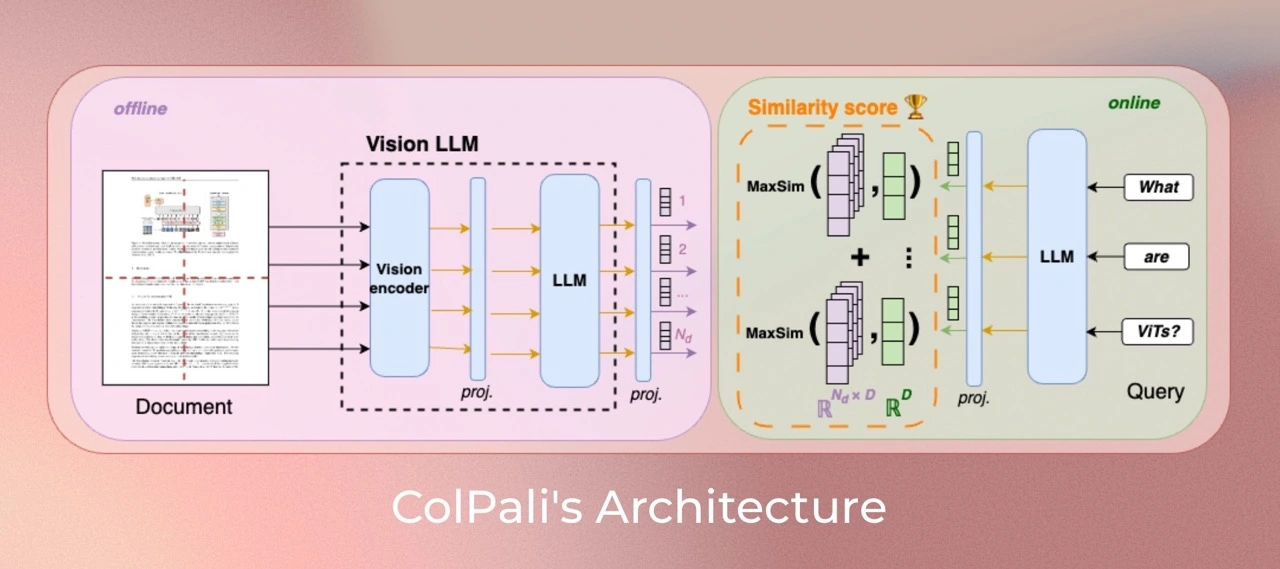

ColPaliは、ビジョン言語モデル(VLMs)に基づく新しいモデルアーキテクチャとトレーニング戦略を用いて、文書の視覚的特徴から効率的に文書をインデックス化するモデルです。これは、PaliGemma - 3Bを拡張したもので、ColBERTスタイルのテキストと画像の多ベクトル表現を生成します。このモデルは論文ColPali: Efficient Document Retrieval with Vision Language Modelsで紹介され、このリポジトリで最初に公開されました。

🚀 クイックスタート

このバージョンは、元のColPaliモデルと同じデータで、バッチサイズ256で3エポックのトレーニングを行っています。

✨ 主な機能

バージョンの特徴

このバージョンはcolpali - engine==0.2.0でトレーニングされていますが、>=0.2.0の任意のバージョンでロードすることができます。

vidore/colpaliと比較して、このバージョンはクエリの右パディングでトレーニングされており、クエリエンコーディングで不要なトークンを修正しています。また、固定されたvidore/colpaligemma - 3b - pt - 448 - baseに由来しており、決定的な射影層の初期化を保証します。このバージョンは5エポックでトレーニングされ、バッチ内ネガティブとハードマイニングされたネガティブを使用し、1000ステップ(10倍長い)のウォームアップを行って、非英語の言語崩壊を減らすのに役立ちます。データは論文で説明されているColPaliデータと同じです。

モデルの説明

このモデルは、既存の[SigLIP](https://huggingface.co/google/siglip - so400m - patch14 - 384)モデルから反復的に構築されています。これを微調整してBiSigLIPを作成し、SigLIPから出力されたパッチ埋め込みを大規模言語モデルである[PaliGemma - 3B](https://huggingface.co/google/paligemma - 3b - mix - 448)に入力してBiPaliを作成します。

画像パッチ埋め込みを言語モデルを通して入力することの利点の1つは、それらが自然にテキスト入力(クエリ)と同様の潜在空間にマッピングされることです。これにより、ColBERT戦略を利用して、テキストトークンと画像パッチの間の相互作用を計算することができ、BiPaliと比較して性能が大幅に向上します。

モデルのトレーニング

データセット

トレーニングデータセットは127,460のクエリ - ページペアで構成されており、公開されている学術データセットのトレーニングセット(63%)と、ウェブクロールされたPDF文書のページから構成され、VLM生成(Claude - 3 Sonnet)の疑似質問で拡張された合成データセット(37%)で構成されています。トレーニングセットは設計上完全に英語であり、非英語へのゼロショット汎化を研究することができます。明示的に、[ViDoRe](https://huggingface.co/collections/vidore/vidore - benchmark - 667173f98e70a1c0fa4db00d)とトレーニングセットの両方でマルチページPDF文書が使用されていないことを検証し、評価の汚染を防いでいます。ハイパーパラメータを調整するために、サンプルの2%で検証セットを作成しています。

注: 多言語データは言語モデル(Gemma - 2B)の事前学習コーパスに存在し、PaliGemma - 3Bのマルチモーダルトレーニング中に潜在的に発生します。

パラメータ

すべてのモデルはトレーニングセットで1エポックトレーニングされます。特に指定がない限り、モデルはbfloat16形式でトレーニングされ、低ランクアダプター(LoRA)を使用し、言語モデルのトランスフォーマー層と最後のランダムに初期化された射影層にalpha = 32およびr = 32を使用し、paged_adamw_8bitオプティマイザを使用します。データ並列で8GPUの設定でトレーニングされ、学習率は5e - 5で線形減衰し、2.5%のウォームアップステップを使用し、バッチサイズは32です。

📦 インストール

[colpali - engine](https://github.com/illuin - tech/colpali)をインストールします。

pip install colpali-engine>=0.3.0,<0.4.0

💻 使用例

基本的な使用法

from typing import cast

import torch

from PIL import Image

from colpali_engine.models import ColPali, ColPaliProcessor

model_name = "vidore/colpali-v1.3"

model = ColPali.from_pretrained(

model_name,

torch_dtype=torch.bfloat16,

device_map="cuda:0",

).eval()

processor = ColPaliProcessor.from_pretrained(model_name)

images = [

Image.new("RGB", (32, 32), color="white"),

Image.new("RGB", (16, 16), color="black"),

]

queries = [

"Is attention really all you need?",

"Are Benjamin, Antoine, Merve, and Jo best friends?",

]

batch_images = processor.process_images(images).to(model.device)

batch_queries = processor.process_queries(queries).to(model.device)

with torch.no_grad():

image_embeddings = model(**batch_images)

query_embeddings = model(**batch_queries)

scores = processor.score_multi_vector(query_embeddings, image_embeddings)

🔧 技術詳細

このモデルは、ビジョン言語モデルの新しいアプローチを用いており、文書の視覚的特徴を効率的に利用して文書を検索することができます。ColBERTスタイルの多ベクトル表現を生成することで、テキストと画像の相互作用をより細かく分析することができます。

📄 ライセンス

ColPaliのビジョン言語バックボーンモデル(PaliGemma)は、その[モデルカード](https://huggingface.co/google/paligemma - 3b - mix - 448)で指定されているgemmaライセンスの下にあります。モデルに付属するアダプターはMITライセンスの下にあります。

コンタクト

- Manuel Faysse: manuel.faysse@illuin.tech

- Hugues Sibille: hugues.sibille@illuin.tech

- Tony Wu: tony.wu@illuin.tech

引用

この組織のデータセットやモデルを研究で使用する場合は、元のデータセットを次のように引用してください。

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

モデル情報

| 属性 |

详情 |

| モデルタイプ |

ビジョン言語モデルに基づく視覚文書検索モデル |

| トレーニングデータ |

公開学術データセット(63%)と合成データセット(37%) |

重要提示

⚠️ 重要提示

このモデルは主にPDFタイプの文書とリソースの多い言語に焦点を当てているため、他の文書タイプや表現が少ない言語への汎化が制限される可能性があります。また、このモデルはColBERTの遅延相互作用メカニズムに由来する多ベクトル検索に依存しており、ネイティブの多ベクトルサポートがない一般的なベクトル検索フレームワークに適応させるにはエンジニアリングの努力が必要になる場合があります。

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語