🚀 ColQwen2.5: Qwen2.5-VL-3B-InstructベースのColBERT戦略によるビジュアル検索モデル

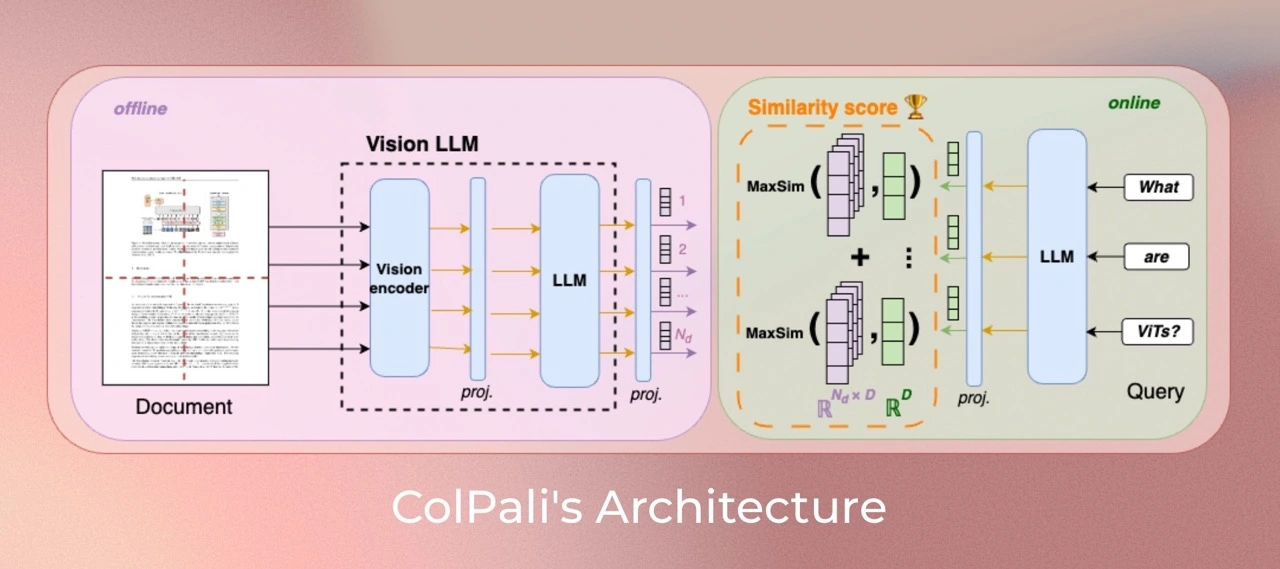

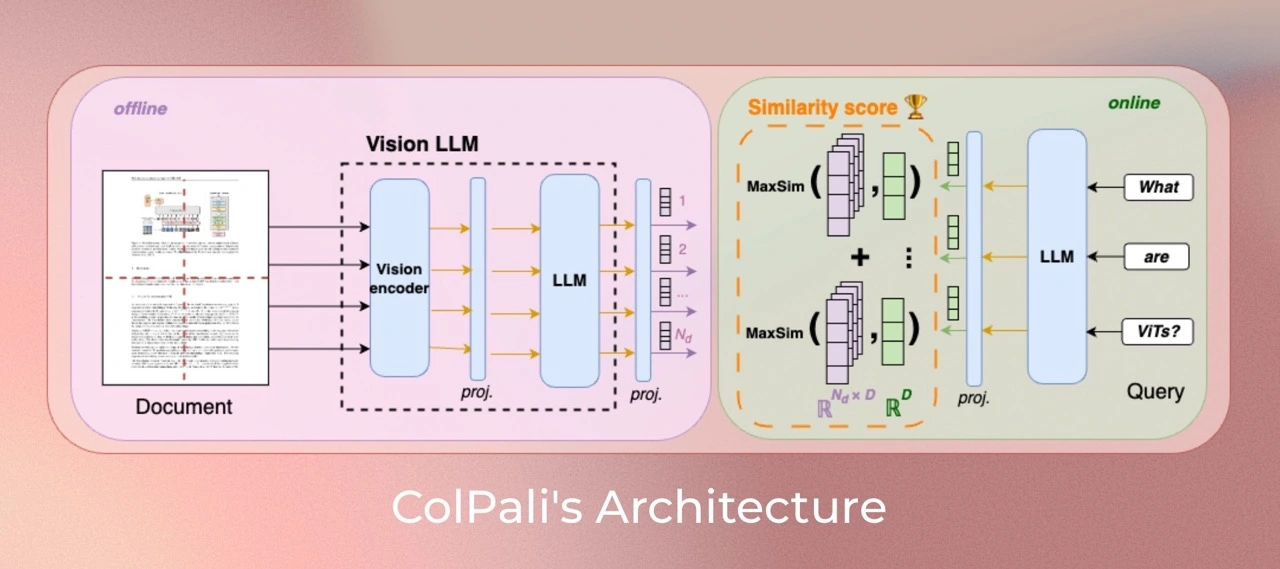

ColQwenは、ビジョン言語モデル(VLM)に基づく新しいモデルアーキテクチャとトレーニング戦略を用いて、ドキュメントのビジュアル特徴から効率的にインデックスを作成するモデルです。

これはQwen2.5-VL-3Bの拡張モデルで、ColBERTスタイルのテキストと画像の多ベクトル表現を生成します。

このモデルは論文ColPali: Efficient Document Retrieval with Vision Language Modelsで紹介され、このリポジトリで最初に公開されました。

🚀 クイックスタート

ColQwen2.5は、革新的なモデルアーキテクチャとトレーニング戦略を用いて、ビジュアル特徴からドキュメントを効率的にインデックス化します。以下の手順で簡単に使い始めることができます。

✨ 主な機能

- ビジョン言語モデル(VLM)に基づく新しいアーキテクチャとトレーニング戦略を採用。

- Qwen2.5-VL-3Bを拡張し、ColBERTスタイルの多ベクトル表現を生成。

- 動的な画像解像度を入力として受け付け、アスペクト比を変えずに処理。

📦 インストール

colpali-engineをソースからインストールするか、バージョン0.3.1以上でインストールしてください。また、transformersのバージョンは4.45.0以上が必要です。

pip install git+https://github.com/illuin-tech/colpali

💻 使用例

基本的な使用法

import torch

from PIL import Image

from transformers.utils.import_utils import is_flash_attn_2_available

from colpali_engine.models import ColQwen2_5, ColQwen2_5_Processor

model = ColQwen2_5.from_pretrained(

"vidore/colqwen2.5-v0.2",

torch_dtype=torch.bfloat16,

device_map="cuda:0",

attn_implementation="flash_attention_2" if is_flash_attn_2_available() else None,

).eval()

processor = ColQwen2_5_Processor.from_pretrained("vidore/colqwen2.5-v0.2")

images = [

Image.new("RGB", (32, 32), color="white"),

Image.new("RGB", (16, 16), color="black"),

]

queries = [

"Is attention really all you need?",

"What is the amount of bananas farmed in Salvador?",

]

batch_images = processor.process_images(images).to(model.device)

batch_queries = processor.process_queries(queries).to(model.device)

with torch.no_grad():

image_embeddings = model(**batch_images)

query_embeddings = model(**batch_queries)

scores = processor.score_multi_vector(query_embeddings, image_embeddings)

📚 ドキュメント

バージョンの特性

このモデルは動的な画像解像度を入力として受け付け、ColPaliのようにアスペクト比を変えずにリサイズしません。最大解像度は、最大768個の画像パッチが作成されるように設定されています。実験では、画像パッチの数を増やすことで明らかな改善が見られますが、メモリ要件が増加します。

このバージョンはcolpali-engine==0.3.7でトレーニングされています。データは論文で説明されているColPaliデータと同じです。

モデルのトレーニング

データセット

127,460のクエリ-ページペアからなるトレーニングデータセットは、公開されている学術データセットのトレーニングセット(63%)と、ウェブクロールしたPDFドキュメントのページから構成され、VLM生成(Claude-3 Sonnet)の疑似質問で拡張された合成データセット(37%)で構成されています。

トレーニングセットは設計上完全に英語であり、非英語言語へのゼロショット汎化を研究することができます。明示的に、ViDoReとトレーニングセットの両方でマルチページPDFドキュメントが使用されていないことを検証し、評価の汚染を防いでいます。

サンプルの2%を使用して検証セットを作成し、ハイパーパラメータを調整しています。

注: 多言語データは言語モデルの事前学習コーパスに存在し、おそらくマルチモーダルトレーニングにも存在します。

パラメータ

すべてのモデルはトレーニングセットで1エポックトレーニングされています。特に指定がない限り、モデルはbfloat16形式でトレーニングされ、低ランクアダプター(LoRA)を使用し、alpha=32 と r=32 を言語モデルのトランスフォーマーレイヤーと、最後のランダムに初期化された投影レイヤーに適用し、paged_adamw_8bitオプティマイザーを使用します。

8 GPU設定でデータ並列でトレーニングされ、学習率は5e-5で線形減衰し、2.5%のウォームアップステップがあり、バッチサイズは32です。

制限事項

- 焦点: このモデルは主にPDFタイプのドキュメントと高リソース言語に焦点を当てているため、他のドキュメントタイプやあまり表現されていない言語への汎化が制限される可能性があります。

- サポート: このモデルはColBERTの後期相互作用メカニズムに基づく多ベクトル検索に依存しているため、ネイティブの多ベクトルサポートがない一般的なベクトル検索フレームワークに適応させるにはエンジニアリング努力が必要になる場合があります。

📄 ライセンス

ColQwen2.5のビジョン言語バックボーンモデル(Qwen2.5-VL)はQwen RESEARCH LICENSE AGREEMENTライセンスの下にあります。モデルに付属するアダプターはMITライセンスの下にあります。

🔧 技術詳細

モデルの概要

ColQwenは、ビジョン言語モデル(VLM)に基づく新しいモデルアーキテクチャとトレーニング戦略を用いて、ドキュメントのビジュアル特徴から効率的にインデックスを作成します。これはQwen2.5-VL-3Bの拡張モデルで、ColBERTスタイルの多ベクトル表現を生成します。

トレーニングの詳細

データセット

トレーニングデータセットは、公開されている学術データセットのトレーニングセットと合成データセットで構成されています。合成データセットは、ウェブクロールしたPDFドキュメントのページから構成され、VLM生成(Claude-3 Sonnet)の疑似質問で拡張されています。

パラメータ

すべてのモデルは1エポックでトレーニングされ、bfloat16形式で学習されます。低ランクアダプター(LoRA)を使用し、alpha=32 と r=32 を言語モデルのトランスフォーマーレイヤーと、最後のランダムに初期化された投影レイヤーに適用します。paged_adamw_8bitオプティマイザーを使用し、学習率は5e-5で線形減衰し、2.5%のウォームアップステップがあります。

バージョンの特性

このモデルは動的な画像解像度を入力として受け付け、アスペクト比を変えずにリサイズしません。最大解像度は、最大768個の画像パッチが作成されるように設定されています。実験では、画像パッチの数を増やすことで明らかな改善が見られますが、メモリ要件が増加します。

🔗 コンタクト

- Manuel Faysse: manuel.faysse@illuin.tech

- Hugues Sibille: hugues.sibille@illuin.tech

- Tony Wu: tony.wu@illuin.tech

📖 引用

この組織のデータセットやモデルを研究で使用する場合は、以下のように元のデータセットを引用してください。

@misc{faysse2024colpaliefficientdocumentretrieval,

title={ColPali: Efficient Document Retrieval with Vision Language Models},

author={Manuel Faysse and Hugues Sibille and Tony Wu and Bilel Omrani and Gautier Viaud and Céline Hudelot and Pierre Colombo},

year={2024},

eprint={2407.01449},

archivePrefix={arXiv},

primaryClass={cs.IR},

url={https://arxiv.org/abs/2407.01449},

}

Transformers 複数言語対応

Transformers 複数言語対応 Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語 Transformers 英語

Transformers 英語