モデル概要

モデル特徴

モデル能力

使用事例

🚀 Stable Diffusion v1-5 モデルカード

Stable Diffusionは、任意のテキスト入力に基づいて写真のようにリアルな画像を生成できる潜在的なテキストから画像への拡散モデルです。このモデルは、Appleのリポジトリを使用してHugging Faceによって生成され、ASCLが適用されています。

これらの重みは、Apple Siliconハードウェアで使用するためにCore MLに変換されています。

🚀 クイックスタート

このモデルは、潜在的なテキストから画像への拡散モデルであり、任意のテキスト入力に基づいて写真のようにリアルな画像を生成できます。詳細については、🤗のStable Diffusionブログを参照してください。

✨ 主な機能

- 任意のテキスト入力に基づいて写真のようにリアルな画像を生成できます。

- これらの重みは、Apple Siliconハードウェアで使用するためにCore MLに変換されています。

📚 ドキュメント

モデルの詳細

| プロパティ | 詳細 |

|---|---|

| 開発者 | Robin Rombach, Patrick Esser |

| モデルタイプ | 拡散ベースのテキストから画像への生成モデル |

| 言語 | 英語 |

| ライセンス | The CreativeML OpenRAIL M license は、Open RAIL M license であり、BigScience と the RAIL Initiative が共同で行っている責任あるAIライセンスの分野の作業から適応されています。また、the article about the BLOOM Open RAIL license も参照してください。 |

| モデルの説明 | これは、テキストプロンプトに基づいて画像を生成および変更するために使用できるモデルです。Latent Diffusion Model であり、Imagen paper で提案されているように、固定された事前学習済みのテキストエンコーダー (CLIP ViT-L/14) を使用しています。 |

| 詳細情報のリソース | GitHub Repository, Paper |

| 引用 | @InProceedings{Rombach_2022_CVPR, |

用途

直接的な使用

このモデルは研究目的のみを意図しています。可能な研究分野やタスクには以下が含まれます。

- 有害なコンテンツを生成する可能性のあるモデルの安全な展開。

- 生成モデルの制限やバイアスの調査と理解。

- アートワークの生成とデザインや他の芸術的プロセスでの使用。

- 教育または創造的ツールでの応用。

- 生成モデルに関する研究。

除外される使用については以下で説明します。

誤用、悪意のある使用、および範囲外の使用

このモデルは、人々に敵対的または疎外感を与える環境を生み出す画像を意図的に作成または拡散するために使用されるべきではありません。これには、人々が不快、苦痛、または不快感を感じると予想される画像の生成、または歴史的または現在のステレオタイプを広めるコンテンツが含まれます。

範囲外の使用

このモデルは、人やイベントの事実的または真実の表現を生成するように訓練されていないため、そのようなコンテンツを生成するためにモデルを使用することは、このモデルの能力範囲外です。

誤用と悪意のある使用

このモデルを使用して個人に残酷なコンテンツを生成することは、このモデルの誤用です。これには以下が含まれますが、これらに限定されません。

- 人やその環境、文化、宗教などの侮辱的、非人間的、またはその他の有害な表現の生成。

- 差別的なコンテンツまたは有害なステレオタイプを意図的に宣伝または拡散すること。

- 個人の同意なしになりすましすること。

- 見る人の同意なしの性的コンテンツ。

- 誤情報と偽情報。

- 重大な暴力やグロテスクな表現。

- 著作権またはライセンスされた素材をその使用条件に違反して共有すること。

- 著作権またはライセンスされた素材の改変コンテンツをその使用条件に違反して共有すること。

制限とバイアス

制限

- モデルは完全な写真のようなリアリズムを達成しません。

- モデルは読めるテキストをレンダリングできません。

- モデルは、「青い球体の上に赤い立方体」に対応する画像をレンダリングするなど、構成性を伴うより難しいタスクではうまく機能しません。

- 顔や人全体が適切に生成されない場合があります。

- モデルは主に英語のキャプションで訓練されており、他の言語ではうまく機能しません。

- モデルのオートエンコーディング部分は損失があります。

- モデルは大規模なデータセット LAION-5B で訓練されており、成人向けの素材が含まれており、追加の安全メカニズムと考慮なしに製品で使用するには適していません。

- データセットの重複排除に追加の対策は使用されていません。その結果、訓練データに重複する画像についてはある程度の記憶が見られます。訓練データは https://rom1504.github.io/clip-retrieval/ で検索でき、記憶された画像の検出に役立つ可能性があります。

バイアス

画像生成モデルの能力は印象的ですが、社会的バイアスを強化または悪化させる可能性もあります。Stable Diffusion v1は、LAION-2B(en) のサブセットで訓練されており、主に英語の説明に限定された画像で構成されています。他の言語を使用するコミュニティや文化のテキストや画像は、十分に考慮されていない可能性があります。これは、白人や西洋文化がデフォルトとして設定されることが多いため、モデルの全体的な出力に影響を与えます。さらに、モデルが英語以外のプロンプトでコンテンツを生成する能力は、英語のプロンプトと比較して大幅に劣ります。

セーフティモジュール

このモデルの意図された使用方法は、Diffusersの Safety Checker を使用することです。このチェッカーは、モデルの出力を既知のハードコードされたNSFW概念と比較することで機能します。これらの概念は、このフィルターの逆エンジニアリングの可能性を減らすために意図的に隠されています。具体的には、チェッカーは画像生成後の CLIPTextModel の埋め込み空間で有害な概念のクラス確率を比較します。これらの概念は、生成された画像とともにモデルに渡され、各NSFW概念の手動で設計された重みと比較されます。

訓練

訓練データ

モデル開発者は、以下のデータセットをモデルの訓練に使用しました。

- LAION-2B (en) およびそのサブセット (次のセクションを参照)

訓練手順

Stable Diffusion v1-5は、オートエンコーダーとオートエンコーダーの潜在空間で訓練された拡散モデルを組み合わせた潜在拡散モデルです。訓練中は以下の手順が行われます。

- 画像はエンコーダーを通じてエンコードされ、画像が潜在表現に変換されます。オートエンコーダーは相対的なダウンサンプリング係数8を使用し、形状が H x W x 3 の画像を形状が H/f x W/f x 4 の潜在表現にマッピングします。

- テキストプロンプトはViT-L/14テキストエンコーダーを通じてエンコードされます。

- テキストエンコーダーの非プール出力は、クロスアテンションを介して潜在拡散モデルのUNetバックボーンに入力されます。

- 損失は、潜在表現に追加されたノイズとUNetによる予測との間の再構成目的です。

現在、6つのStable Diffusionチェックポイントが提供されており、以下のように訓練されています。

-

stable-diffusion-v1-1: laion2B-en で解像度256x256で237,000ステップ。laion-high-resolution (LAION-5Bから解像度>= 1024x1024の170Mの例) で解像度512x512で194,000ステップ。 -

stable-diffusion-v1-2:stable-diffusion-v1-1から再開。"laion-improved-aesthetics" (laion2B-enのサブセットで、元のサイズ>= 512x512、推定美学スコア> 5.0、推定ウォーターマーク確率< 0.5の画像にフィルタリングされたもの。ウォーターマーク推定はLAION-5Bメタデータから、美学スコアは improved aesthetics estimator を使用して推定されます) で解像度512x512で515,000ステップ。 -

stable-diffusion-v1-3:stable-diffusion-v1-2から再開 - "laion-improved-aesthetics" で解像度512x512で195,000ステップ、およびテキスト条件付けの10%をドロップして classifier-free guidance sampling を改善。 -

stable-diffusion-v1-4stable-diffusion-v1-2から再開 - "laion-aesthetics v2 5+" で解像度512x512で225,000ステップ、およびテキスト条件付けの10%をドロップして classifier-free guidance sampling を改善。 -

stable-diffusion-v1-5stable-diffusion-v1-2から再開 - "laion-aesthetics v2 5+" で解像度512x512で595,000ステップ、およびテキスト条件付けの10%をドロップして classifier-free guidance sampling を改善。 -

stable-diffusion-inpaintingstable-diffusion-v1-5から再開 - その後、「laion-aesthetics v2 5+」で解像度512x512で440,000ステップのインペイント訓練、およびテキスト条件付けの10%をドロップ。インペイントの場合、UNetには追加の5つの入力チャネル (エンコードされたマスク画像用の4つとマスク自体用の1つ) があり、その重みは非インペイントチェックポイントを復元した後にゼロ初期化されます。訓練中は、合成マスクを生成し、25%の確率ですべてをマスクします。 -

ハードウェア: 32 x 8 x A100 GPUs

-

オプティマイザー: AdamW

-

勾配累積: 2

-

バッチ: 32 x 8 x 2 x 4 = 2048

-

学習率: 10,000ステップで0.0001までウォームアップし、その後一定に維持

評価結果

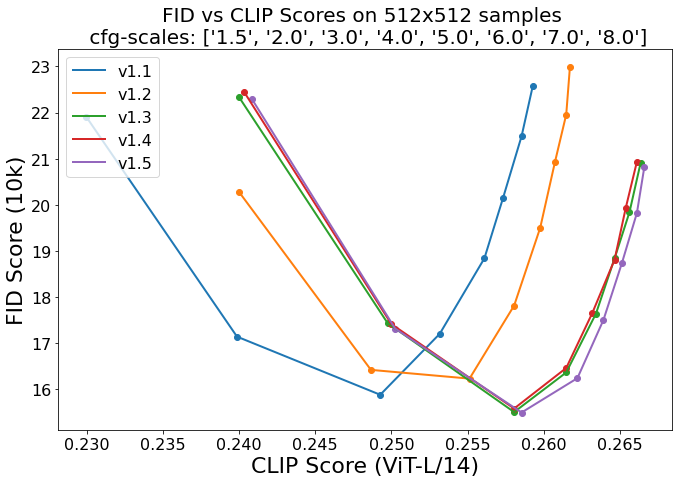

異なる分類器なしガイダンススケール (1.5, 2.0, 3.0, 4.0, 5.0, 6.0, 7.0, 8.0) および50 PNDM/PLMSサンプリングステップでの評価は、チェックポイントの相対的な改善を示しています。

COCO2017検証セットからの10000のランダムなプロンプトを使用して50 PLMSステップで評価され、解像度512x512で評価されました。FIDスコアの最適化は行われていません。

環境への影響

Stable Diffusion v1 推定排出量

この情報に基づいて、Lacoste et al. (2019) で提示された Machine Learning Impact calculator を使用して、以下のCO2排出量を推定します。ハードウェア、実行時間、クラウドプロバイダー、およびコンピュートリージョンを利用して炭素影響を推定しました。

- ハードウェアタイプ: A100 PCIe 40GB

- 使用時間: 150000時間

- クラウドプロバイダー: AWS

- コンピュートリージョン: US-east

- 排出された炭素 (電力消費 x 時間 x 電力網の場所に基づく炭素排出量): 11250 kg CO2 eq.

引用

@InProceedings{Rombach_2022_CVPR,

author = {Rombach, Robin and Blattmann, Andreas and Lorenz, Dominik and Esser, Patrick and Ommer, Bj\"orn},

title = {High-Resolution Image Synthesis With Latent Diffusion Models},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

month = {June},

year = {2022},

pages = {10684-10695}

}

このモデルカードは、Robin RombachとPatrick Esserによって作成され、DALL-E Miniモデルカード に基づいています。

Transformers

Transformers Transformers 英語

Transformers 英語 Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers

Transformers Transformers 複数言語対応

Transformers 複数言語対応 Transformers

Transformers Transformers 複数言語対応

Transformers 複数言語対応 Transformers 英語

Transformers 英語