Mask2former Swin Large Coco Instance

Mask2Former是基於Transformer的統一圖像分割模型,採用Swin-Large骨幹網絡並在COCO數據集上微調,專精實例分割任務

Downloads 37.31k

Release Time : 1/2/2023

Model Overview

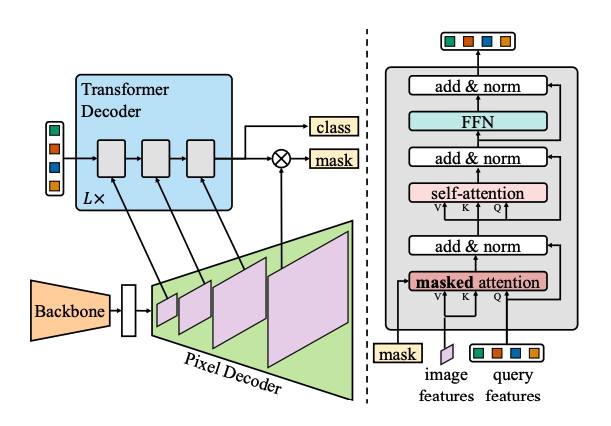

該模型通過預測一組掩碼及對應標籤實現實例分割,採用多尺度可變形注意力機制提升性能,是MaskFormer的改進版本

Model Features

統一分割框架

通過相同架構處理實例/語義/全景分割任務,簡化流程

多尺度可變形注意力

替代傳統像素解碼器,顯著提升特徵提取效率

掩碼注意力機制

在Transformer解碼器中引入掩碼注意力,提升性能而不增加計算負擔

高效訓練策略

通過採樣點計算損失而非整張掩碼,訓練速度提升3倍

Model Capabilities

圖像實例分割

多目標檢測與分割

複雜場景解析

Use Cases

計算機視覺

物體實例分割

對圖像中的每個物體實例生成精確分割掩碼

在COCO數據集上達到SOTA性能

場景理解

解析複雜場景中的物體分佈與空間關係

Featured Recommended AI Models

Llama 3 Typhoon V1.5x 8b Instruct

專為泰語設計的80億參數指令模型,性能媲美GPT-3.5-turbo,優化了應用場景、檢索增強生成、受限生成和推理任務

大型語言模型 Transformers Supports Multiple Languages

Transformers Supports Multiple Languages

Transformers Supports Multiple Languages

Transformers Supports Multiple LanguagesL

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-Tiny是一個基於SODA數據集訓練的超小型對話模型,專為邊緣設備推理設計,體積僅為Cosmo-3B模型的2%左右。

對話系統 Transformers English

Transformers English

Transformers English

Transformers EnglishC

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

基於RoBERTa架構的中文抽取式問答模型,適用於從給定文本中提取答案的任務。

問答系統 Chinese

R

uer

2,694

98