Git Base Textvqa

GITはTransformerベースの視覚言語モデルで、画像をテキスト記述に変換でき、特にTextVQAタスク向けにファインチューニングされています。

ダウンロード数 1,182

リリース時間 : 12/6/2022

モデル概要

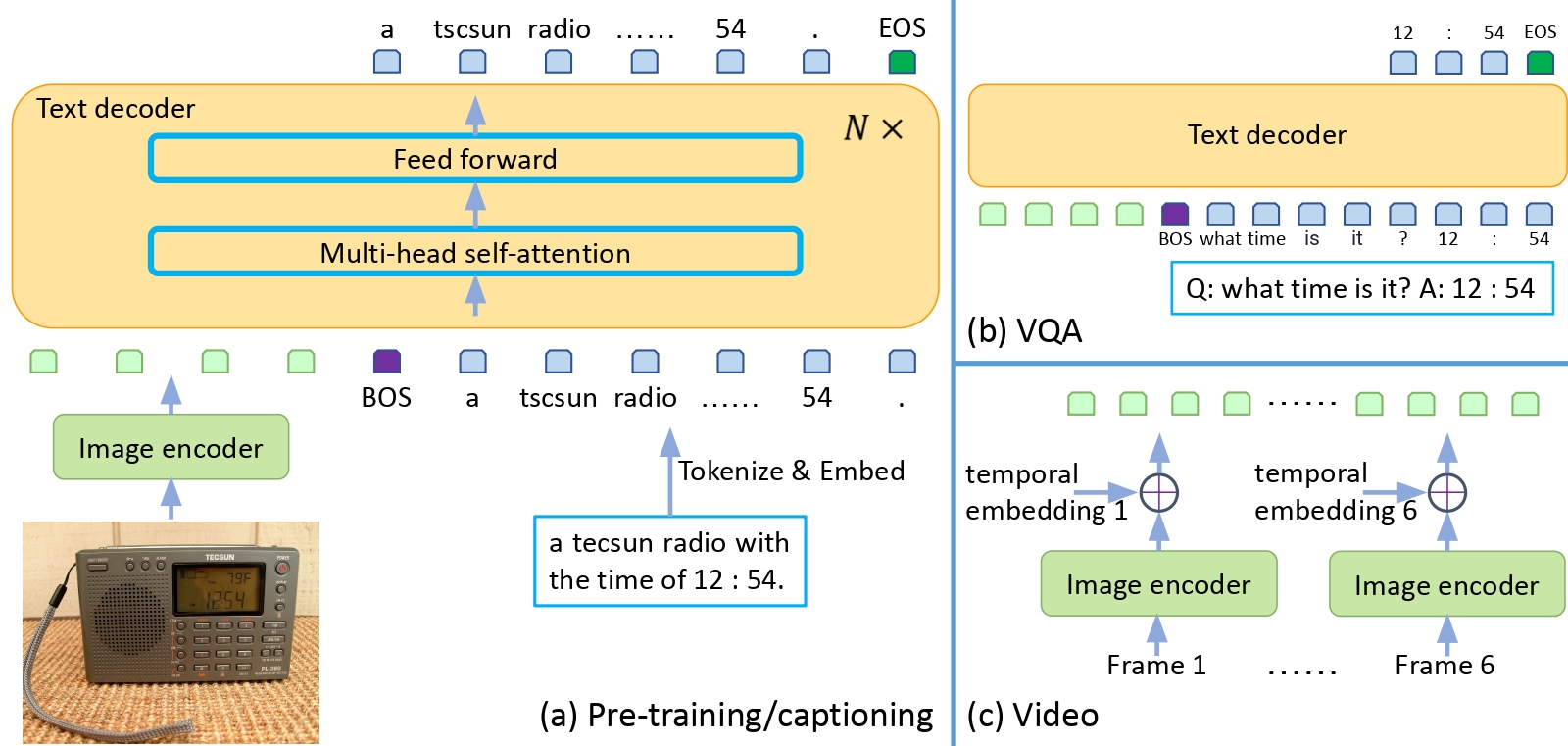

このモデルはCLIP画像トークンとテキストトークンで条件付けされて訓練され、画像キャプション生成や視覚的質問応答などのタスクを実行できます。ベースバージョンは1000万の画像-テキストペアで訓練され、TextVQAタスク向けにファインチューニングされています。

モデル特徴

双方向画像アテンション

モデルは画像パッチトークンに完全アクセスでき、双方向アテンションメカニズムを使用します

因果的テキスト生成

次のテキストトークンを予測する際、先行するテキストトークンのみにアクセス可能で、因果的アテンションマスクを使用します

マルチタスク適応性

画像キャプション生成、視覚的質問応答、画像分類など様々なタスクに使用可能

モデル能力

画像キャプション生成

視覚的質問応答

画像分類

テキスト生成

使用事例

視覚的質問応答

TextVQA

画像内のテキスト内容に基づく質問に回答

TextVQAタスク向けに特別にファインチューニングされています

画像理解

画像キャプション生成

画像に対して記述的なテキストを生成

おすすめAIモデル

Llama 3 Typhoon V1.5x 8b Instruct

タイ語専用に設計された80億パラメータの命令モデルで、GPT-3.5-turboに匹敵する性能を持ち、アプリケーションシナリオ、検索拡張生成、制限付き生成、推論タスクを最適化

大規模言語モデル Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応

Transformers 複数言語対応L

scb10x

3,269

16

Cadet Tiny

Openrail

Cadet-TinyはSODAデータセットでトレーニングされた超小型対話モデルで、エッジデバイス推論向けに設計されており、体積はCosmo-3Bモデルの約2%です。

対話システム Transformers 英語

Transformers 英語

Transformers 英語

Transformers 英語C

ToddGoldfarb

2,691

6

Roberta Base Chinese Extractive Qa

RoBERTaアーキテクチャに基づく中国語抽出型QAモデルで、与えられたテキストから回答を抽出するタスクに適しています。

質問応答システム 中国語

R

uer

2,694

98